DiceHuBERT는 HuBERT를 압축하기 위한 지식 증류 프레임워크로, 기존의 층별 및 특징별 매핑을 사용하는 방법과 달리 HuBERT의 자체 증류 메커니즘을 활용하여 원래 모델을 학생 모델로 직접 대체함으로써 학생이 HuBERT 사전 훈련시 사용된 동일한 자가 지도 학습 목표를 사용하여 학습되도록 함.

DiceHuBERT는 HuBERT를 압축하기 위한 지식 증류 프레임워크로, 기존의 층별 및 특징별 매핑을 사용하는 방법과 달리 HuBERT의 자체 증류 메커니즘을 활용하여 원래 모델을 학생 모델로 직접 대체함으로써 학생이 HuBERT 사전 훈련시 사용된 동일한 자가 지도 학습 목표를 사용하여 학습되도록 함.

비디오 생성 분야는 놀라운 발전을 이루었지만, 강력하고 확장 가능한 모델의 개발을 지도할 명확하고 체계적인 레시피에 대한 긴급한 필요성이 여전히 존재합니다. 본 연구에서는 모델 아키텍처, 훈련 레시피 및 데이터 정리 전략의 상호 작용을 체계적으로 탐구하는 포괄적인 연구를 제시하며, STIV라는 간단하고 확장 가능한 텍스트-이미지-조건부 비디오 생성 방법을 완성했습니다. 우리의 프레임워크는 이미지 조건을 DiT(Diffusion Transformer)에 프레임 교체를 통해 통합하면서 텍스트 조건을 통합합니다.

특이 발화의 음향 특성이 파악모델의 성능에 영향을 줄 수 있다. 특이 발화 데이터셋을 사용해 음성으로부터 감정을 인식하는 모델의 성능을 평가했으며, 전형적인 발화 데이터셋과 비교했다. 인텔리지빌리티, 모노피치, 가혹함 세 가지 발화 특징을 조사했다.

다국어 대규모 언어 모델(mLLMs)에서 언어 간 정렬된 표현은 교차언어 작업의 성능을 향상시킬 수 있습니다. 보통 정렬은 모델을 세밀하게 조정하는 것을 필요로 하는데, 이는 계산적으로 비싸며 종종 충분한 언어 데이터가 없을 수 있습니다. 모델 개입은 세부 조정에 대안이 될 수 있습니다. 우리는 인기있는 개입 방법(전문가 찾기)이 교차언어 표현의 정렬에 미치는 영향을 분석합니다.

딥러닝 모델의 매개변수 수가 증가함에 따라 자원 제한된 장치에 배포하기 위한 효과적인 압축 기술이 필요하다. 이 논문은 정보 기하학을 적용하여 모델 압축 영역에서 기존 방법을 분석하고, 주로 연산자 인수분해에 초점을 맞춘다. 이 관점을 채택함으로써 핵심 과제를 강조하는데, 최적의 저연산 하위다양체(또는 부분집합)를 정의하고 그 위에 투영하는 것이다. 많은 성공적인 모델 압축 접근법이 이해될 수 있다고 주장한다.

이 논문은 2025년 Large Language Model Memorization (L2M2) 워크샵에서 받았다. 대형 언어 모델(Large Language Models, LLMs)은 다양한 작업에 귀중한 도우미가 되었지만, 사용자 대화를 기억하고 맞춤 응답하는 능력이 제한된다. 이 논문에서는 이전 대화의 지식을 LLM에 주입하여 개인화 작업을 더 나아가게 하는 방법을 탐구한다.

이 연구는 대규모 언어 모델이 복잡한 작업 실행이 가능한 디지털 어시스턴트를 구동하는 잠재력을 평가한다. ASPERA는 어시스턴트 라이브러리 시뮬레이션과 인간 지원 LLM 데이터 생성 엔진으로 구성된 프레임워크로, 개발자들이 LLM이 고품질의 작업을 생성하도록 안내할 수 있도록 한다.

대규모 언어 모델(LLM)을 평가하고 피드백하기 위해 모델 응답에 대한 쌍별 선호도가 널리 수집됩니다. 이 데이터는 전통적인 하드 코딩된 지표를 얻기 어려운 도메인에서 모델 진행 상황을 측정하거나 모델 세부 조정을 돕는 데 도움이 될 수 있습니다. 그러나 일부 도메인에서는 이러한 쌍별 비교를 얻는 것이 까다로울 수 있습니다.

mRAKL은 저자원 언어를 위한 다국어 검색 보강 지식 그래프 구축을 위한 시스템으로, 다국어 지식 그래프 구축 작업을 질문 응답(QA) 작업으로 재정의하고, RAG 기반 시스템을 도입하여 수행합니다. 실험은 헤드 엔티티와 링크 관계를 활용하여 모델이 꼬리 엔티티를 예측하도록 합니다.

최근 대형 언어 모델의 발전으로 인해 인간과 유사한 에이전트 능력을 평가하기 위한 종합적인 벤치마크의 수요가 증가했다. 기존의 벤치마크는 특정 응용 시나리오에 초점을 맞추고 작업 완료를 강조하지만 결과를 이끌어내는 기본적인 기술을 분석하지 못하는 경우가 많다. 이러한 세부성의 부족으로 인해 실패의 원인을 심층적으로 이해하기 어렵다. 또한, 이러한 환경을 설정하는 데 상당한 노력이 필요하며 대화형 작업에서는 신뢰성과 재현성 문제가 발생할 수 있다.

다중 정확도와 다중 캘리브레이션은 학습과 계산 복잡성에서 다양한 응용을 찾은 예측의 다중 그룹 공정 개념이다. 이는 약한 어고노틱 학습이라는 하나의 학습 기본 원리로부터 이루어질 수 있다. 이 연구에서는 다중 정확도를 학습 기본 원리로서의 힘을 조사했으며, 캘리브레이션의 추가 가정 없이도 다중 정확도의 역량이 상당히 약하다는 것을 발견했다. 그러나 글로벌 캘리브레이션을 추가하면(이 개념을 캘리브레이션된 다중 정확도라고 함) 그 역량이 크게 향상되어, 이전에 파악되지 않았던 시사점을 복구할 수 있음을 발견했다.

Apple은 오스트리아 비엔나에서 7월 27일부터 8월 1일까지 진행되는 연례 컴퓨터언어학 협회(Association for Computational Linguistics, ACL) 대회에서 새로운 연구를 발표할 예정이다. ACL은 자연어에 대한 컴퓨터 접근 방식에 관심 있는 다양한 연구 분야를 다루는 컴퓨터언어학 분야의 학회이다.

2024년 애플이 인간중심 머신러닝 워크샵을 개최한다. 이 접근 방식은 ML 및 AI 기술을 사용하는 사람들의 필요와 가치를 우선시하여 인간 능력을 보완하고 향상시키는 AI를 만들어낸다. HCML 영역의 연구는 투명하고 해석 가능한 머신러닝 시스템 개발로 사용자들이 AI를 더 안전하게 사용하도록 돕고 부정적인 사회적 영향을 예측하고 예방하는 전략을 다룬다.

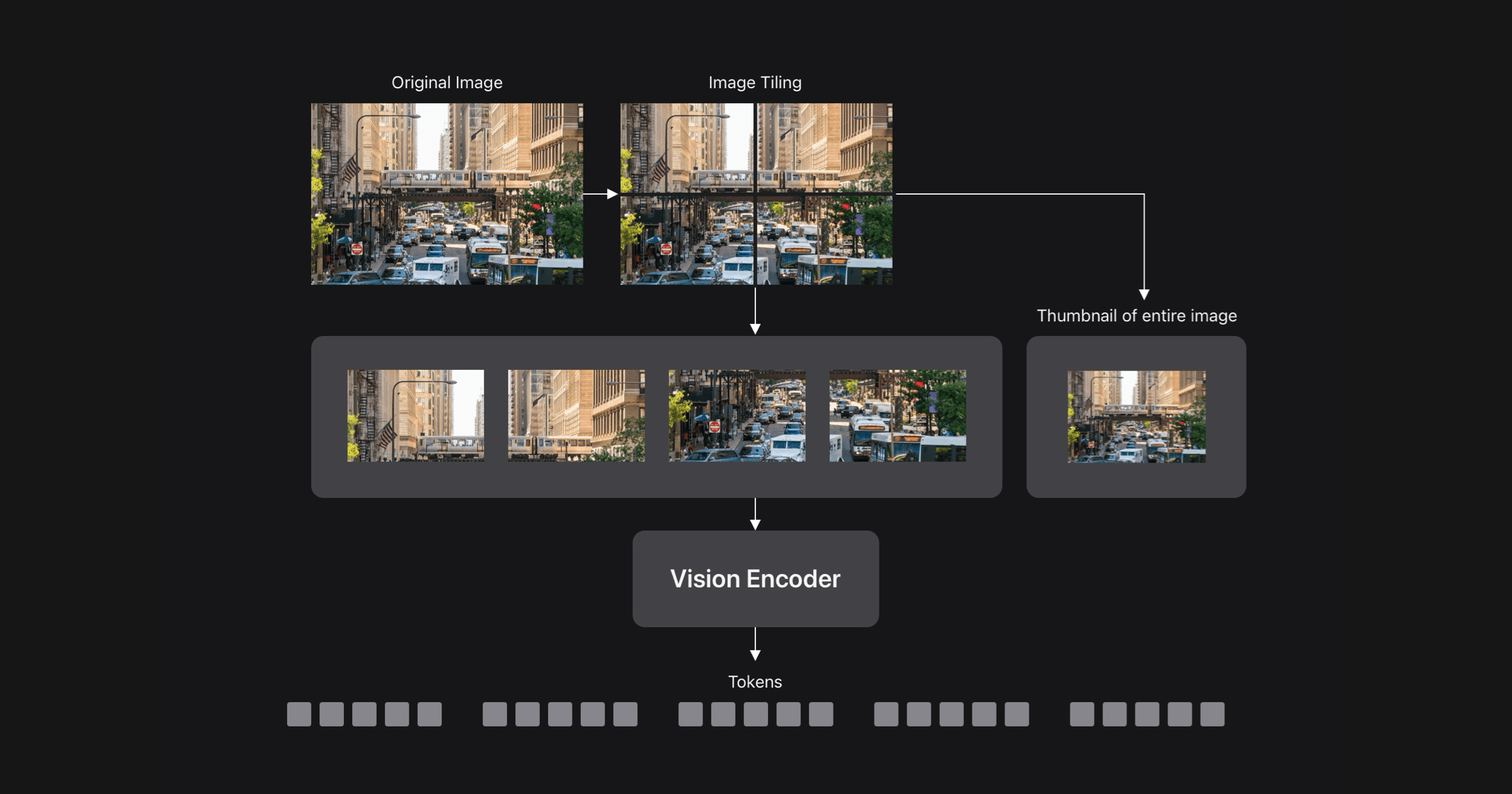

Vision Language Models은 시각적 이해를 텍스트 입력과 함께 가능케 합니다. FastVLM은 사전 훈련된 시각 인코더에서 시각 토큰을 대규모 언어 모델로 전달하여 구축됩니다. VLM은 시각 인코더의 풍부한 시각적 표현과 LLM의 세계 지식 및 추론 능력을 활용하여 접근성 보조기, UI 탐색, 로봇 공학, 게임 등 다양한 응용 분야에 유용할 수 있습니다.

Boolformer는 불리언 함수들의 심볼릭 회귀를 수행하는 Transformer 기반 모델로, 훈련 중이 아닌 복잡한 함수에 대한 간결한 공식을 예측할 수 있음을 보여줌. 불완전하거나 잡음이 있는 관측에서도 좋은 근사 표현을 찾을 수 있음을 입증하며, 실제 이진 분류 데이터셋에서 Boolformer를 평가하여 해석 가능한 대안으로의 잠재력을 보여줌.

데이터 선택 방법은 대상을 가지고 있으며, 이를 명시적으로 최적화할 때 어떤 일이 벌어지는지를 탐구하기 위해 벤치마크 대상 순위(BETR) 방법을 제안하고 있다. 이 방법은 벤치마크 학습 예제와 유사성에 기반한 사전 학습 문서를 선택하는 간단한 방법으로, 모델의 성능을 향상시킬 수 있다.

Apple은 Apple 디바이스와 서비스 전반에 걸쳐 사용되는 두 개의 다국어, 다모달 Foundation 언어 모델을 소개합니다. 이 모델들은 Apple 실리콘에 최적화된 약 30억 파라미터의 온디바이스 모델과 Apple의 Private Cloud Compute에서 경쟁력 있는 비용으로 높은 품질을 제공하는 새로운 병렬 트랙 MoE(Mixture-of-Experts) 트랜스포머를 기반으로 합니다.

이 연구는 두 서버 시스템에서 높은 차원 벡터의 안전한 집계 문제를 재방문하며, 개인 연합 학습에서 그래디언트와 같은 벡터를 집계하는 데 사용되는 Prio와 같은 시스템을 다룬다. 기존 방법은 차원과 통신량을 필요로 하지만, 우리는 차원에 비례하지 않는 효율적인 처리가 가능한 PREAMBLE를 제안한다.

AXLearn은 대규모 심층 학습 모델의 확장 가능하고 고성능의 훈련을 용이하게 하는 제품 심층 학습 시스템이다. 다른 최신 심층 학습 시스템과 비교했을 때, AXLearn은 모듈화와 이질적 하드웨어 인프라 지원에 중점을 둔다. AXLearn의 내부 인터페이스는 엄격한 캡슐화를 따라 소프트웨어 구성 요소 간의 다양한 조합을 용이하게 하여 빠른 모델 개발 및 실험을 가능케 한다.

다중 입력 데이터를 활용하는 기계 학습 시스템의 능력 향상을 위해 LLMs의 발전이 중요하다. 그러나 기존의 다중 모달 모델은 대부분 사전 훈련된 LLMs 위에 구축되어 다른 모달 간의 시간적 의존성을 정확하게 모델링하는 것을 제한할 수 있다. 이에 LLM 스타일의 다중 모달 디코더 모델에서 텍스트, 비디오, 음성 모달의 정렬을 조사한다.

이 논문에서는 Multimodal Vision-Language Models (VLMs)을 사용하여 UI 작업에 대한 훈련 데이터 부족 문제를 해결하는 방법을 제시한다. 이를 위해 기존의 이미지-언어 쌍 데이터 생성 방법을 UI 도메인에 적용하여 대화형 예제와 UI를 결합한 데이터셋을 생성한다.

대규모 트랜스포머 모델을 훈련하는 것에 대한 어려움으로 인해 차별적 개인정보 보호 및 페더레이티드 러닝(FL)이 음성 인식에 적용되는 것은 쉽지 않았다. 이를 해결하기 위해 새로운 벤치마크, 적응형 옵티마이저, 그리고 그래디언트 클리핑을 제안하였다. 이전 연구들은 표준 최적화 기술로 수렴하기 어렵다는 문제에 직면해왔다.

언어 모델에 어휘 없는 인코더를 추가하여, 텍스트를 픽셀로 렌더링하여 입력 임베딩을 생성하는 방법을 제안함. 영어 중심 언어 모델 실험 결과, 기존의 서브워드 토큰화 방식을 능가하며 기계 번역 성능을 획기적으로 향상시키고 효과적인 다국어 전이를 가능하게 함.

이 연구에서는 적대적 밴딧과 전문가 충고가 있는 밴딧 문제에 대한 새로운 차별화된 프라이버시 알고리즘을 설계했다. 기존의 비-프라이버시 밴딧 알고리즘을 프라이버시 밴딧 알고리즘으로 변환하는 간단하고 효율적인 방법을 제시했으며, 기존 상한선을 개선하여 모든 프라이버시 영역에서 O(KTε)의 상한선을 제공한다.

웨어러블 기기는 생리적 및 행동 신호를 기록하여 건강 예측을 개선할 수 있다. 이 연구에서는 162,000명의 개인으로부터 얻은 25억 시간의 웨어러블 데이터를 사용하여 행동 신호의 기반 모델을 개발했다. 이는 고유한 데이터셋에 대해 구조와 토큰화 전략을 체계적으로 최적화한 것이다. 이 모델은 57가지 건강 관련 문제에 대해 평가되었다.

딥 생성 모델링의 지속적인 발전에 이끌리는 시뮬레이션 기반 추론(SBI)은 확률적 시뮬레이터의 매개변수를 추론하는 데 사용되고 있습니다. 하지만 최근 연구에서 모델 부정확성이 SBI의 신뢰성을 훼손할 수 있다는 것을 보여주었습니다. 이 연구는 소량의 실제 세계 보정 데이터를 사용하여 모델 부정확성을 극복하는 Robust Posterior Estimation~(RoPE) 프레임워크를 소개합니다.

CommVQ는 Commutative Vector Quantization을 제안하여, 긴 문맥을 필요로 하는 대형 언어 모델에서 메모리 사용량을 현저히 줄이는 방법을 제시합니다. 가벡터 양자화를 활용하여 가벡터 캐시를 압축하고, 간단한 행렬 곱셈으로 디코딩할 수 있도록 설계되었습니다.

이 연구는 생성 모델이 동일한 프롬프트로 반복해서 이미지를 생성할 때 종종 비슷한 변형을 얻는 문제를 다루며, 기존 이미지와의 다양성을 유지하면서 새로운 이미지를 생성하는 방법을 제안한다. 데이터 기반의 방법을 활용하여 생성된 이미지를 기존 이미지 집합으로부터 멀어지도록 격리시키는 효과적인 방법을 제시한다.

본 연구에서는 이산 데이터를 모델링하고 생성하기 위한 유망한 프레임 워크인 이산 확산을 제시한다. 대상 콘크리트 점수 매칭(TCSM)은 이산 확산 모델의 교육과 세부 조정을 위한 혁신적이고 다재다능한 목적을 제시한다. TCSM은 넓은 적용 가능성을 갖는 일반적인 프레임 워크를 제공하며, 다양한 기존 이산 확산 접근 방식을 자연스럽게 다룰 수 있다. 또한, 동일한 TCSM 목적은 이산 확산 모델의 사후 교육까지 확장된다.

대형 언어 모델의 성공으로 영감을 받아 음성 모델링에 적용되고 있지만, 음성은 연속적이고 복잡하여 자동 회귀 모델링을 위해 이산화되곤 한다. 자기 지도 모델에서 파생된 음성 토큰은 음성의 언어적 측면에 중점을 두지만 억양 정보를 무시하는 경우가 많다. 이에 따라 이러한 토큰으로 훈련된 모델은 자연함이 감소한 음성을 생성할 수 있다. 기존 접근 방식은 이를 해결하기 위해 음성 토큰에 음높이 특성을 추가하는 것이지만, 음높이만으로는 범위를 완전히 표현할 수 없다.

이 논문은 대규모 언어 모델(LLMs)이 답변에 대해 확신이 없을 때 그것을 나타내야 한다는 불확실성 양자화의 역할을 탐구한다. LLMs의 다양한 출력 공간을 활용하여 불확실성을 설명하는 문자열을 제안한다.

점점 더 많은 edge 장치에서 대규모 언어 모델이 장기 문맥 설정에 배포되고 있어서, 빠르고 효율적인 장기 문맥 추론이 점점 더 필요해지고 있다. 이 연구에서는 기존 방법들이 효율적인 KV 캐시 최적화 전략을 통해 중요한 속도 향상을 달성하는 데 어려움을 겪고 낮은 수락률을 유발하는 반면, 자가-추론 디코딩을 사용하여 이러한 쟁점을 해결하는 방법을 제시한다.

3D 장면을 효과적으로 나타내는 것은 중요하지만 어렵다. 이 연구는 비디오 및 포인트 기반 표현을 비교하고 시각적 토큰을 3D 포인트 클라우드 기능으로 보강하는 새로운 방법을 제안한다. 실험 결과는 명시적인 3D 정보를 통합하는 것이 3D 장면 이해에 도움이 된다는 것을 보여준다.

애플 연구원들이 인공지능과 머신러닝 분야의 기본 연구를 통해 진보하고 있으며, 이를 지원하기 위해 연구 내용을 게재하고 학회 참여를 통해 발전을 가속화하고 있다. 다음 주에 캐나다 밴쿠버에서 열리는 국제 머신러닝 학회(ICML)에 애플이 참가할 예정이며, 산업 후원사로 참여할 예정이다.

시각 장애인이 낯선 환경에서 독립적으로 여행하기 어려운 이유 중 하나는 물리적 지형에 대한 불확실성 때문이다. 이 연구에서는 시각 장애인을 위한 AI 에이전트 시네스카우트를 소개한다. 이는 거리뷰 이미지를 활용하여 환경적 세부 사항을 제공함으로써 시각 장애인들에게 풍부한 시각 정보를 제공한다.

대형 언어 모델(Large language models, LLMs)은 다양한 작업에서 탁월한 성능을 보여주며 현재 실제 응용 프로그램에서 증가하고 있습니다. 하지만 특히 고위험 상황에서는 LLM의 출력이 신뢰할 수 없을 때를 알아내는 것이 중요합니다. 이 연구에서는 LLM이 답변에 대한 확신을 신뢰할 수 있는지, 이 신뢰의 개념이 하류 정확도로 어떻게 전환되는지 조사합니다.

언어 모델 용량 확장은 성능 향상과 새로운 기능 발견에 신뢰할만한 방법이다. 모델 매개변수 및 예제 당 연산량으로 주로 정의되며, 이 두 가지 요소 간의 상호 작용과 전체 용량에 대한 복합 기여는 아직 완전히 이해되지 않았다. 본 논문에서는…

대형 언어 모델은 다양한 작업에서 탁월한 일반화 능력을 보여주지만, 그 신뢰성에 대한 우려로 여전히 실용적인 중요성을 주장하고 있다. 최근 연구들은 언어 모델의 활성화를 검토하여 질문에 대한 답변이 올바른지 평가하는 것을 제안했다. 몇몇 연구는 예시에서 “진실의 기하학”이 학습될 수 있다고 주장한다.

동적 후회를 가진 전문가 의견 예측 문제에 대한 차별적 개인 알고리즘을 설계합니다. 변화하는 분포에 대한 확률론적 적대자, 맹목적 적대자 및 적응적 적대자 세 가지 유형의 적대자에 대응하고, 모든 경우에 대해 하위 선형 후회를 갖는 알고리즘을 설계합니다. 특히, 분포가 S번 변할 수있는 시간에 대해 ε-차별적 개인 알고리즘을 제공하며, 예상 동적 후회는 O(STlog(NT)+Slog(NT)ε)입니다.

최근 State-Space Models (SSMs) 중 하나인 Mamba는 Transformers에 유망한 대안으로 부상했다. Mamba는 입력 선택성을 도입하여 SSM 레이어(S6)에 소성과 게이팅을 통합시킨다. 이러한 수정은 Mamba의 성능을 향상시키지만, 입력 선택성이 추가 기능과 상호작용하는 방식은 여전히 명확하지 않다. 본 연구에서는 Mamba에서의 입력 선택성 역할을 명확히하고, 이것이 Mamba 아키텍처의 다른 작업들과 상호작용하는 방식을 조사했다.

대형 언어 모델(LLMs)의 급속한 채택은 그들의 공정성을 벤치마킹하는 중요성을 강조합니다. 이에 따라 모델의 불확실성을 고려한 새로운 공정성 측정 기준 UCerF를 제안하였습니다. 이는 모델의 내부 편향을 더 잘 반영하여 모델의 공정성을 세밀하게 평가할 수 있습니다.

다양한 데이터 소스의 혼합물로 대규모 모델이 교육되고, 다양한 데이터 혼합물은 매우 다른 하류 성능을 얻는다. 이에 따라 모델을 다시 교육할 필요 없이 각 데이터 혼합물에 대한 모델을 생성할 수 있는 새로운 아키텍처를 제안한다. 이 아키텍처는 전문가 가중치 은행으로 구성되어 있으며, 입력 히스토그램의 함수로 선형 결합 계수를 학습한다. 이 아키텍처를 교육하기 위해 무작위 히스토그램을 샘플링하고 해당 모델을 생성한 후 데이터 배치를 통해 역전파한다.

대형 언어 모델의 일부 파라미터가 모델의 품질에 지대한 영향을 미친다는 연구 결과가 나왔다. 작은 비율의 파라미터가 모델의 품질에 중요하며, 하나의 파라미터도 제거하면 모델의 텍스트 생성 능력이 파괴될 수 있다. 이를 식별하기 위한 데이터 없는 방법을 제안한다.

데이터 부족 문제를 해결하기 위해 에고센트릭 인간 비디오를 활용한 솜씨있는 조작 학습. EgoDex라는 최대 규모와 다양성을 갖춘 데이터셋 구축.

AI 에이전트가 사용자 인터페이스를 조작하여 일상 업무를 관리하는 데 집중한 최근 연구. 이 연구는 AI 에이전트의 행동이 미치는 영향과 결과를 조사하고, 특히 위험하거나 되돌릴 수 없는 행동에 대해 탐구함. 모바일 UI 조작의 영향에 대한 분류체계 개발을 통해 연구 시작.

CLIP는 이미지/텍스트 표현을 생성하는 비전 인코더를 훈련하는 데 사용되는 인기 있는 방법이며, 최근에는 다양한 응용 프로그램을 용이하게 하는 다중 언어 모델의 비전 백본으로 널리 채택되었습니다. 그러나 CLIP의 성공은 이미지 수준에서의 웹 크롤링된 노이즈 텍스트 주석을 정렬하는 데 의존하는데, 이러한 기준은 특히 세부 비전 표현이 필요한 하위 작업에 대해 충분하지 않을 수 있습니다.

이 연구는 자아중심 비디오 질문 응답에 다모달 대형 언어 모델이 어떻게 적용되는지 평가하고 있다. 긴 시간 범위의 시간적 추론, 일인칭 시점, 자주 발생하는 카메라 움직임과 같은 과제를 처리해야 한다. QaEgo4Dv2 데이터셋에서 4가지 인기 MLLM을 평가하며 주석 노이즈를 줄이기 위해 QaEgo4Dv2를 소개한다.

언어 모델이 더 많은 문맥을 지원할수록 그 문맥을 효과적으로 활용하는 능력을 평가하는 것이 점점 중요해진다. 여러 코드 생성 모델이 장거리 종속성을 처리하는 능력을 분석했으며, 8k 토큰 길이의 컨텍스트 창에서 다중 단계 키 검색 작업을 사용하여 모델 능력을 평가했다. 성능이 많은 모델에서 크게 감소하는 것으로 나타났다.

텍스트 대비 생성된 비디오의 의미적 정렬을 정확히 평가하는 것은 여전히 도전적이다. 기존의 텍스트 대비 비디오 정렬 메트릭인 CLIPScore는 미세한 정렬 세부사항을 생성하지 못하여 인간의 선호와 일치하지 못한다. 이 한계를 극복하기 위해 우리는 ETVA라는 새로운 텍스트 대비 비디오 정렬 평가 방법을 제안한다. 이 방법은 미세한 질문 생성과 답변을 통해 텍스트 대비 비디오의 정렬을 평가한다.

Cavia는 카메라 제어가 가능한 멀티뷰 비디오 생성을 위한 혁신적인 프레임워크로, 입력 이미지를 다양한 카메라 경로로 일관된 비디오로 변환할 수 있다.

대형 언어 모델의 신속한 확장으로 구조화된 가지치기가 보다 효율적이고 우수한 성능을 제공하는 작은 모델을 학습하는 데 널리 사용되고 있다. 이 논문에서는 모델에 대한 고정된 가지치기 마스크를 결정하는 전통적인 정적 가지치기 접근법을 넘어서 사용자 지시에 설명된 정보를 기반으로 가지치기 마스크를 동적으로 조정하는 방법을 제안한다.

언어 모델의 불확실성 측정은 안전성과 신뢰성 향상에 중요하다. AUROC와 같은 메트릭을 사용하여 UQ 방법이 작업 정확성 함수와 얼마나 잘 상관하는지를 평가하는데, 상호 편향은 평가를 왜곡시킬 수 있다. 상호 편향이 AUROC 순위를 왜곡시키는 것을 공식적으로 증명하고, 7가지 방법을 테스트하여 이를 확인했다.

본 연구는 다중 모달 속도 벡터 필드를 모델링하여 클래식한 정정 흐름 매칭을 향상시키는 변분 정정 흐름 매칭을 탐구합니다. 추론 시간에는 소스 분포에서 대상 분포로 샘플을 ‘이동’시키는 과정으로 속도 벡터 필드를 통해 보통 미분 방정식을 해결합니다. 훈련 시간에는 속도 벡터 필드를 소스와 대상 분포에서 무작위로 추출된 결합된 샘플 사이를 선형 보간하여 학습합니다.

Flow matching 모델은 이미지나 비디오와 같은 도메인뿐만 아니라 3D 포인트 클라우드나 단백질 구조와 같은 불규칙하거나 구조화되지 않은 데이터에 대한 생성 모델링에 강력한 방법으로 등장했습니다. 이 두 단계 패러다임은 서로 다른 데이터 도메인에 대해 손수 제작된 압축기 아키텍처가 사용되기 때문에 모델의 통합을 방해합니다.

대형 언어 모델을 훈련하는 것은 상당 부분의 데이터 기억을 포함한다는 최근 연구 결과가 있다. 이 기억은 민감한 사용자 데이터를 기반으로 훈련할 때 개인 정보 침해로 이어질 수 있으며, 이는 데이터 기억이 학습에서 어떤 역할을 하는지에 대한 연구를 촉발한다. 이 연구에서는 강력한 데이터 처리 불평등과 데이터 기억 사이의 새로운 연결을 통해 초과 데이터 기억에 대한 하한선을 증명하기 위한 일반적인 방법을 개발한다.

특정 도메인에서 잘 작동하는 언어 모델을 얻기 위한 보편적인 전략은 해당 도메인의 데이터를 사용하여 비지도 다음 토큰 예측을 훈련시키는 것이다. 하지만 미세조정은 목표 데이터의 양이 제한적인 경우 빠르게 과적합될 수 있고, 원래 모델에서 벗어나 사전 훈련 분포를 잊을 수 있다. 이 논문은 이러한 두 현상을 몇 가지 목표 도메인, 사용 가능한 목표 데이터 및 모델 스케일에 대해 정량화한다.

정규화 흐름(NFs)은 연속적인 입력에 대한 우도 기반 모델로, 밀도 추정과 생성 모델링 작업에서 유망한 결과를 보여주었으며, 이번 연구에서 NFs가 예상보다 강력함을 입증하고 있다. TarFlow는 NF 모델의 성능을 높일 수 있는 간단하고 확장 가능한 아키텍처로, 이미지 패치 위에 자기회귀 Transformer 블록의 스택으로 이루어진 MAFs의 변형으로 볼 수 있다.

높은 품질의 데이터를 확보하는 것이 비용이 많이 드는 End-to-end (E2E) 자동 음성 인식 (ASR) 모델을 훈련시킬 때 어려움을 겪는다. 이 논문에서는 E2E ASR 시스템의 훈련 데이터에 충분히 표현되지 않는 최근이나 드문 영화 제목과 같은 쿼리들에 대한 음운론적 보정 시스템을 제안한다.

이 연구는 다국어 언어 모델이 언어 식별(형태)과 의미 내용(의미)을 어떻게 표현하는지를 평가하기 위한 훈련이 필요 없는 ABX 스타일의 차별화 작업을 소개한다. XLM-R에 적용된 결과, 언어 차별이 훈련 과정에서 감소하고 하위 레이어에 집중됨을 발견했다.

애플 연구원들이 기본 연구를 통해 AI 및 머신러닝을 발전시키고 있으며, CVPR 학회에 참여하여 새로운 연구를 발표할 예정이다. 애플은 컴퓨터 비전 및 패턴 인식 학회에 참여하여 연구 결과를 공유하고 있다.

Apple은 개인정보 보호를 유지하면서 강력한 생성형 AI를 앱과 경험에 통합하고 있습니다. 2025 Worldwide Developers Conference에서 최신 소프트웨어에서 Apple Intelligence 기능을 향상시키기 위해 특별히 개발된 새로운 세대의 언어 기반 모델을 소개했습니다. 또한 앱 개발자들이 Apple Intelligence 핵심인 기기 내 기반 언어 모델에 직접 액세스할 수 있는 새로운 Foundation Models framework도 소개했습니다.

대량 데이터로 사전 훈련된 시각 기반 모델은 현실 세계 개념의 풍부한 표현을 인코딩하며, 세부 작업에 맞게 조정될 수 있다. 그러나 하나의 작업에 모델을 세밀 조정하는 것은 종종 다른 작업에서 개념을 잊어버리는 문제를 야기한다. 최근 견고한 세부 조정 방법은 사전 지식을 잊지 않으면서 세부 조정 성능을 향상시키는 것을 목표로 한다.

이상적이지 않은 말과 다른 말 조절의 주요 특성을 설명하는 지각적 음성 품질 차원을 개발하고 평가했습니다. 434명의 화자로부터 11,184개 샘플을 사용하여 퍼블릭 스피치 접근성(SAP) 프로젝트 데이터셋에서 음성 품질 모델을 개발하고 평가했습니다. 우리는 우리의 조사가 강력한 성능과 강력한 일반화를 보여주었음을 발견했습니다.

최근의 선두 언어 모델은 상세한 사고 과정을 생성하는 대규모 추론 모델(LRMs)을 소개했다. 이러한 모델은 추론 벤치마크에서 뛰어난 성능을 보이지만, 기본적인 능력, 확장 성질 및 한계에 대한 이해는 여전히 미흡하다. 현재의 평가는 주로 수학적 및 코딩 벤치마크에 초점을 맞추며, 최종 답변 정확도를 강조한다. 그러나 이러한 평가 패러다임은 종종 데이터 오염 문제를 겪으며 추론 추적에 대한 통찰을 제공하지 않는다.

시각 언어 모델의 씨토트 추론은 해석 가능성과 신뢰성을 향상시키는 데 중요하다. 현재의 훈련 방법은 짧은 주석으로 지배된 데이터셋에 의존하고 있는데, 이는 자세한 설명이 필요한 추론 작업에서 일반화가 부족하다는 한계가 있다. 이 한계를 극복하기 위해 짧은 답변 데이터를 확장한 두 단계의 후훈련 전략을 제안한다.

토크나이저 디자인은 언어 모델 성능에 상당한 영향을 미치지만, 토크나이저 품질을 평가하는 것은 여전히 어렵다. 최근 연구에서는 텍스트 압축이 일반적인 내재적 측도로 등장했지만, 신뢰성이 의문되고 있다. 저자들은 작은 모델(350M 매개변수)에서 토크나이저를 평가하는 것이 큰 규모(2.7B 매개변수)에서의 영향을 신뢰할 수 있는지 조사했다. 널리 사용되는 언어 모델의 토크나이저를 실험한 결과, 토크나이저 선택은 영어 작업에는 거의 영향을 주지 않지만, 중요한 차이를 보여준다.

2025년 6월 11일부터 15일까지 테네시 주 내슈빌에서 개최되는 IEEE/CVF 컴퓨터 비전 및 패턴 인식(CVPR) 컨퍼런스에 Apple이 후원사로 참여할 예정이다. 이 컨퍼런스는 주요 컨퍼런스와 여러 공동 워크샵 및 단기 과정으로 구성된 매년 열리는 컴퓨터 비전 행사이다.

다국어 간 전이는 NLP 작업의 훈련 데이터 양을 늘리는 인기있는 방법이지만, 어떤 다국어 데이터를 포함해야 하는지에 대한 최적 전략은 명확하지 않다. 본 연구에서는 263개 언어에 대한 다국어 간 전이를 분석하여 이 질문에 기여하고 있다. 세 가지 인기 NLP 작업을 포함한다.

현재의 읽기 오류 주석 방법을 개선하기 위해 대상 독해 텍스트를 프롬프팅하여 원문 전사 및 직접 미스큐 탐지를 위해 훈련된 혁신적인 엔드 투 엔드 아키텍처를 제안합니다.

증류 스케일링 법칙은 학생과 선생님 간의 컴퓨팅 예산 및 할당을 기반으로 증류된 모델 성능을 예측하는 법칙이다. 컴퓨팅 최적 할당을 통해 학생 성능을 극대화하여 대규모 증류와 관련된 위험을 완화한다. 기존 선생님이 있는 경우와 선생님을 훈련해야 하는 경우에 대한 컴퓨팅 최적 증류 레시피를 제공한다.

말 앞단과 대형 언어 모델의 점점 더 통합되는 환경에서 이 모달리티를 통합하는 아키텍처를 탐구하는 필요성이 있다. 우리는 전통적인 텍스트 음성 변환 시스템을 사용하여 LLM 출력을 오디오로 변환하는 ‘스트리밍’ TTS를 제안한다.

확산 모델이 시각적 콘텐츠 생성을 주도하는 가운데, 이러한 모델을 3D 콘텐츠를 만들기 위해 다중 뷰 이미지 생성에 적응시키는 노력이 이루어졌다. 우리는 RGB 프레임과 함께 정규화된 좌표 공간(Normalized Coordinate Space, NCS) 프레임을 생성하는 것을 제안한다. NCS 프레임은 각 픽셀의 전역 좌표를 캡처하여 강력한 픽셀 대응과 3D 일관성을 위한 명시적 지도를 제공한다.

이 연구는 대규모 언어 모델의 추론 능력을 향상시키는 긴 사고 체인이 시간 효율성 및 첫 번째 토큰 도달 시간에 미치는 영향을 분석하고, 강화 학습을 활용하여 다중 단계 질문에 대한 간헐적 추론을 유도하는 새로운 학습 패러다임을 제안한다. 모델이 간헐적 추론을 수행할 수 있는 능력을 강화하기 위해 간단하면서도 효과적인 규칙 기반 보상 시스템을 도입한다.

최근 자가 감독 음향 표현 기반 모델(FMs)이 제안되어 음향 기반 생리학적 정보를 제공하는데 사용되어 왔다. 본 연구는 공개된 PCG 데이터셋과 심박수(HR) 추정 모델을 사용하여 여섯 가지 음향 표현 FMs의 층별 조사를 수행하였다.

CLIP-Upcycling (CLIP-UP)은 밀집형 CLIP 모델을 희소 MoE 아키텍처로 변환하는 효율적인 대체 학습 전략으로, 훈련 복잡성과 비용을 현저히 줄인다. 다양한 설정과 보조 손실을 활용한 방대한 실험을 통해 CLIP-UP은 훈련 복잡성과 비용을 크게 낮추는 것을 입증했다.

대규모 데이터셋에 대한 의존성을 줄이기 위해 생성 모델을 사용하는 CtrlSynth 기술 소개. 기존 방법과 달리 이미지와 텍스트를 모두 지원하며 합성과정을 세밀하게 제어할 수 있어 데이터 다양성을 높일 수 있음.

대규모 언어 모델의 규모가 급격하게 증가함에 따라 여러 컴퓨팅 유닛 간의 효율적인 분산 추론이 점점 중요해지고 있다. 그러나 텐서 병렬성과 같은 인기 있는 분산 추론 기술로 인한 통신 오버헤드는 확장성과 낮은 지연 시간을 달성하는데 중요한 도전 요소이다. 따라서 통신 오버헤드를 줄이기 위해 주의도를 기울여 동기화를 선택적으로 제거하는 싱크포인트 드롭(SPD) 최적화 기술을 소개하고 있다.

가상 현실(VR) 헤드셋의 급속한 발전으로 입체 품질 경험(SQoE)의 효과적인 측정이 중요해졌다. 기존의 입체 메트릭은 주로 시각적 불편함이나 이미지 품질과 같은 특정 측면에 초점을 맞추었으며 데이터 한계에 직면해왔다. 이를 해결하기 위해 실제와 합성된 입체 이미지로 구성된 SCOPE(입체 콘텐츠 선호도 평가) 데이터 세트를 제시한다.

다양한 데이터로 인간형 로봇을 훈련시키는 것은 그들의 견고성과 과제 및 플랫폼 간의 일반화를 향상시킨다. 본 논문은 인간의 자가 중심의 시범을 더 확장 가능한 데이터 원천으로 조사하여 로봇 학습을 위한 훈련 데이터로 활용한다. 우리는 인간형 로봇과 인간 사이의 구현 갭을 데이터 및 모델링의 관점에서 완화한다.

Cubify Anything은 실내 3D 물체 검출을 위해 새로운 데이터셋과 모델링을 도입하고 있습니다. 기존 데이터셋의 한계를 극복하기 위해 Cubify-Anything 1M (CA-1M) 데이터셋을 소개하고 있으며, 이를 통해 400K개 이상의 3D 물체를 라벨링하고 1K개 이상의 정확한 레이저 스캔 장면과 3.5K개 이상의 핸드헬드 캡처와 연계시켰습니다.

현재 대규모 언어 모델(LLMs)은 주로 영어를 주요 언어로 사용하며, 몇 안 되는 다국어 모델조차도 영어 중심적인 편향을 보입니다. 이 연구에서는 다국어 LLM의 자연함을 평가하고 개선하는 방법에 대해 다룹니다. LLMs는 영어가 아닌 언어에서 자연스럽지 않은 결과물을 생성할 수 있으며, 이는 어휘와 문법에서 영어 중심적인 패턴을 반영합니다.

StreamBridge는 오프라인 비디오 대형 언어 모델을 스트리밍 가능한 모델로 변환하는 효과적인 프레임워크이다. 이는 기존 모델을 온라인 시나리오에 적응시키는데 두 가지 주요 도전 과제를 해결한다: 실시간 다중 대화 이해 능력의 한계와 선행적인 응답 메커니즘의 부재.

Matrix3D는 동일한 모델을 활용하여 포즈 추정, 깊이 예측, 신규 뷰 합성과 같은 여러 사진 측량 하위 작업을 수행하는 통합 모델이다. Matrix3D는 이미지, 카메라 매개변수, 깊이 맵과 같은 여러 모달리티 간의 변환을 통합하기 위해 다중 모달 확산 트랜스포머(DiT)를 활용한다. Matrix3D의 대규모 다중 모달리티 훈련의 핵심은 마스크 학습 전략의 통합에 있다. 이는 이미지-포즈 및 이미지-깊이 쌍과 같은 부분적으로 완전하지 않은 데이터로도 완전한 모달리티 모델 훈련이 가능하게 한다.

이 연구는 확산 모델에서의 구성에 대한 이론적 기초를 연구하며, 특히 분포의 조합을 통한 외삽과 길이 일반화에 초점을 맞추고 있습니다. 이전 연구에서는 선형 점수 조합을 통해 분포를 조합하면 길이 일반화를 달성할 수 있다는 것이 밝혀졌으나, 이러한 조합이 왜 동작하는지에 대한 이론적 이해는 아직 미완성 상태입니다. 이 논문은 이러한 기본적인 공백을 다루기 시작합니다.

연합 텔레메트리 응용프로그램을 고려하여, 지역 Pan-개인정보 보호에 대한 연구를 진행하고, 연합 시스템에서 이벤트 발생 횟수를 모니터링할 때 지역 장치에서의 이벤트 발생은 심지어 해당 장치의 침입자에게도 숨겨져야 함을 보여줌.

이 연구는 분류기 없는 가이드(CFG)의 이론적 기초를 조사한다. CFG는 텍스트-이미지 확산 모델의 조건부 샘플링의 주요 방법이지만, 다른 확산 측면과 달리 이론적 기반이 불안정하다. 이 논문에서는 CFG가 DDPM 및 DDIM과 다르게 상호작용하며 CFG와 함께 사용된 어떤 샘플러도 gamma-제곱 분포 p(x|c)^γp(x)^{1−γ}를 생성하지 않음을 보여준다. 그리고 CFG의 행동을 명확히 하기 위해 이것이 예측자-교정자 방법의 한 종류이다는 것을 보여준다.

미분적으로 개인 정보 보호(DP) 최적화 알고리즘을 연구하고 부드럽지도 볼록하지도 않은 확률적 및 경험적 목적 함수에 대해 제안되며, 기존 작업을 개선하는 샘플 복잡도 한계를 가진 방법을 제안합니다.

통계 분석이 과학, 산업 및 사회에서 중요해지면서 결과의 정확성을 보장해야 하는 필요성이 커지고 있다. 복제를 통해 근사 정확성을 확인할 수 있지만, 복제 없이도 확인할 수 있는 방법은 없을까? 최근 연구를 기반으로, 결과가 대략적으로 정확한지 확률적으로 확인할 수 있는 증명 시스템을 연구하고 있다.

앱 스토어의 평가와 리뷰는 사용자들이 앱을 탐색할 때 소중한 자원이다. iOS 18.4에서 리뷰 요약이 제공되면서 사용자들은 앱에 대한 다른 사용자들의 의견을 빠르게 파악할 수 있다. 이 기능은 새로운, 다단계 LLM 기반 시스템으로 구동되며 주기적으로 사용자 리뷰를 요약한다.

애플 연구자들이 머신러닝과 인공지능을 발전시키며 세계의 기술 이해를 개선하고 그 가능성을 재정의하는 데 기여하고 있습니다. 이번 주에는 싱가포르에서 열리는 ICLR 2025에서 주요 딥러닝 전문가들이 모여 representation에 대한 응용을 논의할 예정입니다.

고해상도 이미지의 확장은 Vision Language Models (VLMs)의 성능을 향상시키는 데 중요하며, 이를 위해 FastVLM이 개발되었다. ViTs와 같은 인기 있는 비전 인코더는 고해상도에서 비효율적이지만 FastVLM은 인코딩 레이턴시를 줄이고 시각적 토큰 수를 최적화하여 전반적인 레이턴시를 낮춘다.

레이블이 없는 데이터로부터 분리된 표현을 학습하는 것은 기계 학습에서의 중요한 과제이다. 이를 해결함으로써 일반화, 해석 가능성 또는 공정성과 같은 다른 문제들을 해결할 수 있다. 이론적으로 해결하기 어렵지만, 실제로는 이전 일치를 통해 분리가 종종 이루어진다. 또한, 최근 연구들은 기하학적 고려사항을 활용하여 이전 일치 접근법을 개선할 수 있음을 보여주었다.

애플이 ACM 인간-컴퓨터 상호작용 학회 (CHI) 2025에서 새로운 연구를 발표할 예정이며, 이번 행사는 4월 26일부터 5월 1일까지 일본 요코하마에서 진행됩니다. 애플은 이 학회를 후원하며 상호작용 기술에 초점을 맞춘 과학 및 산업 연구 커뮤니티를 결집시키는데 자랑스러워합니다.

본 논문은 머신러닝을 위한 확산 모델 및 흐름 일치 수학에 대한 접근 가능한 초급 과정을 제시한다. 확산을 가능한 간단하게 가르치고 있으며, 수학적이고 머신러닝에 대한 선행 지식은 최소화했지만, 올바름에 대해 논의할만한 충분한 기술적 세부 정보를 제공한다. 대부분의 튜토리얼과는 달리, Variational Auto Encoder(VAE)나 Stochastic Differential Equations(SDE) 접근 방식을 취하지 않는다. 사실, 핵심 아이디어에는 SDE, ELBO, Langevin dynamics, 심지어 점수 개념이 필요하지 않다. 독자는 단순히…

DART는 Markov 프로세스 노이즈 제거를 통해 훈련되는 확산 모델의 한계를 극복하기 위해 제안된 transformer 기반 모델로, 비-Markovian 프레임워크 내에서 자기 회귀와 확산을 통합한다. 이미지 패치를 공간적, 스펙트럼적으로 반복적으로 노이즈 제거하며 텍스트에서 이미지를 생성한다.

현재의 다중 모달 모델은 사전 훈련된 구성 요소를 통합하는 방식을 사용하는데, 이에 대한 late-fusion 아키텍처의 우월성이 여전히 논란이다. 본 연구에서는 네이티브 다중 모달 모델(NMMs)의 구조적 설계를 재방문하고 모든 modalities에 대해 처음부터 훈련된 모델을 탐구한다.

2025년 4월 24일부터 28일까지 싱가포르에서 개최되는 국제학습표현학회(ICLR)를 애플이 후원할 예정이다. 깊은 학습의 발전에 헌신하는 전문가들이 모인다.

확산 언어 모델(DLMs)은 텍스트 생성 모델링을 위한 유망한 새로운 패러다임으로 등장했으며, 자기 회귀(AR) 모델의 한계를 해결할 수 있는 잠재력이 있다. 그러나 현재의 DLMs는 AR 모델에 비해 작은 규모에서 연구되었으며, 언어 모델 벤치마크에서 공정한 비교가 부족하다. 또한, 대규모로부터 DLMs를 처음부터 훈련시키는 것은 여전히 어렵다. 이에 우리는 오픈 소스 AR 언어 모델의 보급으로부터 이러한 모델들을 적응시켜 텍스트 확산 모델을 구축하는 것을 제안한다.

확산 언어 모델(DLMs)은 텍스트 생성 모델링을 위한 유망한 새로운 패러다임으로 등장했으며, 자기 회귀(AR) 모델의 한계를 해결할 수 있는 잠재력이 있다. 그러나 현재의 DLMs는 AR 모델에 비해 작은 규모에서 연구되었으며, 언어 모델 벤치마크에서 공정한 비교가 부족하다. 또한, 대규모로부터 DLMs를 처음부터 훈련시키는 것은 여전히 어렵다. 이에 우리는 오픈 소스 AR 언어 모델의 보급으로부터 이러한 모델들을 적응시켜 텍스트 확산 모델을 구축하는 것을 제안한다.