이 튜토리얼에서는 Magika의 딥러닝 기반 파일 유형 탐지와 OpenAI의 언어 지능을 결합하여 실용적인 분석 파이프라인을 구축하는 방법을 소개합니다.

최신뉴스 전체보기

NVIDIA가 하이브리드 양자-고전 시스템을 위한 첫 번째 오픈 양자 AI 모델인 ‘이징’을 출시했습니다. 이 모델은 양자 컴퓨터와 고전 컴퓨터의 간극을 줄이기 위한 노력의 일환으로 개발되었습니다.

일론 머스크의 AI 회사 xAI가 독립형 음성 인식(STT) 및 음성 합성(TTS) API를 출시했습니다. 이 API는 Grok Voice의 인프라를 기반으로 하며, 기업 음성 개발자를 겨냥하고 있습니다.

이 튜토리얼에서는 GPU 가속을 활용하여 PrismML의 최적화된 GGUF 배포 스택을 사용해 Bonsai 1비트 대형 언어 모델을 효율적으로 실행하는 방법을 설명합니다.

이 튜토리얼에서는 Hypothesis를 사용한 속성 기반 테스트를 탐구하며, 전통적인 단위 테스트를 넘어서는 엄격한 테스트 파이프라인을 구축합니다. 다양한 테스트 기법을 통해 시스템의 기능적 정확성과 행동 보장을 검증합니다.

앤트로픽이 클로드 오퍼스 4.7을 출시했습니다. 이번 버전은 에이전틱 소프트웨어 엔지니어링과 멀티모달 기능에서 중요한 개선을 이루었으며, 실제 AI 애플리케이션 개발에 큰 도움이 될 것으로 기대됩니다.

구글이 LLM 기반의 자동 진단 도구인 ‘Auto-Diagnose’를 발표했다. 이 도구는 통합 테스트 로그를 자동으로 분석하여 오류를 찾아내는 기능을 제공한다.

이 튜토리얼에서는 Google Colab에서 OpenAI의 오픈 웨이트 GPT-OSS 모델을 실행하는 방법을 다룹니다. 기술적 특성, 배포 요구 사항, 실용적인 추론 워크플로우에 중점을 두고 설명합니다.

생성형 AI의 발전과 함께 보안 위협도 증가하고 있습니다. 2026년 가이드에서는 Mindgard, Garak, Microsoft의 PyRIT 등 19개의 주요 도구를 소개하며, 보안 팀이 데이터 유출 및 편향과 같은 취약점을 사전에 식별할 수 있도록 돕습니다.

이 튜토리얼에서는 Redis에 의존하지 않고 Huey를 사용하여 완전한 백그라운드 작업 처리 시스템을 구축하는 방법을 설명합니다. SQLite를 기반으로 한 Huey 인스턴스를 설정하고, 고급 작업 패턴을 구현하는 방법을 다룹니다.

Qwen 팀이 3억 개의 활성 매개변수를 가진 희소 MoE 비전-언어 모델 Qwen3.6-35B-A3B를 오픈 소스로 공개했습니다. 이 모델은 에이전틱 코딩 기능을 갖추고 있습니다.

OpenAI가 생명과학 분야에 진출하며, 약물 발견과 유전체 연구를 가속화하기 위해 GPT-Rosalind라는 AI 모델을 출시했습니다. 이 모델은 10-15년의 약물 발견 기간을 단축할 것으로 기대됩니다.

NetKet과 JAX를 사용하여 변형자 아키텍처와 양자 물리를 결합하는 방법을 배워보세요. 이 가이드는 신경 양자 상태를 통해 J1-J2 하이젠베르크 스핀 체인을 해결하는 연구 수준의 VMC 파이프라인 구축 과정을 안내합니다.

UCSD와 Together AI 연구팀이 파르카에(Parcae)라는 새로운 언어 모델 아키텍처를 소개했습니다. 이 모델은 기존 트랜스포머 모델의 두 배 크기와 같은 품질을 제공하면서도 효율성을 높였습니다.

이 튜토리얼에서는 Mem0와 OpenAI 모델, ChromaDB를 활용하여 AI 에이전트를 위한 범용 장기 기억 레이어를 구축하는 방법을 소개합니다. 자연 대화에서 구조화된 기억을 추출하고, 의미적으로 저장하며, 지능적으로 검색하는 시스템을 설계합니다.

이 튜토리얼에서는 SmolAgents를 사용하여 다중 에이전트 AI 시스템을 구축하는 방법을 소개합니다. 현대의 경량 AI 에이전트가 코드 실행, 도구 호출 및 동적 오케스트레이션을 통해 협력하는 과정을 보여줍니다.

현대 대형 언어 모델(LLM)의 훈련은 원시 데이터를 신뢰할 수 있는 지능형 시스템으로 변환하는 복잡한 과정입니다. 이 과정은 일반 언어 패턴과 세계 지식을 학습하는 사전 훈련 단계로 시작됩니다.

구글이 Gemini 3.1 Flash TTS를 출시하며 음성 품질과 표현력, 다국어 생성 능력을 개선한 텍스트-음성 변환 모델을 선보였습니다. 이 모델은 70개 이상의 언어를 지원하며, 자연어 오디오 태그와 다중 화자 대화 기능을 갖추고 있습니다.

구글 딥마인드가 로봇의 인지적 사고를 지원하는 ‘제미니 로보틱스-ER 1.6’ 모델을 발표했다. 이 모델은 시각적 및 공간적 이해, 작업 계획, 성공 감지 등 로봇 운영에 필수적인 추론 능력을 강화했다.

구글이 크롬에 새로운 기능인 ‘스킬’을 출시했습니다. 이 기능은 사용자가 자주 사용하는 AI 프롬프트를 재사용 가능한 원클릭 워크플로우로 저장할 수 있게 해줍니다. 2026년 4월 14일부터 Mac, Windows, ChromeOS 사용자에게 제공됩니다.

이 튜토리얼에서는 Crawl4AI의 전체 워크플로우를 구축하고 현대 웹 크롤링의 다양한 기능을 탐구합니다. 기본 크롤링, 마크다운 생성, JavaScript 실행 등 필수 기능을 설정하는 방법을 다룹니다.

타이니피쉬가 AI 에이전트를 위한 통합 웹 인프라 플랫폼을 출시했습니다. 이 플랫폼은 검색, 데이터 수집, 브라우저 자동화 기능을 하나의 API 키로 제공합니다.

NVIDIA와 메릴랜드 대학교 연구팀이 오디오 언어 모델 ‘AF-Next’를 공개했습니다. 이 모델은 음성, 환경 소음, 음악 등을 이해하는 데 강력한 성능을 발휘합니다.

이 튜토리얼에서는 구글 ADK를 활용한 고급 데이터 분석 파이프라인을 구축하고, 실제 분석 작업을 위한 다중 에이전트 시스템으로 구성하는 방법을 설명합니다.

구글 AI 연구팀이 협업, 창의성, 비판적 사고를 측정하기 위한 LLM 기반의 Vantage 프로토콜을 제안했다. 기존의 표준화된 테스트로는 이러한 내구성 있는 기술을 평가하기 어렵다는 점을 강조하고 있다.

이 튜토리얼에서는 NVIDIA PhysicsNeMo를 사용하여 물리 기반 머신러닝을 위한 실용적인 워크플로우를 구축합니다. 2D 다르시 흐름 문제를 위한 데이터 생성과 물리적 필드 시각화를 포함합니다.

이 튜토리얼에서는 DuckDB-Python의 기능을 코드로 직접 실습하며 종합적으로 이해하는 과정을 다룹니다. 연결 관리와 데이터 생성의 기초부터 시작해, 실제 분석 워크플로우를 진행합니다.

AI 연구 회사 MiniMax가 MMX-CLI를 출시했습니다. 이 커맨드라인 인터페이스는 AI 에이전트가 이미지, 비디오, 음성, 음악, 비전 및 검색 기능에 접근할 수 있도록 지원합니다.

이 튜토리얼에서는 Microsoft VibeVoice를 사용하여 음성 인식과 실시간 음성 합성을 위한 워크플로우를 구축하는 방법을 소개합니다. 환경 설정부터 최신 모델 지원 확인까지 단계별로 안내합니다.

메타 AI와 킹 압둘라 과학기술대학교(KAUST) 연구진이 신경망이 직접 컴퓨터 역할을 하는 신경 컴퓨터(NC)를 제안했다. 이 연구는 이론적 틀과 함께 두 가지 모델을 소개한다.

이 튜토리얼에서는 MolmoAct를 단계별로 설명하며, 시각적 관찰을 통해 공간에서의 행동 추론 모델이 어떻게 작동하는지 이해합니다. 환경 설정, 모델 로드, 다중 시점 이미지 입력 준비 등을 다룹니다.

MiniMax가 자가 진화 에이전트 모델인 MiniMax M2.7을 오픈 소스로 공개했습니다. 이 모델은 SWE-Pro에서 56.22%, Terminal Bench 2에서 57.0%의 성과를 기록했습니다.

Liquid AI가 새로운 비전-언어 모델 LFM2.5-VL-450M을 출시했다. 이 모델은 바운딩 박스 예측, 다국어 지원, 250ms 이하의 엣지 추론 기능을 갖추고 있다.

MIT, NVIDIA, 저장대학교 연구팀이 긴 체인 추론을 위한 KV 캐시 압축 방법인 TriAttention을 제안했습니다. 이 방법은 전체 주의 메커니즘과 동일한 성능을 유지하면서도 2.5배 더 높은 처리량을 자랑합니다.

이 튜토리얼에서는 OpenClaw 런타임을 구축하고 운영하는 방법을 소개합니다. 로컬 환경에서 안전한 실행 환경을 설정하고, 인증된 모델 접근을 구성하는 방법을 다룹니다.

복잡한 예측 문제를 해결하기 위해 여러 모델을 결합하는 앙상블 방식이 사용되지만, 이는 운영 복잡성과 지연 문제로 인해 실제 적용이 어렵습니다. 지식 증류는 이러한 앙상블을 교사로 활용하여 더 작은 모델을 훈련시키는 방법을 제시합니다.

알리바바의 Tongyi Lab이 비주얼 데이터를 효과적으로 탐색할 수 있는 다중 모달 RAG 프레임워크인 VimRAG를 발표했습니다. 이 프레임워크는 메모리 그래프를 활용하여 대규모 시각적 맥락을 탐색하는 데 중점을 두고 있습니다.

이 튜토리얼에서는 Colab에서 마커 없는 3D 운동학을 이해하기 위한 Pose2Sim 파이프라인을 구축하고 실행하는 방법을 설명합니다. 환경 설정부터 시작해 다양한 단계가 포함됩니다.

NVIDIA가 PyTorch 모델에 최적의 추론 백엔드를 자동으로 찾아주는 오픈소스 툴킷 AITune을 출시했다. 이 툴킷은 연구자가 훈련한 모델과 실제 운영 환경에서 효율적으로 작동하는 모델 간의 간극을 줄이는 데 도움을 준다.

현대 AI는 단일 프로세서에 의존하지 않고, CPU, GPU, TPU, NPU, LPU 등 다양한 전문 컴퓨팅 아키텍처를 활용합니다. 각 아키텍처는 유연성, 병렬 처리, 메모리 효율성 간의 균형을 고려하여 설계되었습니다.

이 튜토리얼에서는 NVIDIA의 KVPress를 통해 긴 문맥 언어 모델 추론을 효율적으로 수행하는 방법을 자세히 설명합니다. 환경 설정, 라이브러리 설치, 모델 로딩 및 간단한 워크플로우 준비 과정을 다룹니다.

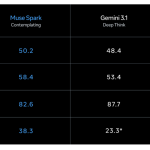

메타 슈퍼인텔리전스 연구소가 ‘뮤즈 스파크’를 발표했습니다. 이 모델은 도구 사용, 시각적 사고 과정, 다중 에이전트 조정을 지원하는 멀티모달 추론 모델입니다.

딥 뉴럴 네트워크는 입력 공간을 재형성하여 복잡한 결정 경계를 형성하는 기하학적 시스템으로 이해될 수 있다. 이 과정에서 각 레이어는 의미 있는 공간 정보를 보존해야 한다.

이 튜토리얼에서는 구글의 LangExtract 라이브러리를 사용해 비정형 텍스트를 구조화된 기계 판독 정보로 변환하는 방법을 소개합니다. OpenAI API 키 설정과 재사용 가능한 추출 파이프라인 구축 방법도 다룹니다.

구글 AI 연구팀이 연구 논문 작성을 자동화하는 다중 에이전트 프레임워크인 PaperOrchestra를 소개했다. 이 시스템은 연구자들이 실험 결과를 정리하고 논문을 작성하는 과정을 간소화하는 데 도움을 줄 것으로 기대된다.

이 튜토리얼에서는 Colab에서 원활하게 실행되는 ModelScope의 전체적인 워크플로우를 탐구합니다. 환경 설정, 의존성 확인, GPU 가용성 검증을 통해 신뢰성 있는 작업을 시작합니다.

AI 에이전트가 컴퓨터를 실제로 사용할 수 있도록 훈련하는 것은 현대 AI의 가장 어려운 인프라 문제 중 하나입니다. OSGym은 이러한 문제를 해결하기 위한 새로운 OS 인프라 프레임워크입니다.

Z.AI가 차세대 모델 GLM-5.1을 출시했습니다. 이 모델은 754억 개의 파라미터를 가진 에이전틱 모델로, SWE-Bench Pro에서 최첨단 성능을 달성하며 8시간의 자율 실행을 지원합니다.

이번 튜토리얼에서는 2026년 3월 구글이 발표한 Gemini API 도구 업데이트를 다룹니다. 구글 검색과 구글 지도, 맞춤형 기능 호출을 단일 API 요청으로 결합하는 방법을 실습을 통해 배워봅니다.

이 튜토리얼에서는 Python을 사용하여 Colab에서 Open WebUI를 안전하게 배포하는 방법을 안내합니다. API 키를 안전하게 입력하고 환경 변수를 설정하는 과정을 포함합니다.

메타 AI가 1억 미만의 파라미터를 가진 새로운 비전 인코더 EUPE를 출시했습니다. 이 모델은 이미지 이해, 밀집 예측 및 언어-비전 모델 작업에서 전문 모델과 경쟁할 수 있는 성능을 자랑합니다.

이 튜토리얼에서는 NVIDIA 변환 엔진을 Python으로 구현하며, 혼합 정밀도 가속을 활용한 딥러닝 워크플로우를 탐구합니다. 환경 설정, GPU 및 CUDA 준비 상태 확인, 필요한 구성 요소 설치 방법을 다룹니다.

RightNow AI 연구팀이 PyTorch 모델의 GPU 커널 최적화를 위한 오픈소스 프레임워크 AutoKernel을 출시했다. 이 프레임워크는 자율 LLM 에이전트 루프를 적용하여 GPU 코드를 자동화하는 것을 목표로 한다.

MaxToki는 세포의 노화를 예측하고 그에 대한 대처 방법을 제시하는 인공지능입니다. 기존 생물학 모델의 한계를 극복하고 세포의 현재 상태를 분석하는 데 도움을 줍니다.

이번 튜토리얼에서는 Netflix의 VOID 모델을 위한 고급 파이프라인을 구축하고 실행하는 방법을 소개합니다. 환경 설정, 필수 종속성 설치, 저장소 클론, 모델 다운로드 등의 과정을 다룹니다.

‘AutoAgent’는 AI 엔지니어가 자신의 에이전트를 최적화할 수 있도록 돕는 오픈소스 라이브러리입니다. 반복적인 작업을 줄이고 효율성을 높이는 데 기여할 것으로 기대됩니다.

패션은 항상 사람의 선호를 예측하는 것이며, 오늘날 인공지능을 통해 이러한 예측이 가능해졌다. 알고리즘과 머신러닝을 활용하여 패션의 미래를 디자인하는 방법을 살펴본다.

넷플릭스 AI 팀이 동영상에서 물체를 지우는 AI 모델 ‘VOID’를 오픈소스로 공개했습니다. 이 모델은 물체 제거 후에도 자연스러운 장면을 유지하는 데 도움을 줍니다.

이 튜토리얼에서는 Z.AI의 GLM-5 모델을 활용하여 실제 에이전틱 애플리케이션을 위한 시스템 구축 방법을 소개합니다. 기본 환경 설정부터 고급 기능까지 단계별로 설명합니다.

구글 딥마인드의 연구팀이 LLM을 활용해 게임 이론 알고리즘을 스스로 재작성하는 AlphaEvolve를 개발했습니다. 이 시스템은 전문가들을 능가하는 성과를 보였습니다.

기술 혁신 연구소(TII)가 자연어 프롬프트를 활용한 오픈 어휘 그라운딩 및 세분화를 위한 0.6B 매개변수 초기 융합 변환기 ‘Falcon Perception’을 발표했다. 이 기술은 언어와 비전 간의 상호작용을 개선할 것으로 기대된다.

이 튜토리얼에서는 NVIDIA 모델 최적화기를 사용하여 Google Colab에서 딥러닝 모델을 훈련하고 가지치기 및 미세 조정하는 전체 파이프라인을 구축하는 방법을 설명합니다.

Arcee AI가 복잡한 다단계 추론이 가능한 오픈 소스 AI 모델 ‘Trinity Large Thinking’을 Apache 2.0 라이선스 하에 공개했다. 이는 개발자들에게 투명한 대안을 제공한다.

구글의 최신 모델을 NVIDIA RTX AI PC에서 더욱 빠르게 실행하여 개인화된 AI 어시스턴트를 구축할 수 있는 방법을 소개합니다. 이 과정에서 발생하는 ‘토큰 세금’ 문제를 해결하는 기술적 진전을 다룹니다.

IBM이 기업급 문서 데이터 추출을 위해 설계된 비전-언어 모델인 Granite 4.0 3B 비전을 출시했습니다. 이 모델은 고충실도의 시각적 추론을 제공하는 전문 어댑터로 구성되어 있습니다.

이 튜토리얼에서는 AgentScope 워크플로우를 처음부터 끝까지 구축하고 Colab에서 실행하는 방법을 설명합니다. OpenAI와 AgentScope를 연결하고 기본 모델 호출을 검증하는 과정이 포함됩니다.

Z.ai가 GLM-5V-Turbo를 출시했습니다. 이 모델은 시각적 인식과 코드 실행 간의 간극을 메우는 데 중점을 두고 있으며, 소프트웨어 엔지니어링에 필요한 엄격한 구문으로 시각 정보를 변환하는 데 강점을 보입니다.

이 튜토리얼에서는 Hugging Face Transformers와 HF Token을 사용하여 Gemma 3 1B 인스트럭션을 위한 Colab 워크플로우를 구축하고 실행하는 방법을 단계별로 설명합니다.

Hugging Face가 TRL(Transformer Reinforcement Learning) v1.0을 공식 출시했습니다. 이 버전은 연구 중심의 라이브러리에서 안정적인 프로덕션 준비 프레임워크로의 전환을 의미합니다.

구글이 비디오 생성 포트폴리오의 새로운 모델인 Veo 3.1 Lite를 발표했다. 이 모델은 생산 규모 배포의 주요 장애물인 가격 문제를 해결하기 위해 설계되었다.

Liquid AI가 LFM2.5-350M 모델을 출시했습니다. 이 모델은 28T 토큰으로 훈련된 350M 파라미터의 컴팩트한 구조로, 기존의 스케일링 법칙에 도전하는 사례로 주목받고 있습니다.

이 튜토리얼에서는 A-Evolve 프레임워크를 사용하여 OpenAI 기반의 에이전트를 구축하고, 맞춤형 벤치마크를 정의하며, 진화 엔진을 개발하는 과정을 설명합니다.

알리바바 Qwen 팀이 Qwen3.5-Omni를 출시했습니다. 이 모델은 텍스트, 오디오, 비디오를 통합하여 실시간 상호작용을 지원하는 멀티모달 언어 모델로, 기존의 모델들과 차별화된 점이 있습니다.

마이크로소프트가 다양한 언어에 대한 고품질 의미 표현을 제공하는 다국어 텍스트 임베딩 모델 Harrier-OSS-v1을 발표했다. 이 모델은 270M, 0.6B, 27B의 세 가지 규모로 제공된다.

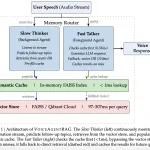

세일즈포스 AI 연구팀이 음성 AI의 반응 속도를 획기적으로 개선하는 VoiceAgentRAG를 발표했다. 이 기술은 음성 기반 RAG 시스템의 지연 시간을 크게 줄여 자연스러운 대화 흐름을 유지할 수 있도록 돕는다.

에이전트 인프라가 AI 에이전트를 위한 올인원 런타임인 AIO 샌드박스를 공개했습니다. 이 오픈소스 프로젝트는 코드 실행을 위한 기능적이고 격리된 환경을 제공합니다.

이 튜토리얼에서는 OpenAI 호환 모델을 사용하여 CAI 사이버 보안 AI 프레임워크를 단계별로 구축하고 탐색합니다. 환경 설정부터 API 키 안전 로딩, 기본 에이전트 생성까지 다룹니다.

아마존 연구팀이 자율 AI 에이전트 개발을 자동화하는 A-Evolve라는 인프라를 발표했습니다. 이 프레임워크는 수동 조정 대신 자동화된 진화 과정을 통해 에이전트 개발을 혁신할 것으로 기대됩니다.

Chroma가 다중 홉 검색, 컨텍스트 관리 및 확장 가능한 합성 작업 생성을 위한 20억 파라미터의 에이전틱 검색 모델 ‘Context-1’을 발표했다. 이 모델은 기존의 컨텍스트 윈도우의 한계를 극복하는 데 중점을 두고 있다.

구글이 AI 기능을 제품에 통합하면서 새로운 기술적 개체인 ‘Google-Agent’가 서버 로그에 등장했습니다. 이는 자동화된 인덱서와 사용자 요청을 구분하는 데 중요한 역할을 합니다.

이 튜토리얼에서는 HKUDS의 초경량 개인 AI 에이전트 프레임워크인 나노봇을 깊이 있게 탐구합니다. 기본 시스템을 수동으로 재구성하며 나노봇의 핵심 기능을 이해하는 방법을 소개합니다.

Mistral AI가 오픈 웨이트 텍스트-투-스피치 모델인 Voxtral TTS를 출시했습니다. 이는 회사의 오디오 생성 분야로의 첫 번째 주요 진출로, 개발자 생태계에서 독점 음성 API와의 경쟁을 목표로 하고 있습니다.

NVIDIA 연구진이 다중 턴 LLM 에이전트를 위한 강화 학습 인프라인 ProRL AGENT를 소개했다. 이 시스템은 ‘롤아웃-서비스’ 철학을 채택하여 에이전트 롤아웃 조정을 훈련 루프와 분리한다.

이 튜토리얼에서는 마크다운 노트를 탐색 가능한 지식 그래프로 다루는 오픈소스 개인 지식 관리 시스템 IWE를 구현합니다. 개발자 지식 기반을 구축하고, 위키 링크와 마크다운 링크를 연결하는 방법을 설명합니다.

openJiuwen 커뮤니티가 자가 진화하는 AI 에이전트 ‘JiuwenClaw’를 출시했습니다. 이 AI는 실제 작업을 수행하는 데 중점을 두고 개발되었습니다.

메타가 새로운 뇌 인코딩 모델 TRIBE v2를 발표했습니다. 이 모델은 비디오, 오디오, 텍스트 자극에 대한 fMRI 반응을 예측할 수 있는 기능을 갖추고 있습니다.

구글이 개발자들을 위해 ‘제미니 3.1 플래시 라이브’를 공개했습니다. 이 모델은 저지연의 자연스러운 음성 상호작용을 목표로 하며, 멀티모달 스트림을 처리할 수 있는 기술적 기반을 제공합니다.

이 튜토리얼에서는 Claude 스타일의 사고로 증류된 Qwen3.5 모델을 사용하여 Colab 파이프라인을 설정하는 방법을 설명합니다. 27B GGUF 변형과 경량 2B 4비트 버전 간의 전환이 가능합니다.

코히어가 새로운 자동 음성 인식 모델 ‘코히어 트랜스크라이브’를 출시하며 기업 AI 시장에 진입했습니다. 이 모델은 비구조화된 오디오를 실용적인 텍스트로 변환하는 데 도움을 줍니다.

텐센트 AI 연구소가 7B 매개변수를 가진 Covo-Audio라는 음성 언어 모델을 공개했습니다. 이 모델은 연속 오디오 입력을 처리하고 오디오 출력을 생성하는 통합 아키텍처를 제공합니다.

이 튜토리얼에서는 MolmoWeb을 사용하여 스크린샷에서 직접 웹사이트를 이해하고 상호작용하는 AI 에이전트를 구축하는 방법을 소개합니다. Colab 환경을 설정하고, 4비트 양자화를 통해 MolmoWeb-4B 모델을 로드합니다.

NVIDIA가 새로운 AI 프레임워크인 PivotRL을 소개했습니다. 이 프레임워크는 4배 적은 롤아웃 턴으로 높은 에이전틱 정확도를 달성할 수 있도록 설계되었습니다.

구글이 대형 언어 모델의 메모리 통신 오버헤드를 줄이기 위해 TurboQuant라는 새로운 압축 알고리즘을 발표했습니다. 이 알고리즘은 LLM의 키-값 캐시 메모리를 6배 줄이고 최대 8배의 속도 향상을 제공합니다.

대형 언어 모델(LLM)을 운영할 때 GPU 메모리가 주요 제한 요소로 작용하며, 이는 요청마다 토큰 수준 데이터를 저장하기 위한 KV 캐시가 필요하기 때문이다. 페이지드 어텐션 기술이 이 문제를 해결할 수 있다.

이 튜토리얼에서는 HKUDS가 개발한 자가 진화형 기술 엔진 OpenSpace를 소개합니다. AI 에이전트의 효율성을 높이고, 작업 수행을 통해 학습하는 방법을 다룹니다.

메타의 FAIR 연구팀과 코넬 대학교, 카네기 멜론 대학교의 연구자들이 극소수의 파라미터로도 대형 언어 모델이 추론을 학습할 수 있음을 입증했습니다. 이들은 TinyLoRA라는 새로운 방법을 소개했습니다.

얀 르쿤의 새로운 LeWorldModel 연구는 픽셀 데이터에서 훈련된 세계 모델이 겪는 ‘표현 붕괴’ 문제를 해결하기 위한 접근 방식을 제시합니다. 이 연구는 예측 목표를 충족하기 위해 중복된 임베딩을 생성하는 문제를 다룹니다.

메타 AI의 하이퍼 에이전트는 단순히 작업을 해결하는 것을 넘어, 학습 방식을 혁신적으로 변화시키고 있습니다. 이는 AI의 자기 개선 가능성을 한층 높이는 발전으로 평가됩니다.

루마랩스가 기존의 확산 파이프라인의 ‘의도 격차’를 해결하기 위해 구조적 추론이 가능한 이미지 모델 ‘유니-1’을 출시했다. 이 모델은 이미지 생성 전에 추론 단계를 도입하여 새로운 워크플로우를 제시한다.

이 튜토리얼에서는 Google의 새로운 오픈소스 MCP 서버인 colab-mcp를 활용하여 Google Colab 노트북과 런타임을 프로그래밍적으로 제어하는 AI 에이전트를 설계하는 방법을 소개합니다.