검색 엔진에 쿼리를 입력할 때, 어떤 문서가 관련성이 있는지를 결정하고 순위를 매기는 방법에 대해 BM25와 RAG의 차이를 살펴봅니다.

검색 엔진에 쿼리를 입력할 때, 어떤 문서가 관련성이 있는지를 결정하고 순위를 매기는 방법에 대해 BM25와 RAG의 차이를 살펴봅니다.

이 튜토리얼에서는 Google DeepMind가 개발한 RLax 라이브러리를 사용하여 CartPole 환경을 해결하는 강화 학습 에이전트를 구현합니다. JAX, Haiku, Optax와 함께 Deep Q-Learning(DQN) 에이전트를 구축하는 방법을 소개합니다.

AI 에이전트 개발의 현재 상태는 여러 경쟁 생태계 간의 단편화로 특징지어집니다. GitAgent는 이러한 문제를 해결하기 위한 새로운 솔루션으로 주목받고 있습니다.

이 튜토리얼에서는 Python을 이용한 계산 재료 과학을 위한 pymatgen 라이브러리의 기능을 탐구합니다. 실리콘, 염화나트륨, LiFePO4 유사 물질의 결정 구조를 구축하고, 이들의 격자 속성과 조성을 분석합니다.

머신러닝 모델을 생산 환경에 배포하는 것은 ML 생애 주기에서 중요한 단계입니다. 기존 모델을 직접 교체하는 것은 위험할 수 있으며, 이를 안전하게 수행하기 위한 네 가지 전략이 소개됩니다.

이 튜토리얼에서는 신뢰도를 추정하고 자기 평가 기능을 포함한 불확실성 인식 대형 언어 모델 시스템을 구축하는 방법을 소개합니다. 이 시스템은 답변을 생성하고 그에 대한 신뢰도를 평가합니다.

NVIDIA가 Nemotron-Cascade 2를 출시했습니다. 이 모델은 30B Mixture-of-Experts(MoE) 구조로, 3B의 활성화된 매개변수를 통해 뛰어난 추론 능력을 제공합니다.

이 튜토리얼에서는 HKUDS가 개발한 오픈소스 에이전트 군집 지능 프레임워크인 ClawTeam의 핵심 아키텍처를 소개합니다. 복잡한 목표를 하위 작업으로 분해하는 리더 에이전트와 자율적으로 작업을 수행하는 전문 작업 에이전트의 개념을 구현합니다.

LlamaIndex가 AI 에이전트 워크플로우에서 공간 PDF를 파싱하기 위한 CLI 및 TypeScript 기반 라이브러리인 LiteParse를 출시했습니다. 이 도구는 데이터 수집 파이프라인의 병목 현상을 해결하는 데 도움을 줄 것으로 기대됩니다.

구글이 AI 에이전트가 Google Colab 환경과 직접 상호작용할 수 있는 오픈소스 MCP 서버를 출시했습니다. 이로 인해 에이전트는 클라우드 기반 Jupyter 노트북에서 Python 코드를 생성하고 수정하며 실행할 수 있는 프로그램적 접근이 가능해졌습니다.

이 튜토리얼에서는 Diffrax 라이브러리를 사용하여 미분 방정식을 해결하고 신경 미분 방정식 모델을 구축하는 방법을 설명합니다. JAX, Diffrax 등 필요한 과학 컴퓨팅 라이브러리 설치부터 시작합니다.

카네기 멜론 대학교와 프린스턴 대학교의 연구팀이 새로운 상태 공간 모델 Mamba-3를 발표했습니다. 이 모델은 2배 작은 상태를 사용하며, MIMO 디코딩 하드웨어 효율성을 개선했습니다.

칭화대학교와 앤트 그룹의 연구진이 자율 LLM 에이전트인 OpenClaw의 취약점을 완화하기 위한 5단계 생애주기 기반 보안 프레임워크를 공개했습니다. 이 프레임워크는 OpenClaw의 ‘커널-플러그인’ 구조의 취약점을 분석한 결과에서 출발했습니다.

바이두 치안판 팀이 40억 개 매개변수를 가진 ‘치안판-OCR’을 출시했습니다. 이 모델은 문서 파싱, 레이아웃 분석, 문서 이해를 통합하여 이미지에서 직접 Markdown으로 변환할 수 있습니다.

NVIDIA가 자율 AI 에이전트를 위한 안전한 런타임 환경인 ‘OpenShell’을 오픈소스로 공개했습니다. 이 시스템은 도구 사용과 코드 실행이 가능한 자율 AI 에이전트의 보안 문제를 해결하기 위한 것입니다.

ServiceNow Research가 복잡한 전문 워크플로우를 수행할 수 있는 자율 에이전트를 평가하기 위한 새로운 벤치마크인 EnterpriseOps-Gym을 소개했습니다. 이 벤치마크는 기업 환경의 특정 도전 과제를 반영합니다.

언슬로스 AI가 고성능 대형 언어 모델(LLM) 미세 조정을 위한 로컬 노코드 인터페이스 ‘언슬로스 스튜디오’를 출시했습니다. 이 스튜디오는 VRAM 사용량을 70% 줄여 효율성을 높입니다.

구글과 연구팀이 아프리카 언어를 위한 다국어 음성 데이터셋 WAXAL을 발표했다. 이 데이터셋은 24개 언어를 포함하며, 자동 음성 인식 및 텍스트 음성 변환 모델 훈련에 활용될 예정이다.

이 튜토리얼에서는 NVIDIA Warp를 사용하여 Python에서 고성능 GPU 및 CPU 시뮬레이션을 구축하는 방법을 소개합니다. Colab 호환 환경을 설정하고 Warp를 초기화하는 과정이 포함됩니다.

Mistral AI가 Mistral Small 4를 출시했습니다. 이 모델은 다양한 기능을 통합하여 단일 배포 대상으로 설계되었습니다. Mistral Small 4는 지시 수행, 추론, 다중 모드 이해를 결합한 첫 번째 모델입니다.

문샷 AI 연구팀이 변환기 모델의 성능 향상을 위해 깊이별 주의를 활용한 새로운 잔여 연결 방식을 발표했습니다. 이 방식은 기존의 고정 잔여 혼합 방식의 구조적 문제를 해결하는 데 중점을 두고 있습니다.

IBM이 다국어 자동 음성 인식 및 번역을 위한 컴팩트한 음성 모델 Granite 4.0 1B Speech를 출시했습니다. 이 모델은 메모리 사용량과 지연 시간, 계산 효율성을 중시하는 기업 및 엣지 스타일의 음성 배포를 목표로 하고 있습니다.

이 튜토리얼에서는 OpenClaw와 Python을 사용하여 기업 수준의 AI 거버넌스 시스템을 구축하는 방법을 소개합니다. OpenClaw 런타임 설정과 API를 통한 에이전트와의 상호작용을 다룹니다.

OpenViking은 AI 에이전트를 위한 오픈소스 컨텍스트 데이터베이스로, 파일 시스템 기반의 메모리와 검색 기능을 제공합니다. 이 프로젝트는 에이전트 시스템이 컨텍스트를 단순한 텍스트 덩어리로 취급하지 않도록 설계되었습니다.

LangChain이 다단계, 상태 유지, 복잡한 작업에 적합한 AI 에이전트용 라이브러리 ‘Deep Agents’를 출시했다. 이 라이브러리는 계획, 메모리, 컨텍스트 분리를 지원한다.

Zhipu AI가 문서 파싱과 핵심 정보 추출에 최적화된 0.9B 규모의 멀티모달 OCR 모델 GLM-OCR을 선보였다. 이 모델은 실제 문서에서 표, 수식 등 복잡한 구조를 효율적으로 처리하는 것을 목표로 한다.

이 튜토리얼에서는 Outlines를 활용해 타입 안전하고 구조화된 언어 모델 출력물을 생성하는 방법을 소개한다. Literal, int, bool 같은 타입 제약을 적용하고, Pydantic 모델로 엄격한 스키마 검증을 구현한다.

개리 탄이 AI 코딩을 위한 오픈소스 툴킷 ‘gstack’을 발표했다. 이 시스템은 제품 기획, 엔지니어링 리뷰, 출시, 품질 검증을 각각 독립된 모드로 분리해 신뢰성을 높이는 데 중점을 뒀다.

구글 딥마인드가 수학 경시대회 수준을 넘어 전문 연구를 수행할 수 있는 AI 에이전트 ‘알레시아’를 선보였다. 이 AI는 자연어로 해법을 생성, 검증, 수정하며 복잡한 연구 문제를 해결한다.

최근 AI 에이전트 생태계에서는 외부 도구와 도메인 지식 활용을 위한 두 가지 접근법인 스킬과 모델 컨텍스트 프로토콜(MCP)이 주목받고 있다. 이들은 설정과 작업 수행 방식에서 차이를 보인다.

구글 AI 연구팀이 Gemini 모델을 활용해 비정형 글로벌 뉴스에서 구조화된 역사 데이터를 추출하는 새로운 방법론 ‘Groundsource’를 발표했다. 이 프로젝트는 급작스러운 자연재해에 대한 역사 데이터 부족 문제를 해결하는 데 목적이 있다.

이 튜토리얼에서는 Andrej Karpathy가 제안한 AutoResearch 프레임워크를 구글 콜랩에 맞게 구현하는 방법을 소개합니다. 자동화된 실험 파이프라인을 구축해 하이퍼파라미터 조정과 실험 추적을 자동으로 수행합니다.

스탠퍼드 대학 연구진이 기기 내에서 완전히 작동하는 개인 AI 에이전트를 개발할 수 있는 오픈소스 프레임워크 ‘OpenJarvis’를 발표했다. 이 플랫폼은 로컬 우선 AI 시스템 구축을 위한 연구 및 배포용 인프라를 제공한다.

이 튜토리얼에서는 계속해서 안전한 부분 추론 업데이트를 스트리밍하는 동안 온라인으로 생각하고 행동하는 스트리밍 의사 결정 에이전트를 구축합니다. 이는 이동하는 장애물과 이동하는 목표가 있는 동적 그리드 월드를 구현하고, 온라인 A* 플래너를 사용하여 미래 몇 단계에만 집중합니다.

NVIDIA가 Nemotron 3 Super를 공개했다. 이 모델은 복잡한 다중 에이전트 응용 프로그램을 위해 설계된 놀라운 1200억 파라미터 추론 모델로, 경쟁 모델보다 5배 높은 처리량을 제공한다.

구글이 Gemini Embedding 2를 발표했다. 이 모델은 텍스트 뿐만 아니라 이미지, 비디오, 오디오, 문서 등을 임베딩 공간으로 가져와 AI 개발자가 고차원 저장 및 교차 모달 검색 도전에 대처할 수 있도록 설계되었다.

Fish Audio의 S2-Pro은 Fish Speech 생태계 내에서의 플래그십 모델로, 고품질의 다중 화자 합성과 150ms 미만의 대기 시간을 갖춘 오픈 아키텍처로의 전환을 대표함. 릴리스는 제로샷 보이스 클로닝과 세밀한 음성 복제를 위한 프레임워크를 제공함.

이 튜토리얼에서는 간단한 작업 설명서로부터 자동으로 다른 에이전트를 설계하는 메타 에이전트를 구축합니다. 작업을 분석하고 도구를 선택하며 메모리 아키텍처를 선택하고 계획자를 구성한 다음 완전히 작동하는 에이전트 런타임을 인스턴스화하는 시스템을 구현합니다. 정적 에이전트 템플릿을 넘어서 동적이고 자가 구성되는 아키텍처를 구축합니다.

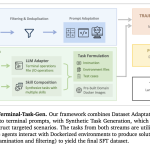

NVIDIA가 Nemotron-Terminal을 공개했다. 이는 LLM 터미널 에이전트의 확장을 위한 체계적인 데이터 엔지니어링 파이프라인으로, 자율 주행 AI 에이전트 구축 경쟁에서 데이터가 병목 현상을 일으키고 있다. 새로운 모델과 훈련 전략의 불투명성은 연구자와 개발자를 고비용의 암묵적인 사이클로 몰아넣고 있다.

이 튜토리얼에서는 내부 비평가와 불확실성 추정 프레임워크를 통합하여 단순한 응답 생성을 넘어진 심화된 에이전트 시스템을 구축한다. 다중 샘플 추론을 시뮬레이션하고 후보 응답을 정확도, 일관성, 안전성 측면에서 평가하며, 엔트로피, 분산, 일관성 측정을 사용하여 예측 불확실성을 양적화한다. 자신감을 균형있게 유지하기 위해 위험에 민감한 선택 전략을 구현한다.

바이트댄스가 DeerFlow 2.0을 공개했다. 이 프레임워크는 ‘슈퍼에이전트’로 일을 제안하는 것뿐만 아니라 실행하는 기능을 갖추고 있어, 복잡한 작업을 수행할 수 있다.

Andrew Ng와 그의 팀이 개발한 Context Hub은 코딩 에이전트의 정적 훈련 데이터와 현대 API의 빠르게 변화하는 현실 사이의 간극을 줄이기 위해 설계된 오픈 소스 도구입니다.

Anthropic은 Claude Code를 통해 고급 에이전틱 다단계 추론 루프를 활용해 복잡한 보안 연구를 자동화하는 코드 리뷰를 소개하고 있다. 이는 AI가 보일러플레이트만 작성하는 것을 넘어서 실제로 왜 Kubernetes 클러스터가 새벽 3시에 알람을 울리는지 이해하는 AI 에이전트를 지향하는 것이다.

구글 연구팀은 현재의 AI 에이전트들이 ‘확률적 추론’ 능력을 크게 부족하다고 주장하며, 대규모 언어 모델(LLM)이 새로운 증거를 기반으로 믿음을 업데이트하는 냉정하고 단단한 논리에 대해 얼마나 고집스러운지 설명했다.

이 튜토리얼에서는 Scanpy를 사용하여 단일 세포 RNA 시퀀싱 분석을 위한 완전한 파이프라인을 구축합니다. 필요한 라이브러리를 설치하고 PBMC 3k 데이터세트를 로드한 다음 품질 관리, 필터링, 정규화를 수행하여 데이터를 준비합니다. 고변동 유전자를 식별하고 차원 축소를 위해 PCA를 수행한 후 클러스터링 및 시각화를 진행합니다.

OpenAI가 Codex Security를 소개했습니다. 이는 코드베이스를 분석하여 취약점을 확인하고 개발자가 수정 전에 검토할 수 있는 보안 에이전트입니다. 제품은 ChatGPT Enterprise, Business 및 Edu 고객을 대상으로 연구 미리보기로 롤아웃 중입니다.

구글이 안드로이드 개발 작업에서 Large Language Models (LLMs)의 성능을 측정하기 위한 새로운 리더보드 및 평가 프레임워크인 안드로이드 벤치를 공개했다. 데이터셋, 방법론, 테스트 하네스는 GitHub에서 공개되었으며, 일반 코딩 벤치마크가 캡처하지 못하는 안드로이드 개발 작업에 적합하다.

Liquid AI가 LocalCowork를 발표했는데, 이는 LFM2-24B-A2B를 활용한 모델로, 기업 워크플로우를 기기 내에서 완전히 실행할 수 있도록 해준다. API 호출과 데이터 이탈을 없애 프라이버시에 민감한 환경에서 사용된다.

이 튜토리얼에서는 Daft를 사용하여 고성능의 파이썬 데이터 엔진으로 엔드투엔드 분석 파이프라인을 구축하는 방법을 탐구합니다. MNIST 데이터셋을 로드한 다음 UDF, 피처 엔지니어링, 집계, 조인 및 지연 실행을 통해 점진적으로 변환하는 방법을 살펴봅니다. 구조화된 데이터 처리, 숫자 계산, 이미지 처리 등을 원활하게 결합하는 방법을 보여줍니다.

구글 워크스페이스 API를 애플리케이션과 데이터 파이프라인에 통합하는 것은 REST 엔드포인트, 페이지네이션, OAuth 2.0 흐름을 처리하는 보일러플레이트 코드를 작성해야 하는데, 구글 AI 팀이 ‘gws’ CLI 도구를 공개했다. 이 오픈소스 도구는 Google Workspace를 위한 통합된 동적 명령줄 인터페이스를 제공한다.

OpenAI는 심포니를 공개했습니다. 이는 구조화된 ‘실행’을 통해 자율 AI 코딩 에이전트를 관리하기 위한 오픈 소스 프레임워크로, 이 프로젝트는 이슈 트래커를 LLM 기반 에이전트에 연결하여 소프트웨어 개발 작업을 자동화하는 시스템을 제공합니다. 시스템 아키텍처는 Elixir 및 BEAM을 사용합니다.

본 튜토리얼에서는 Tree-of-Thoughts(TOT) 다중 분기 추론 에이전트를 처음부터 구축한다. 선형 사고 체인 대신에 여러 추론 분기를 생성하고 각 분기를 휴리스틱 평가 함수로 점수를 매기며 약한 후보를 제거하고 가장 강력한 경로만 계속 확장하는 시스템을 설계한다.

YuanLab AI가 오픈소스 Mixture-of-Experts (MoE) 대형 언어 모델인 Yuan 3.0 Ultra를 공개했다. 이 모델은 1조 개의 총 파라미터와 68.8조 개의 활성화된 파라미터를 특징으로 하며, 기업 성능을 최적화하고 사전 훈련 효율성을 높이는 것을 목표로 한다.

이 튜토리얼에서는 EverMem-스타일의 영구적인 에이전트 OS를 구축하는 방법에 대해 알아본다. FAISS를 사용하여 짧은 기간의 대화적 맥락과 장기 기억 벡터를 결합하여 각 응답 생성 전 관련 과거 정보를 회상할 수 있게 한다. 의미 기억과 함께 SQLite에 구조화된 레코드를 저장하여 타임스탬프, 중요도 점수, 메모리 신호(선호도 등)와 같은 메타데이터를 영속화한다.

LangWatch는 AI 개발이 단순한 채팅 인터페이스에서 복잡한 자율 에이전트로 이동함에 따라 산업이 직면한 중요한 병목 현상, 즉 비결정론에 대응하기 위해 설계된 오픈소스 플랫폼이다. LangWatch는 AI 에이전트의 엔드 투 엔드 추적, 시뮬레이션 및 체계적인 테스팅을 가능하게 한다.

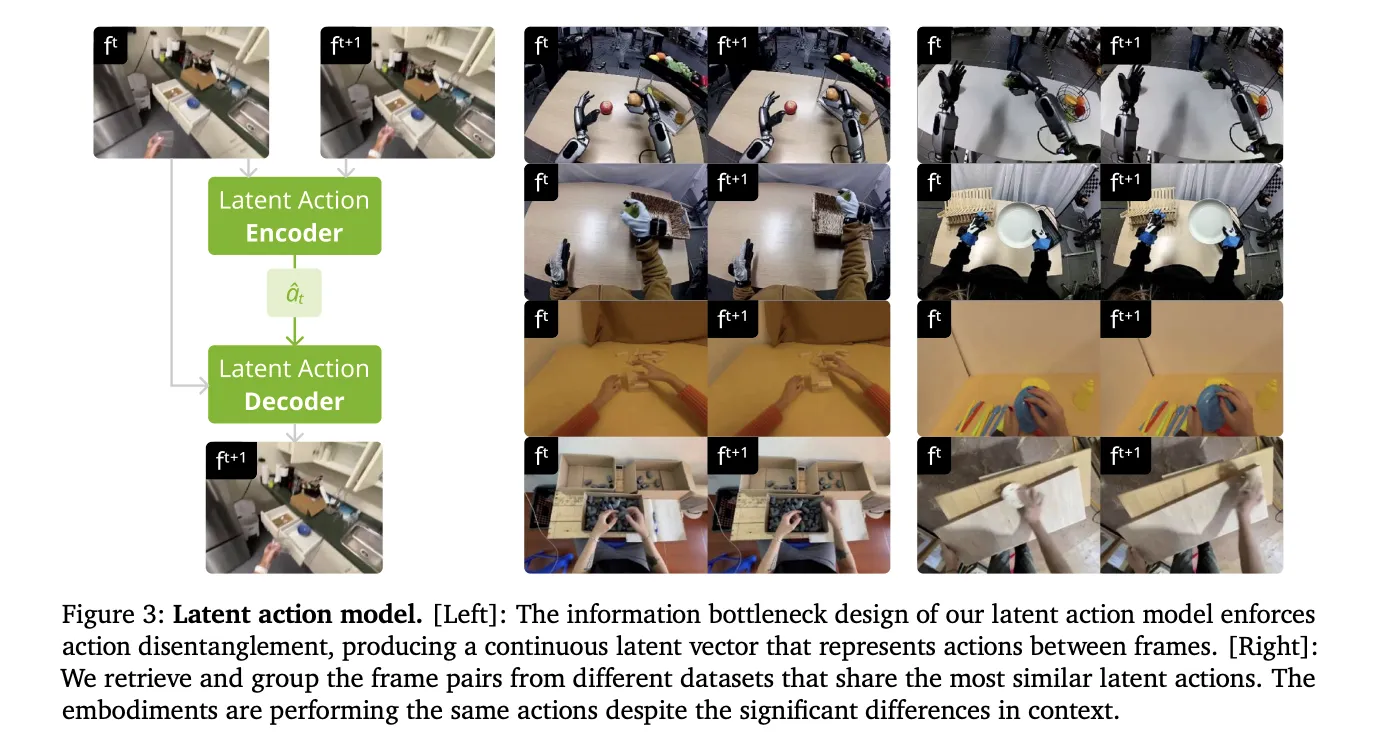

현재의 로봇 정책은 주로 한 번의 관찰 또는 매우 짧은 역사에 기반하며, 장기 과제에 부족함이 있습니다. 이를 해결하기 위해 Physical Intelligence, Stanford, UC Berkeley, MIT의 연구진이 개발한 멀티 스케일 메모리 시스템은 복잡한 작업에 필요한 15분간의 컨텍스트를 제공합니다.

심볼릭 회귀를 통해 딥러닝 모델을 해석 가능한 수학 방정식으로 변환하는 라이브러리 ‘SymTorch’가 소개되었다. 훈련된 모델이 어떤 것을 배웠는지 알아보는 것이 중요한데, 이를 실현하기 위한 기술이다.

이 튜토리얼에서는 Unsloth와 QLoRA를 사용하여 대형 언어 모델을 효율적으로 파인 튜닝하는 방법을 보여줍니다. GPU 감지 실패, 런타임 충돌, 라이브러리 호환성과 같은 일반적인 문제를 처리하는 안정적인 end-to-end 감독 파인 튜닝 파이프라인 구축에 초점을 맞춥니다.

구글이 Gemini 3.1 Flash-Lite를 공개했다. 고성능 작업에 최적화된 이 모델은 낮은 지연시간과 토큰 당 비용을 중점으로 고안되었다. 현재 Gemini API 및 Vertex AI를 통해 Public Preview로 이용 가능하다.

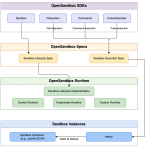

알리바바가 오픈소스 도구인 OpenSandbox를 출시했습니다. 이 도구는 AI 에이전트에 안전하고 격리된 환경을 제공하여 코드 실행, 웹 브라우징, 모델 훈련을 가능하게 합니다. Apache 2.0 라이선스 하에 공개된 OpenSandbox는 AI 에이전트 스택의 ‘실행 레이어’를 표준화하고 여러 프로그래밍 언어에서 작동하는 통일된 API를 제공합니다.

이 튜토리얼에서는 Vaex를 사용하여 메모리에 데이터를 물리적으로 구현하지 않고 수백만 개의 행에서 효율적으로 작동하는 제품 수준의 분석 및 모델링 파이프라인을 설계합니다. 우리는 현실적인 대규모 데이터 세트를 생성하고, 게으른 표현과 근사 통계를 사용하여 풍부한 행동 및 도시 수준의 피처를 엔지니어링하며, 대규모로 통찰을 집계합니다. 그런 다음 Vaex를 scikit-learn과 통합합니다.

알리바바의 Qwen 팀이 0.8B ~ 9B 파라미터의 Qwen3.5 Small 모델 시리즈를 출시했다. 이 모델은 ‘더 많은 지능, 적은 연산’에 초점을 맞춰 산업 트렌드에서 벗어나 더 나은 AI 배포를 지향한다.

NullClaw는 Raw Zig로 완전한 스택 AI 에이전트 프레임워크를 구현하여 Python이나 Go와 같은 고수준 관리 언어에 의존하는 기존의 프레임워크와는 달리 런타임, 가상 머신, 가비지 컬렉터를 통해 상당한 오버헤드를 제거하고 있다.

FireRedTeam은 FireRed-OCR-2B를 발표했는데, 이 모델은 문서 구문 분석을 처리하기 위해 설계되었고, LVLM에서 발생하는 ‘구조적 환각’을 해결하는 데 사용된다.

SHAP-IQ를 활용해 설명 가능한 AI 분석 파이프라인을 구축하는 튜토리얼. 파이썬 환경에서 특성 중요도와 상호 작용 효과를 이해하기 위해 실제 데이터셋을 사용하고 고성능 랜덤 포레스트 모델을 학습한 후 SHAP-IQ 상호 작용 지수를 적용하여 모델 예측의 정확하고 이론적으로 기반된 설명을 계산함.

산업용 추천 시스템에서 Large Language Models (LLMs)를 활용한 Generative Retrieval (GR)이 일반적인 임베딩 기반의 검색을 대체하고 있으며, 이에 따라 엄격한 비즈니스 로직을 준수하는 STATIC 프레임워크가 속도 향상을 제공한다.

이 튜토리얼에서는 LangGraph와 Pydantic을 활용한 고급 멀티 에이전트 통신 시스템을 구축한다. 공유 상태를 통해 에이전트들이 직접 호출하는 대신 통신할 수 있는 엄격한 ACP 스타일의 메시지 스키마를 정의하여 모듈화, 추적성, 그리고 생산용 오케스트레이션을 가능하게 한다. 세 가지 특수화된 에이전트를 구현한다.

알리바바의 연구진이 공개한 CoPaw는 개발자들이 모델 환경에 중점을 둔 오픈소스 프레임워크로, 단순한 대형 언어 모델 추론에서 자율 에이전트 시스템으로 이동함에 따라 개발자들의 과제가 변화하고 있다.

MLflow를 사용하여 생산용 ML 실험 및 배포 워크플로우를 구축하는 튜토리얼. MLflow 추적 서버를 시작하고 구조화된 백엔드 및 아티팩트 저장소를 사용하여 실험을 추적하고, 중첩된 하이퍼파라미터 스윕을 통해 여러 머신러닝 모델을 훈련하고 자동화된 모델 평가 및 배포까지 진행.

Generative AI의 발전은 잠재 확산 모델(LDMs)에 많이 의존하고 있습니다. 잠재 공간으로 데이터를 압축함으로써 모델이 효과적으로 확장될 수 있습니다. 그러나 낮은 정보 밀도는 잠재 변수를 학습하기 쉽게 만들지만 재구성 품질을 희생시키는 기본적인 트레이드오프가 존재합니다.

본 튜토리얼에서는 오픈 소스 instruct 모델을 활용하여 계층적 플래너 에이전트를 구축한다. 이 구조화된 다중 에이전트 아키텍처에는 플래너 에이전트, 실행자 에이전트 및 집계자 에이전트가 포함되어 있으며 각 구성 요소가 복잡한 작업을 해결하는 데 특화된 역할을 수행한다. 플래너 에이전트를 사용하여 고수준 목표를 실행 가능한 단계로 분해한다.

이 Folium 튜토리얼에서는 Colab이나 로컬 Python 환경에서 실행되는 완전한 대화형 지도 세트를 구축합니다. 다양한 베이스맵 스타일을 탐색하고 HTML 팝업을 사용하여 풍부한 마커를 설계하며 히트맵을 사용하여 공간 밀도를 시각화합니다. 또한 GeoJSON에서 지역 수준의 코로플레스 맵을 생성하고 마커 클러스터링을 사용하여 수천 개의 포인트로 확장합니다.

일본의 Sakana AI가 비용 분할을 통해 제한을 우회하는 새로운 접근 방식을 제안했습니다. 최근 두 논문에서 Text-to-LoRA (T2L)과 같은 하이퍼네트워크를 소개하며, 대규모 언어 모델(LLM)의 사용을 개인화하는 과정에서 발생하는 공학적 트레이드오프를 극복했습니다.

Perplexity사가 대규모 검색 작업에 최적화된 다국어 임베딩 모델 pplx-embed을 출시했다. 웹 규모 데이터의 복잡성과 잡음을 처리하기 위한 이 모델은 전용 임베딩 API에 대한 대안으로 제작되었다. 양방향 어텐션과 확산을 활용한 구조적 혁신이 돋보인다.

Microsoft의 연구진은 CORPGEN을 소개했는데, 이는 계층적 계획과 메모리를 활용하여 자율형 디지털 직원을 통해 현실적인 조직 업무의 복잡성을 관리하는 데 사용되는 아키텍처에 중립적인 프레임워크이다. 기존의 AI 에이전트는 단일 작업에 대해 평가되지만, 실제 기업 환경에서는 복잡한 종속성을 가진 여러 작업을 동시에 처리해야 한다.

구글이 Nano-Banana 2를 공개했다. 이 모델은 고급 주제 일관성과 초당 하위 4K 이미지 합성 성능을 특징으로 한다. 기술적으로는 Gemini 3.1 Flash Image로 지칭되며, 장치 내에서 완전히 유지되는 고품질 하위 초 이미지 합성을 지향한다.

Nous Research 팀이 Hermes Agent를 공개하여 AI의 망각 문제를 해결하기 위해 디자인된 오픈소스 자율 시스템을 출시했습니다. 현재의 AI 환경에서 우리는 ‘일시적 에이전트’에 익숙해졌는데, 이는 매 채팅 세션마다 인지 클락을 재시작하는 잊어버리기 쉬운 조수입니다. LLMs는 뛌륭한 코더가 되었지만, 진정한 팀원으로 기능하는 데 필요한 지속적인 상태가 부족합니다.

Tailscale과 LM Studio가 LM Link를 소개했다. 이는 개인 GPU 하드웨어 자산에 암호화된 포인트 투 포인트 액세스를 제공하며, AI 개발자들에게 생산성을 높여준다.

이 튜토리얼에서는 현대 RAG 시스템이 임베딩을 분산 스토리지 노드에 샤딩하는 방식을 반영하는 탄성 벡터 데이터베이스 시뮬레이터를 구축한다. 시스템이 확장될수록 균형 잡힌 배치와 최소한의 재배치를 보장하기 위해 가상 노드로 일관된 해싱을 구현한다. 해싱 링을 실시간으로 시각화하고 노드를 대화식으로 추가하거나 제거한다.

최근 ETH 취리히 연구에서, AI의 ‘Context Engineering’이 중요한데 AGENTS.md 파일이 너무 상세해서 코딩 에이전트가 실패하는 것으로 밝혀졌다. 산업 리더들은 AGENTS.md를 코딩 에이전트의 최종 설정 지점으로 손꼽았는데, 이 파일이 복잡한 코드베이스를 안내하는데 있어 중요한 역할을 한다.

Liquid AI 팀이 발표한 LFM2-24B-A2B는 24억 개의 파라미터를 가진 모델로, 전력 소비 및 메모리 병목 현상의 한계에 부딪히는 산업에서, 파라미터 수보다 아키텍처 효율성에 대한 대화로 전환되고 있다.

Meta AI 연구팀이 GCM을 오픈 소스로 공개하여, 고성능 AI 훈련 및 하드웨어 신뢰성을 보장하기 위해 GPU 클러스터 모니터링을 개선하고 있다. AI 모델이 조파라미터로 확장됨에 따라, 이를 훈련하는 데 필요한 클러스터는 행성상에서 가장 복잡하고 취약한 기계 중 하나로 변화하고 있다.

이 튜토리얼에서는 asyncio를 사용하여 Practical Byzantine Fault Tolerance (PBFT) 시뮬레이터를 구현한다. 비동기 메시지 패싱, 구성 가능한 지연 및 프로토콜에서 의도적으로 벗어나는 바이잔틴 노드를 모델링하여 PBFT가 적대적 상황에서 합의를 달성하는 방법을 탐색한다.

알리바바의 Qwen 3.5 중간 모델 시리즈 출시는 대규모 언어 모델의 발전이 초기에는 성능 향상을 이끌었지만, 이로 인해 상당한 인프라 부담과 한계적인 이득이 도입되었음을 신호한다. 작은 AI 모델이 더 똑똑하다는 점을 강조하며 Qwen 접근 방식의 변화를 시사한다.

구글 딥마인드 연구팀은 MARL 분야에서 진보를 위해 직관에 의존했던 기존의 방식을 변화시켜, CFR 및 PSRO와 같은 알고리즘을 수동으로 개선하는 대신 의미론적 진화를 적용하여 우수한 알고리즘 수렴을 이룩했다.

최근의 언어 모델은 대규모 문맥 창으로 한 번에 처리할 수 있는 정보량을 크게 증가시켰다. 수십만 개 또는 수백만 개의 토큰을 처리할 수 있는 모델들이 등장함에 따라 검색 보완 생성(RAG)은 더 이상 필요하지 않다고 가정하기 쉽지만, 선택적 검색이 모든 데이터를 프롬프트에 넣는 것보다 더 효율적이고 신뢰할 수 있다.

최근 AI 세계는 대형 언어 모델(LLM)이 더 어려운 문제를 해결하려면 그 사고 체인(Chain-of-Thought, CoT)을 더 길게 만들어야 한다는 간단한 규칙을 따라왔다. 그러나 버지니아 대학교와 구글의 새로운 연구는 ‘긴 생각’은 ‘열심히 생각’하는 것과 같지 않음을 입증했다.

최신 LangChain 에이전트 API를 사용하여 물류 디스패치 센터를 위한 생산 스타일의 경로 최적화 에이전트를 구축하는 튜토리얼. 에이전트가 추측하는 대신 거리, 도착 예정 시간 및 최적 경로를 신뢰성 있게 계산하고 결과를 구조화하여 하류 시스템에서 직접 사용할 수 있게 함.

오픈소스 프로젝트인 OpenPlanter는 개인들에게 데이터 추적 권한을 돌려주는 노력으로, 개발자 ‘Shin Megami Boson’이 만들었으며 재귀 언어 모델 조사 에이전트입니다. 사용자들의 마이크로 감시 요구를 지원하는 것이 목표입니다.

Diffusers 라이브러리를 사용하여 실용적인 이미지 생성 워크플로우를 설계하고, 안정적인 환경을 구축한 후 최적화된 스케줄러를 사용하여 텍스트 프롬프트에서 고품질 이미지를 생성합니다. LoRA 기반 잠재 일관성 접근을 통해 추론을 가속화하고, 엣지 조건부 하에서 ControlNet으로 합성을 안내하며, 마지막으로 지역적인 편집을 수행합니다.

본 튜토리얼에서는 간단한 채팅 상호작용을 넘어 다단계 연구 문제를 해결하는 “스위스 아미 나이프” 연구 에이전트를 구축한다. 최신 기술을 활용하여 모던 에이전트가 추론, 확인 및 보고서 작성을 어떻게 수행하는지 보여준다.

NVIDIA가 DreamDojo를 발표했다. 이는 44,711시간의 실제 인간 비디오 데이터로 훈련된 오픈소스 로봇 월드 모델로, 기존의 물리 엔진 대신 픽셀에서 직접 로봇 행동의 결과를 ‘꿈꾼다’.

NVIDIA가 Dynamo v0.9.0을 출시했다. 이 업데이트는 대규모 모델의 배포와 관리를 간소화하고 GPU가 다중 모달 데이터를 처리하는 방식을 개선했다. 이번 릴리스에서는 NATS와 etcd와 같은 무거운 종속성을 제거하고 있다.

이 튜토리얼에서는 모든 결정을 추적 가능하고 감사 가능하며 인간 승인에 의해 명시적으로 통제되는 유리 상자 형태의 에이전트 워크플로우를 구축합니다. LangGraph의 인터럽트 주도형 인간-루프 제어와 해시 체인 데이터베이스를 결합하여 고위험 작업에 대한 동적 권한 부여를 강제로 시행합니다.

구글은 Gemini 3.1 Pro를 공식 출시했는데, 이는 ‘에이전틱’ AI 시장을 겨냥한 것으로, 추론 안정성, 소프트웨어 엔지니어링, 도구 신뢰성에 초점을 맞춰 개발자들을 위한 업데이트다.

이 튜토리얼에서는 PydanticAI를 사용하여 신뢰성을 우선시하는 프로덕션 준비 워크플로우를 구축한다. 엄격하고 유형화된 출력을 강제하여 각 단계에서 명확한 응답 스키마를 정의하고 의존성 주입을 통해 도구를 연결하며, 에이전트가 데이터베이스와 같은 외부 시스템과 안전하게 상호작용할 수 있도록 한다.

Zyphra가 EEG 신호에 특화된 380M 파라미터 foundation 모델인 ZUNA를 공개했다. ZUNA는 채널 인필링과 초해상도를 수행하는 마스크된 확산 오토인코더로, Apache-2.0 라이선스 하에 가중치가 포함되어 있다.

이 튜토리얼에서는 ColPali를 사용하여 엔드 투 엔드 시각 문서 검색 파이프라인을 구축한다. PDF 페이지를 이미지로 렌더링하고 ColPali의 다중 벡터 표현을 사용하여 페이지를 임베드하며, 늦은 상호작용 스코어링을 활용하여 가장 관련성 높은 페이지를 검색한다.

Tavus는 Phoenix-4를 출시하여 인공적인 비디오의 최종 영역인 ‘거친 계곡’을 개선하려고 합니다. Phoenix-4는 인간 상호 작용의 영혼을 부족한 AI 아바타를 보완하기 위해 설계된 새로운 생성 AI 모델입니다.

구글 딥마인드가 음악 분야에서도 창의적 AI의 한계를 넓혔다. Lyria 3은 사진과 텍스트를 이용해 사용자 맞춤 트랙을 생성하는 고급 음악 생성 모델로, 복잡한 오디오 파형과 창의적 의도를 다루는데 큰 전환점을 제공한다.