로우코드 및 노코드 AI 플랫폼은 프롬프트를 사용해 작동하는 앱, 에이전트 또는 모델로 변환합니다. 이 가이드는 21개의 도구를 비교하며, 각 도구의 공식 사이트 링크도 포함되어 있습니다.

최신뉴스 전체보기

UIUC와 Chroma가 개발한 Harness-1은 20억 매개변수로 구성된 검색 서브 에이전트로, 강화 학습을 통해 훈련되었습니다. 이 시스템은 검색과 검증을 효율적으로 관리합니다.

구글이 Colab CLI를 출시하여 개발자와 AI 에이전트가 로컬 코드를 원격 Colab GPU 및 TPU 환경에서 실행할 수 있게 되었습니다.

문샷 AI가 TypeScript로 작성된 오픈소스 터미널 코딩 에이전트 Kimi Code CLI를 출시했습니다. 이 에이전트는 서브 에이전트와 MCP 구성 기능을 갖추고 있습니다.

구글 딥마인드가 젬마 4의 QAT 체크포인트 Q4_0과 새로운 모바일 포맷을 발표했습니다. 이 포맷은 장치 메모리를 절약할 수 있는 특징이 있습니다.

NVIDIA가 CRIU 및 cuda-checkpoint 도구를 사용하여 Kubernetes에서 vLLM 추론 작업자를 체크포인트하고 복원하는 ‘다이나모 스냅샷’을 발표했습니다.

퍼플렉시티 AI가 개인용 컴퓨터를 위한 하이브리드 로컬-서버 추론 오케스트레이터를 발표했다. 이 시스템은 AI 작업을 자동으로 온디바이스와 클라우드 모델 간에 라우팅한다.

NVIDIA가 550B의 오픈 Mixture-of-Experts 하이브리드 모델인 Nemotron 3 Ultra를 출시했습니다. 이 모델은 1M 토큰 컨텍스트를 지원하며, 유사한 LLM보다 최대 6배 높은 추론 처리량을 자랑합니다.

스탠포드 연구진이 개인 AI 시스템을 위한 오픈소스 프레임워크 OpenJarvis를 공개했습니다. 이 프레임워크는 모든 기능을 기기 내에서 수행하며, 클라우드 모델보다 훨씬 저렴한 비용으로 운영됩니다.

Nous Research가 Hermes Agent v0.15.2를 위한 크로스 플랫폼 GUI인 Hermes Desktop을 출시했습니다. 이 소프트웨어는 단일 에이전트 코어와 메모리를 공유합니다.

NVIDIA가 물리적 AI를 위한 자율 회귀 VLM 추론기와 확산 생성기를 결합한 오픈 옴니모달 세계 모델인 Cosmos 3를 출시했다.

타이니피시가 ‘빅셋’이라는 오픈소스 다중 에이전트 시스템을 출시했습니다. 사용자가 데이터셋을 한 문장으로 설명하면, 빅셋의 조정자와 하위 에이전트가 실시간 웹을 검색해 구조화된 테이블을 반환합니다.

알리바바의 Qwen 팀이 Bailian 플랫폼에서 Qwen3.7-Plus를 출시했습니다. 이 모델은 이미지와 비디오를 이해하며, 자가 프로그래밍 및 도구 호출 기능을 추가했습니다.

JetBrains가 AI 워크플로우를 위해 10.6조 개의 토큰으로 훈련된 12B MoE 모델인 Mellum2를 Apache 2.0 라이선스 하에 출시했다.

MiniMax가 새로운 M3 모델을 출시했습니다. 이 모델은 1M-토큰 컨텍스트 창과 함께 이미지, 비디오, 컴퓨터 사용을 지원하는 기능을 갖추고 있습니다.

메모리 OS는 헬메스 에이전트 위에 구축된 6계층의 오픈소스 프로젝트로, 로컬 지속 메모리를 추가하고 게이트드 검색 및 위키 기능을 제공합니다.

파랄락스는 LLA의 쿼리별 솔버를 학습된 프로젝터로 대체하여 산술 강도를 두 배로 늘리고, 0.6B 및 1.7B에서 혼란도를 개선합니다.

Trajectory가 UC 버클리 스카이랩 및 Anyscale과 협력하여 지속 학습을 위한 동시 다중 LoRA 훈련 스택을 개발했습니다. 이 시스템은 각 RL 실험을 전용 LoRA 어댑터에 매핑하여 실험 처리량을 2.81배 향상시켰습니다.

제네시스 AI가 2026년 5월 27일 물리, 렌더링, 컴파일, 도구를 포함한 시뮬레이션 플랫폼 ‘제네시스 월드 1.0’을 출시했습니다. 이 시스템은 시뮬레이션과 실제 로봇 성능 간의 상관관계를 0.8996으로 달성했습니다.

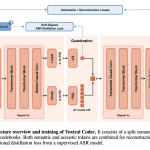

헤르메스 에이전트가 MCP의 컨텍스트 부풀림 문제를 해결하기 위해 툴 검색 기능을 추가했습니다. 이 기능은 BM25 점진적 스키마 공개를 활용하여 정확도를 49%에서 74%까지 향상시킵니다.

NVIDIA가 X-Token을 발표하며 GOLD의 두 가지 구조적 문제를 해결하고 GSM8k 정확도를 2.56에서 15.54로 향상시켰습니다.

StepFun이 198B MoE 모델인 Step 3.7 Flash를 출시했습니다. 이 모델은 네이티브 비전 기능과 256k 컨텍스트, 어드바이저 모드를 지원합니다.

UC 버클리의 UCCL 팀이 다중 GPU 및 노드를 지원하는 mKernel을 출시했습니다. 이 라이브러리는 NVLink와 RDMA를 통합하여 효율적인 GPU 기반 통신을 가능하게 합니다.

Hexo Labs가 MIT 라이센스 하에 자가 개선 루프인 SIA를 오픈소스로 공개했습니다. 이 에이전트는 각 실행의 경로를 읽고, 구조를 재작성하거나 LoRA 가중치를 업데이트합니다.

Liquid AI가 8.3B 매개변수 중 1.5B를 활성화한 LFM2.5-8B-A1B 모델을 출시했습니다. 이 모델은 소비자 하드웨어에서 128K의 컨텍스트, 추론 및 도구 호출 기능을 제공합니다.

앤트로픽이 클로드 오퍼스 4.8을 출시하며 동적 워크플로우와 저렴한 빠른 모드를 도입했습니다. 현재 연구 미리보기 단계에 있습니다.

Perplexity AI가 재작성한 유니그램 토크나이저를 오픈 소스로 공개했습니다. 이 토크나이저는 재랭커의 지연 시간을 줄이고 CPU 사용량을 5-6배 감소시킵니다.

사카나 AI가 제안한 DiffusionBlocks는 잔여 네트워크를 독립적으로 학습할 수 있는 블록으로 변환하는 훈련 프레임워크입니다. 이 방법은 레이어 업데이트를 역 확산 잡음 제거 단계로 해석합니다.

NVIDIA가 언어 에이전트를 훈련하기 위한 새로운 롤아웃 프레임워크 ‘Polar’를 발표했습니다. 이 프레임워크는 에이전트 하네스를 수정하지 않고도 강화 학습을 통해 훈련할 수 있도록 설계되었습니다.

EAGLE 팀과 vLLM, TorchSpec이 협력하여 EAGLE 3.1을 출시했습니다. 이 알고리즘은 생산 환경에서 발생하는 추측적 디코딩의 불안정성을 해결합니다.

NUS, MIT, A*STAR의 연구진이 LLM 파라미터를 수정하지 않고 새로운 지식을 훈련할 수 있는 MEMO라는 모듈형 프레임워크를 제안했다.

D-Wave Quantum Inc.가 최근 Flatiron Institute의 주장에 대해 반박하며, 자사의 초월적 양자 컴퓨터 시뮬레이션 이정표를 재확인했습니다. 이들은 고전적인 작업이 양자 어닐링 상태 계산을 복제할 수 있다는 주장에 대응했습니다.

Together AI가 OSCAR(오프라인 스펙트럴 공분산 인식 회전)를 공개했습니다. 이 시스템은 긴 문맥의 LLM 서비스를 위한 INT2 KV 캐시 양자화 방법으로, 메모리 사용량을 약 8배 줄이고 디코드 속도를 최대 3배 향상시킵니다.

2026년, AI 에이전트와 MCP 서버의 인증이 중요한 인프라 결정으로 떠오르고 있다. 이 가이드는 WorkOS, Stytch, Auth0, Composio 등 8개 주요 플랫폼을 평가한다.

WorkOS가 AI 에이전트 등록을 위한 새로운 프로토콜 auth.md를 발표했습니다. 이 프로토콜은 웹 애플리케이션이 AI 에이전트의 등록 흐름과 요청할 범위를 안내하는 Markdown 파일을 제공하도록 합니다.

마이크로소프트 리서치가 클릭 추적 웹 자동화를 대체하는 터미널 기반 브라우저 에이전트 프레임워크 ‘웹라이트’를 발표했다. 이 프레임워크는 GPT-5.4를 기반으로 하여 Odysseys 벤치마크에서 60.1%의 점수를 기록했다.

NVIDIA가 Gated DeltaNet-2를 발표했습니다. 이 모델은 델타 규칙에서 기존의 내용을 지우고 새로운 내용을 쓰는 과정을 분리하여 성능을 향상시킵니다. 1.3B 파라미터로 100B FineWeb-Edu 토큰에서 훈련되어 여러 언어 모델링 작업에서 우수한 성과를 보였습니다.

텐센트가 MIT 라이선스 하에 AI 에이전트를 위한 로컬 메모리 시스템인 ‘TencentDB Agent Memory’를 오픈소스로 공개했다. 이 시스템은 4단계의 장기 메모리 구조를 갖추고 있으며, 성능 개선이 보고되었다.

Nous Research가 LLM 행동을 조정하기 위한 새로운 방법인 Contrastive Neuron Attribution(CNA)을 발표했습니다. 이 방법은 희소 MLP 뉴런 회로를 식별하고 제거하는 방식으로, SAE 훈련이나 가중치 수정 없이도 가능합니다.

퍼플렉시티가 자사의 검색 제품인 코멧과 컴퓨터의 개발자 시스템을 보호하기 위해 사용하는 내부 보안 도구 ‘범블비’를 오픈소스로 공개했습니다. 이 도구는 macOS와 Linux 개발자 엔드포인트를 위한 읽기 전용 재고 수집기입니다.

마이크로소프트 리서치가 Fara1.5를 출시했습니다. 이 에이전트는 4B, 9B, 27B 크기로 제공되며, Fara1.5-27B는 Online-Mind2Web에서 72%의 성과를 기록했습니다.

자나두 퀀텀 테크놀로지스가 나스닥과 TSX에 상장하며, 양자 읽기 전용 메모리(QROM) 모듈의 알고리즘 최적화를 발표했다. 이 최적화는 비클리포드 연산 오버헤드를 절반으로 줄인다.

CopilotKit의 2026년 배송 주기를 살펴보며, 새로운 AG-UI 프로토콜, AIMock 테스트 스위트, Pathfinder 서버가 에이전틱 AI를 위한 생산 아키텍처를 어떻게 제공하는지 알아봅니다.

알리바바의 Qwen 팀이 2026 알리바바 클라우드 서밋에서 Qwen3.7-Max를 발표했습니다. 이 모델은 100만 토큰의 컨텍스트 윈도우와 확장된 사고 모드를 특징으로 하며, 코딩 및 디버깅 등 장기 작업에 최적화되어 있습니다.

Cohere가 Command A+를 출시했습니다. 이 모델은 218B 스파스 혼합 전문가 모델로, 이전의 네 가지 Command A 변형을 통합한 것입니다. 두 대의 H100 GPU에서 작동하며, 48개 언어를 지원합니다.

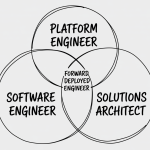

오픈AI가 40억 달러 규모의 배포 회사를 출범하고, 앤트로픽이 블랙스톤 및 골드만삭스와 15억 달러 규모의 합작 투자를 체결했습니다. 이들은 포워드 배치 엔지니어 모델을 중심으로 구축되었습니다.

Turbovec는 구글 리서치의 TurboQuant 알고리즘을 활용하여 벡터 검색을 지원하며, 16배 압축과 코드북 훈련이 필요 없는 RAG 파이프라인을 제공합니다.

NVIDIA가 3가지 디코딩 모드를 통합한 언어 모델 ‘Nemotron-Labs-Diffusion’을 출시했습니다. 이 모델은 3B, 8B, 14B 파라미터 크기로 제공되며, 자율 회귀, 확산 기반 병렬 디코딩, 자기 추측 디코딩을 지원합니다.

알리바바의 Qwen 팀이 Qwen3.5-LiveTranslate-Flash를 출시했습니다. 이 모델은 60개 언어를 지원하며, 2.8초의 지연 시간으로 오디오와 비디오를 동시에 처리합니다.

구글이 I/O 2026에서 Gemini 3.5 Flash를 공개했습니다. 이 모델은 기존 플래그십 모델보다 코딩 및 에이전트 성능에서 우수하며, 속도는 4배 빠르고 비용은 절반으로 줄였습니다.

Upstash, Supabase, Neon은 각기 다른 데이터베이스 플랫폼으로, 2026년의 코딩 워크플로우에 적합한 선택을 비교합니다.

구글이 I/O 2026 개발자 키노트에서 AI 지원 개발 방식을 혁신하는 ‘안티그래비티 2.0’을 발표했다. 이 플랫폼은 에이전트 오케스트레이션을 중심으로 구성된 독립형 데스크톱 애플리케이션이다.

2026년 기업용 에이전틱 AI가 파일럿 단계를 넘어 실제 운영에 들어갔습니다. 이 가이드는 Salesforce Agentforce, Microsoft Copilot Studio 등 10대 플랫폼을 가격과 도입 데이터를 기반으로 평가합니다.

MemTensor, HONOR Device, 그리고 동지대학교의 연구팀이 사용자 데이터를 보호하면서도 메모리 유용성을 유지하는 MemPrivacy 프레임워크를 발표했습니다.

NVIDIA가 NVFP4 마이크로 스케일링 포맷을 기반으로 한 4비트 사전 훈련 방법론을 소개했습니다. 이 방법론은 12B 하이브리드 맘바-트랜스포머에서 10조 개의 토큰으로 검증되었습니다.

Vercel Labs가 AI 에이전트가 인간의 해석 없이도 네이티브 프로그램을 읽고 수정하며 배포할 수 있도록 설계된 시스템 프로그래밍 언어 ‘제로’를 발표했다.

Nous Research가 발표한 라이트하우스 어텐션은 선택 기반의 계층적 어텐션 메커니즘으로, 프리트레인 중에만 사용되며, 기존의 방법보다 1.4~1.7배 빠른 속도를 자랑합니다.

BerriAI가 개발한 LiteLLM 에이전트 플랫폼은 AI 에이전트를 안정적으로 운영할 수 있는 솔루션으로, 격리된 환경에서의 세션 관리 기능을 제공합니다.

NVIDIA가 SANA-WM을 소개했습니다. 이 오픈소스 모델은 60초 길이의 720p 비디오를 생성하며, 6자유도 카메라 제어를 지원합니다. 64개의 H100 GPU로 훈련되었고, 단일 RTX 5090에서 배포 가능합니다.

Zyphra가 자가 회귀 LLM에서 변환된 최초의 MoE 확산 모델 ZAYA1-8B-Diffusion-Preview를 발표했다. 이 모델은 최대 7.7배의 추론 속도 향상을 보여준다.

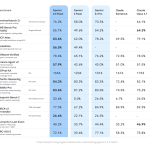

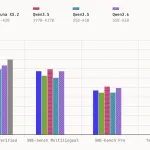

2026년 AI 코딩 에이전트 분야는 더욱 발전하고 복잡해졌습니다. Claude Code는 코드 품질에서 87.6%로 선두를 달리고 있으며, GPT-5.5는 82.7%로 뒤를 잇고 있습니다. 그러나 OpenAI가 오염된 것으로 선언한 벤치마크가 여전히 사용되고 있습니다.

Poetiq의 메타 시스템이 Gemini 3.1 Pro를 사용해 LiveCodeBench Pro를 위한 모델 비의존적 추론 하네스를 자동으로 구축하고 최적화했습니다. 이 하네스는 다른 모델에도 적용되어 모두 성능이 향상되었습니다.

Cline이 내부 에이전트 하니스를 오픈 소스 TypeScript SDK인 @cline/sdk로 분리하여 출시했습니다. 이 SDK는 CLI와 칸반을 지원하며, VS Code와 JetBrains 확장도 이전 중입니다.

Nous Research가 LLM 사전 훈련 시간을 최대 2.5배 단축할 수 있는 토큰 슈퍼포지션 트레이닝(TST) 방법을 발표했다. 이 방법은 모델 아키텍처를 변경하지 않고도 훈련 효율성을 높인다.

패스티노 랩스가 3억 개 파라미터를 가진 오픈 소스 안전 모더레이션 모델 GLiGuard를 공개했습니다. 이 모델은 네 가지 안전 작업을 단일 처리로 수행하며, 기존 모델보다 높은 처리량과 낮은 지연 시간을 자랑합니다.

틸드 리서치가 신경망 훈련을 위한 새로운 최적화기 오로라를 발표했다. 이 최적화기는 널리 사용되는 뮤온 최적화기의 구조적 결함을 해결하며, 훈련 중 상당수의 MLP 뉴런이 영구적으로 사망하는 문제를 다룬다.

메타 FAIR와 스탠포드 대학의 연구진이 서브워드 토큰화 없이 50% 이상의 메모리 대역폭 비용을 줄이는 세 가지 추론 방법을 제안했습니다.

사카나 AI와 NVIDIA 연구팀이 L1 정규화를 통해 피드포워드 레이어에서 99% 이상의 희소성을 달성하고, 새로운 희소 데이터 형식과 융합된 CUDA 커널을 활용해 GPU 처리 성능을 향상시켰다고 발표했다.

벡터 데이터베이스는 RAG 및 에이전틱 AI의 핵심 검색 인프라로 자리잡고 있습니다. 이 가이드는 아키텍처, 가격, 확장성 측면에서 9개의 주요 시스템을 비교합니다.

NVIDIA의 NVlabs가 Rust로 작성된 GPU 커널을 PTX로 변환하는 실험적 컴파일러인 cuda-oxide v0.1.0을 출시했다. 이 컴파일러는 단일 명령어로 호스트와 장치 코드를 동시에 컴파일할 수 있다.

NVIDIA가 Star Elastic을 발표했습니다. 이 방법은 30B, 23B, 12B 파라미터 규모의 여러 추론 모델을 하나의 체크포인트에 통합하여 훈련 효율성을 높입니다.

GitHub가 AI 코딩 에이전트를 위한 새로운 오픈 소스 툴킷 ‘Spec-Kit’을 발표했습니다. 이 툴킷은 명세 기반 개발을 지원하며, AI 코딩 에이전트의 한계를 극복하는 데 도움을 줄 것으로 기대됩니다.

OpenAI가 Codex의 Chrome 확장 프로그램을 출시하여 AI 에이전트가 LinkedIn, Salesforce, Gmail 등 다양한 웹사이트에 접근할 수 있게 되었습니다.

라이트시크 재단이 에이전틱 코딩 시스템의 성능을 높이기 위해 오픈소스 LLM 추론 엔진 ‘토큰스피드’를 발표했다. 이 엔진은 TensorRT-LLM 수준의 성능을 목표로 하고 있다.

메타 AI 팀이 NeuroAI 모델을 벤치마킹하기 위한 오픈소스 프레임워크 NeuralBench를 출시했습니다. 이 프레임워크는 36개의 EEG 작업과 94개의 데이터셋을 포함하며, 9,478명의 피험자와 13,603시간의 뇌 기록을 기반으로 합니다.

OpenAI가 AMD, 브로드컴, 인텔, 마이크로소프트, NVIDIA와 협력하여 MRC(다중 경로 신뢰 연결)라는 새로운 오픈 네트워킹 프로토콜을 개발했습니다. 이 프로토콜은 대규모 AI 훈련 클러스터의 GPU 네트워킹 성능과 복원력을 향상시킵니다.

Zyphra가 760M의 활성 파라미터를 가진 추론 Mixture of Experts 모델 ZAYA1-8B를 출시했다. 이 모델은 수학 및 코딩 벤치마크에서 기존의 대형 모델들을 능가하며, 새로운 지능 밀도를 제시하고 있다.

CopilotKit Intelligence는 오픈소스 CopilotKit 스택 위에 관리되는 지속성 레이어를 추가하여 에이전트가 컨텍스트와 상태, 상호작용 기록을 유지할 수 있도록 지원합니다.

구글이 Gemma 4 패밀리를 위한 다중 토큰 예측(MTP) 드래프터를 발표하며, 품질 손실 없이 최대 3배 빠른 추론 속도를 달성했다고 밝혔다.

Mistral의 Voxtral TTS는 기존 음성 합성 시스템의 한계를 극복하고 감정과 리듬을 살린 자연스러운 음성을 제공하는 혁신적인 기술입니다.

Zyphra가 텐서 및 시퀀스 병렬 처리(TSP) 기술을 소개했다. 이 기술은 GPU 축을 따라 파라미터와 활성화 메모리를 줄이는 전략으로, 기존 TP+SP 기준 대비 2.6배의 처리량을 제공한다.

사카나 AI가 실시간으로 LLM 지식을 음성 대화 AI에 주입하는 KAME라는 새로운 아키텍처를 소개했습니다. 이 기술은 지연 없이 음성 간 대화를 가능하게 합니다.

Mistral AI가 새로운 128B 모델과 비동기 클라우드 기반 코딩 세션을 도입하며, 개발자들이 AI 에이전트를 활용할 수 있는 새로운 작업 모드를 제공한다.

이번 튜토리얼에서는 lambda/hermes-agent-reasoning-traces 데이터셋을 활용해 에이전트 기반 모델의 사고 방식과 도구 사용, 다중 대화에서의 응답 생성 과정을 탐구합니다.

NVIDIA 연구팀이 NeMo RL에 추측적 디코딩을 통합하여 8B 모델에서 1.8배의 롤아웃 생성 속도 향상을 달성했다고 발표했다. 235B 모델에서는 2.5배의 속도 향상이 예상된다.

메타가 AI 모델을 자율 데이터 과학자로 변환하는 새로운 프레임워크인 Autodata를 소개했습니다. 이 기술은 고품질 훈련 데이터 생성을 목표로 하고 있습니다.

Qwen 팀이 LLM 내부 기능을 실용적인 개발 도구로 변환하는 오픈소스 스파스 오토인코더(Qwen-Scope) 제품군을 발표했다.

Moonshot AI가 FlashKDA를 오픈소스로 공개했습니다. 이는 Kimi Delta Attention의 고성능 구현으로, 플래시-선형-어텐션 생태계에 직접 연결되며 벤치마크 결과에서 의미 있는 속도 향상을 보여줍니다.

마이크로소프트 리서치가 텍스트-비디오 모델에 3D 일관성을 주입하기 위해 강화 학습을 활용한 World-R1을 발표했다. 이 기술은 구조적 변경 없이도 기하학적 일관성을 확보할 수 있다.

풀사이드 AI가 라구나 XS.2와 M.1을 출시했습니다. 이 두 모델은 장기 과제를 위해 설계된 오픈 웨이트 에이전틱 코딩 모델로, SWE-bench에서 각각 68.2%와 72.5%의 성능을 기록했습니다.

모나크 퀀텀과 오라토믹이 결함 허용 양자 컴퓨터 개발을 가속화하기 위해 전략적 파트너십을 체결했다. 이번 협력은 두 회사의 기술을 통합하여 대규모 양자 컴퓨터 시스템을 구축하는 데 중점을 둔다.

메타 리얼리티 랩스가 포즈 추정, 세분화 및 3D 기하학을 새로운 수준으로 끌어올리는 인간 중심 비전 모델 Sapiens2를 발표했다. 이 모델은 단일 백본으로 다양한 기능을 지원한다.

xAI의 새로운 음성 모델 grok-voice-think-fast-1.0이 소매, 항공사, 통신 분야에서 Gemini와 GPT Realtime을 초과 성능을 보였습니다.

DeepSeek AI가 DeepSeek-V4 시리즈의 미리보기 버전을 출시했습니다. 이 모델은 백만 토큰 컨텍스트를 실용적이고 경제적으로 만드는 데 중점을 두고 개발되었습니다.

OpenAI가 AI 에이전트의 디버깅을 돕기 위한 브라우저 기반 시각화 도구 ‘Euphony’를 오픈 소스로 공개했습니다. 이 도구는 Harmony 채팅 데이터와 Codex 세션 로그를 시각화합니다.

Hugging Face가 대형 언어 모델(LLM)의 후처리 작업을 자동화하는 오픈소스 AI 에이전트 ‘ml-intern’을 출시했다. 이 도구는 문헌 검토, 데이터셋 발견, 훈련 스크립트 실행 등의 작업을 자동으로 수행한다.

OpenAI가 사이버 방어 프로그램의 신뢰할 수 있는 접근 방식을 확대하며, 사이버 보안에 최적화된 GPT-5.4-Cyber 모델을 수천 명의 검증된 방어자에게 제공한다고 발표했다.

문샷 AI와 칭화대 연구진이 대규모 언어 모델(LLM) 서비스 방식을 혁신적으로 변화시킬 PrfaaS 아키텍처를 제안했습니다. 이 아키텍처는 데이터 센터 간의 KVCache 구조를 통해 LLM의 추론 방식을 개선하는 데 중점을 두고 있습니다.

OpenMythos는 Claude Mythos 아키텍처를 이론적으로 재구성한 오픈소스 프로젝트로, PyTorch로 완전히 구축되었습니다. 이 프로젝트는 연구 커뮤니티의 이론을 바탕으로 하고 있습니다.

NVIDIA가 하이브리드 양자-고전 시스템을 위한 첫 번째 오픈 양자 AI 모델인 ‘이징’을 출시했습니다. 이 모델은 양자 컴퓨터와 고전 컴퓨터의 간극을 줄이기 위한 노력의 일환으로 개발되었습니다.