Amazon Bedrock 사용자를 위한 체계적인 평가 방법론 소개. 이론적 프레임워크와 실용적 전략을 결합하여 데이터 과학자와 머신러닝 엔지니어가 최적의 모델 선택을 할 수 있게 함.

Amazon Bedrock 사용자를 위한 체계적인 평가 방법론 소개. 이론적 프레임워크와 실용적 전략을 결합하여 데이터 과학자와 머신러닝 엔지니어가 최적의 모델 선택을 할 수 있게 함.

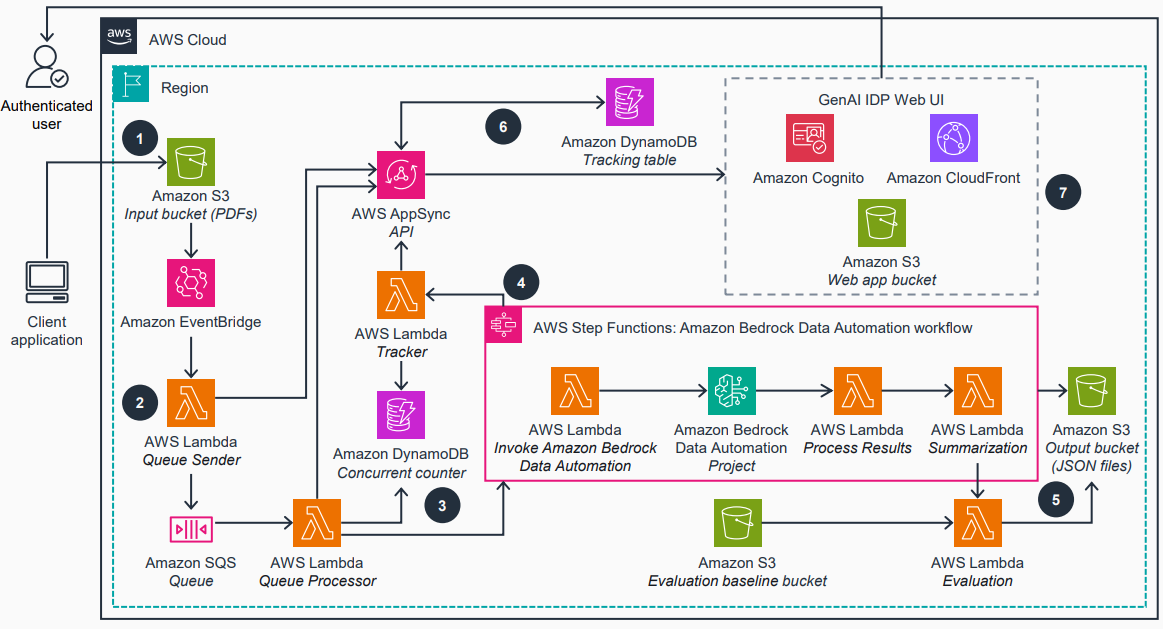

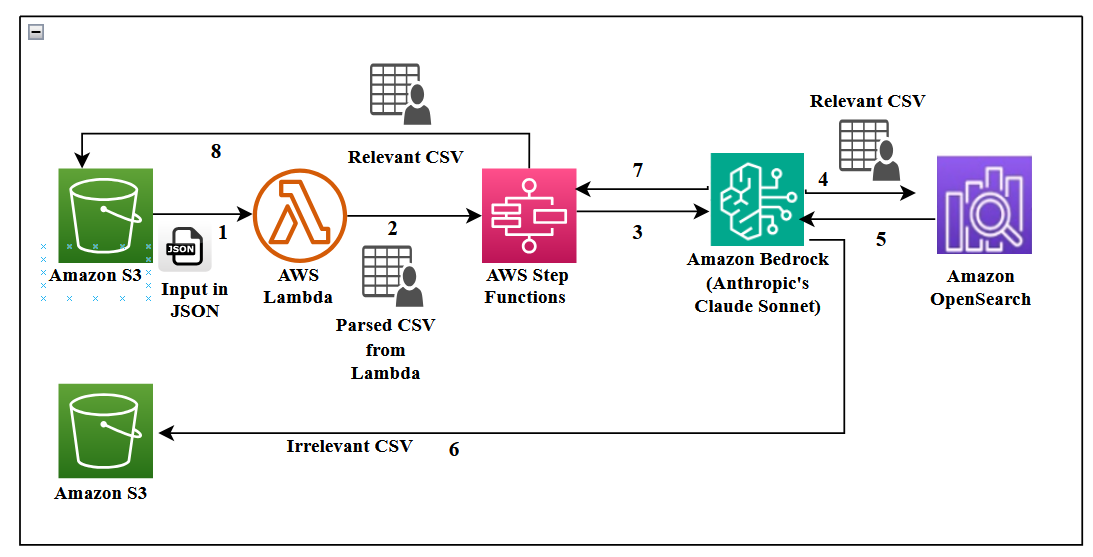

GenAI IDP Accelerator를 활용한 지능형 문서 처리 솔루션을 AWS에서 소개. 자동화된 문서 처리 워크플로우는 문서에서 구조화된 정보를 정확하게 추출하여 수동 작업을 줄임. 이 솔루션을 통해 Generative AI를 활용한 워크플로우를 몇 일 안에 구축할 수 있음.

SageMaker HyperPod의 세 가지 기능 소개. Continuous provisioning으로 유연한 리소스 프로비저닝 제공해 모델 학습 및 배포를 빠르게 시작하고 클러스터를 효율적으로 관리. Custom AMIs로 ML 환경을 조직의 보안 표준과 소프트웨어 요구 사항에 맞게 조정 가능.

아마존 세이지메이커를 사용하여 GPT-OSS 모델을 세밀하게 조정하는 방법에 대한 시리즈 중 두 번째 포스팅이다. 이번 글에서는 오픈 소스 허깅페이스 라이브러리를 이용해 GPT-OSS 모델을 세밀하게 조정하는 방법을 다룬다.

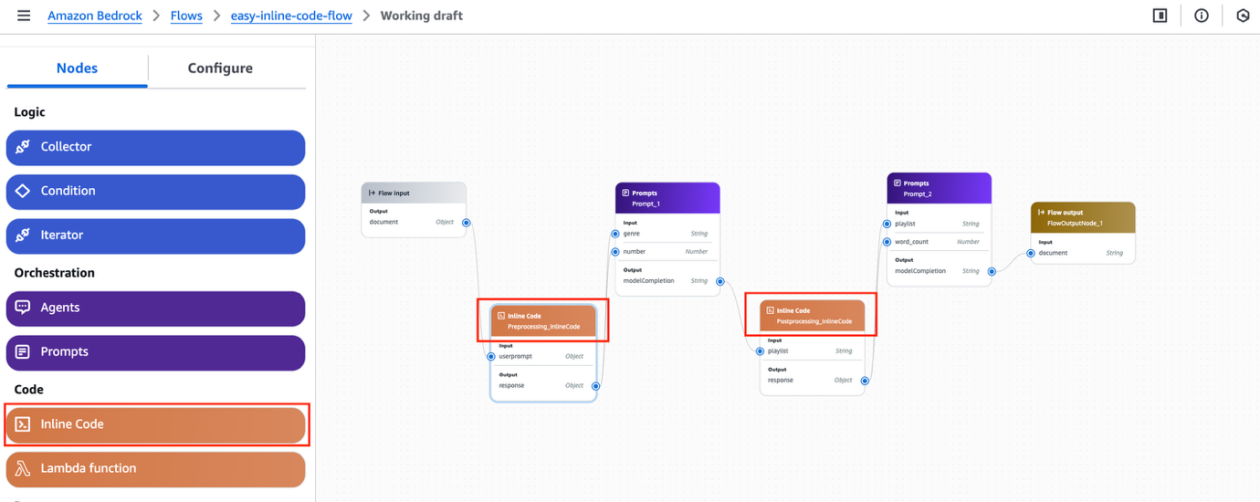

아마존 베드락 플로우의 공개 미리보기로 인라인 코드 노드 지원이 가능해졌습니다. 이 강력한 새로운 기능을 통해 워크플로우 내에서 파이썬 스크립트를 직접 작성할 수 있어 간단한 로직에 대한 별도의 AWS 람다 함수가 필요 없어졌습니다. 이 기능은 데이터 정규화와 응답 서식 지정과 같은 전처리 및 후처리 작업을 간소화하여 창조적 AI 애플리케이션 개발을 단순화하고 조직 전체에서 더 접근성 있게 만듭니다.

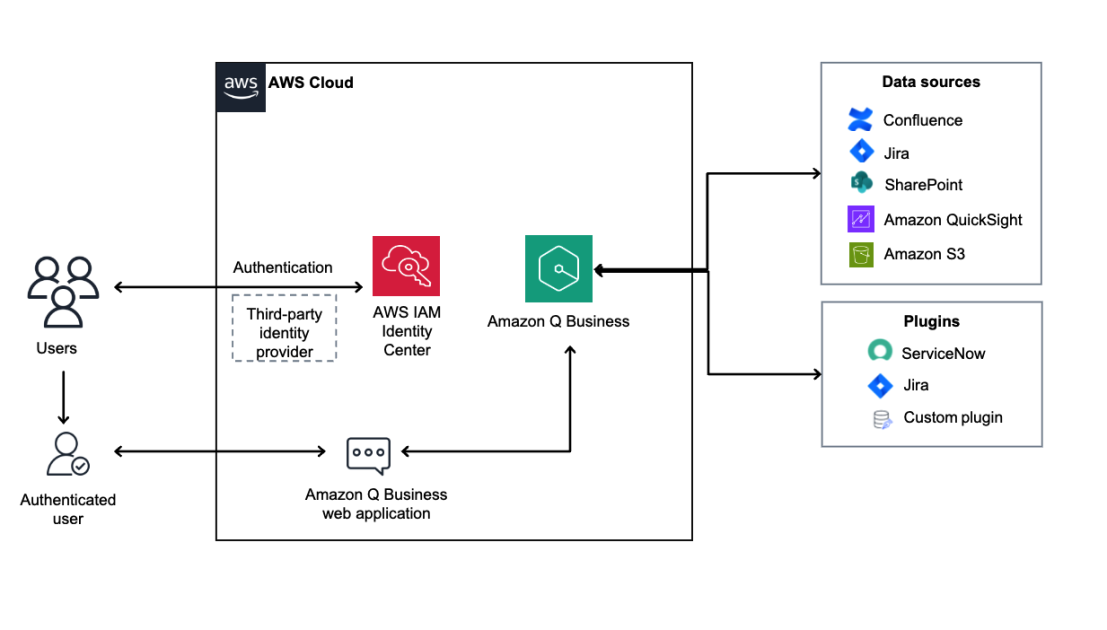

Amazon Q Business는 AWS 고객에게 조직 전반의 업무 프로세스를 향상시키는 확장 가능하고 포괄적인 솔루션을 제공한다. 사용 사례를 신중히 평가하고 구현 모범 사례를 따르며, 이 게시물에서 제공된 아키텍처 지침을 사용함으로써 Amazon Q Business를 배포하여 기업 생산성을 변형할 수 있다. 성공의 열쇠는 작게 시작하고 빠르게 가치를 입증하며, 조직 전반에 체계적으로 확장하는 것에 있다.

새로운 코드 편집기와 다중 공간 지원을 활용하여 SageMaker 통합 스튜디오에서 ML 파이프라인을 개발하는 방법을 안내합니다. 이 샘플 솔루션은 전형적인 ML 활동을 자동화하여 ML 모델을 구축, 훈련, 평가 및 (선택적으로) 배포하는 방법을 보여줍니다.

대규모 에너지 공급업체의 기술 도움데스크 요원들이 고객 전화를 받고 현장 요원을 지원하는 사례를 살펴봅니다. 아마존 베드락과 인포시스 토파즈™ 기능을 활용하여, 콜 처리 시간을 단축하고 작업 자동화, 기술 지원의 전반적인 품질 향상을 이끌어내는 생성적 AI 애플리케이션을 구축합니다.

Amazon Bedrock의 Amazon Nova를 활용하여 구축된 The Fragrance Lab은 소매, 소비재, 광고 및 마케팅 분야에서 생성적 AI의 변혁적인 힘을 보여주는 포괄적인 애플리케이션이다. 이 게시물에서는 The Fragrance Lab의 개발에 대해 살펴보며, 프랑스 리비에라의 영혼을 담아 창의성, 광고, 소비재를 축하하는 독특한 물리적 및 디지털 경험의 조합을 만들었다.

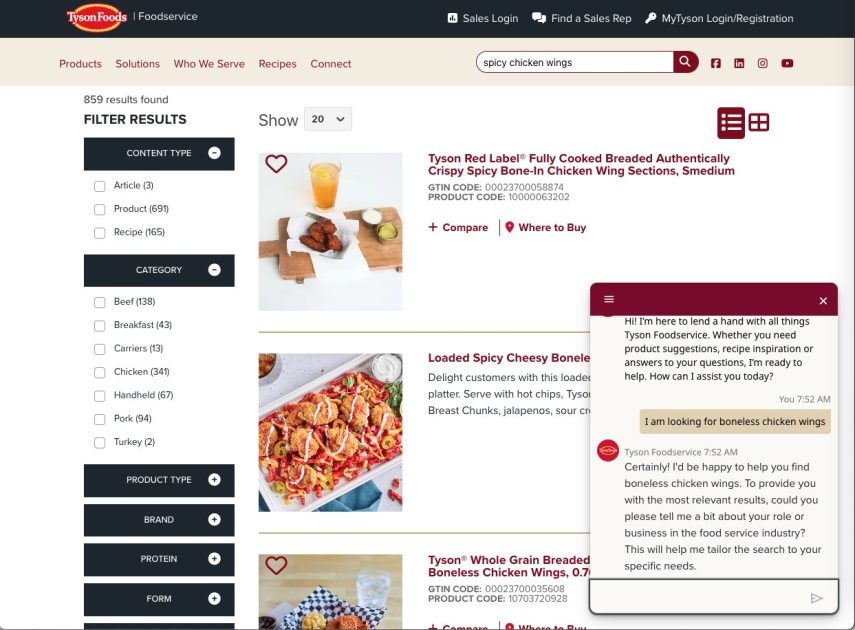

Tyson Foods가 AWS Generative AI Innovation Center와 협력하여 웹사이트에 통합된 직관적인 AI 어시스턴트를 통해 고객 상호작용을 혁신했다. Amazon Bedrock을 사용해 구축된 이 AI 어시스턴트는 고객의 검색 경험을 향상시키고 있다.

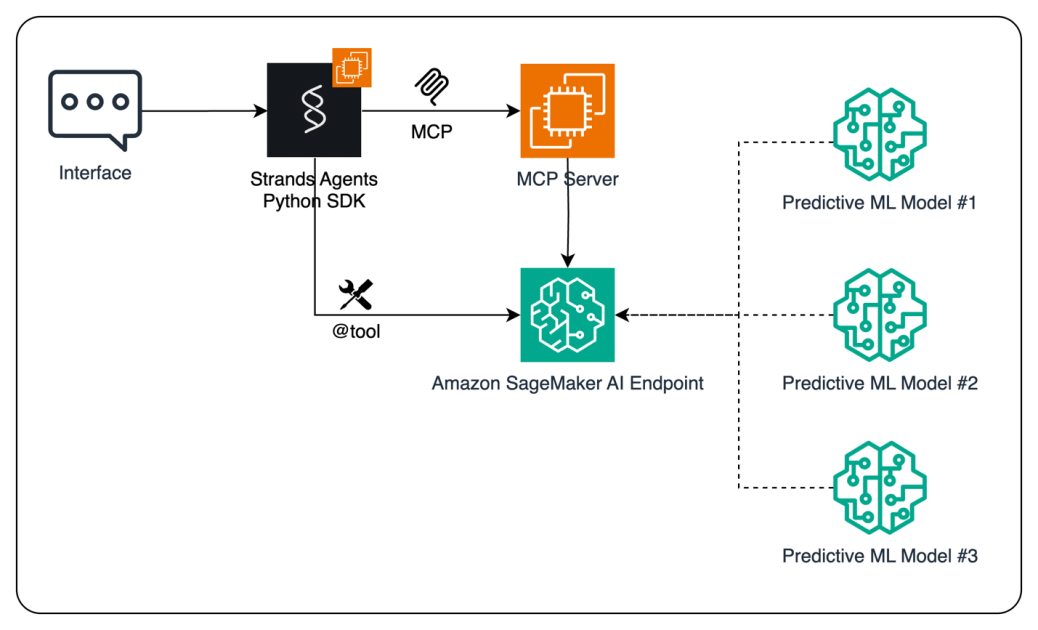

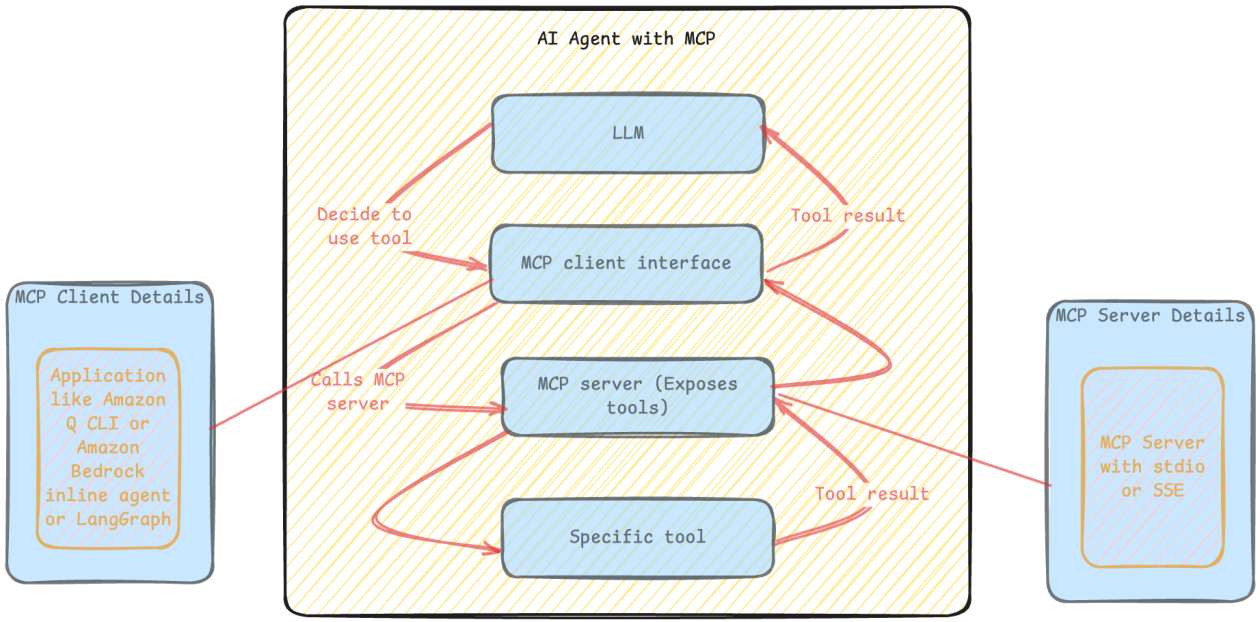

이 포스트에서는 아마존 SageMaker AI와 MCP를 활용하여 예측적 머신러닝 모델을 통합하여 AI 에이전트의 능력을 향상하는 방법을 소개합니다. Strands Agents SDK와 SageMaker AI의 유연한 배포 옵션을 사용하여, 개발자들은 대화형 AI를 강력한 예측 분석 기능과 결합한 고급 AI 애플리케이션을 만들 수 있습니다.

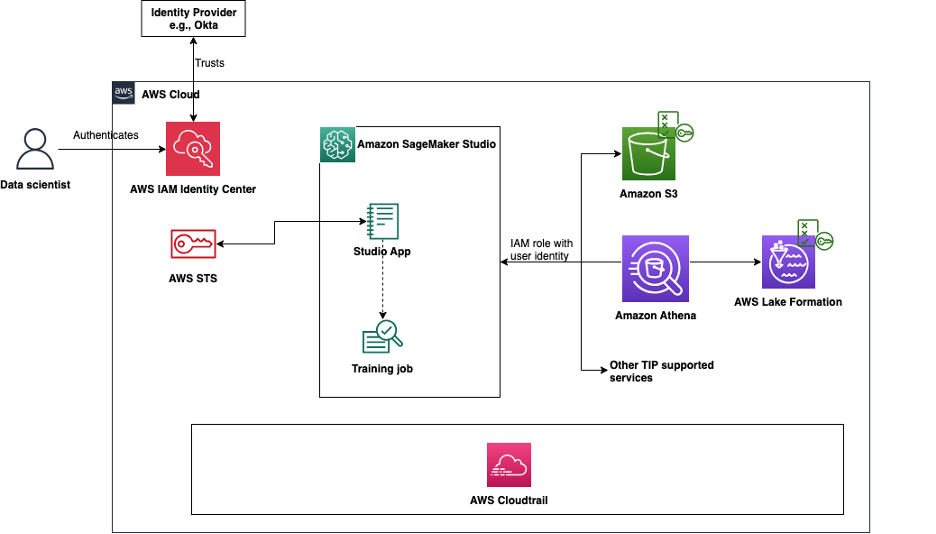

이 블로그 글에서는 Amazon SageMaker Studio에서 신뢰할 수 있는 아이덴티티 전파를 활성화하고 사용하는 방법을 탐구하며, 이를 통해 조직이 기존 AWS IAM Identity Center 신원에 권한을 부여하여 액세스 관리를 간소화할 수 있습니다. 이 솔루션은 사용자의 물리적 신원을 기반으로 세밀한 액세스 제어를 구현하는 방법을 보여주며, 지원되는 AWS 서비스 전체에 걸쳐 자세한 감사 로그를 유지하고 교육 작업에 대한 장기 사용자 백그라운드 세션을 지원합니다.

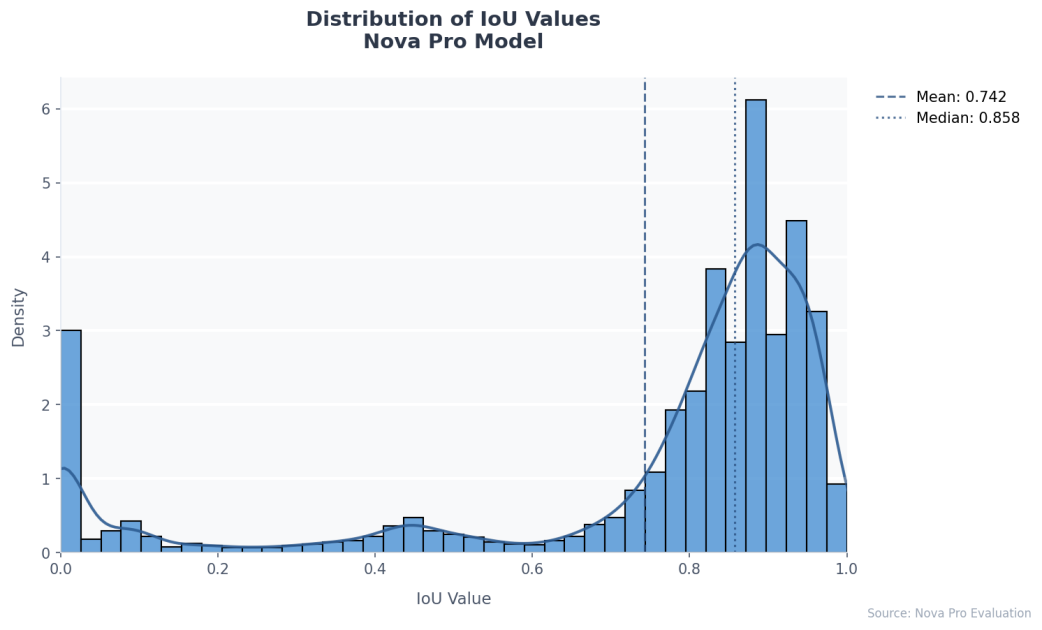

이 게시물은 Amazon Bedrock의 foundation models (FMs) 중 Amazon Nova Pro를 사용하여 높은 정확도의 문서 필드 로컬라이제이션을 실현하는 방법을 보여줍니다. 이러한 모델을 사용하면 프론트엔드 노력을 최소화하면서 문서 필드를 정확하게 찾아내고 해석할 수 있어 처리 오류와 수동 개입을 줄일 수 있습니다.

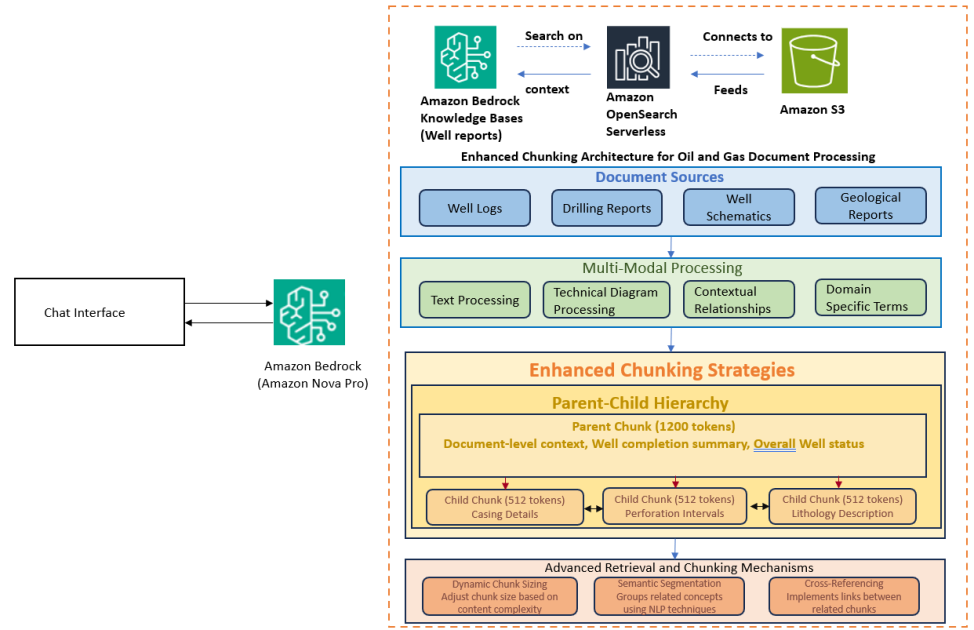

Infosys는 석유 및 가스 부문을 위해 맞춤형 Amazon Bedrock을 활용한 고급 RAG 솔루션을 구축했다. 이 솔루션은 다중 모달 데이터 원본을 처리하며 텍스트, 다이어그램, 숫자 데이터를 매끄럽게 처리하고 다른 데이터 요소 간의 맥락과 관계를 유지한다. 이 글에서는 해당 솔루션에 대한 통찰과 다양한 접근 방식 및 아키텍처 패턴(다른 청킹, 다중 벡터 검색, 개발 중 하이브리드 검색)을 안내한다.

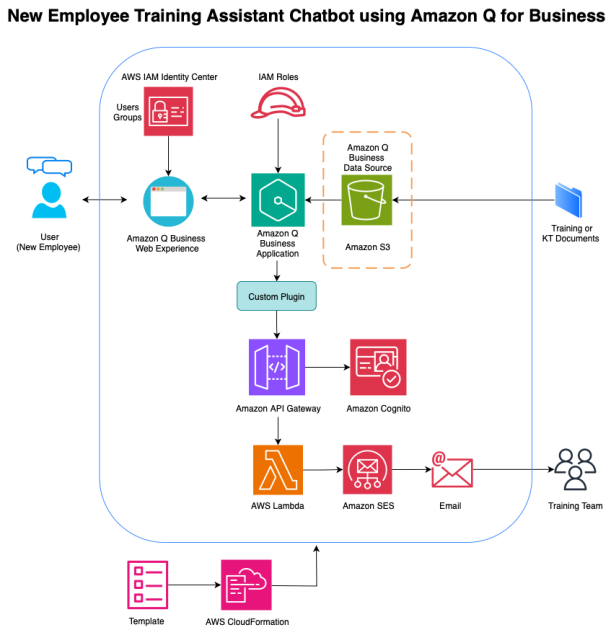

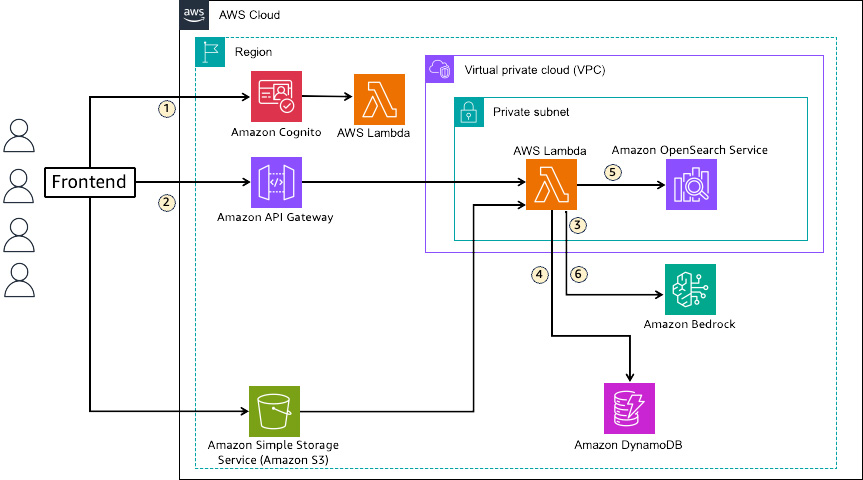

이 포스트에서는 Amazon Q Business에 맞춤형 플러그인을 설계하고 구현하여 교육 자료에서 답변을 검색하여 직원 교육을 간소화하는 지능형 챗봇을 만드는 방법을 탐구합니다. 이 솔루션은 사용자 인증 및 권한 부여를 위해 Amazon Cognito를 사용한 안전한 API 액세스를 구현하고, 다양한 문서 형식을 처리하며, RAG 향상된 응답 및 사용자 정의 플러그인을 통한 이메일 에스컬레이션 기능을 포함합니다.

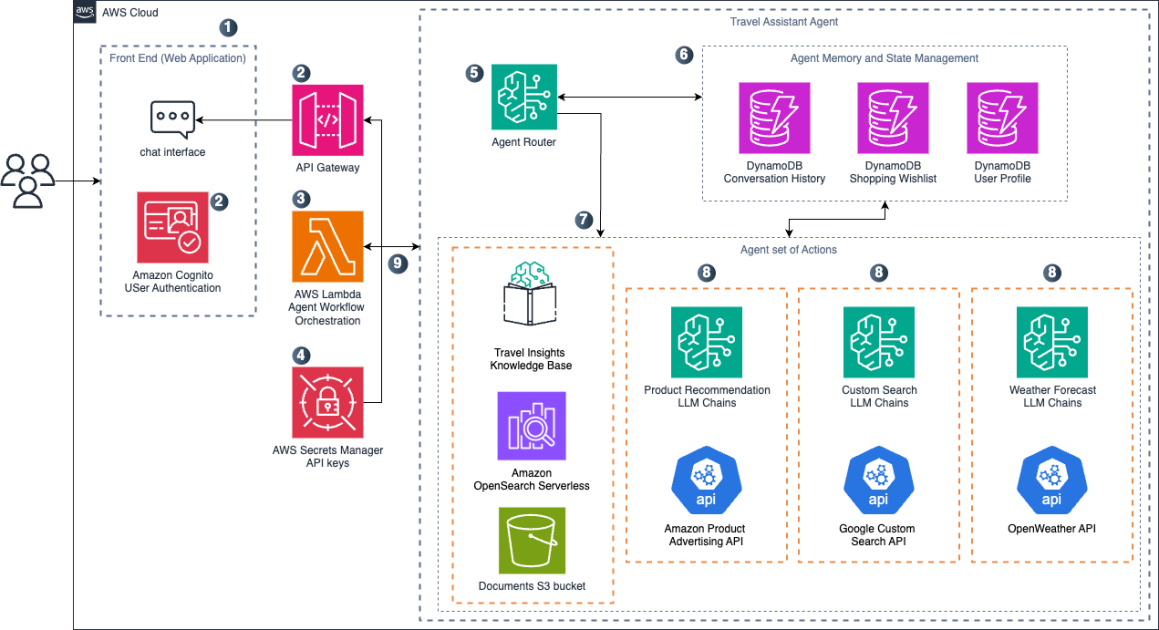

이 포스트에서는 AI 에이전트를 활용하여 여행 계획 솔루션을 구축하는 방법을 탐구합니다. 아마존 노바를 사용하는데, 다른 상업용 LLM에 비해 성능과 비용의 최적 균형을 제공합니다. 정확하지만 비용 효율적인 아마존 노바 모델과 LangGraph 오케스트레이션 기능을 결합하여 복잡한 계획 작업을 처리하면서 제품 배포의 운영 비용을 관리할 수 있는 실용적인 여행 보조 도우미를 만듭니다.

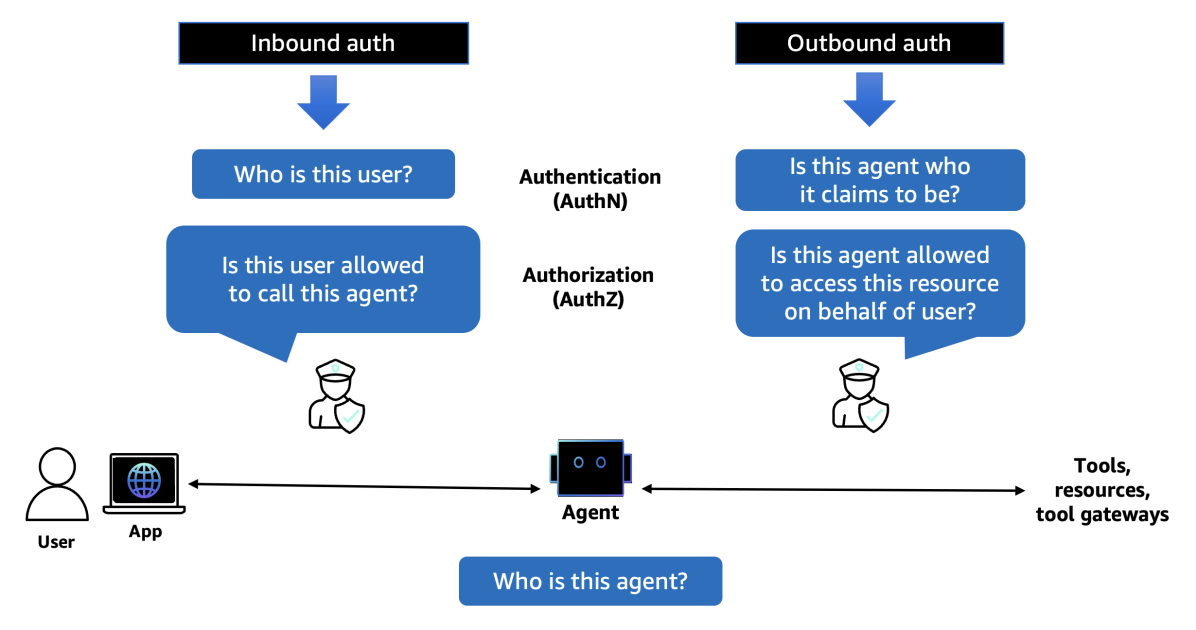

아마존 베드락 에이전트코어 게이트웨이는 기업이 AI 에이전트와 도구 및 서비스를 연결하는 방식을 혁신적으로 변화시키는 완전히 관리되는 서비스로, 에이전트-도구 소통을 위한 통합 인터페이스를 제공한다. 보안 가드, 번역, 구성, 대상 확장성, 인프라 관리자, 의미론적 도구 선택과 같은 주요 기능을 제공하며, 양방향 보안 아키텍처를 구현하여 수신 및 발신 연결에 고급 보안을 제공한다.

전통적인 소프트웨어 개발 생명주기에서 많은 시간이 각 단계에서 소비되는 것에 대해 알아봤습니다. 이 게시물에서는 Amazon Q Developer를 활용하여 AWS에서 확장 가능한 MERN 스택 웹 애플리케이션을 구축함으로써 얻을 수 있는 생산성 향상을 살펴보았습니다.

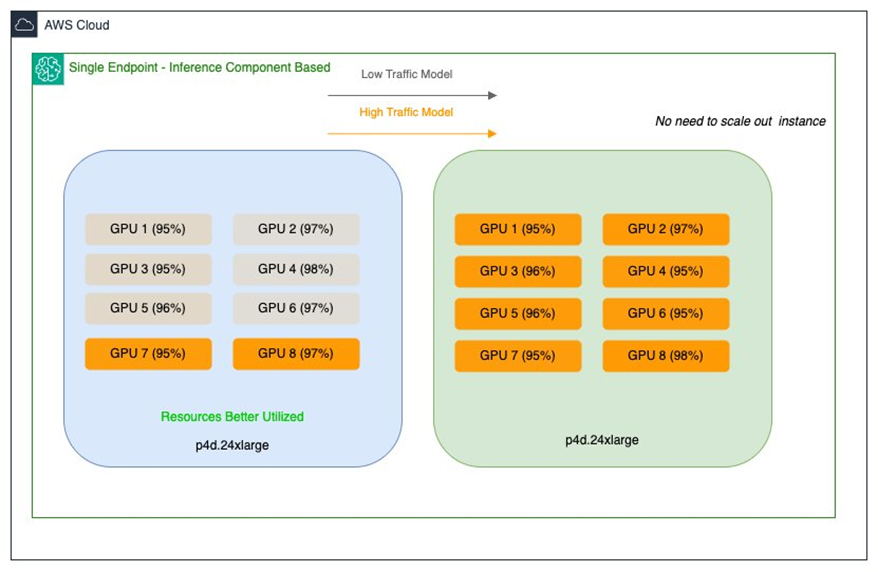

Salesforce AI 플랫폼팀이 Amazon SageMaker AI를 활용하여 GPU 활용률을 최적화하고 리소스 효율성을 향상시키며 비용 절감을 이룬 경험을 공유합니다.

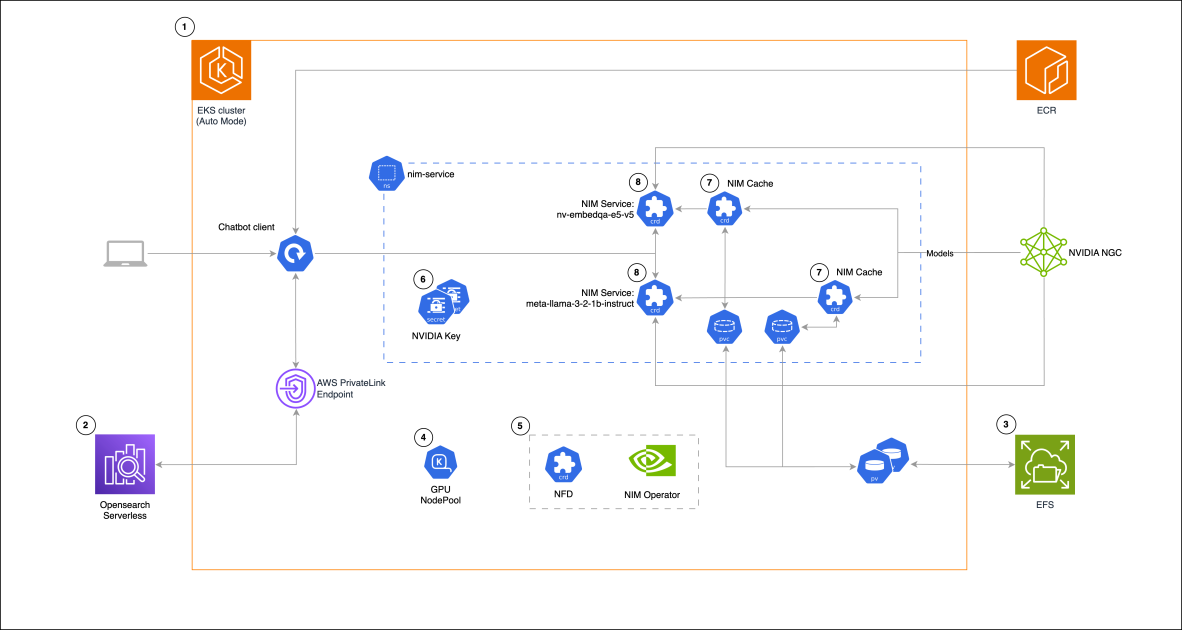

이 포스트에서는 최신 기술 스택을 사용하여 실용적인 RAG 채팅 기반 어시스턴트를 구현하는 방법을 보여줍니다. 솔루션은 NVIDIA NIMs를 사용하여 LLM 추론 및 텍스트 임베딩 서비스를 제공하며, NIM Operator가 이들의 배포와 관리를 처리합니다. 아키텍처에는 Amazon OpenSearch Serverless가 포함되어 유사성 검색을 위한 고차원 벡터 임베딩을 저장하고 쿼리합니다.

Amazon Bedrock AgentCore Identity는 AI 에이전트를 위한 종합 식별 및 액세스 관리 서비스로, AWS 리소스와 제3자 도구에 안전한 액세스를 가능하게 합니다. 에이전트 식별 디렉토리, 에이전트 권한 부여자, 리소스 자격 증명 제공자 및 리소스 토큰 보관소와 같은 강력한 식별 관리 기능을 제공하여 조직이 대규모로 AI 에이전트를 안전하게 배포할 수 있습니다.

DTDC와 ShellKode가 아마존 베드락을 활용하여 제너레이티브 인공지능(AI)을 기반으로 한 DIVA 2.0 물류 에이전트를 구축한 과정에 대해 소개합니다.

이 게시물은 Salesforce Agentforce를 Amazon Bedrock Agents와 Amazon Redshift와 통합하여 기업 업무 프로세스를 자동화하는 실용적인 협업을 탐구합니다.

아마존 베드락을 활용해 계정 계획 프로세스를 간소화하고 향상시킨 Account Plan Pulse를 소개합니다. Pulse는 검토 시간을 줄이고 협업과 소비를 위해 실질적인 계정 계획 요약을 제공하여 AWS 영업팀이 고객에게 더 나은 서비스를 제공할 수 있게 도와줍니다.

Asana AI Studio와 Amazon Q index가 통합되어 기업 효율성을 높이는 지능적인 워크플로우 자동화와 데이터 접근성을 향상시키는 방법을 살펴봅니다.

결제 업계가 AI 도입 확장에서 직면하는 독특한 과제, 시행 결정에 영향을 미치는 규제적 고려사항, 책임 있는 AI 원칙 적용에 대한 실용적 접근 방법을 탐구한다. 파트 2에서는 결제 시스템 내에서 책임 있는 AI를 운영화하는 실용적인 전략을 제시한다.

이 시리즈의 첫 번째 부분에서는 결제 업계에서의 책임 있는 AI의 기본적인 개념을 탐구했습니다. 본문에서는 책임 있는 AI 프레임워크의 실질적인 구현에 대해 논의합니다.

아마존 베드락 데이터 자동화와 세이지메이커 AI를 사용하여 다중 페이지 문서에 인간 검토 루프를 적용하는 방법을 소개합니다.

이 포스트에서는 Amazon Q Business를 사용하여 AI 어시스턴트를 구축하는 방법을 보여줍니다. 사용자 요청에 응답하는 AI 어시스턴트를 구축하고, S3 버킷에 저장된 기업 문서를 기반으로 응답합니다. 사용자들은 AI 어시스턴트 응답에서 참조 URL을 사용하여 참조 문서를 보거나 다운로드할 수 있으며, 책임 있는 AI를 실천하기 위해 AI 응답을 확인할 수 있습니다.

Amazon SageMaker JumpStart에서 OpenAI의 새로운 GPT OSS 모델인 gpt-oss-120b와 gpt-oss-20b을 이용할 수 있다. 이를 통해 AWS에서 OpenAI의 최신 추론 모델을 배포하여 생성적 AI 아이디어를 실험하고 책임 있게 확장할 수 있다. 본문에서는 이러한 모델을 SageMaker JumpStart에서 어떻게 시작하는지에 대해 설명한다.

Amazon Q Business는 기업이 데이터와 지식의 가치를 발견하는 데 도움을 주는 완전히 관리되는 생성 AI 기반 어시스턴트이다. Amazon Q Business를 사용하면 회사의 다양한 데이터 소스와 기업 시스템에 저장된 정보와 전문 지식을 활용해 빠르게 질문에 답을 찾고 요약 및 콘텐츠를 생성하며 작업을 완료할 수 있다.

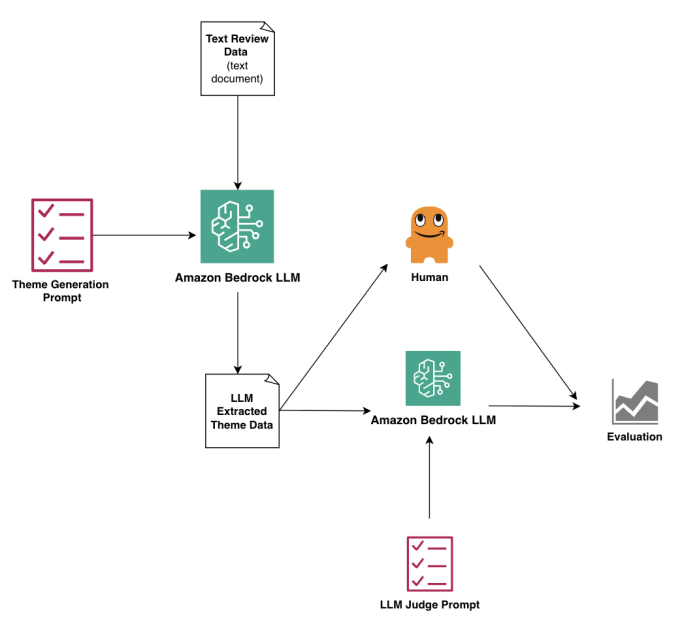

본문에서는 Amazon Bedrock에 여러 생성 AI 모델을 배포하여 LLM 모델에게 텍스트 응답의 주제 요약을 작성하도록 지시하는 방법을 강조합니다. 그런 다음 이러한 LLM 생성 요약을 검토하는 판사로서 여러 LLM 모델을 사용하여 요약 제목과 요약 설명 사이의 내용 일치를 판단하고 등급을 할당하는 방법을 보여줍니다.

이 글에서는 강의 개요 생성과 강의 콘텐츠 생성이라는 두 가지 핵심 모듈의 기술적 구현과 함께 각 구성 요소를 자세히 탐구합니다.

Handmade.com이 Amazon Bedrock 및 Amazon OpenSearch Service를 활용하여 AI 기반 파이프라인을 구현하여 제품 설명 처리를 현대화했습니다. 이 솔루션은 Anthropic의 Claude 3.7 Sonnet LLM, Amazon Titan Text Embeddings V2 및 시맨틱 검색 기능을 결합하여 60,000개 이상의 카탈로그에서 제품 설명을 자동화 및 향상시킵니다.

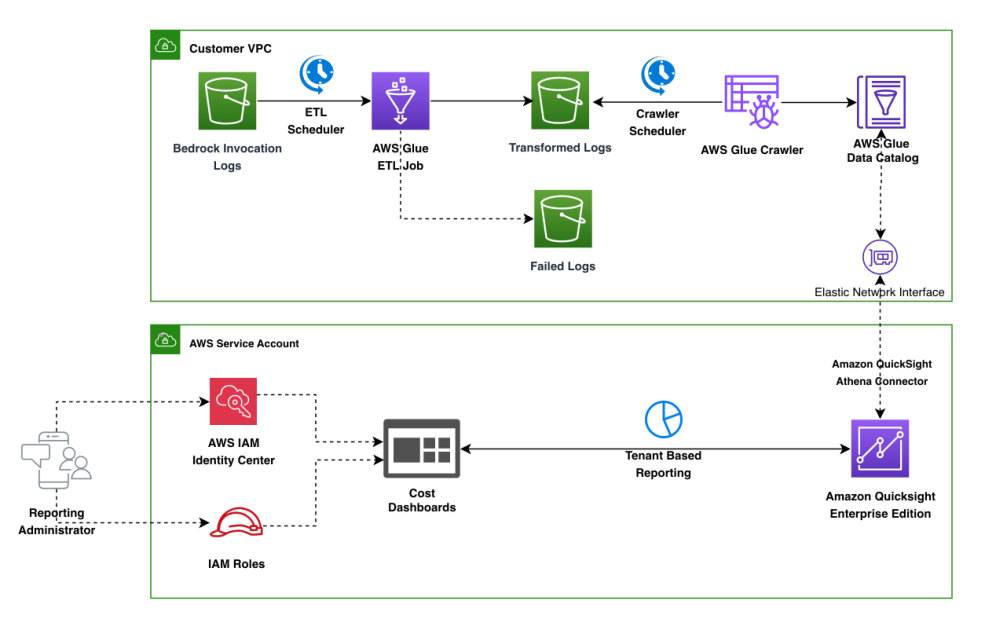

이 게시물에서는 Converse API의 requestMetadata 매개변수를 사용하여 Amazon Bedrock에서 멀티 테넌트 모델 추론 비용을 추적하고 분석하는 방법을 보여줍니다. 솔루션에는 AWS Glue를 사용한 ETL 파이프라인과 Amazon QuickSight 대시보드가 포함되어 있어 사용 패턴, 토큰 소비 및 다양한 테넌트 및 부서 간의 비용 할당을 시각화합니다.

Amazon Bedrock AgentCore 브라우저 도구를 소개합니다. 기업이 클라우드 기반 브라우저 자동화를 필요로 하는 이유와 실시간 데이터 접근을 요구하는 FMs에게 해결책을 제공합니다. 핵심 사용 사례와 도구의 핵심 기능에 대해 다루며, 도구 사용 방법을 안내합니다.

아마존 베드락의 에이전트코어 코드 해석기는 AI 에이전트가 격리된 샌드박스 환경에서 안전하게 코드를 실행할 수 있게 해주는 완전히 관리되는 서비스입니다. 보안, 확장성, 인프라 관리와 관련된 도전 과제를 해결하는 방법에 대해 설명합니다.

Arize AX 서비스를 사용하여 Strands Agents를 통해 시작된 AI 에이전트 작업을 추적하고 평가하여 에이전트 워크플로우의 정확성과 신뢰성을 확인하는 방법 소개.

이 포스트에서는 조직이 보안 포지션을 유지하면서 운영 이벤트를 모니터링하고 식별하며 문제 해결하는 데 도움이 되는 로우코드 노코드 AIOps 솔루션을 구현하는 방법에 대해 논의합니다. 이러한 기술이 어떻게 함께 작동하여 반복 작업을 자동화하고 사고 대응을 간소화하며 조직 전체의 운영 효율성을 향상시키는지 보여줍니다.

이 포스트에서는 Amazon Q Developer CLI와 Model Context Protocol (MCP) 서버 통합을 사용하여 온프레미스에서 실행 중인 레거시 Java Spring Boot 애플리케이션을 현대화하고, Amazon Elastic Kubernetes Service (Amazon EKS)에 배포하여 AWS로 마이그레이션하는 방법에 대해 알아볼 수 있습니다.

AWS Batch가 Amazon SageMaker 학습 작업과 완벽하게 통합되었습니다. ML 학습 작업을 효율적으로 관리하고 우선순위를 지정하여 비즈니스에 하드웨어를 효율적으로 활용하는 이점에 대해 설명하고, 이 새로운 기능을 사용하는 방법과 SageMaker 학습 계획 활용을 안내합니다.

Amazon Nova의 제약 디코딩을 통해 구조화된 출력 도구의 신뢰성을 제공했다. 이제 Amazon Nova Foundation 모델(FMs)을 사용하여 복잡한 스키마를 기반으로 데이터를 추출하고 도구 사용 오류를 95% 이상 줄일 수 있다. 본문에서는 Amazon Nova FMs를 구조화된 출력 사용 사례에 어떻게 활용할 수 있는지 탐구한다.

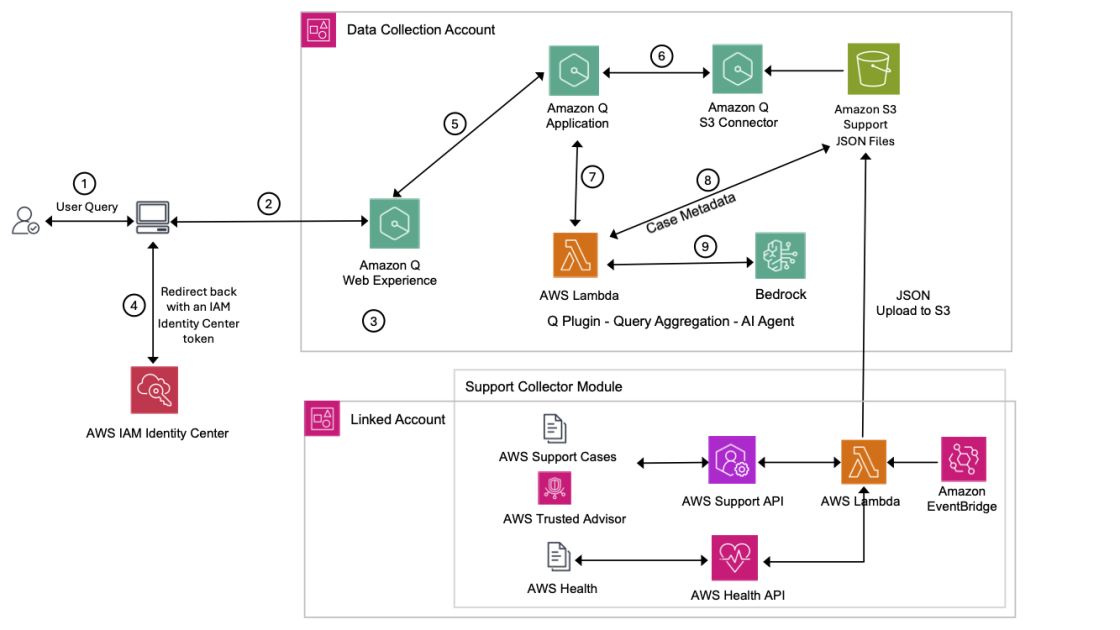

Amazon Q를 사용하여 사용자 정의 플러그인을 활용하여 AWS 지원 데이터에 대한 의미 검색 기능과 정확한 분석을 결합하는 방법을 배우세요. 이 솔루션은 구조화된 데이터 쿼리를 RAG 아키텍처와 통합하여 더 정확한 분석 질문에 대한 답변을 제공하며, 팀이 지원 사례와 건강 이벤트를 실행 가능한 통찰로 변환할 수 있도록 합니다.

Amazon Strands Agents SDK는 AWS 환경과 통합되어 안전하고 확장 가능한 배포를 제공하며, 생산 환경에서 풍부한 관측 가능성을 제공합니다. 실용적인 사용 사례를 살펴보고 Strands를 활용한 단계별 예시를 제시합니다.

본문에서는 Strands 에이전트와 Tavily의 웹 인텔리전스 API를 결합하여 강력한 리서치 에이전트를 소개하며, 기업 배포에 필요한 보안 및 규정 준수 기준을 유지하면서 복잡한 정보 수집 작업에 뛰어난 성과를 거둘 수 있는 방법을 소개합니다.

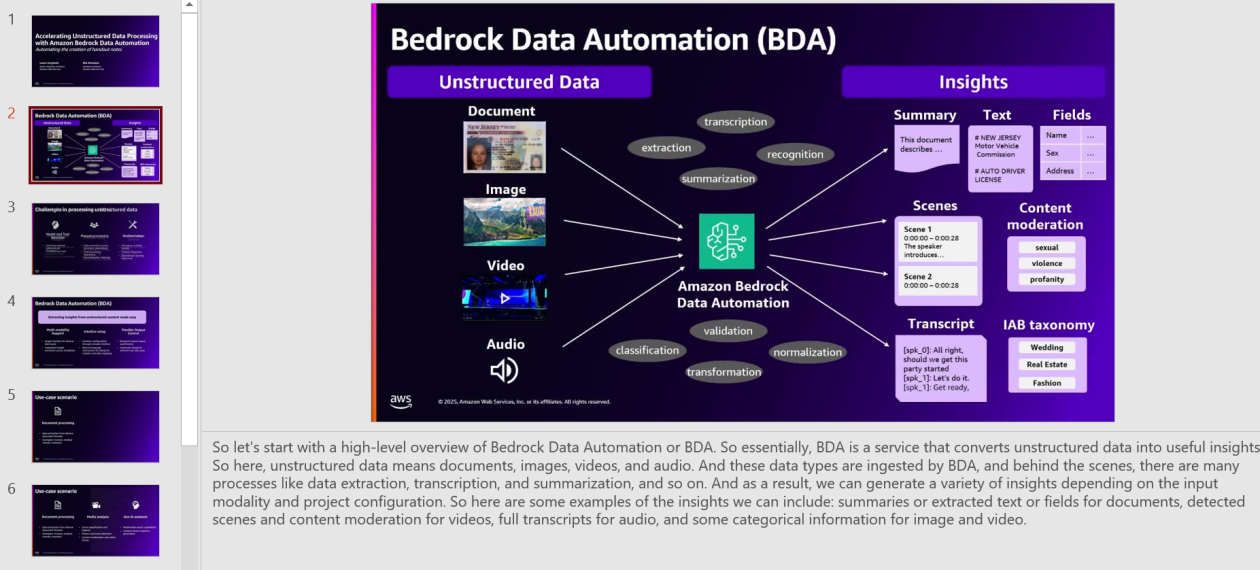

이 글에서는 Amazon Bedrock Data Automation을 사용하여 웨비나 녹화물을 종합적인 핸드아웃으로 변환하는 자동화된 서버리스 솔루션을 구축하는 방법을 소개합니다. Amazon Bedrock Data Automation을 구현하여 영상 분석을 위해 트랜스크라이브하고 슬라이드 변경을 감지하며, Amazon Bedrock foundation 모델 (FM) 및 사용자 정의 AWS Lambda 함수를 AWS Step Functions에 의해 조정하는 과정을 안내합니다.

Amazon Bedrock FMs, LangGraph 및 Model Context Protocol (MCP)를 사용하여 강력한 에이전트 애플리케이션을 만드는 방법을 탐색하며, GitHub 워크플로우를 다루는 실제 시나리오를 소개합니다.

Mistral AI의 24 억 개 파라미터 대형 언어 모델 Mistral-Small-3.2-24B-Instruct-2506이 출시되었습니다. 이 모델은 향상된 지시 따르기와 반복 오류 감소를 위해 최적화되어 Amazon SageMaker JumpStart 및 Amazon Bedrock Marketplace를 통해 이용 가능합니다.

금융 기관이 의심스러운 금융 거래를 의심하는 합리적인 근거가 있는 경우 금융 감독기관에 제출해야 하는 의심스러운 거래 보고서(STR)에 대해 살펴봅니다. 이 글에서는 Amazon Bedrock의 FMs를 활용하여 초안 STR을 작성하는 솔루션에 대해 알아봅니다.

이 포스트에서는 Llama-3.2-11B-Vision-Instruct 모델을 웹 자동화 작업에 세밀하게 조정하고 배포하는 완벽한 솔루션을 제시합니다. AWS Deep Learning Containers (DLCs)를 사용하여 Amazon Elastic Kubernetes Service (Amazon EKS)에서 안전하고 확장 가능하며 효율적인 인프라를 구축하는 방법을 보여줍니다.

니뽘 라이프 인도 자산관리가 채택한 솔루션은 사용자 쿼리를 재작성하고 응답을 집계 및 재랭킹하여 일반적인 RAG 방법보다 정확도를 향상시킴. 개선된 RAG 방법을 사용해 응답의 전반적인 정확도를 향상시키는 방법을 살펴봄.

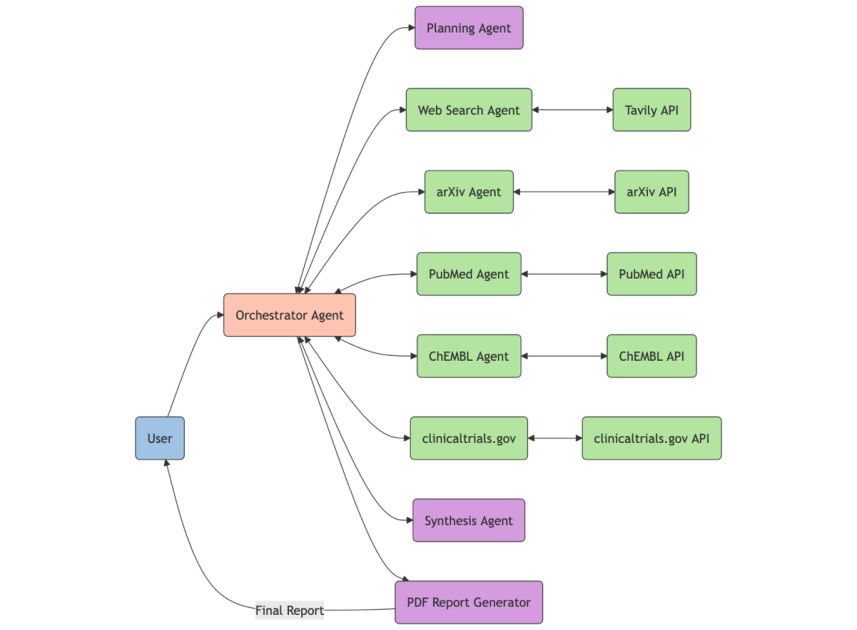

Strands 에이전트와 아마존 베드락을 이용하여 약물 발견을 위한 강력한 연구 보조 도구를 만드는 방법을 소개합니다. 이 AI 보조 도구는 Model Context Protocol (MCP)을 사용하여 여러 과학 데이터베이스를 동시에 검색하고, 그 결과를 종합하여 약물 타겟, 질병 메커니즘, 치료 분야에 대한 포괄적 보고서를 생성할 수 있습니다.

Amazon Nova Act SDK는 브라우저 기반의 워크플로우를 대규모로 자동화하기 위해 이미 여러 산업 분야의 팀들이 사용하고 있는데, 이 포스트에서는 Nova Act SDK의 독특한 기능과 작동 방식에 대해 살펴볼 것이다.

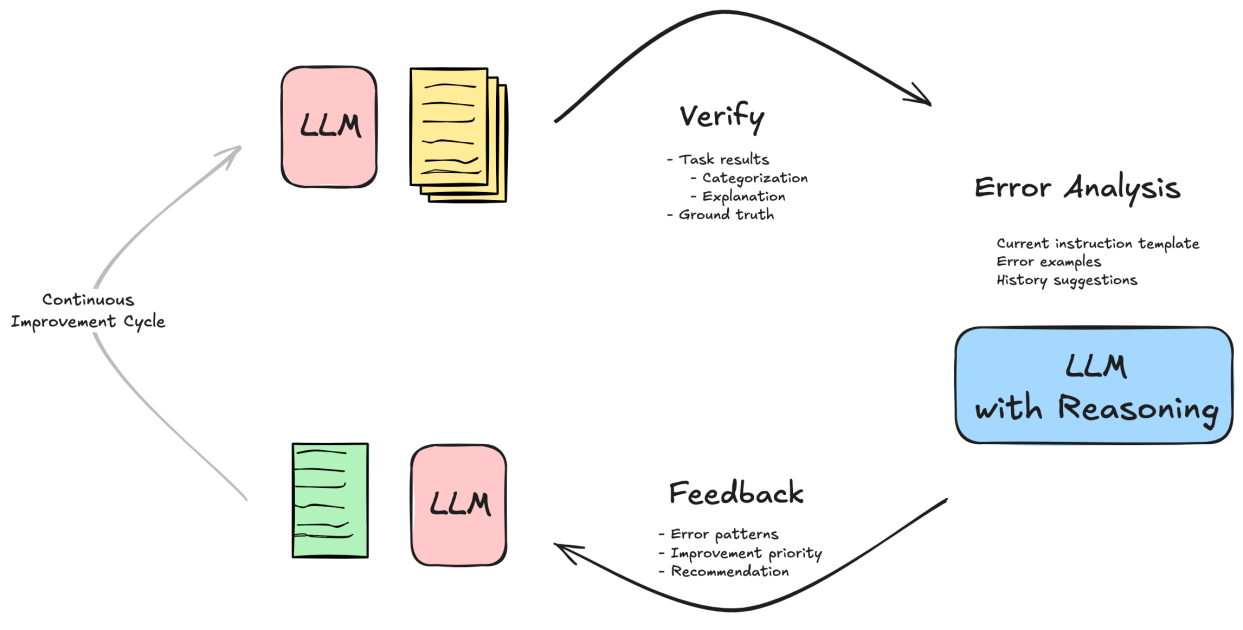

Crypto.com은 사용자 및 시스템 피드백을 활용하여 지시 프롬프트를 지속적으로 개선하고 최적화하는 방법을 탐색합니다. 이 피드백 중심적 접근법은 다양한 서브시스템에 적응하면서 다양한 사용 사례에서 높은 성능을 유지하면서 더 효과적인 프롬프트를 만들 수 있게 했습니다.

AWS Serverless MCP 서버가 서버리스 라이프사이클 전반에 걸쳐 개발을 가속화하는 방법을 살펴보고 있습니다. get_iac_guidance 및 get_lambda_guidance와 같은 도구를 사용하여 구조적인 결정을 내린 후 get_serverless_templates, sam_init를 통해 개발을 간소화하고 SAM 통합, webapp_deployment_help, configure_domain를 통해 배포합니다. 우리는 대화형 AI 접근 방식이 아키텍처 설계부터 운영까지 전 과정을 변화시키는 방법을 보여줍니다.

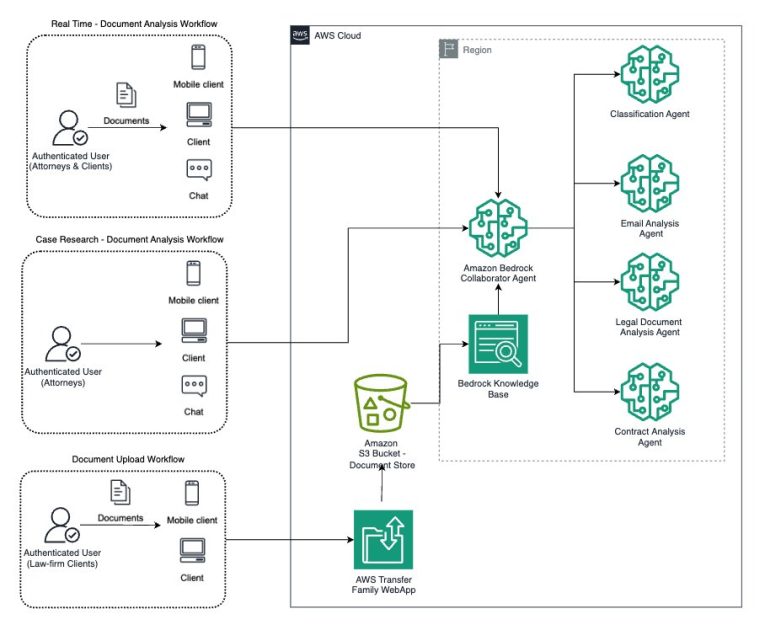

Amazon Bedrock 에이전트를 사용하여 실시간 문서 분석을 위한 지능형 eDiscovery 솔루션을 구축하는 방법을 소개합니다. 문서 분류, 계약 분석, 이메일 검토, 법적 문서 처리를 위한 특수 에이전트를 배포하고 다중 에이전트 아키텍처를 통해 함께 작동하는 방법을 보여줍니다. 구현 세부 정보, 배포 단계 및 조직이 특정 eDiscovery 요구 사항에 적응할 수있는 확장 가능한 기반을 만드는 데 필요한 모범 사례를 안내합니다.

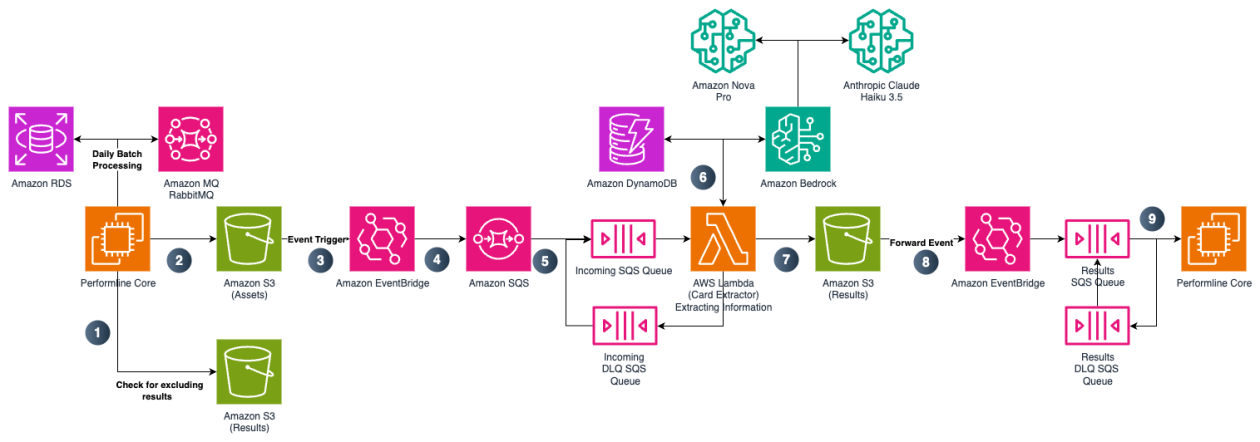

PerformLine은 Amazon Bedrock을 활용하여 규정 준수 프로세스를 가속화하고 실행 가능한 통찰을 얻으며 속도와 정확성을 제공함. 이는 대규모 감시에 필수적인 요소로 작용함.

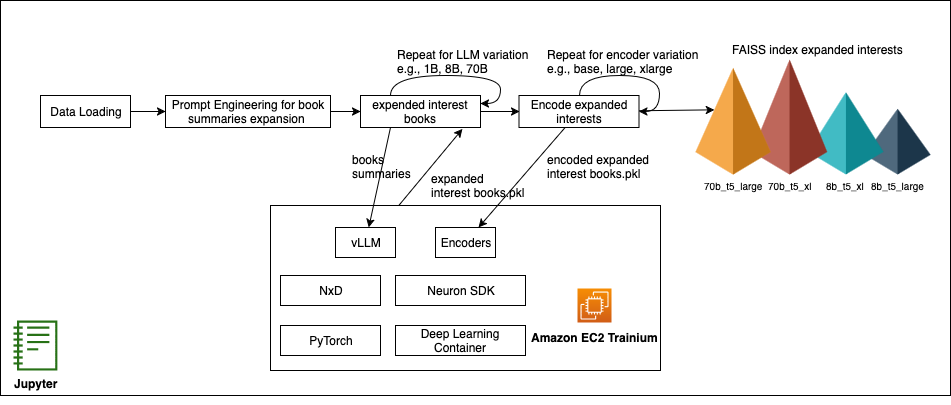

이 글에서는 vLLM을 사용하여 확장 가능한 추론을 어떻게 할지 보여주고 AWS Deep Learning Containers (DLC)를 사용하여 모델 패키징과 배포를 간편화하는 방법을 소개합니다. 구조화된 프롬프트를 통해 관심 확장을 생성하고 이를 임베딩으로 인코딩하며, FAISS로 후보를 검색하고 결과를 유지하기 위해 검증을 적용하며, cold-start 도전을 과학적 실험으로 구성합니다. LLM과 인코더 쌍을 벤치마킹하고 추천 메트릭에 빠르게 반복하며 각 구성에 대한 명확한 ROI를 보여줍니다.

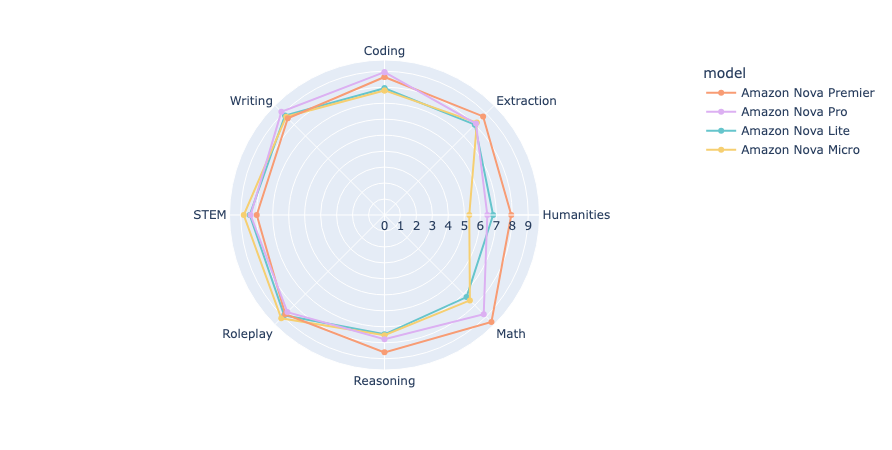

MT-Bench와 Arena-Hard의 저장소는 OpenAI의 GPT API를 사용하여 개발되었으며, 주로 GPT-4를 심사관으로 활용했습니다. 우리 팀은 Amazon Bedrock API와 통합하여 Amazon의 심사관으로 Anthropic의 Claude Sonnet을 사용할 수 있도록 기능을 확장했습니다. 이 게시물에서는 MT-Bench와 Arena-Hard를 사용하여 Amazon Nova 모델을 벤치마킹하고, Amazon Bedrock를 통해 사용 가능한 다른 주요 LLM과 비교합니다.

AWS Summit에서 Amazon Nova foundation 모델을 위한 포괄적인 모델 사용자 정의 기능 세트를 소개했습니다. Amazon SageMaker AI에서 사용할 수 있는 준비된 레시피로, Nova Micro, Nova Lite 및 Nova Pro를 모델 훈련 수명주기 전반에 걸쳐 적응하는 데 사용할 수 있습니다. 이 게시물에서는 SageMaker 훈련 작업에서 Nova Micro를 사용자 정의하는 간소화된 방법을 소개합니다.

이 솔루션은 OpenSearch Service를 사용하여 Multi-tenant RAG에서 벡터 데이터 저장소로 사용하며 JWT 및 FGAC를 사용하여 데이터 격리 및 라우팅을 달성합니다.

이 포스트에서는 Amazon Q 지수와 MCP를 결합하는 최적의 방법과 통합 패턴을 탐색하여 기업이 안전하고 확장 가능하며 실행 가능한 AI 검색 및 검색 아키텍처를 구축할 수 있도록 도와줍니다.

2024년, 일본 경제산업성이 Generative AI 가속기 도전을 시작했고, AWS는 GENIAC의 두 번째 사이클을 위해 클라우드 제공업체로 선정되어 12개 기관에 기반 모델 개발을 위한 인프라와 기술 지원을 제공했다.

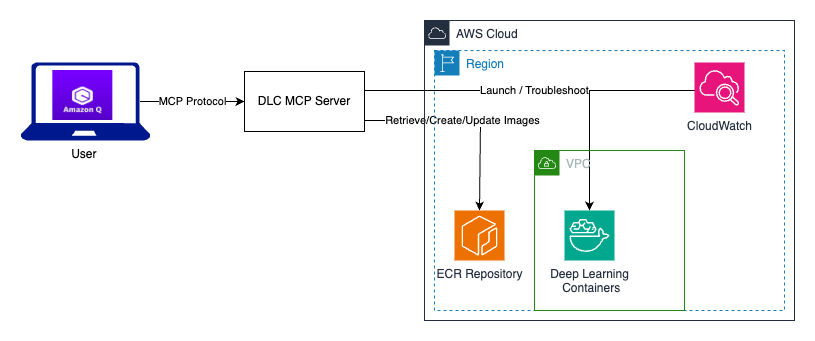

이 글에서는 Amazon Q Developer와 Model Context Protocol (MCP) 서버를 사용하여 DLC 워크플로우를 간소화하여 DLC 컨테이너의 생성, 실행 및 사용자 정의를 자동화하는 방법을 탐색합니다.

Amazon Bedrock와 Amazon Transcribe의 고급 기능을 활용하여 음성 녹음을 간결하고 구조화된 요약으로 변환하는 서버리스 회의 요약 시스템을 소개합니다. 이 프로세스를 자동화함으로써 조직은 핵심 통찰력, 업무 항목 및 결정 사항이 체계적으로 기록되고 이해관계자에게 접근 가능하게 됩니다.

Kyruus Health가 AWS 서비스를 활용해 Guide를 구축하는 방법을 소개하며, Amazon Bedrock와 Amazon OpenSearch Service가 건강 관련 언어를 이해하고 적절한 공급자와 연결하는 데 어떻게 협력하는지 보여줍니다.

제조업에서 서비스 보고서로부터의 소중한 통찰력이 종종 문서 저장 시스템에서 제대로 활용되지 않습니다. 이 글은 Amazon Web Services (AWS) 고객이 생성 AI를 사용하여 여러 보고서로부터 중요 정보를 자동으로 디지턀화하고 추출하는 솔루션을 구축하는 방법을 탐색합니다.

이 글에서는 고객 프로필 및 선호도와 실시간 가격 데이터를 결합하여 맞춤형 휴가 패키지를 생성하는 Amazon Bedrock를 활용한 생성적 AI 솔루션을 구축하는 방법을 소개합니다. Amazon Bedrock Knowledge Bases를 사용하여 여행 정보, Amazon Bedrock Agents를 사용하여 실시간 항공편 세부 정보, Amazon OpenSearch Serverless를 사용하여 효율적인 패키지 검색 및 검색을 보여줍니다.

이 글에서는 가상의 회사인 AnyTelco를 위해 AI 기반 콜 센터 에이전트인 Telly를 만드는 방법을 소개합니다. MCP(Modal Context Protocol) 프레임워크를 사용하여 구현된 사용자 정의 도구를 통해 실시간 고객 데이터에 액세스하면서 Telly는 요금제 및 서비스에 대한 고객 문의를 처리할 수 있습니다.

Amazon Bedrock의 응용 프로그램 추론 프로필 기능을 활용하여 다중 테넌트 AI 배포에 대한 강력한 모니터링 솔루션을 구현하는 방법을 탐색합니다. 복잡한 다중 테넌트 환경에서 세밀한 사용량 추적, 정확한 비용 할당 및 동적 자원 관리를 가능하게 하는 시스템 생성 방법을 시연합니다.

대형 언어 모델의 성능평가는 헷갈리거나 BLEU 점수와 같은 통계적 지표를 넘어섭니다. 실제 생성형 AI 시나리오에서 모델이 기준선이나 이전 버전보다 나은 출력물을 생성하는지 이해하는 것이 중요합니다. 특히 요약, 콘텐츠 생성과 같은 응용 분야에서 더욱 중요합니다.

이 포스트에서는 Amazon S3 벡터를 Amazon Bedrock 지식베이스와 통합하여 RAG 애플리케이션에 활용하는 방법을 소개합니다. 수백만 문서를 처리하면서도 검색 품질을 유지하고 S3 벡터를 사용하여 비용을 절감하는 실용적인 방법을 배울 수 있습니다.

이 글에서는 Amazon Bedrock를 사용하여 사용자 지정 모델의 온디맨드 배포 워크플로우를 안내하고, AWS 관리 콘솔 및 API 또는 AWS SDK를 사용한 단계별 구현 가이드를 제공합니다. 또한 Amazon Bedrock에서 사용자 지정 Amazon Nova 모델을 배포하는 데 있어 최적의 사례와 고려 사항에 대해 논의합니다.

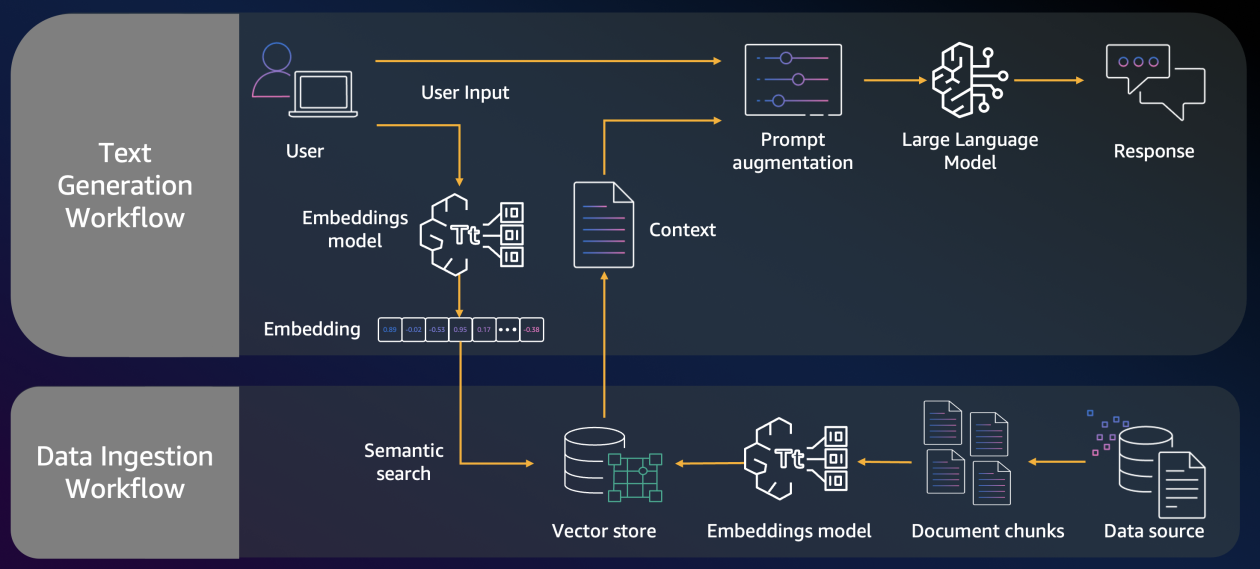

기업들이 DeepSeek R1과 같은 대규모 언어 모델을 도입하여 비즈니스 프로세스를 변형하고 고객 경험을 향상시키며 이전에 없던 속도로 혁신을 주도하고 있다. 그러나 독립형 LLM은 환각, 오래된 지식 및 독점 데이터 접근 불가와 같은 주요 제한 사항이 있습니다. RAG는 의미 검색과 생성적 AI를 결합하여 이러한 갭을 해결합니다.

악센처는 아마존 노바와 베드락 에이전트를 활용해 비디오 하이라이트 제작을 확장하고, 시청자 참여도를 높이며 콘텐츠 가치를 증진시키는데 성공했다. 짧고 강렬한 클립은 시청자 유지율을 끌어올리고 소셜 미디어를 통해 확대되는 동시에 브랜드 아이덴티티를 강화하고 새로운 기회를 열어준다.

이 게시물에서는 개발자들이 Amazon Nova Sonic을 Vonage 통신 서비스와 통합하여 실시간으로 반응성이 뛰어나고 자연스러운 음성 경험을 구축하는 방법을 탐구합니다. Vonage Voice API를 Amazon Nova Sonic의 낮은 지연 및 표현력 있는 음성 기능과 결합하여 기업은 전통적인 음성 인터페이스보다 더 인간적인 상호 작용을 제공하는 AI 음성 에이전트를 배포할 수 있습니다. 이러한 에이전트는 고객 지원, 가상 비서 등으로 사용할 수 있습니다.

Amazon은 새로운 기능을 통해 에이전트를 대규모로 구축하고 배포하는 데 필수적인 측면에 대응하고 있습니다. 이러한 혁신은 실험을 넘어 비즈니스 프로세스에 신뢰할 수 있는 생산 준비 에이전트 시스템을 구축하는 데 도움이 될 것입니다.

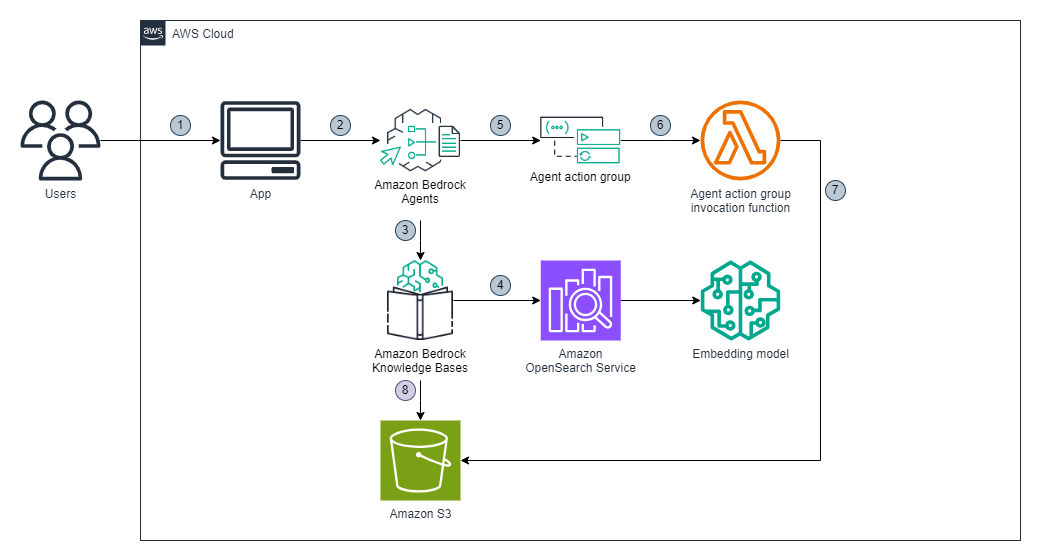

Amazon Bedrock Knowledge Bases는 Amazon OpenSearch Service 관리 클러스터를 지원함으로써 완전히 관리되는 RAG 솔루션의 기능을 강화했습니다. 이 기능은 Amazon Bedrock Knowledge Bases의 핵심 기능을 더욱 강화하며, foundation models (FMs)을 내부 데이터 소스와 원활하게 연결하도록 설계되었습니다.

Datadog LLM Observability와 Amazon Bedrock 에이전트 간의 새로운 통합을 소개합니다. 이 통합은 Amazon Bedrock에 구축된 에이전트 애플리케이션을 성공적으로 모니터링, 운영 및 디버깅하는 데 필요한 가시성과 제어를 제공합니다.

PayU는 상인, 은행 및 소비자의 금융 요구를 기술을 통해 서비스하는 풀스택 디지털 금융 서비스 시스템을 제공합니다. 이 게시물에서는 PayU 팀이 기업용 AI 솔루션을 갖추고 Amazon Bedrock을 활용하여 AI 액세스를 민주화하는 방법을 설명하며, 데이터 소재 요구 사항에 손상을 주지 않았습니다.

NVIDIA와 함께 작성된 이 글은 AWS의 DGX 클라우드가 고성능 AI 인프라에 대한 접근을 민주화하는 데 어떻게 도움이 되는지 소개합니다. NVIDIA GPU 전문 지식과 AWS 확장 가능한 클라우드 서비스를 결합하여 조직은 학습 시간을 가속화하고 운영 복잡성을 줄이며 Amazon Bedrock를 활용할 수 있습니다.

NVIDIA Dynamo를 활용하여 Amazon EKS에서 생성 모델 AI 추론을 가속화하는 방법에 대한 소개. NVIDIA Dynamo를 Amazon EKS에 설정하여 자동 스케일링 및 간소화된 Kubernetes 운영을 수행하는 방법을 설명하고 있으며, AWS Labs의 AI on EKS GitHub repo에서 NVIDIA Dynamo 블루프린트를 사용하여 인프라 프로비저닝, 모니터링 구성, NVIDIA Dynamo 오퍼레이터 설치하는 실습 안내 제공.

AWS는 AWS 창의적 AI 혁신 센터에 1억 달러의 추가 투자를 발표했으며, 금융 서비스부터 의료 분야까지의 산업에서의 성공적인 고객 협업 두 해를 기념했다. 이 투자는 AI가 더 많은 자율적이고 행동적인 시스템으로 진화함에 따라 이루어졌으며, 이미 수천 명의 고객이 수백만 달러의 생산성 향상을 이끌고 고객 경험을 변화시키는 데 도움을 받고 있다.

Sonatus가 AWS Generative AI Innovation Center와 협력하여 생성적 AI를 활용해 데이터 수집 및 자동화 정책을 생성하는 자연어 인터페이스를 개발했다. 이 혁신은 정책 생성 과정을 몇 분 내지 몇 시간으로 줄이고 엔지니어 및 비전문가 모두에게 접근 가능하게 만들었다.

Rapid7은 CVSS 벡터를 예측하는 ML 모델의 교육, 유효성 검사 및 배포를 자동화하여 고객이 위험을 정확히 이해하고 복구 조치를 우선 순위로 정할 수 있도록 지원하고 있다.

본문에서는 서버리스 데이터 호수 아키텍처를 활용하여 안전한 RAG 애플리케이션을 구축하는 방법을 탐구합니다. Amazon S3, Amazon DynamoDB, AWS Lambda, Amazon Bedrock Knowledge Bases 등 AWS 서비스를 사용하여 비정형 데이터 자산을 지원하고 구조화된 데이터로 확장할 수 있는 종합 솔루션을 만드는 방법을 다룹니다. 기업 데이터에 대한 세밀한 액세스 제어를 구현하고 보안 경계를 준수하는 메타데이터 기반 검색 시스템을 설계하는 방법을 다루며, 이러한 접근법은 조직의 데이터 가치를 극대화하고 견고한 보안 및 규정 준수를 유지하는 데 도움이 됩니다.

AWS에서 ML 모델을 세밀하게 튜닝할 때 특정한 필요에 맞는 적절한 도구를 선택할 수 있다. AWS는 데이터 과학자, ML 엔지니어, 비즈니스 사용자들이 ML 목표를 달성할 수 있도록 포괄적인 도구 모음을 제공한다. SageMaker 훈련 작업부터 HyperPod까지 다양한 ML 심도를 지원하는 솔루션을 구축했다. 현재 필요에 맞는 것부터 시작하여 접근 방식을 발전시켜가는 것을 권장한다.

SkyPilot과 함께하는 이 글은, 생성적 AI 및 Foundation 모델(FMs)의 신속한 발전으로 기계 학습(ML) 워크로드의 계산 리소스 요구가 크게 증가했다. 현대 ML 파이프라인은 가속화된 컴퓨팅 리소스에 작업 부하를 효율적으로 분산시키는 시스템을 필요로 하며, 개발자 생산성을 유지해야 한다.

이 블로그 포스트는 Amazon Bedrock 데이터 자동화 및 기타 AWS 서비스를 이용한 종단 간 IDP 애플리케이션을 소개합니다. 이 애플리케이션은 IDP 파이프라인을 배포하고 문서를 구조화된 테이블로 변환하는 직관적인 UI를 제공하는 재사용 가능한 AWS 인프라를 제공합니다. 사용자는 입력 문서(계약서 또는 이메일 등)와 추출할 속성 목록만 제공하면 됩니다. 그럼 생성 AI를 사용하여 IDP를 수행합니다.

이 포스트에서는 Amazon Q를 QuickSight에 통합하여 “지난 6개월 동안 미국에서 반품된 상품 수를 보여줘”와 같은 자연어 요청을 의미 있는 데이터 시각화로 변환하는 방법에 대해 다룹니다. Amazon Bedrock 에이전트와 Amazon Q를 결합하여, 기업 전반에 걸쳐 데이터 액세스를 민주화하는 포괄적인 데이터 어시스턴트를 만드는 방법을 보여줍니다.

Amazon Bedrock을 사용하여 Text-to-SQL 솔루션을 구축하는 방법을 소개하고, Amazon Bedrock 에이전트의 기능을 설명하며, Part 2에서는 Amazon Q와 QuickSight를 활용하여 비즈니스 통찰력을 제공하는 방법을 소개합니다.

ABAC 패턴을 중점으로 한 권한 관리 전략을 통해 세밀한 사용자 액세스 제어를 가능하게 하고 AWS IAM 역할의 증식을 최소화하는 방법에 대해 논의합니다. ML 워크플로우에서 운영 효율성을 희생하지 않으면서 조직이 보안과 규정 준수를 유지하는 데 도움이 되는 검증된 최선의 방법을 공유합니다.

아마존 베드락 플로우 내에서 장기 실행(비동기) 플로우 지원이 공개 미리보기로 발표되었습니다. 이를 통해 기초 모델, 프롬프트 관리, 에이전트, 지식 베이스, 가드레일 등을 연결하여 사전 정의된 생성형 AI 워크플로우를 구축하고 확장할 수 있습니다.

금융 기관이 확장 가능하고 개인정보 보호를 우선시하는 사기 탐지 시스템을 구축하는 데 세이지메이커와 연합 학습이 어떻게 도움이 되는지 탐구한다.

이 시리즈의 첫 번째 부분에서는 Amazon Bedrock과 음성 및 멀티모달 대화형 AI 에이전트를 위한 오픈 소스 프레임워크인 Pipecat의 조합을 사용하여 인간과 유사한 대화형 AI 애플리케이션을 구축하는 방법을 배웠습니다. 또한 음성 에이전트의 일반적인 사용 사례와 단계별 모델 접근 방식에 대해 알아보았습니다. 본문(파트 2)에서는 Amazon Nova Sonic과 통합 모델을 활용하는 방법에 대해 탐구합니다.

패션 산업에서 빠르게 혁신하는 도중 AI를 활용하면서 독성 콘텐츠의 문제가 발생할 수 있다. Amazon Bedrock Guardrails의 다중 모달 독성 감지 기능을 사용하여 윤리적 기준을 유지하고 유해 콘텐츠를 걸러내는 방법에 대해 소개한다.

Amazon SageMaker AI의 새로운 혁신 기능을 소개하며, SageMaker HyperPod의 새로운 관측 기능, HyperPod에 JumpStart 모델 배포 기능, 로컬 개발 환경에서 SageMaker AI로의 원격 연결, 완전히 관리되는 MLflow 3.0 등이 포함됩니다.

SageMaker HyperPod에서 Amazon Elastic Kubernetes Service (EKS) 애드온을 원 클릭 설치하여 NVIDIA DCGM, Kubernetes 노드 익스포터, EFA, 통합 파일 시스템, Kubernetes API, Kueue, SageMaker HyperPod 작업 연산자의 건강 및 성능 데이터를 통합할 수 있습니다. 이 기사에서는 SageMaker HyperPod의 기본 관측 기능의 통합 대시보드를 설치하고 사용하는 방법을 안내합니다.

Amazon SageMaker가 MLflow 3.0을 완전 관리형으로 지원하여 AI 실험을 간소화하고 아이디어부터 제품 생산까지 생성 모델 AI 개발을 가속화하는 방법을 탐색합니다.

아마존 세이지메이커 하이퍼팟은 세이지메이커 JumpStart의 기본 모델 및 Amazon S3 또는 Amazon FSx에서 사용자 정의 또는 세밀하게 조정된 모델을 배포하는 지원을 발표했습니다. 이러한 기능을 통해 고객은 동일한 하이퍼팟 컴퓨팅 리소스에서 모델을 학습, 세밀하게 조정 및 배포하여 전체 모델 수명 주기 동안 리소스 활용을 극대화할 수 있습니다.