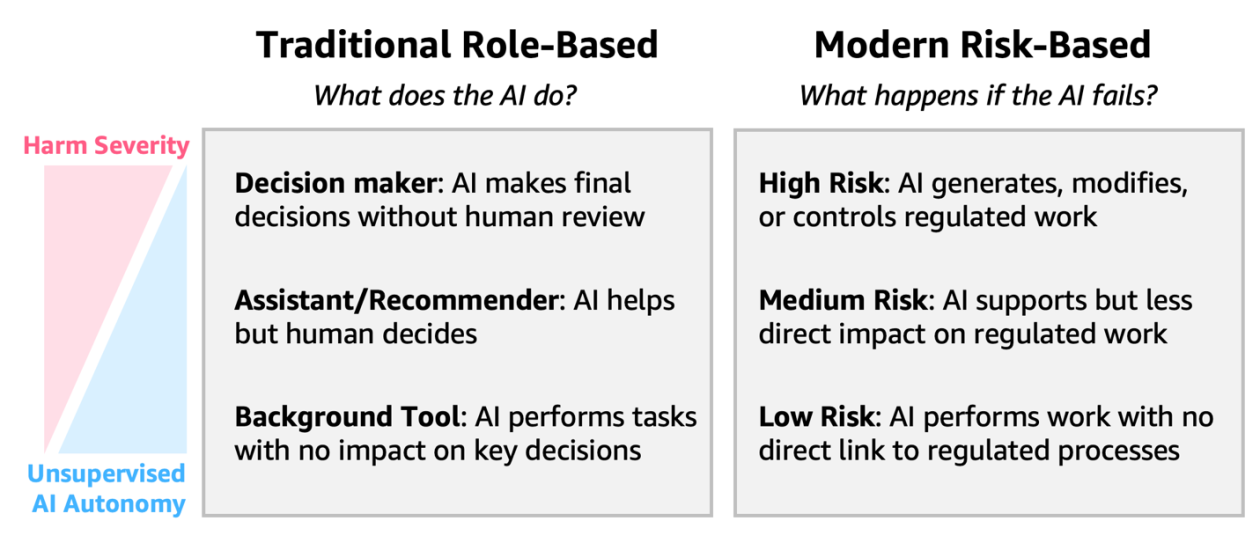

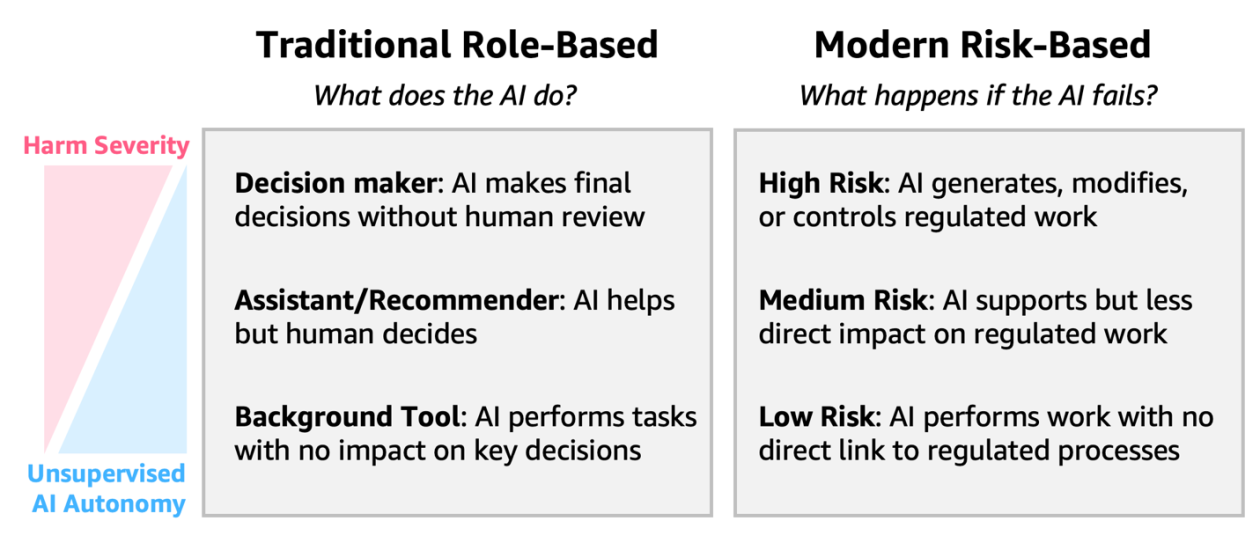

GxP 규정 준수를 위한 규제 환경이 AI의 고유한 특성을 고려하도록 발전하고 있습니다. 본문에서는 위험 기반 구현, 다양한 위험 수준에 따른 실용적 구현 고려 사항, AWS의 규정 준수를 위한 공유 책임 모델, 위험 완화 전략의 구체적 예시 등을 다룹니다.

GxP 규정 준수를 위한 규제 환경이 AI의 고유한 특성을 고려하도록 발전하고 있습니다. 본문에서는 위험 기반 구현, 다양한 위험 수준에 따른 실용적 구현 고려 사항, AWS의 규정 준수를 위한 공유 책임 모델, 위험 완화 전략의 구체적 예시 등을 다룹니다.

OpenAI가 gpt-oss-safeguard의 연구 미리보기를 공개했습니다. 두 개의 오픈 웨이트 안전 추론 모델은 사용자가 추론 시 사용자 정의 안전 정책을 적용할 수 있도록 합니다. 모델은 gpt-oss에서 파인 튜닝된 gpt-oss-safeguard-120b와 gpt-oss-safeguard-20b 두 가지 크기로 제공되며 Apache 2.0 라이선스로 배포되었으며 Hugging Face에서 로컬 사용을 위해 제공됩니다.

구글과 아칸소소주립대학 교수팀이 제안한 AI 에이전트 면역 시스템은 경량, 자율적인 AI 에이전트를 활용해 보안 위협을 빠르게 격리하는데 도움을 줄 수 있으며, 중앙 왕복 없이 220밀리초 이내에 보안 위협을 분석하고 중화할 수 있다.

이 튜토리얼에서는 탈옥 방어 기술을 소개하며, 정책 회피 프롬프트를 탐지하고 안전하게 처리하는 방법을 단계별로 소개합니다. 실제 공격 및 양성 예제를 생성하고, 규칙 기반 신호를 만들어 TF-IDF 기능과 결합하여 회피 프롬프트를 차단하지 않고 합법적인 요청을 차단할 수 있는 간결하고 해석 가능한 분류기를 만듭니다.

이 튜토리얼에서는 MCP 서버용으로 OAuth 2.1을 구현하는 방법을 단계별로 살펴볼 것이다. Scalekit을 사용하여 간단한 금융 감성 분석 서버를 구축하고 이를 안전하게 보호하는 방법을 알아볼 것이다.

Datadog Cloud Security의 새로운 보안 기능을 통해 Amazon Bedrock 구성 오류를 사전에 감지하고 해결할 수 있습니다. 이 통합은 AI 보안을 클라우드 보안 전략에 통합하여 종합적인 AI 보안을 제공하고, 실시간 위험 감지를 통해 AI 관련 보안 문제를 식별하며, 사전 구축된 감지로 AI 규정을 준수하는 것을 단순화합니다.

대형 언어 모델이 단순 텍스트 생성기에서 계획 수립, 추론, 자율 조치가 가능한 시스템으로 진화함에 따라 능력과 관련 위험이 증가하고 있다. 기업들이 자동화를 위해 AI를 채택하면서 목표 불일치, 프롬프트 주입, 의도치 않은 행동, 데이터 누출과 같은 새로운 도전에 직면하게 된다.

SageMaker 통합 스튜디오와 AWS IAM을 사용하여 Amazon Bedrock 모델을 위한 견고한 권한 프레임워크를 설정하는 방법을 소개하며, 어드민이 안전하고 협업 가능한 환경 내에서 특정 모델에 누가 접근할 수 있는지 정확히 관리하는 방법을 안내합니다. 기업의 관리 시나리오에 대한 코드 예시와 함께 모델 접근을 제어하기 위한 세밀한 권한을 생성하는 방법을 안내합니다.

제너레이티브 AI가 취약성 식별을 자동화하고 포괄적인 공격 시나리오를 생성하며 맥락을 제공하는 방식으로 위협 모델링을 혁신할 수 있는 방법을 탐구합니다.

스쿠데리아 페라리 HP가 머신러닝을 활용해 정확한 피트스톱 분석 기술을 개발하는 방법을 소개하는 글.

Amazon Bedrock 에이전트는 간접 프롬프트 삽입에 대비하여 AI 상호작용을 안전하게 보호하는 보안 조치와 전략을 제공합니다.

Meta AI가 출시한 LlamaFirewall은 AI 에이전트의 보안 위험에 대응하기 위해 시스템 수준의 보안 계층을 제공하는 오픈 소스 가드레일 시스템이다.

이 게시물에서는 Amazon Bedrock를 사용하여 RAG 애플리케이션에서 민감한 데이터를 보호하기 위한 두 가지 접근 방식을 탐구합니다. 첫 번째 접근 방식은 Amazon Bedrock 지식 베이스로의 데이터 삽입 전 민감한 데이터를 식별하고 마스킹하는 데 초점을 맞추었으며, 두 번째는 민감한 정보에 대한 접근을 관리하기 위한 세밀한 RBAC 패턴을 시연했습니다. 이러한 솔루션은 생성 모델 AI 애플리케이션에서 민감한 데이터를 보호하기 위한 다양한 접근 방식 중 두 가지에 불과합니다.