기업은 애플리케이션에 안전한 임베드 챗을 구현하는 것이 어려운데, 이를 해결하기 위해 Quick Suite Embedding SDK를 사용한 챗 에이전트 임베드 솔루션을 제공한다.

기업은 애플리케이션에 안전한 임베드 챗을 구현하는 것이 어려운데, 이를 해결하기 위해 Quick Suite Embedding SDK를 사용한 챗 에이전트 임베드 솔루션을 제공한다.

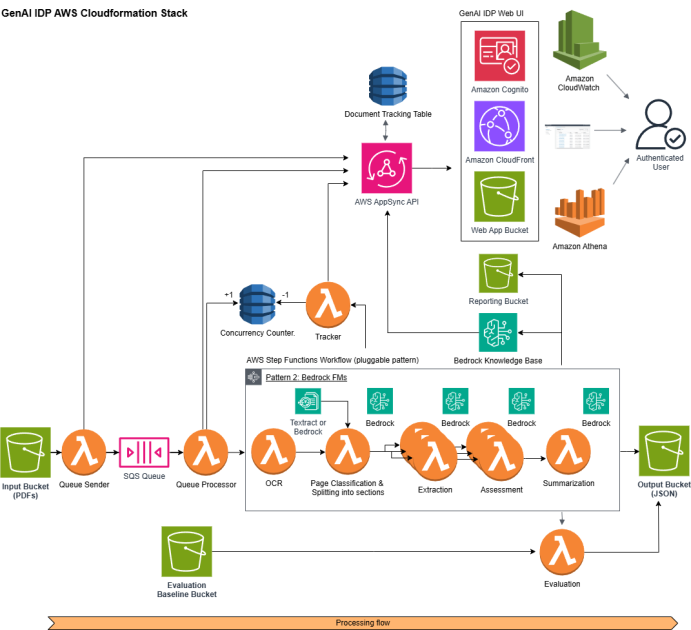

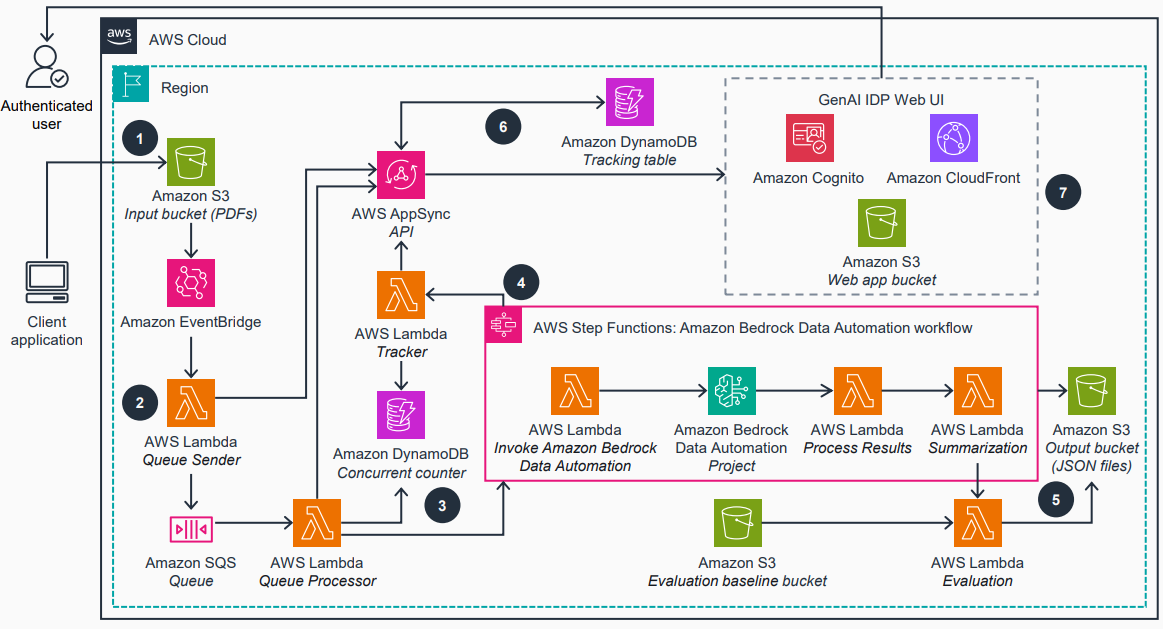

리코가 AWS GenAI IDP 가속기를 기반으로 자동 문서 분류 및 추출을 위한 표준화된 멀티 테넌트 솔루션을 구축하여 문서 처리를 사용자 정의 엔지니어링 병목 현상에서 확장 가능하고 반복 가능한 서비스로 변환하는 방법을 탐구합니다.

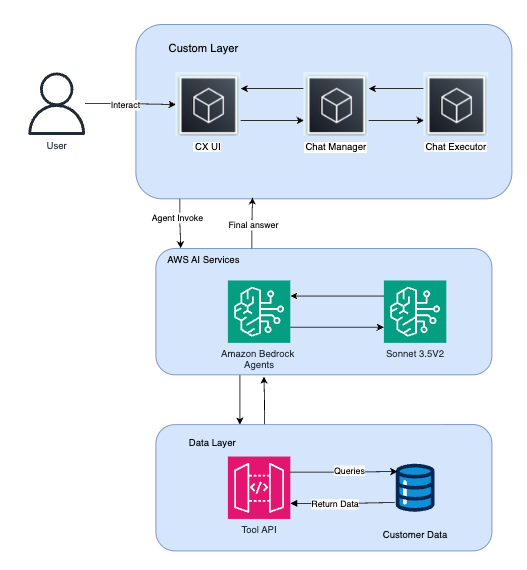

Lendi Group이 Amazon Bedrock을 활용해 AI 파워드 홈론 가디언을 만들었고, 구현된 아키텍처와 성과를 설명. 고객 경험을 변화시키는데 있어 유용한 통찰을 제공.

이 포스트는 Amazon Bedrock, LangGraph 및 Amazon SageMaker AI에서 관리되는 MLflow를 사용하여 지능적인 대화형 에이전트를 구축하는 방법에 대해 탐구합니다.

Liquid AI 팀이 발표한 LFM2-24B-A2B는 24억 개의 파라미터를 가진 모델로, 전력 소비 및 메모리 병목 현상의 한계에 부딪히는 산업에서, 파라미터 수보다 아키텍처 효율성에 대한 대화로 전환되고 있다.

이 게시물에서는 Amazon SageMaker 학습 작업에서 veRL과 Ray를 사용하여 경쟁 프로그래밍을 위한 특수화된 70억 개 파라미터 모델인 CodeFu-7B를 훈련하는 방법을 보여줍니다. 이를 통해 데이터 준비, 분산 훈련 설정 및 종합적인 관측성을 다루며, 이 통합된 방법이 복잡한 강화 학습 훈련 작업에 대해 계산 규모와 개발자 경험을 모두 제공하는 방법을 소개합니다.

이 포스트는 Amazon Bedrock을 사용할 때 응용 프로그램 신뢰성과 사용자 경험을 향상시킬 수 있는 강력한 오류 처리 전략을 구현하는 방법을 보여줍니다. 이 포스트에서는 이러한 오류에 대한 응용 프로그램의 성능 최적화 전략에 대해 깊이 파헤칩니다.

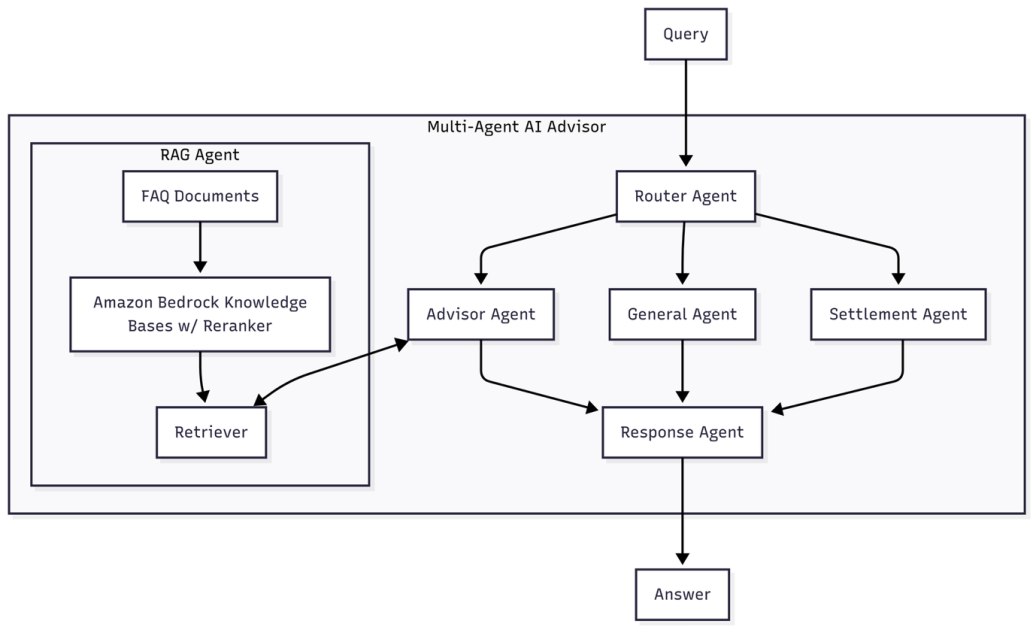

LinqAlpha는 보스턴 기반의 기관 투자자를 위해 구축된 다중 에이전트 AI 시스템으로, 기업 스크리닝, 프라이머 생성, 주가 촉진요인 매핑을 지원하며, 새로운 AI 에이전트 Devil’s Advocate를 통해 투자 아이디어를 압력 테스트하는 방법을 소개합니다.

아마존은 아마존 노바 모델을 활용하여 AI 기반 이미지 인식 솔루션을 구현하여 모듈 구성 요소의 감지 및 유효성 검사를 자동화하고 수동 확인 작업을 크게 줄이고 정확성을 향상시킵니다.

기업 LLM fine-tuning을 효율적이고 확장 가능한 솔루션으로 변화시키는 방법을 소개하며, 도메인 특화 응용 프로그램에서 더 나은 모델 성능을 달성하기 위한 것.

이 글에서는 Amazon Web Services (AWS) 계정에 Fullstack AgentCore Solution Template (FAST)를 배포하는 방법과 해당 아키텍처를 이해하는 방법, 그리고 요구 사항에 맞게 확장하는 방법을 알 수 있습니다. FAST를 사용하면 인증, 인프라 구성 (IaC), 배포 파이프라인 및 서비스 통합을 처리하면서 자체 에이전트를 구축하는 방법을 배울 수 있습니다.

Associa는 AWS Generative AI 혁신 센터와 협력하여 생성적 AI를 활용한 문서 분류 시스템을 구축했으며, 이를 통해 운영 효율성을 달성하는 장기적 비전을 실현하고 있습니다. 이 솔루션은 들어오는 문서를 고정도로 자동 분류하고 효율적으로 처리하여 운영 탁월성을 유지하면서 상당한 비용 절감을 제공합니다.

이 포스트에서는 AppSync 이벤트를 사용하여 능력있고 서버리스 AI 게이트웨이 아키텍처의 기반을 구축하는 방법에 대해 설명합니다. AWS 서비스와의 통합 방법을 탐색하여 AI 게이트웨이 아키텍처에서 제공되는 기능을 포괄적으로 다룹니다. 또한 샘플 코드로 여러분의 계정에서 시작할 수 있도록 안내합니다.

Totogi가 AWS Generative AI Innovation Center와 협력하여 Amazon Bedrock의 신속한 혁신 능력을 활용하여 변경 요청 처리를 자동화하는 방법에 대해 설명합니다.

아마존 카탈로그팀이 아마존 베드락을 활용해 대규모 시스템을 구축하여 정확도를 지속적으로 향상시키고 비용을 줄이는 자기 학습 시스템을 소개합니다.

톰슨 로이터의 플랫폼 엔지니어링팀이 수동 시스템에서 자동화된 에이전틱 시스템으로 전환하여 운영 생산성을 향상시키는 방법에 대해 설명합니다.

본문에서는 Strands 에이전트, Meta의 Llama 4 모델 및 Amazon Bedrock을 사용하여 다중 에이전트 비디오 처리 워크플로우를 구축하는 방법을 탐구하며, 전문화된 AI 에이전트들이 협력하여 비디오 콘텐츠를 자동으로 분석하고 이해하는 방법을 살펴봅니다. 이 솔루션을 소개하기 위해 Amazon SageMaker AI를 사용하여 코드를 안내할 것입니다.

아마존에서의 세밀 조정 기술을 통해 위험한 약물 오류가 33% 감소하고, 인간 노력이 80% 감소하며, 콘텐츠 품질 평가가 77%에서 96%까지 향상되는 방법에 대해 소개하고 있습니다. 이를 위해 지도 세밀 조정(SFT), PPO, DPO, GRPO, DAPO, GSPO 등의 기술을 상세히 설명하고 있습니다.

이 게시물은 Amazon Bedrock를 사용한 생성적 AI 가이드 비즈니스 보고 솔루션을 소개하며, 비즈니스에 대한 성과 및 도전과제를 작성하는 데 초점을 맞춰 내부 커뮤니케이션과 보고를 간소화하고 가속화하는 스마트하고 실용적인 솔루션을 제공합니다.

본문에서는 양자화 모델이 Amazon SageMaker AI에 어떻게 원활하게 배포되는지 살펴봅니다. 양자화는 추론 비용을 낮추고 자원이 제한된 하드웨어에 배포를 지원하며, 현대 LLM의 금융 및 환경적 영향을 줄이면서 대부분의 성능을 유지하는 방법을 탐구합니다. PTQ의 원리에 대해 심층적으로 살펴보고 선택한 모델을 양자화하고 Amazon SageMaker에 배포하는 방법을 시연합니다.

AWS와 Instituto de Ciência e Tecnologia Itaú (ICTi) 간의 전략적 과학적 파트너십을 통해 개발된 이 게시물은 텍스트와 오디오에 대한 감성 분석의 기술적 측면을 탐구합니다. 여러 ML 모델 및 서비스를 비교하고 각 접근 방법의 트레이드오프와 함정을 논의하며 AWS 서비스가 어떻게 조합되어 견고하고 완결된 솔루션을 구축할 수 있는지 강조합니다. 또한 대형 언어 모델 (LLM)을 위한 더 고급화된 프롬프트 엔지니어링과 텍스트 데이터만으로는 놓칠 수 있는 감정적 단서를 포착하기 위해 오디오 기반 분석 범위를 확대하는 가능한 미래 방향에 대한 통찰을 제공합니다.

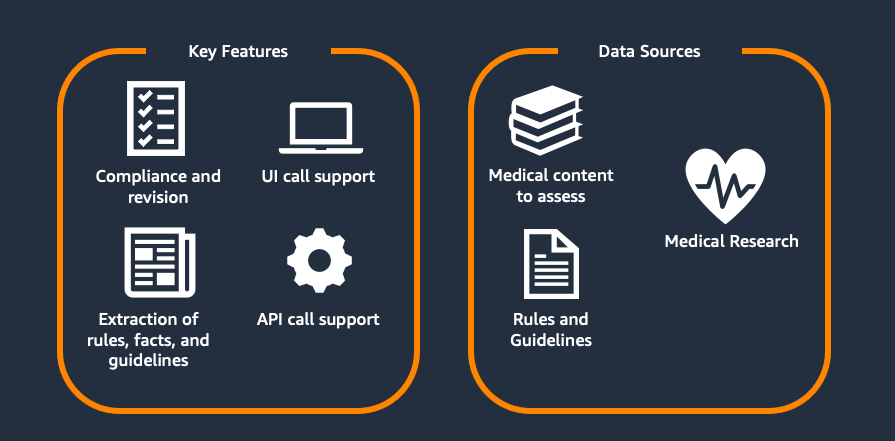

Flo Health의 의료 콘텐츠 검토에 대한 AI 적용 여정을 다룬 이 두 파트 시리즈 중 첫 번째 파트는 PoC를 살펴봅니다. 초기 솔루션, 능력 및 초기 결과를 포함한 내용을 다루며, 두 번째 파트에서는 확장 과제와 현실 세계 적용에 중점을 둡니다.

이 게시물은 Amazon Bedrock 및 Amazon Bedrock Knowledge Bases를 사용하여 AI 기반 웹사이트 어시스턴트를 구축하는 방법을 보여줍니다.

이 포스트에서는 Strands SDK, Amazon Bedrock AgentCore, Amazon Bedrock Knowledge Base 및 Bedrock Data Automation(BDA)를 활용하여 IDP 솔루션을 프로그래밍적으로 생성하는 방법을 탐구합니다. 사용자들이 Jupyter 노트북을 통해 다중 모달 비즈니스 문서를 업로드하고 BDA를 사용하여 관련 청크를 검색하고 FM에 프롬프트를 보강하는 파서로 사용하는 솔루션을 제공합니다.

Amazon SageMaker AI에서 BentoML의 LLM-Optimizer를 사용하여 대형 언어 모델(Large Language Model, LLM) 추론을 최적화하는 방법을 소개하고, 워크로드에 최적화된 서빙 구성을 체계적으로 식별하는 방법을 보여줍니다.

dLocal은 AWS 팀과 긴밀히 협력하여 제품 로드맵을 구상하고 산업 혁신가로서의 역할을 강화하며 글로벌 핀테크 분야의 운영 우수성에 대한 새로운 기준을 설정했습니다.

이 포스트는 Zoom AI Research 논문 ‘Chain of Draft: Thinking Faster by Writing Less’에서 소개된 혁신적인 프롬프팅 기술인 Chain-of-Draft (CoD)를 탐구하며, 모델이 추론 작업에 접근하는 방식을 혁신적으로 변화시키는 방법을 살펴봅니다. 체인 오브 씨오트 (CoT) 프롬프팅이 모델 추론을 향상시키는 데 사용되어 왔지만, CoD는 인간의 문제 해결 패턴을 모방하여 간결하고 신호가 강한 사고 단계를 사용하는 더 효율적인 대안을 제공합니다.

이 포스트에서는 vLLM과 Bring Your Own Container (BYOC) 접근 방식을 사용하여 Amazon SageMaker AI 엔드포인트에 Voxtral 모델을 호스팅하는 방법을 보여줍니다. vLLM은 대규모 언어 모델(LLM)을 제공하는 고성능 라이브러리로, 향상된 메모리 관리를 위한 페이지드 어텐션과 여러 GPU에 걸쳐 모델을 분산하는 텐서 병렬성을 특징으로 합니다.

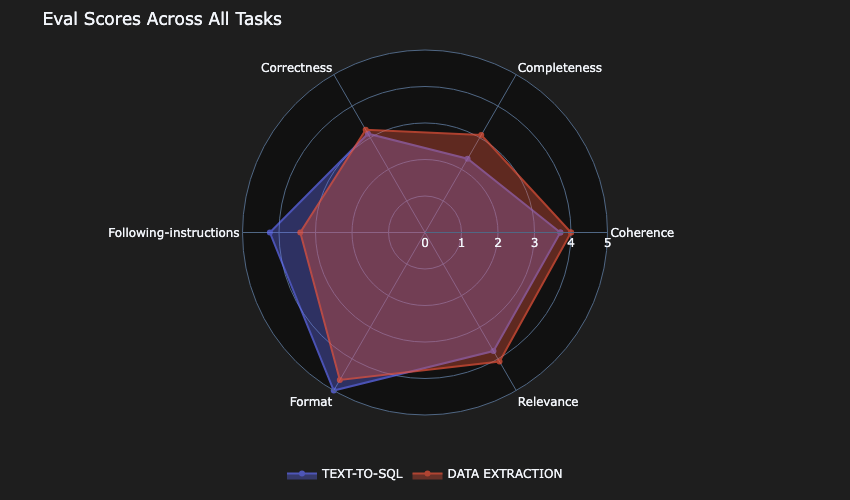

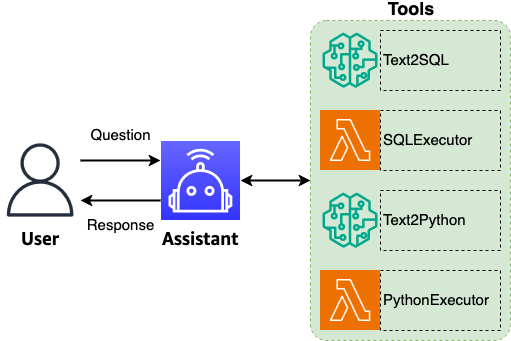

GenAI IDP 가속기에 통합된 새로운 기능 Analytics Agent를 소개합니다. 사용자는 SQL 또는 데이터 분석 전문 지식 없이 자연어 쿼리를 사용하여 고급 검색과 복잡한 분석을 수행할 수 있습니다. 이 기능을 통해 비전문가도 대규모로 처리한 문서를 자연어로 분석하고 이해할 수 있습니다.

이 글에서는 Amazon Bedrock에서 Foundation Models (FMs)을 활용하여 예측 정비 솔루션을 구현하는 방법과, 아마존의 제조 장비를 사례로 들어 그 활용성을 보여줍니다. 이 솔루션은 유연하며 다른 산업에 맞게 맞춤화할 수 있습니다.

이 두 파트 시리즈의 첫 번째에서 기존의 데브옵스 아키텍처를 발전시키고 생성 모델 AI 워크로드를 위한 GenAIOps 실천 방법을 구현하는 방법을 배웁니다. 다양한 생성 모델 AI 채택 수준에 대한 실용적인 구현 전략을 소개하며, 기초 모델 소비에 초점을 맞춥니다.

Harmonic Security가 Amazon SageMaker AI, Amazon Bedrock 및 Amazon Nova Pro를 활용하여 ModernBERT 모델을 세밀하게 조정하여 저지연, 정확하고 확장 가능한 데이터 누출 감지를 달성하는 방법에 대한 내용입니다.

이 포스트에서는 CRM 시스템 및 데이터베이스 간의 데이터 통합, 규제 준수를 위한 설명 가능하고 감사 가능한 AI 결정 제공, 일관된 보험 가입 규칙으로 자동 사기 탐지를 가능케 하는 지능형 보험 가입자 에이전트를 구축하는 방법을 소개합니다. 이 솔루션은 투명한 위험 평가를 위한 Amazon Nova 2 Lite, 관리형 MCP 서버 인프라를 위한 Amazon Bedrock AgentCore, 자연어 상호작용을 위한 Amazon Quick Suite를 결합하여 30분 이내에 배포할 수 있는 생산 준비 시스템을 제공합니다.

Myriad Genetics는 AWS Generative AI 혁신 센터와 협력하여 Amazon Bedrock 및 Amazon Nova foundation 모델을 활용해 건강 관련 문서 처리 파이프라인을 개선했으며, 98%의 분류 정확도를 달성하고 비용을 77% 줄이고 처리 시간을 80% 단축했다. AWS의 오픈소스 GenAI Intelligent Document Processing Accelerator를 사용한 기술적 구현과 문서 분류 및 핵심 정보 추출에 대한 최적화 전략, 그리고 Myriad의 사전 승인 업무에 미친 실제 비즈니스 영향을 상세히 설명한다.

Condé Nast가 Amazon Bedrock과 Anthropic의 Claude를 활용하여 계약 처리와 권리 분석 업무를 가속화하는 방법을 탐구한다. 다수의 브랜드와 지역을 아우르는 회사의 포트폴리오는 점점 복잡해지는 계약, 권리, 라이선싱 계약을 관리해야 했다.

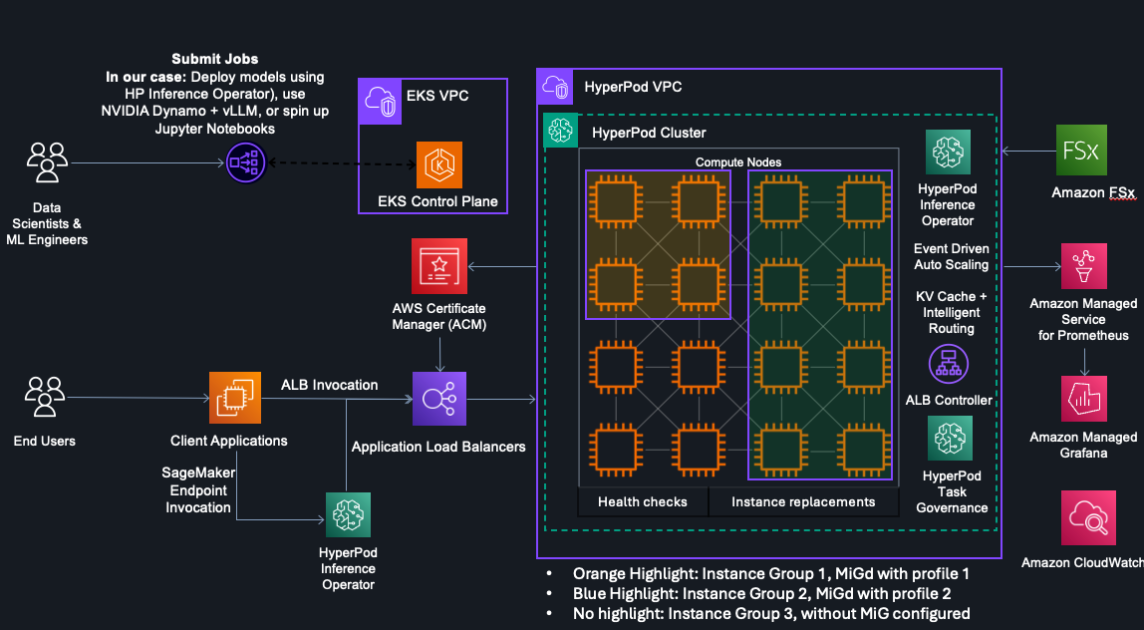

Amazon SageMaker HyperPod가 NVIDIA Multi-Instance GPU(MIG) 기술을 지원함으로써 강력한 GPU를 여러 격리된 인스턴스로 분할하여 추론, 연구, 상호작용 개발과 같은 동시 작업을 실행할 수 있게 되었습니다. GPU 활용도를 극대화하고 낭비되는 자원을 줄이는 MIG는 기업이 다양한 머신러닝 작업에서 성능 격리와 예측 가능한 서비스 품질을 유지하면서 비용을 최적화할 수 있도록 도와줍니다.

이 블로그 포스트에서는 에이전트 워크플로우가 자연어 인터페이스를 활용하여 규모 확장 가능한 유전체 파이프라인의 처리 및 해석을 가속화하는 방법을 소개합니다. 우리는 자동화된 데이터 처리와 지능적 분석을 결합한 포괄적 유전체 변이 해석기 에이전트를 시연하여, 원시 VCF 파일 수용부터 대화형 쿼리 인터페이스까지 전체 워크플로우를 다룹니다.

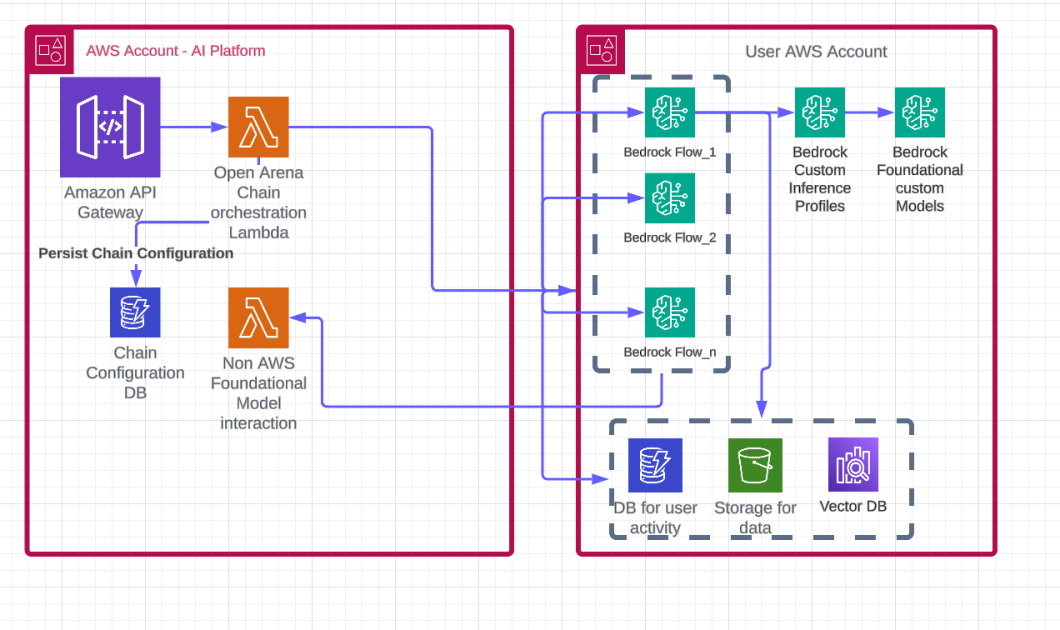

플랫폼 엔지니어링 원칙을 생성 AI에 적용하여 가치 실현 시간 단축, 비용 통제, 확장 가능한 혁신을 어떻게 가능케 하는지에 대해 설명합니다.

MBZUAI의 연구진이 PAN이라는 새로운 모델을 소개했다. 이 모델은 시간이 지남에 따라 도착하는 작업에 따라 지속되는 내부 세계 상태를 유지하지 않는 대부분의 텍스트에서 비디오 모델과는 달리, 상호작용 가능한 일반적인 세계 모델로 작용하도록 설계되었다.

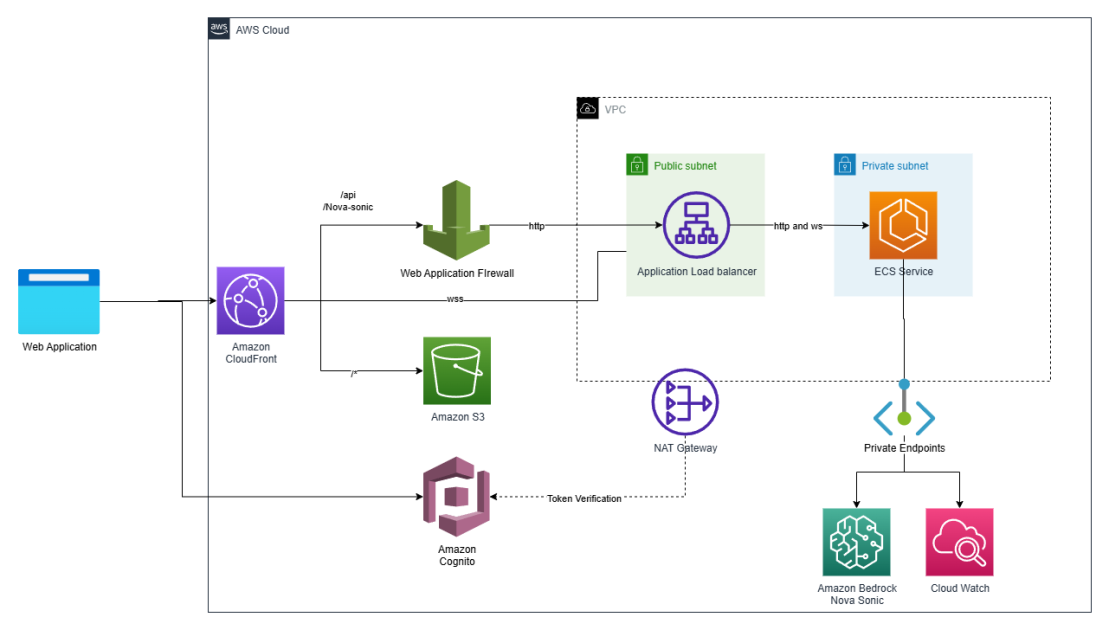

그래픽 사용자 인터페이스는 수십 년 동안 발전해 왔지만, 오늘날 사용자들은 점점 애플리케이션과 대화를 주고받기를 원합니다. 이 글에서는 루틴 작업 관리를 유동적이고 무선으로 전환하는 참조 애플리케이션인 스마트 할 일 앱에 진정한 음성 중심 경험을 추가하는 방법을 소개합니다.

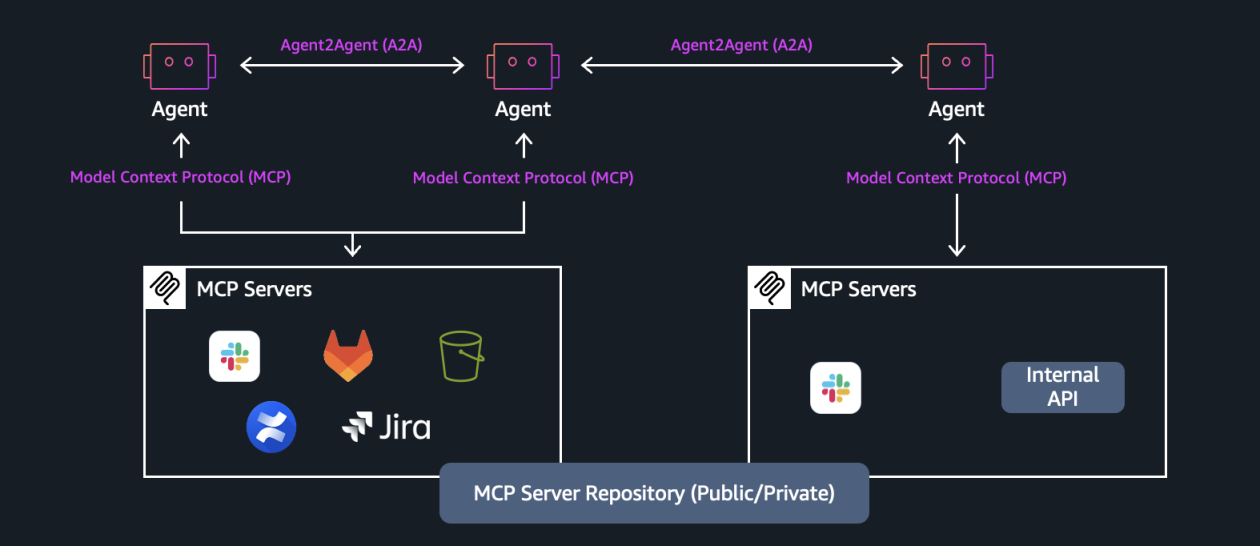

이 블로그에서는 서로 다른 프레임워크로 구축된 AI 에이전트가 원활하게 협업할 수 있는 A2A 프로토콜을 어떻게 사용하는지를 보여줍니다. AgentCore 런타임에 A2A 서버를 배포하는 방법, 에이전트 검색 및 인증 구성, 사건 대응을 위한 실제 멀티 에이전트 시스템 구축 방법 등을 학습할 수 있습니다.

톰슨 로이터가 아마존 베드락과 같은 AWS 서비스로 구동되는 노코드 AI 솔루션인 오픈 아레나를 통해 핵심 비즈니스 사례를 해결하는 방법을 탐구합니다. 아키텍처 설계부터 사용 사례와 사용자 프로필까지 설명합니다.

Amazon Bedrock의 Custom Model Import에 구조화된 출력이 추가되었습니다. 구조화된 출력은 모델의 생성 프로세스를 실시간으로 제한하여 생성되는 모든 토큰이 사용자가 정의한 스키마와 일치하도록합니다. prompt-engineering 트릭이나 후속 처리 스크립트 대신 이제 추론 시에 직접 구조화된 출력을 생성할 수 있습니다.

2024년, AWS Generative AI 혁신 센터 내 Custom Model 프로그램을 시작하여 모델 맞춤화 및 최적화 과정 전반에서 포괄적인 지원을 제공했다. 이 프로그램은 지난 2년간 글로벌 기업 및 스타트업과 협력하여 법률, 금융 서비스, 헬스케어 및 생명 과학 분야를 포함한 다양한 산업에서 탁월한 결과를 이끌어냈다.

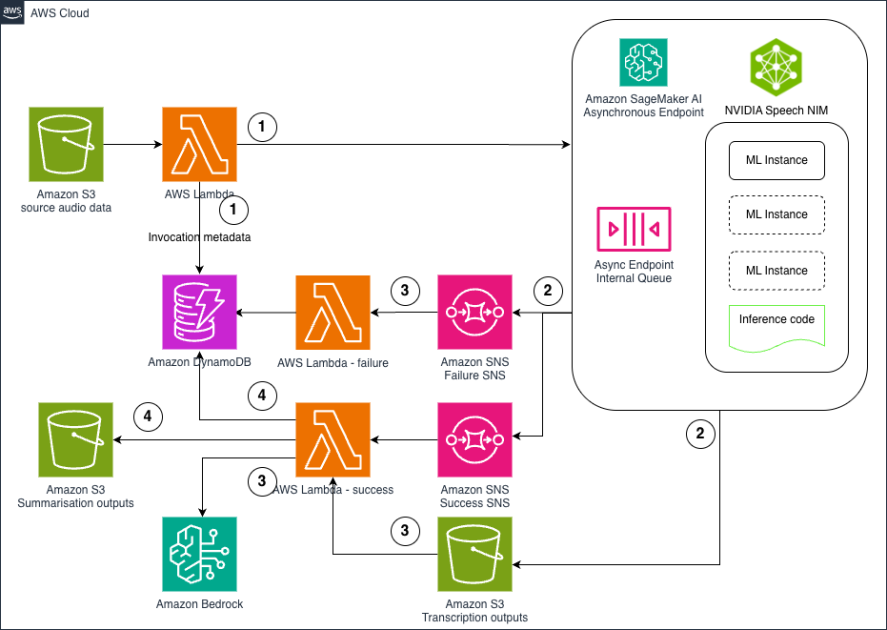

이 포스트에서는 Amazon SageMaker AI에 NVIDIA의 Parakeet ASR 모델을 배포하는 방법을 탐구하며 비동기 추론 엔드포인트를 사용하여 대량의 오디오 데이터를 처리하는 확장 가능하고 비용 효율적인 파이프라인을 만드는 방법을 살펴봅니다. 이 솔루션은 최신 음성 인식 능력과 Lambda, S3, Bedrock 같은 AWS 관리형 서비스를 결합하여 오디오 파일을 자동으로 변환하고 지능적인 요약을 생성하여 기업이 고객 통화, 회의 녹음 및 기타 오디오 콘텐츠에서 가치 있는 통찰력을 대규모로 끌어낼 수 있습니다.

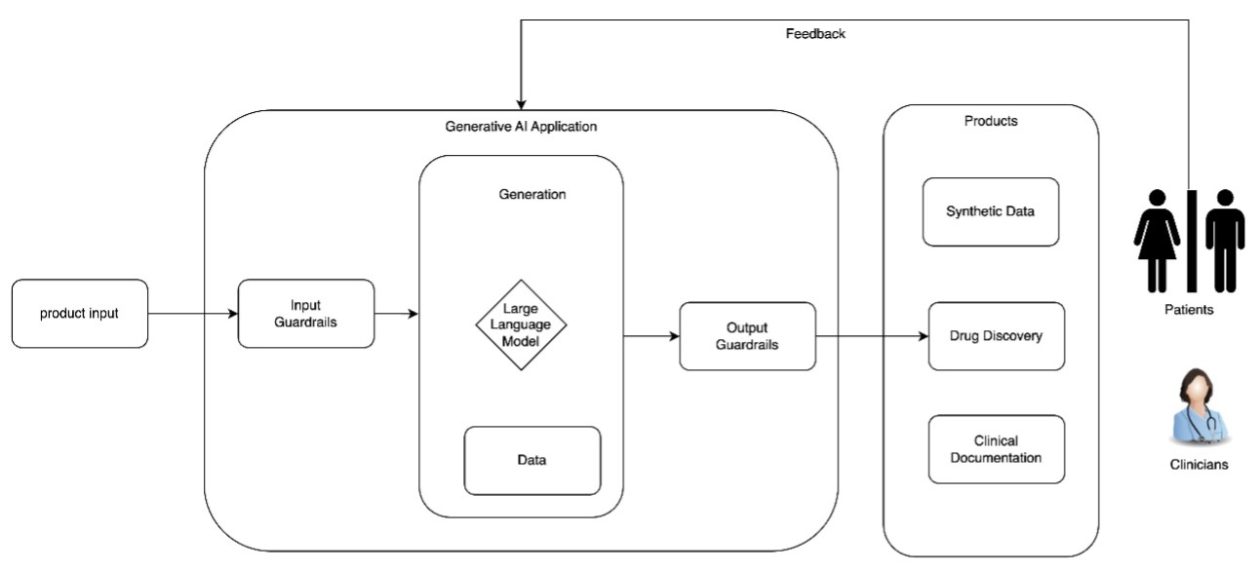

의료 및 생명 과학 분야에서 책임 있는 AI 시스템을 구축하기 위한 중요한 설계 고려 사항을 탐구하며, 건강한 AI 응용 프로그램의 안전하고 효과적인 보장을 위해 거버넌스 메커니즘, 투명성 아티팩트 및 보안 조치에 초점을 맞춥니다. 이 글은 오류와 편향과 같은 위험을 완화하기 위한 필수 정책들을 다루며, AI 개발 수명 주기 전반에 걸쳐 신뢰, 책임, 환자 안전을 증진합니다.

AWS Generative AI 혁신 센터의 고객 프로젝트 중 65%가 성공적으로 컨셉에서 상용화로 전환되는 데 도움을 준 Five V’s Framework를 소개한다. 이 프레임워크는 가치, 시각화, 유효성 검증, 검증, 벤처 단계를 통해 구조화된 접근을 제공하며, “AI가 무엇을 할 수 있는가?”에서 “우리가 AI에게 무엇을 필요로 하는가?”로 초점을 옮기면서 솔루션이 측정 가능한 비즈니스 결과와 지속 가능한 운영 우수성을 제공하도록 한다.

기업이 창의적 AI 프로젝트 우선 순위 결정 방법론에 책임 있는 AI 실천을 체계적으로 통합하는 방법을 탐색하며 비즈니스 가치와 비용을 평가하고 환각 및 규제 준수와 같은 새로운 위험을 해결함에 있어서 어떻게 더 나은 결과를 얻을 수 있는지 살펴봅니다. 이 글은 실제 예시를 통해 미리 책임 있는 AI 위험 평가를 수행함으로써 프로젝트 순위를 크게 바꿀 수 있음을 보여줍니다.

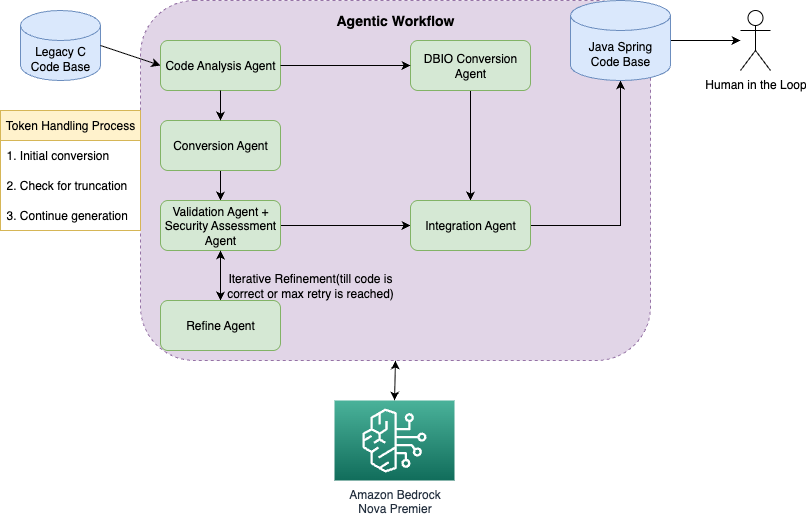

Amazon Nova Premier 및 Amazon Bedrock을 활용하여 레거시 C 코드를 현대적인 Java/Spring 애플리케이션으로 체계적으로 이관하는 방법을 소개합니다. 복잡한 변환 작업을 전문적인 에이전트 역할로 분해하는 지능적인 워크플로우를 통해 마이그레이션 시간과 비용을 절감하고 자동 검증, 보안 평가, 반복적 개선 과정을 통해 코드 품질을 향상시킵니다.

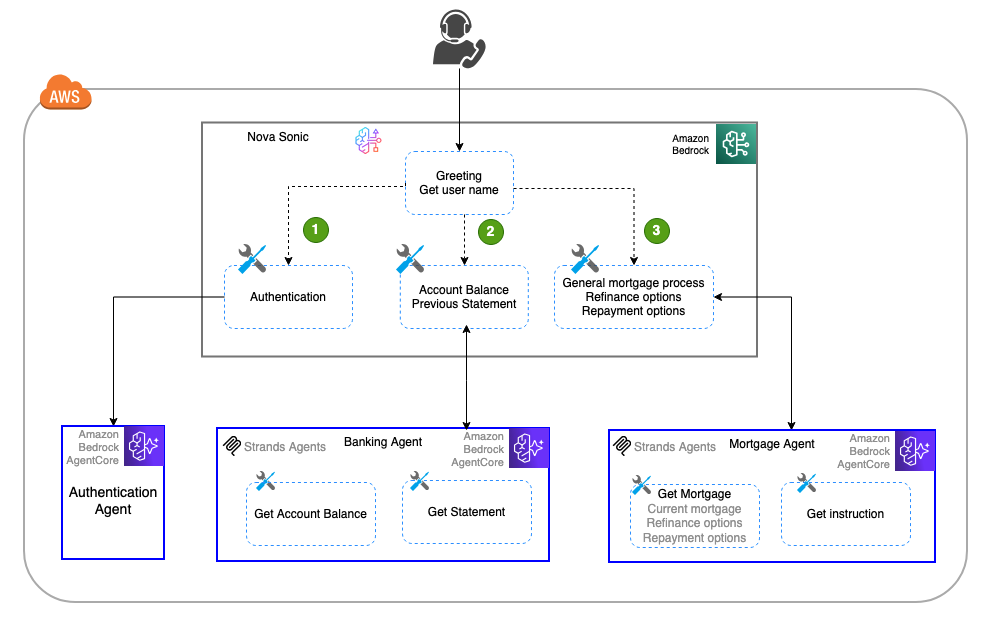

Amazon Nova Sonic의 음성 대 음성 기능과 Amazon Bedrock AgentCore를 결합하여 복잡한 작업을 전문화된 관리 가능한 구성 요소로 분할하는 정교한 다중 에이전트 음성 보조 프로그램을 만드는 방법을 탐구합니다. 이 접근 방식은 전문화된 인증, 은행 문의 및 모기지 서비스를 위한 전용 하위 에이전트를 사용하는 은행 보조 프로그램 예제를 통해 모노리딕 음성 보조 프로그램 설계에 대안을 제공합니다.

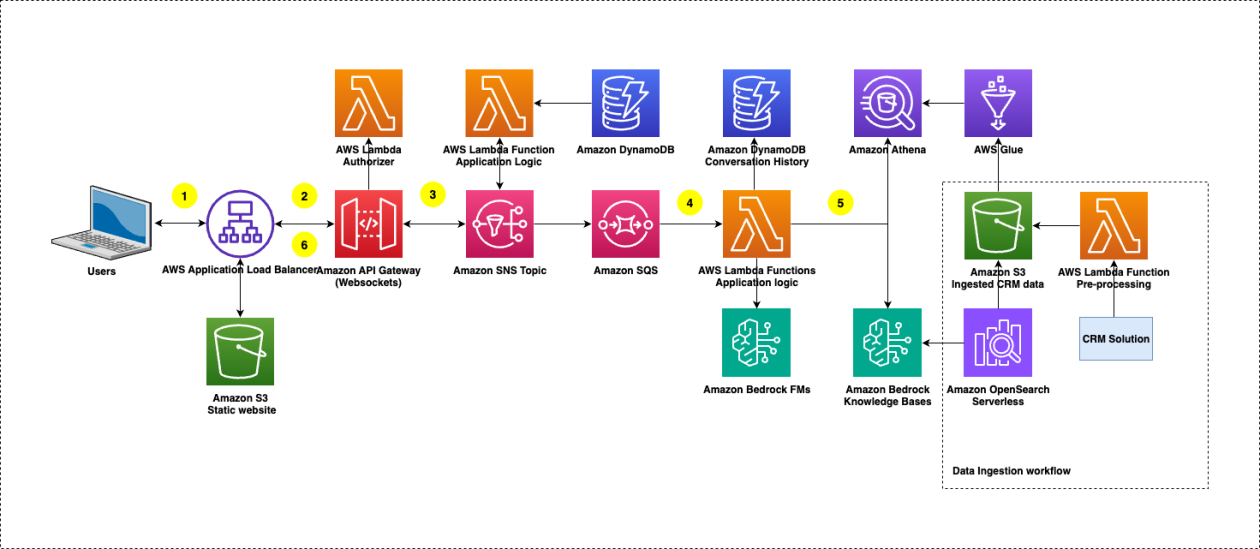

TP ICAP가 Amazon Bedrock Knowledge Bases와 Amazon Bedrock Evaluations을 활용하여 ClientIQ를 구축했고, AI를 사용하여 CRM 통찰을 추출하고 즉각적인 비즈니스 가치를 전달하는 기업용 솔루션을 개발한 과정을 소개합니다.

해당 포스트에서는 올바른 모델을 선택할 때 도움이 되는 종합적이고 경험적인 평가를 구축하는 방법에 대해 논의합니다.

아마존 노바 소닉과 AWS 서비스를 이용한 QSRs 드라이브 스루 솔루션 구현 방법을 소개합니다. 음성 AI와 대화형 메뉴 디스플레이를 결합한 지능형 시스템을 구축하는 방법을 상세히 안내하여 음식점이 드라이브 스루 운영을 현대화할 수 있도록 지원합니다.

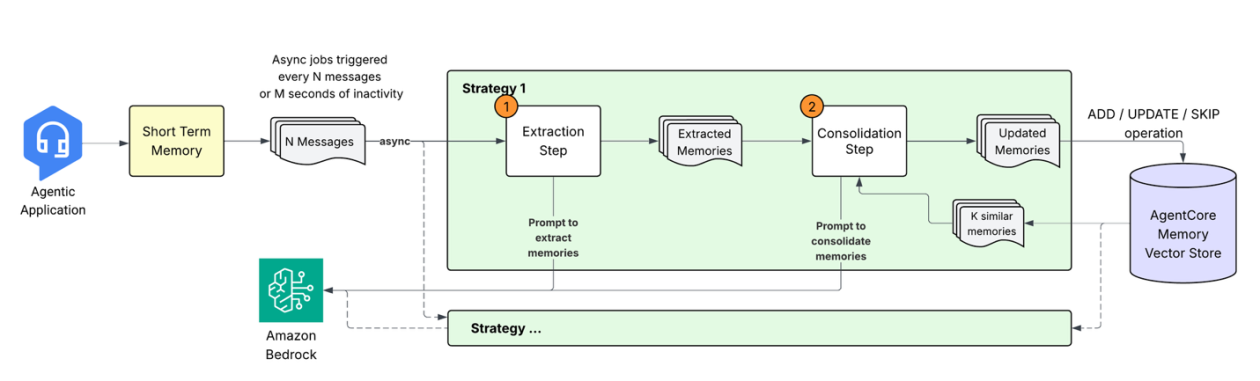

아마존 베드락 AgentCore Memory가 어떻게 원시 대화 데이터를 인간의 인지 프로세스를 모방하는 정교한 추출, 통합 및 검색 메커니즘을 통해 지속적이고 실질적인 지식으로 변환시키는지 살펴봅니다. 이 시스템은 대화를 저장하는 것뿐만 아니라 의미 있는 통찰력을 추출하고, 시간을 초월하여 관련 정보를 병합하며, 일관된 기억 저장소를 유지하여 진정한 맥락을 인식하는 상호작용을 가능케 합니다.

금융 서비스 회사가 FM을 사용하여 대량의 고객 레코드를 처리하고 데이터 기반 제품 추천을 얻는 방법을 소개하며, Amazon Bedrock 배치 추론 작업을 위한 자동 모니터링 솔루션 구현하는 방법을 안내합니다.

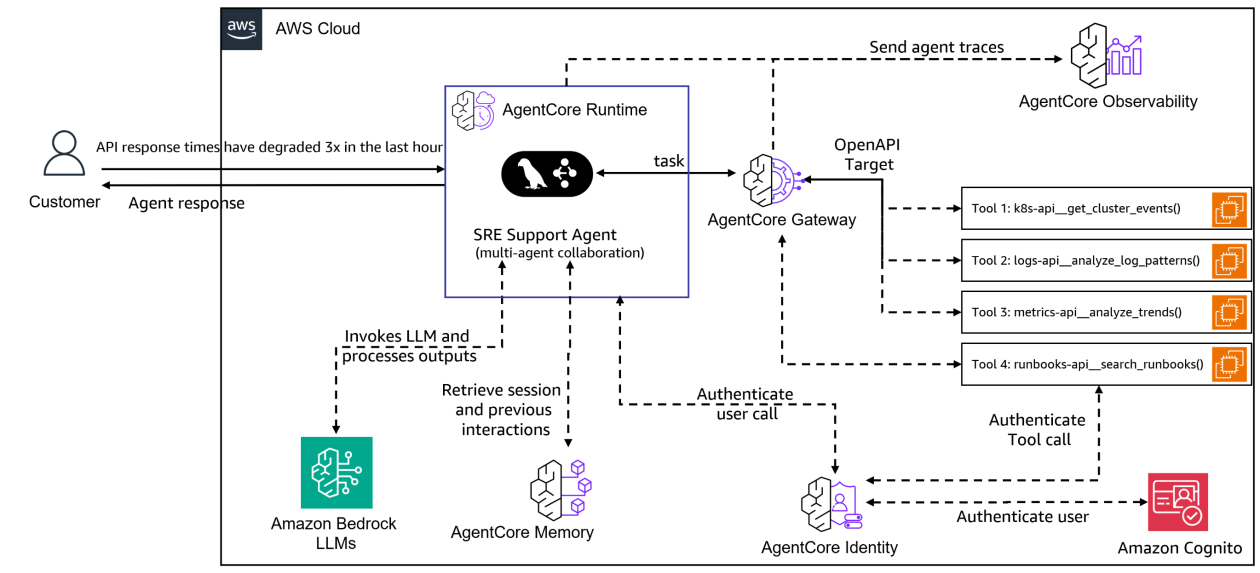

Amazon Bedrock AgentCore, LangGraph 및 MCP를 사용하여 멀티 에이전트 SRE 어시스턴트를 구축하는 방법을 소개합니다. 이 시스템은 특화된 AI 에이전트를 배치하여 현대 SRE 팀이 효과적인 사고 대응과 인프라 관리를 위해 필요로 하는 깊이 있는 문맥적 지능을 제공합니다.

PropHero는 Amazon Bedrock을 활용해 다양한 요소를 고려한 부동산 투자 조언을 제공하는 AI 시스템을 구축했다. 에이전트 아키텍처, 모델 선택 전략, 그리고 품질 대화를 위한 평가 시스템을 탐구하며 빠른 개선을 가능케한다.

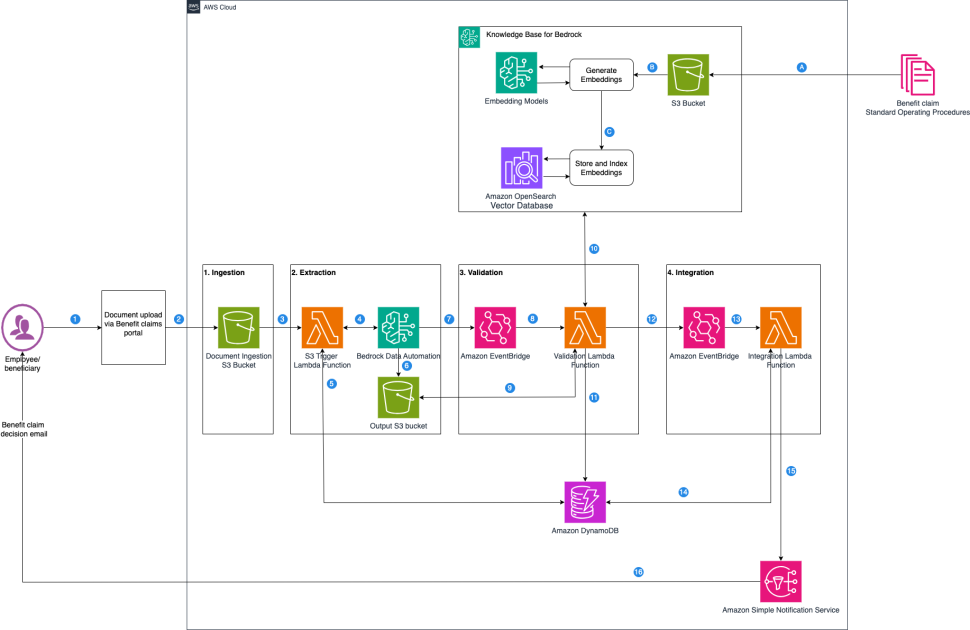

혜택 관리 업계에서 청구 처리는 직원과 수혜자가 건강, 치과, 장애 지급과 같은 혜택을 시간 내에 받을 수 있도록 보장하고, 비용을 통제하며 HIPAA 및 ERISA와 같은 규정을 준수하는 중요한 operation pillar이다. 이 글에서는 일반적인 혜택 청구 처리 워크플로우를 검토하고, 생성 모델을 활용한 자동화가 가장 큰 영향을 줄 수 있는 지점을 식별한다.

Deep Agents 프레임워크를 사용하여 심층 AI 에이전트를 구축하고 협업하여 복잡한 문제를 해결하는 능력을 부여함. 그러나 이에 대한 도전은 이러한 에이전트를 구축하는 것뿐만 아니라…

Stability AI의 Alex Gnibus와 함께 작성된 이 게시물에서 Stability AI 이미지 서비스가 Amazon Bedrock에서 이용 가능하며, Amazon Bedrock API를 통해 제공되는 사용 준비가 완료된 미디어 편집 기능을 제공합니다. 이 이미지 편집 도구는 Stability AI의 Stable Diffusion 3.5 모델(SD3.5) 및 Stable Image Core 및 Ultra 모델의 기능을 확장합니다.

Amazon Bedrock는 이제 안정성 AI 이미지 서비스를 제공하는데, 비즈니스가 이미지를 생성하고 수정하는 방법을 개선하는 9가지 도구를 제공한다. 이 기술은 Stable Diffusion 및 Stable Image 모델을 확장하여 이미지 생성 및 편집에 대해 정밀한 제어를 제공한다. 명확한 유도는 AI 시스템에 예술적 방향을 제공하는 데 중요하다. 강력한 유도는 톤과 같은 특정 요소를 제어한다.

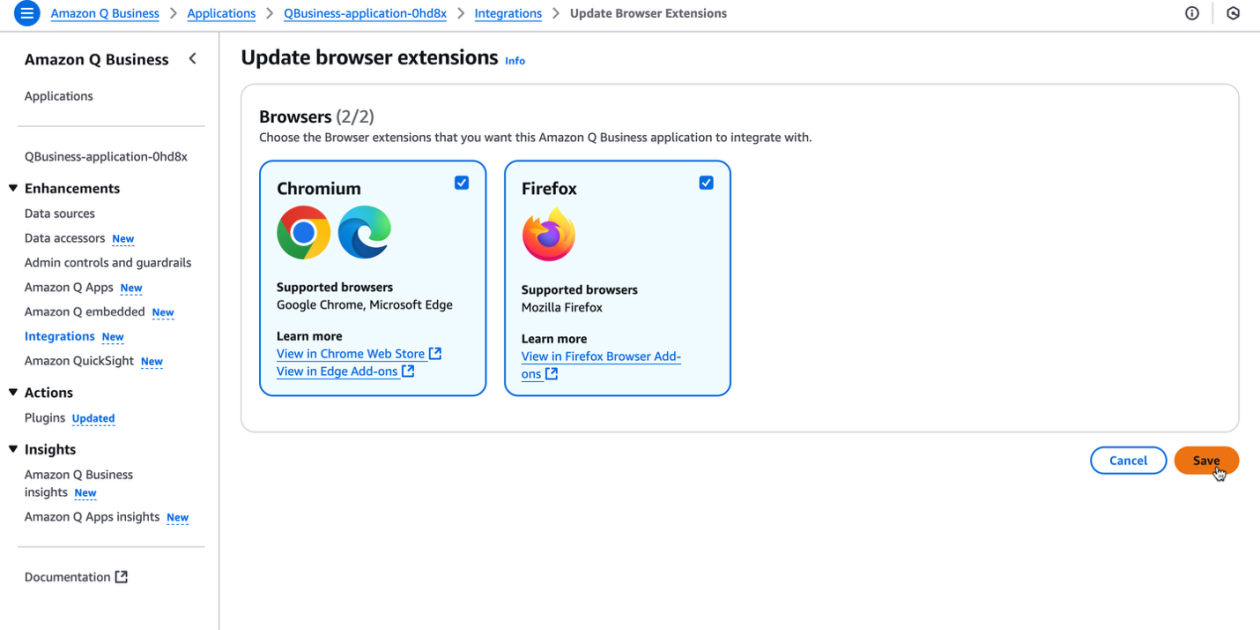

아마존 Q 비즈니스 브라우저 익스텐션을 통해 AI 기반 통찰력과 지원에 팀이 매끄럽게 접근하는 방법을 소개했습니다. 브라우저 익스텐션은 이제 라이트 구독의 일환으로 미국 동부(버지니아 북부) 및 미국 서부(오리건) AWS 지역에서 모질라, 구글 크롬, 마이크로소프트 엣지에서 사용할 수 있습니다.

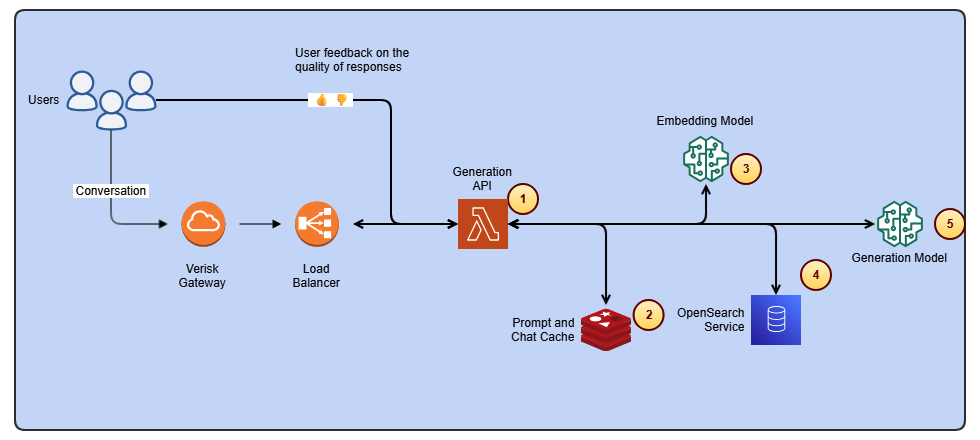

Verisk Rating Insights와 Amazon Bedrock이 함께하는 큰 언어 모델 및 RAG 기술로, 고객들이 ISO ERC 변경 사항에 상호 작용하고 접근하는 방식이 혁신적으로 변화하고 있다.

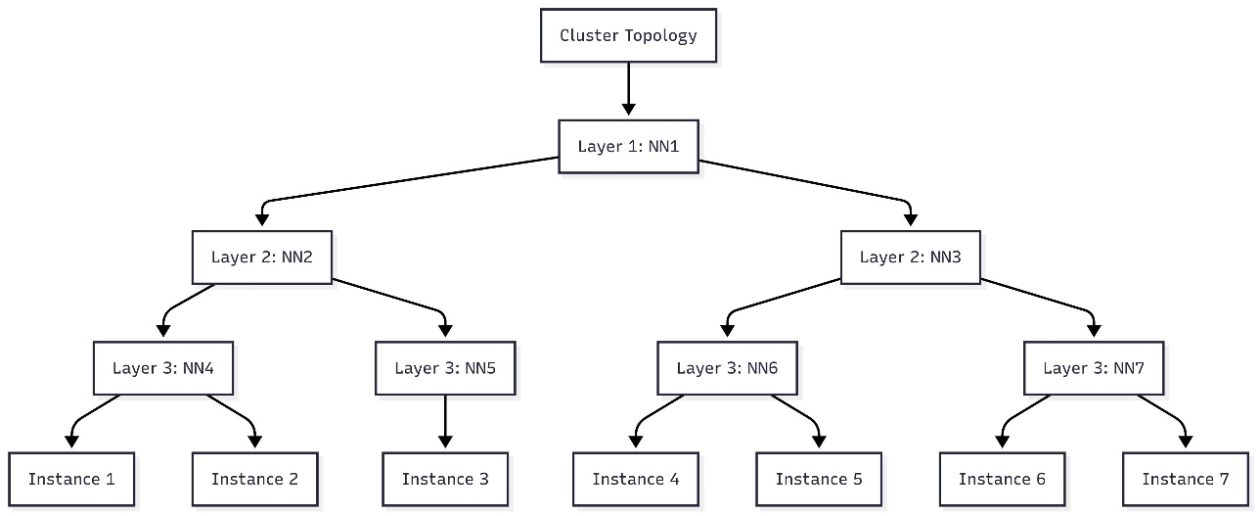

SageMaker HyperPod 작업 관리를 사용하여 토폴로지 인식 스케줄링을 소개하고 계층적 네트워크 정보를 나타내는 작업을 제출함으로써 작업을 최적화하는 방법에 대한 세부 정보를 제공합니다.

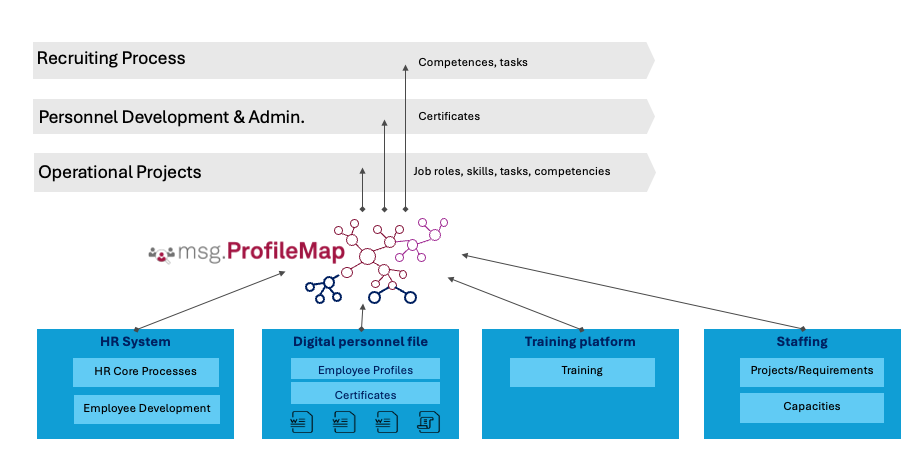

msg는 Amazon Bedrock를 사용하여 msg.ProfileMap의 데이터 조화화를 자동화했고, 이를 통해 HR 개념 일치의 정확성이 향상되었으며 수동 작업 부하가 줄어들고, EU AI 법과 GDPR의 규정 준수가 강화되었습니다.

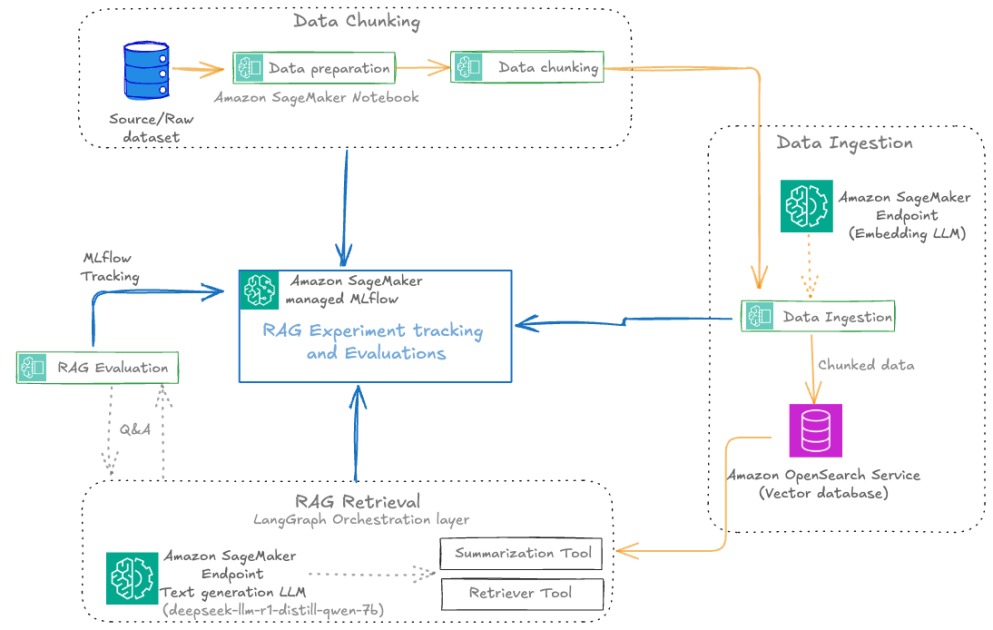

이 글에서는 Amazon SageMaker AI를 사용하여 RAG 개발 생명주기를 실험부터 자동화까지 한 과정으로 간소화하는 방법을 안내하며, 팀이 효율적으로 실험하고 효과적으로 협업하여 지속적인 개선을 이끌어내는 데 도움이 됩니다.

기업의 운영과 혁신을 변화시키는 생성 AI로 인해 AI 모델의 교육 및 배포를 위한 인프라 수요가 급증하고 있다. 전통적인 인프라 방식은 현대 AI 워크로드의 계산 요구, 네트워크 요구, 내구성 요구와 맞춰가기 어렵다. AWS는 기술 분야에서 변화를 경험하고 있으며 AI 인프라 도전 과제에 대응하고 있다.

AWS는 Amazon SageMaker HyperPod에서 관리형 계층형 체크포인팅을 발표했는데, 이는 수천 개의 AI 가속기를 통해 생성 AI 모델 개발을 확장하고 가속화하기 위한 목적으로 만들어진 인프라이다. CPU 메모리를 사용하여 고성능 체크포인트 저장 및 인접한 컴퓨팅 노드 간 자동 데이터 복제를 통해 신뢰성을 향상시킨다.

HyperPod 작업 관리 기능을 사용하여 고객은 Amazon Elastic Kubernetes Service (Amazon EKS)에서 Amazon SageMaker HyperPod 클러스터 활용을 최적화하고 공정한 사용을 분배하며 다른 팀 또는 프로젝트 간에 효율적인 리소스 할당을 지원할 수 있습니다.

Skai는 AI 기반의 옴니채널 광고 및 분석 플랫폼으로, 브랜드와 기관이 검색, 소셜, 소매 미디어 시장 및 기타 “벽돌 정원” 채널을 통해 유료 미디어를 계획, 출시, 최적화 및 측정할 수 있도록 설계되었다. Skai가 Amazon Bedrock 에이전트를 활용하여 데이터 접근과 분석을 개선하고 고객 인사이트를 향상시킨 방법에 대해 소개한다.

Amazon Nova를 활용한 Real-Time Race Track(RTRT)은 팬들이 자신만의 레이싱 서킷을 디자인하고 사용자화하여 공유할 수 있는 상호작용적인 경험을 제공한다. 피트 타이밍과 타이어 선택과 같은 전략적 레이싱 통찰력과 AI 음성 비서, 레트로 스타일 레이싱 포스터와 같은 대화형 기능을 강조하고 있다.

자연어 데이터베이스 분석이 조직이 구조화된 데이터와 상호 작용하는 방식을 혁신할 수 있는 방법을 살펴봅니다. 대형 언어 모델 (LLM) 에이전트의 힘을 통해 복잡한 쿼리를 명확하고 검증 가능한 추론 단계로 분해하고, 오류를 잡아내고 실패를 분석하며 쿼리를 사용자 의도와 스키마 요구 사항과 정확하게 일치하도록 세밀하게 조정함으로써 데이터베이스 분석을 향상시킵니다.

이 글에서는 Amazon 지식 베이스를 RAG 애플리케이션에 자동화된 방법으로 배포하는 방법을 보여줍니다.

Amazon Bedrock 사용자를 위한 체계적인 평가 방법론 소개. 이론적 프레임워크와 실용적 전략을 결합하여 데이터 과학자와 머신러닝 엔지니어가 최적의 모델 선택을 할 수 있게 함.

GenAI IDP Accelerator를 활용한 지능형 문서 처리 솔루션을 AWS에서 소개. 자동화된 문서 처리 워크플로우는 문서에서 구조화된 정보를 정확하게 추출하여 수동 작업을 줄임. 이 솔루션을 통해 Generative AI를 활용한 워크플로우를 몇 일 안에 구축할 수 있음.

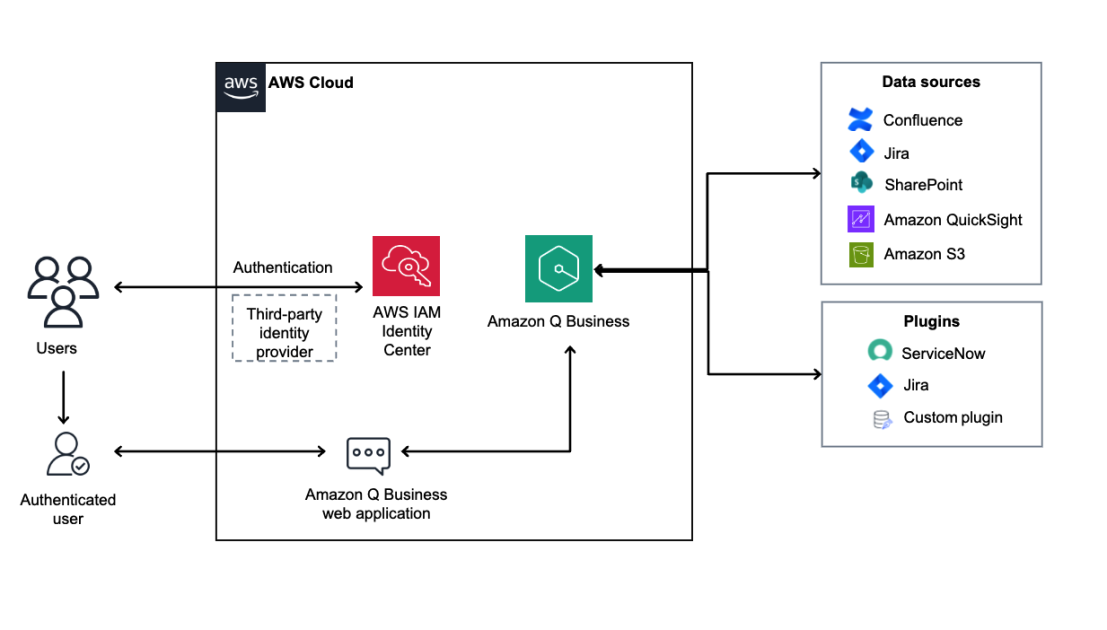

Amazon Q Business는 AWS 고객에게 조직 전반의 업무 프로세스를 향상시키는 확장 가능하고 포괄적인 솔루션을 제공한다. 사용 사례를 신중히 평가하고 구현 모범 사례를 따르며, 이 게시물에서 제공된 아키텍처 지침을 사용함으로써 Amazon Q Business를 배포하여 기업 생산성을 변형할 수 있다. 성공의 열쇠는 작게 시작하고 빠르게 가치를 입증하며, 조직 전반에 체계적으로 확장하는 것에 있다.

Amazon Bedrock의 Amazon Nova를 활용하여 구축된 The Fragrance Lab은 소매, 소비재, 광고 및 마케팅 분야에서 생성적 AI의 변혁적인 힘을 보여주는 포괄적인 애플리케이션이다. 이 게시물에서는 The Fragrance Lab의 개발에 대해 살펴보며, 프랑스 리비에라의 영혼을 담아 창의성, 광고, 소비재를 축하하는 독특한 물리적 및 디지털 경험의 조합을 만들었다.

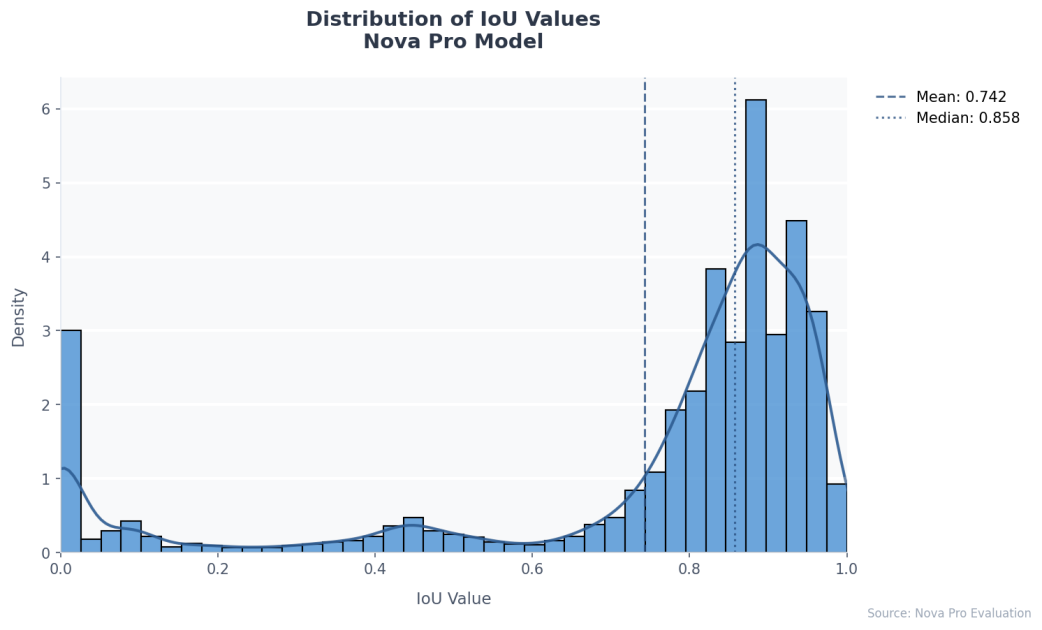

이 게시물은 Amazon Bedrock의 foundation models (FMs) 중 Amazon Nova Pro를 사용하여 높은 정확도의 문서 필드 로컬라이제이션을 실현하는 방법을 보여줍니다. 이러한 모델을 사용하면 프론트엔드 노력을 최소화하면서 문서 필드를 정확하게 찾아내고 해석할 수 있어 처리 오류와 수동 개입을 줄일 수 있습니다.

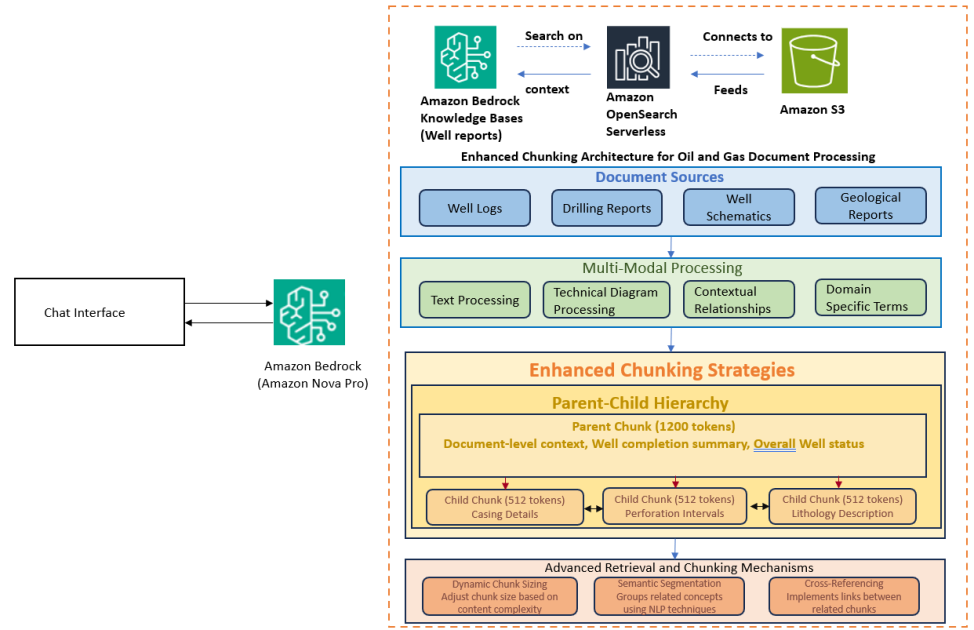

Infosys는 석유 및 가스 부문을 위해 맞춤형 Amazon Bedrock을 활용한 고급 RAG 솔루션을 구축했다. 이 솔루션은 다중 모달 데이터 원본을 처리하며 텍스트, 다이어그램, 숫자 데이터를 매끄럽게 처리하고 다른 데이터 요소 간의 맥락과 관계를 유지한다. 이 글에서는 해당 솔루션에 대한 통찰과 다양한 접근 방식 및 아키텍처 패턴(다른 청킹, 다중 벡터 검색, 개발 중 하이브리드 검색)을 안내한다.

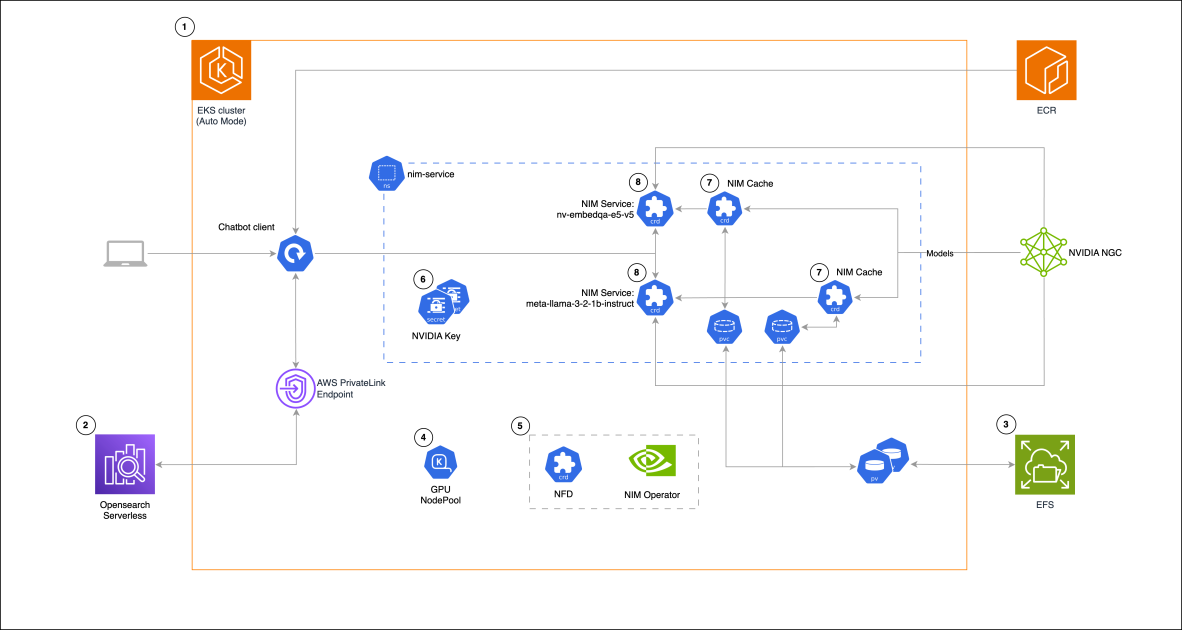

이 포스트에서는 최신 기술 스택을 사용하여 실용적인 RAG 채팅 기반 어시스턴트를 구현하는 방법을 보여줍니다. 솔루션은 NVIDIA NIMs를 사용하여 LLM 추론 및 텍스트 임베딩 서비스를 제공하며, NIM Operator가 이들의 배포와 관리를 처리합니다. 아키텍처에는 Amazon OpenSearch Serverless가 포함되어 유사성 검색을 위한 고차원 벡터 임베딩을 저장하고 쿼리합니다.

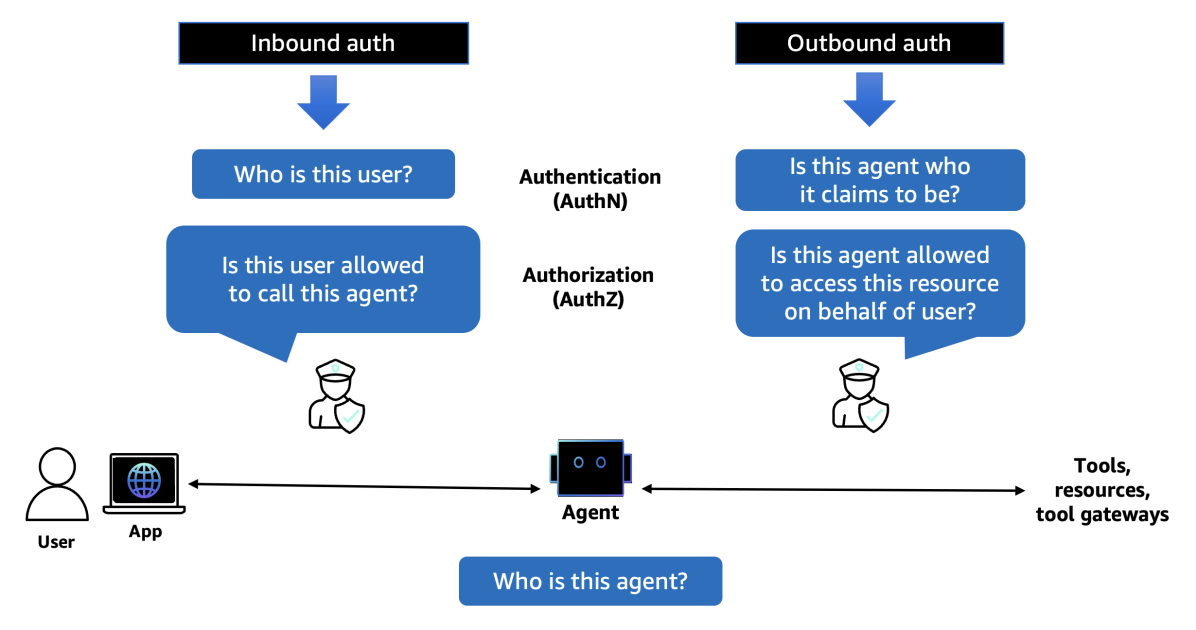

Amazon Bedrock AgentCore Identity는 AI 에이전트를 위한 종합 식별 및 액세스 관리 서비스로, AWS 리소스와 제3자 도구에 안전한 액세스를 가능하게 합니다. 에이전트 식별 디렉토리, 에이전트 권한 부여자, 리소스 자격 증명 제공자 및 리소스 토큰 보관소와 같은 강력한 식별 관리 기능을 제공하여 조직이 대규모로 AI 에이전트를 안전하게 배포할 수 있습니다.

Asana AI Studio와 Amazon Q index가 통합되어 기업 효율성을 높이는 지능적인 워크플로우 자동화와 데이터 접근성을 향상시키는 방법을 살펴봅니다.

Amazon Q Business는 기업이 데이터와 지식의 가치를 발견하는 데 도움을 주는 완전히 관리되는 생성 AI 기반 어시스턴트이다. Amazon Q Business를 사용하면 회사의 다양한 데이터 소스와 기업 시스템에 저장된 정보와 전문 지식을 활용해 빠르게 질문에 답을 찾고 요약 및 콘텐츠를 생성하며 작업을 완료할 수 있다.

Arize AX 서비스를 사용하여 Strands Agents를 통해 시작된 AI 에이전트 작업을 추적하고 평가하여 에이전트 워크플로우의 정확성과 신뢰성을 확인하는 방법 소개.

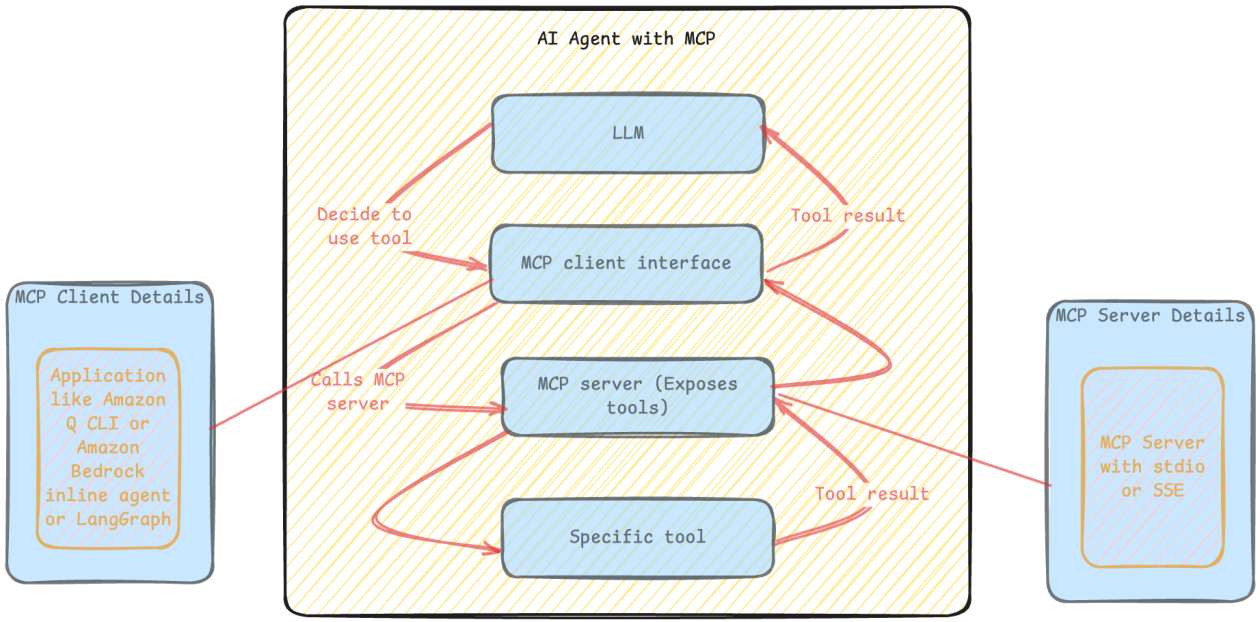

이 포스트에서는 Amazon Q Developer CLI와 Model Context Protocol (MCP) 서버 통합을 사용하여 온프레미스에서 실행 중인 레거시 Java Spring Boot 애플리케이션을 현대화하고, Amazon Elastic Kubernetes Service (Amazon EKS)에 배포하여 AWS로 마이그레이션하는 방법에 대해 알아볼 수 있습니다.

Amazon Nova의 제약 디코딩을 통해 구조화된 출력 도구의 신뢰성을 제공했다. 이제 Amazon Nova Foundation 모델(FMs)을 사용하여 복잡한 스키마를 기반으로 데이터를 추출하고 도구 사용 오류를 95% 이상 줄일 수 있다. 본문에서는 Amazon Nova FMs를 구조화된 출력 사용 사례에 어떻게 활용할 수 있는지 탐구한다.

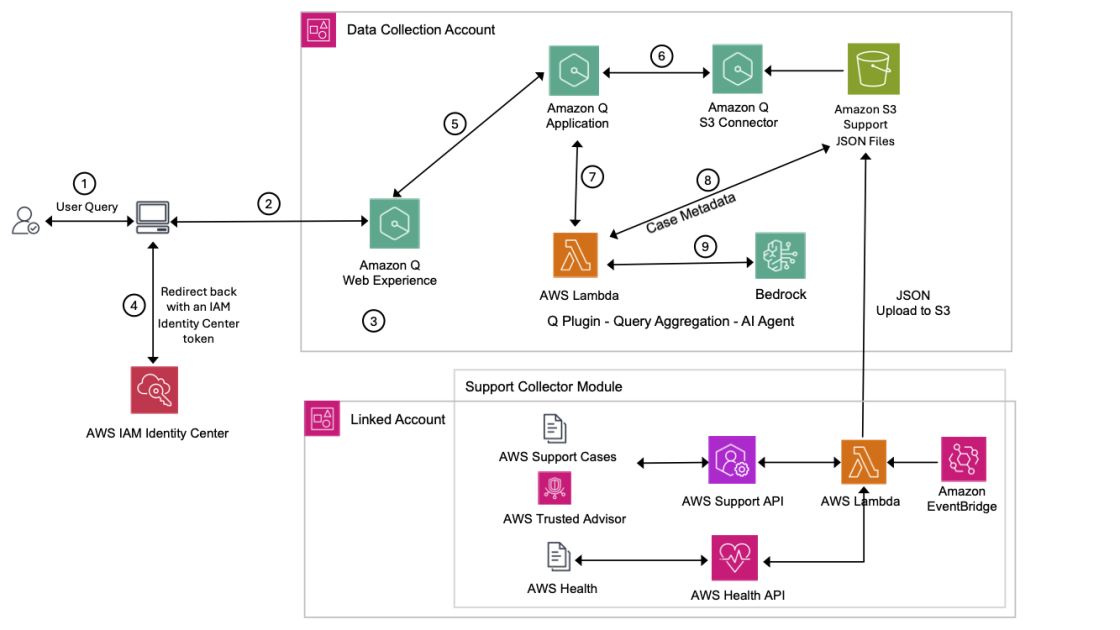

Amazon Q를 사용하여 사용자 정의 플러그인을 활용하여 AWS 지원 데이터에 대한 의미 검색 기능과 정확한 분석을 결합하는 방법을 배우세요. 이 솔루션은 구조화된 데이터 쿼리를 RAG 아키텍처와 통합하여 더 정확한 분석 질문에 대한 답변을 제공하며, 팀이 지원 사례와 건강 이벤트를 실행 가능한 통찰로 변환할 수 있도록 합니다.

Amazon Strands Agents SDK는 AWS 환경과 통합되어 안전하고 확장 가능한 배포를 제공하며, 생산 환경에서 풍부한 관측 가능성을 제공합니다. 실용적인 사용 사례를 살펴보고 Strands를 활용한 단계별 예시를 제시합니다.

본문에서는 Strands 에이전트와 Tavily의 웹 인텔리전스 API를 결합하여 강력한 리서치 에이전트를 소개하며, 기업 배포에 필요한 보안 및 규정 준수 기준을 유지하면서 복잡한 정보 수집 작업에 뛰어난 성과를 거둘 수 있는 방법을 소개합니다.

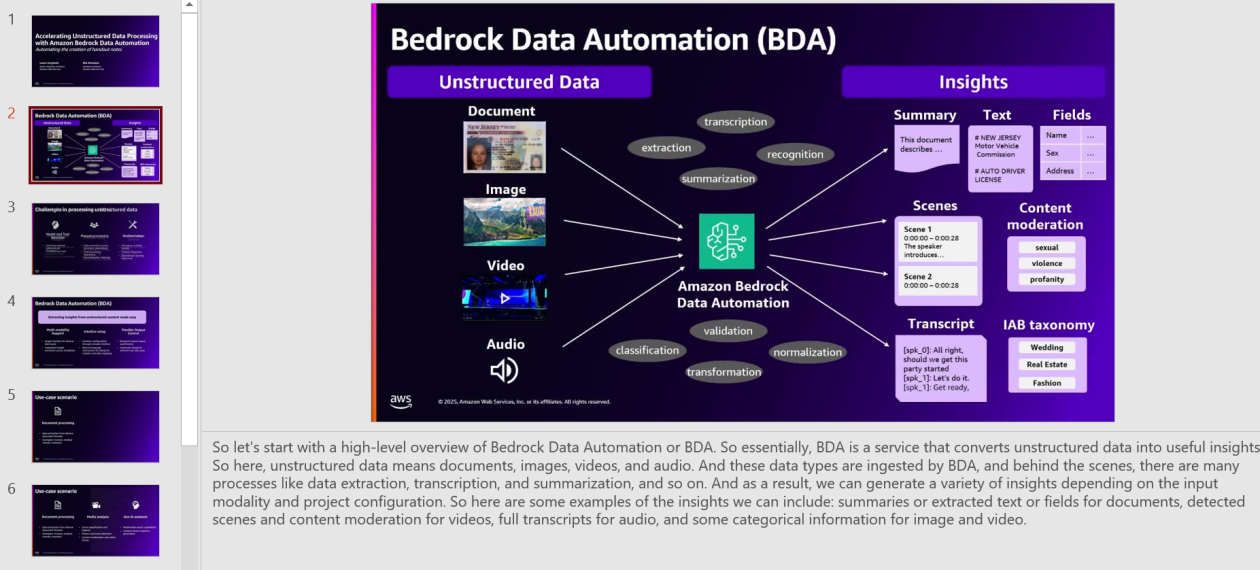

이 글에서는 Amazon Bedrock Data Automation을 사용하여 웨비나 녹화물을 종합적인 핸드아웃으로 변환하는 자동화된 서버리스 솔루션을 구축하는 방법을 소개합니다. Amazon Bedrock Data Automation을 구현하여 영상 분석을 위해 트랜스크라이브하고 슬라이드 변경을 감지하며, Amazon Bedrock foundation 모델 (FM) 및 사용자 정의 AWS Lambda 함수를 AWS Step Functions에 의해 조정하는 과정을 안내합니다.

Amazon Bedrock FMs, LangGraph 및 Model Context Protocol (MCP)를 사용하여 강력한 에이전트 애플리케이션을 만드는 방법을 탐색하며, GitHub 워크플로우를 다루는 실제 시나리오를 소개합니다.

이 포스트에서는 Llama-3.2-11B-Vision-Instruct 모델을 웹 자동화 작업에 세밀하게 조정하고 배포하는 완벽한 솔루션을 제시합니다. AWS Deep Learning Containers (DLCs)를 사용하여 Amazon Elastic Kubernetes Service (Amazon EKS)에서 안전하고 확장 가능하며 효율적인 인프라를 구축하는 방법을 보여줍니다.

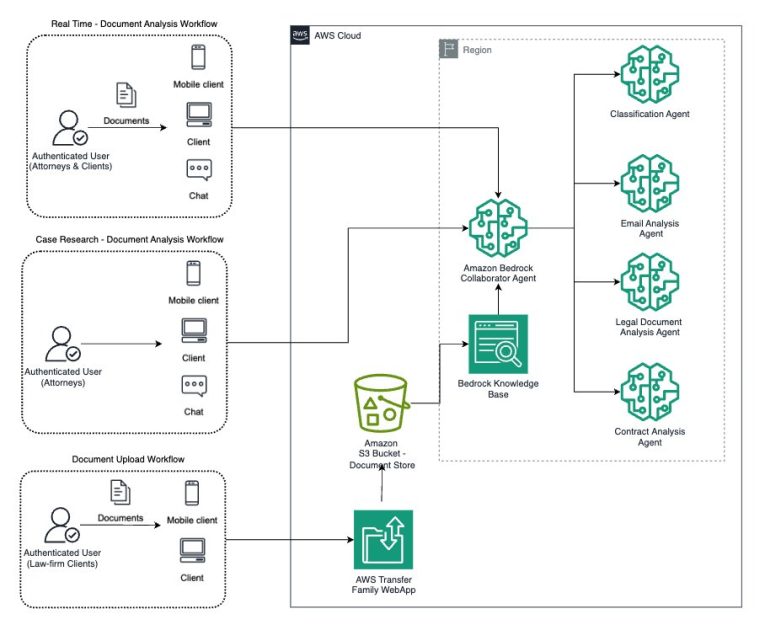

Amazon Bedrock 에이전트를 사용하여 실시간 문서 분석을 위한 지능형 eDiscovery 솔루션을 구축하는 방법을 소개합니다. 문서 분류, 계약 분석, 이메일 검토, 법적 문서 처리를 위한 특수 에이전트를 배포하고 다중 에이전트 아키텍처를 통해 함께 작동하는 방법을 보여줍니다. 구현 세부 정보, 배포 단계 및 조직이 특정 eDiscovery 요구 사항에 적응할 수있는 확장 가능한 기반을 만드는 데 필요한 모범 사례를 안내합니다.

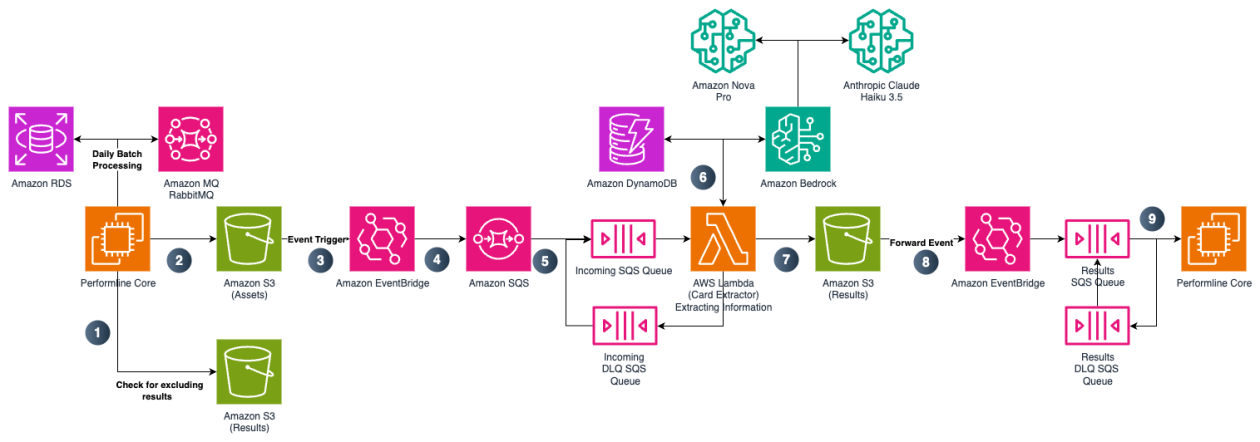

PerformLine은 Amazon Bedrock을 활용하여 규정 준수 프로세스를 가속화하고 실행 가능한 통찰을 얻으며 속도와 정확성을 제공함. 이는 대규모 감시에 필수적인 요소로 작용함.

제조업에서 서비스 보고서로부터의 소중한 통찰력이 종종 문서 저장 시스템에서 제대로 활용되지 않습니다. 이 글은 Amazon Web Services (AWS) 고객이 생성 AI를 사용하여 여러 보고서로부터 중요 정보를 자동으로 디지턀화하고 추출하는 솔루션을 구축하는 방법을 탐색합니다.

기업들이 DeepSeek R1과 같은 대규모 언어 모델을 도입하여 비즈니스 프로세스를 변형하고 고객 경험을 향상시키며 이전에 없던 속도로 혁신을 주도하고 있다. 그러나 독립형 LLM은 환각, 오래된 지식 및 독점 데이터 접근 불가와 같은 주요 제한 사항이 있습니다. RAG는 의미 검색과 생성적 AI를 결합하여 이러한 갭을 해결합니다.

PayU는 상인, 은행 및 소비자의 금융 요구를 기술을 통해 서비스하는 풀스택 디지털 금융 서비스 시스템을 제공합니다. 이 게시물에서는 PayU 팀이 기업용 AI 솔루션을 갖추고 Amazon Bedrock을 활용하여 AI 액세스를 민주화하는 방법을 설명하며, 데이터 소재 요구 사항에 손상을 주지 않았습니다.

본문에서는 서버리스 데이터 호수 아키텍처를 활용하여 안전한 RAG 애플리케이션을 구축하는 방법을 탐구합니다. Amazon S3, Amazon DynamoDB, AWS Lambda, Amazon Bedrock Knowledge Bases 등 AWS 서비스를 사용하여 비정형 데이터 자산을 지원하고 구조화된 데이터로 확장할 수 있는 종합 솔루션을 만드는 방법을 다룹니다. 기업 데이터에 대한 세밀한 액세스 제어를 구현하고 보안 경계를 준수하는 메타데이터 기반 검색 시스템을 설계하는 방법을 다루며, 이러한 접근법은 조직의 데이터 가치를 극대화하고 견고한 보안 및 규정 준수를 유지하는 데 도움이 됩니다.

Parcel Perform의 비즈니스팀은 상인의 소포 배송과 관련된 질문에 대답하기 위해 데이터에 액세스해야 합니다. 과거에는 데이터팀이 질의를 수동으로 작성하고 실행하여 데이터를 가져와야 했지만, Parcel Perform의 새로운 생성 모델 AI 기반 텍스트를 SQL 기능을 통해 비즈니스팀은 AI 어시스턴트 인터페이스를 사용하여 데이터 요구 사항을 직접 처리할 수 있습니다.

바이엘 작물 과학이 대규모 데이터 과학 작업을 관리하고 데이터 분석 요구에 맞게 모델을 훈련하며 개발자 지원을 위해 고품질 코드 문서를 유지함으로써 개발자 입사 시간을 최대 70% 줄이고 개발자 생산성을 최대 30% 향상시키는 방법을 소개합니다.