구글 연구팀이 FLAME을 제안했는데, 이는 강력한 오픈 어휘 탐지기를 기반으로 한 단일 단계의 액티브 러닝 전략으로, 훈련할 수 있는 작은 정교화기를 추가하여 가장 정보가 풍부한 샘플을 선택하고 모델 전문화를 빠르게 만드는 방법이다.

최신뉴스 전체보기

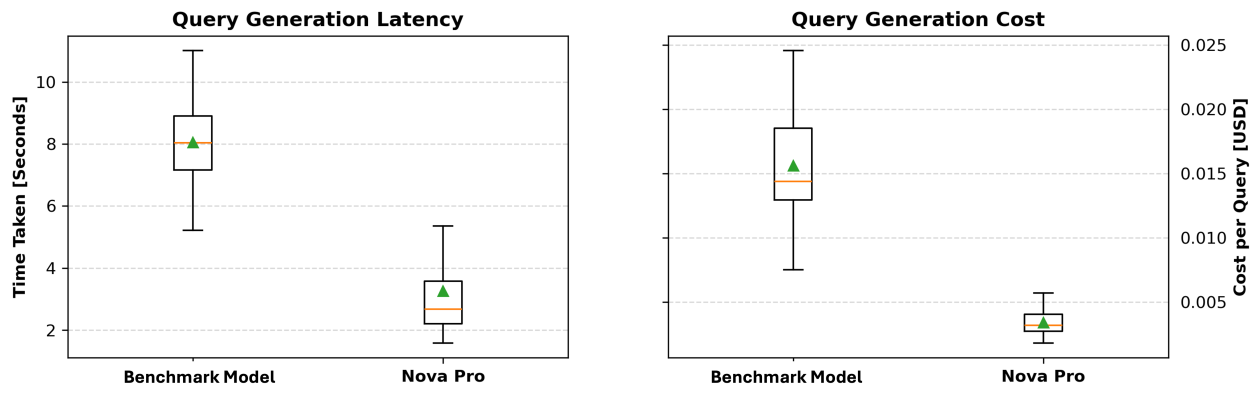

Amazon Bedrock 모델인 Amazon Nova Pro를 사용하여 자연어를 Gremlin 쿼리로 변환하는 혁신적인 방법을 탐색합니다. 비즈니스 분석가와 데이터 과학자들이 깊은 기술 지식이 필요하지 않고 그래프 데이터베이스에 접근할 수 있게 도와줍니다. 이 방법론은 그래프 지식 추출, 텍스트를 SQL처럼 그래프 구조화, 반복적인 개선 과정을 통해 실행 가능한 Gremlin 쿼리 생성으로 이루어져 테스트에서 전체적으로 74.17%의 정확도를 달성했습니다.

Apple 연구자들이 소개한 UltraCUA는 기존 컴퓨터 사용 에이전트의 한계를 극복하는 모델로, 저수준 GUI 동작을 고수준 프로그램 호출과 결합하여 보다 효율적으로 작업을 수행할 수 있게 해준다.

MIT 교수 Facundo Batista와 Dina Katabi를 포함해 세 명의 MIT 동문이 우수한 전문 업적과 봉사에 대한 헌신으로 영예를 받았다.

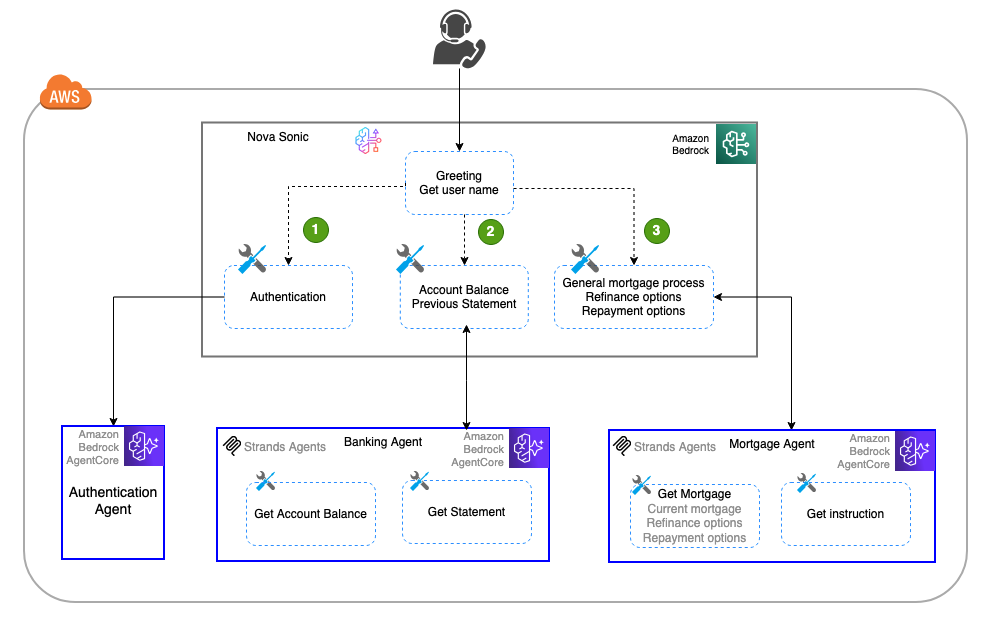

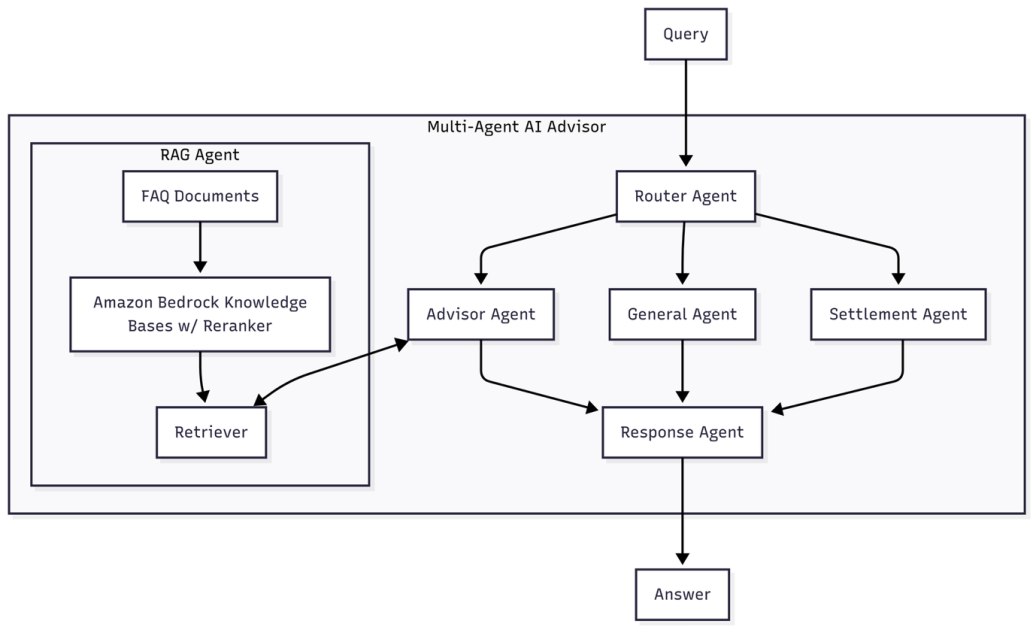

Amazon Nova Sonic의 음성 대 음성 기능과 Amazon Bedrock AgentCore를 결합하여 복잡한 작업을 전문화된 관리 가능한 구성 요소로 분할하는 정교한 다중 에이전트 음성 보조 프로그램을 만드는 방법을 탐구합니다. 이 접근 방식은 전문화된 인증, 은행 문의 및 모기지 서비스를 위한 전용 하위 에이전트를 사용하는 은행 보조 프로그램 예제를 통해 모노리딕 음성 보조 프로그램 설계에 대안을 제공합니다.

구글 연구팀과 UC Santa Cruz의 연구자들이 암 세포의 유전적 변이를 식별하는 AI 모델 ‘DeepSomatic’을 발표했다. Children’s Mercy와의 연구에서, 다른 도구에서 놓친 소아 백혈병 세포의 10가지 변이를 찾아내었다. DeepSomatic은 암 유전체를 위한 체세포 소규모 변이 콜러로, Illumina 단독 독립적으로 작동한다.

DeepSeek-AI가 3B DeepSeek-OCR을 출시했다. 이는 텍스트를 작은 집합의 시각 토큰으로 압축한 뒤 언어 모델로 해당 토큰을 디코딩하는 OCR 및 문서 구문 분석 Vision-Language Model(VLM) 시스템이다. 이미지는 텍스트의 간략한 표현을 갖고 있어 디코더의 시퀀스 길이를 줄인다.

AI 분야의 풍경이 확장되고 있다. 최강의 LLMs(대형 언어 모델) 중 많은 것들이 클라우드에 주로 위치하고 있지만, 이제 강력한 새로운 패러다임이 등장하고 있다. 개인의 프라이버시 문제와 업로드 파일 수나 로딩 기간 제한에 대한 우려도 존재한다.

스탠포드, EPFL, UNC의 연구진은 약한 메타 에이전트가 강한 실행 모델을 부르는 코드 워크플로를 설계하고 개선하는 새로운 강화 학습 프레임워크인 Weak-for-Strong Harnessing, W4S를 소개했다. 이 메타 에이전트는 강한 모델을 세밀하게 조정하는 것이 아니라 조정하는 방법을 학습한다. W4S는 워크플로 디자인을 다중 턴으로 형식화한다.

Microsoft Research는 BitNet Distillation을 제안하여 기존의 완전 정밀한 LLM을 특정 작업을 위해 1.58비트의 BitNet 학생으로 변환하고, 정확도를 FP16 교사에 가깝게 유지하면서 CPU 효율성을 향상시킵니다. 이 방법은 SubLN 기반의 구조적 개선, 지속적인 사전 훈련 및 로짓 및 멀티 헤드 어텐션 관계로부터의 이중 신호 증류를 결합합니다.

AutoCode는 LLM이 경쟁 프로그래밍 문제를 만들고 검증할 수 있는 새로운 AI 프레임워크로, UCSD, NYU, University of Washington, 등 다수의 연구진이 개발했다. 이 프레임워크는 인간의 문제 제작자의 작업 흐름을 본떠 LLM이 문제를 생성하고 검증할 수 있게 한다.

Splash Music가 AWS Trainium을 사용하여 고급 HummingLM 모델을 활용하여 AI 기반 음악 생성의 새 기준을 세우고 있다. 2024 AWS Generative AI Accelerator의 선정된 스타트업으로, Splash Music는 AWS 스타트업과 AWS Generative AI 혁신 센터 (GenAIIC)와 긴밀히 협력하여 혁신을 가속화하고 음악 생성 FM 개발 라이프사이클을 가속화하고 있다.

바이두의 PaddlePaddle 팀이 PaddleOCR-VL을 출시했습니다. 이 모델은 다국어 문서를 Markdown/JSON으로 변환하는데 사용되며, 텍스트, 표, 수식, 차트, 필기체 등을 구문 분석하는 데 적합합니다.

구글 AI 팀이 C2S-Scale 27B 모델을 발표했다. 이 모델은 270억 개의 매개변수를 갖춘 단일 세포 분석을 위한 모델로, 단일 세포 RNA-seq(scRNA-seq) 프로필을 ‘셀 문장’으로 형식화하여 언어 모델이 세포 상태를 자연스럽게 분석할 수 있게 했다.

아마존 노바 소닉과 AWS 서비스를 이용한 QSRs 드라이브 스루 솔루션 구현 방법을 소개합니다. 음성 AI와 대화형 메뉴 디스플레이를 결합한 지능형 시스템을 구축하는 방법을 상세히 안내하여 음식점이 드라이브 스루 운영을 현대화할 수 있도록 지원합니다.

NVIDIA 연구진은 MIT, HKU, Tsinghua과 협력하여 오픈소스 QeRL(Quantization-enhanced Reinforcement Learning)을 소개했다. 이 프레임워크는 4비트 FP4로 강화 학습(Reinforcement Learning) 후 훈련을 밀어넣는다.

Anthropic사가 Claude Haiku 4.5를 출시했다. Claude Sonnet 4와 유사한 코딩 성능을 제공하면서도 비용은 1/3, 속도는 2배 이상 빠르다. 이 모델은 Anthropic의 API 및 아마존 Bedrock, 구글 클라우드 Vertex AI 파트너 카탈로그를 통해 즉시 이용 가능하며, 가격은 $1/MTok 입력이다.

알리바바의 Qwen 팀이 밀도 높은 Qwen3-VL 4B/8B 모델을 FP8로 축소한 Instruct와 Thinking 두 가지 프로필로 출시했다. VRAM을 적게 사용하면서도 256K→1M 컨텍스트와 전체 능력을 유지한다.

안드레이 카르파시가 nanochat을 공개했다. 이는 하나의 멀티 GPU 노드에서 실행 가능한 ChatGPT 스타일 스택을 구현한 경량 코드베이스로, 토크나이저 훈련부터 웹 UI 추론까지를 지원한다. 단일 스크립트 “스피드런”을 제공하여 토큰화, 베이스 사전 훈련, 채팅/다중 선택/도구 사용 데이터에 대한 중간 훈련, 지도된 세부 튜닝(SFT), 선택적 강화 학습을 실행한다.

마이크로소프트 AI가 처음으로 개발한 이미지 생성 모델인 MAI-Image-1이 선보였다. 이 모델은 2025년 10월 13일 기준으로 LMArena 텍스트-이미지 리더보드 Top-10에 데뷔했다. 모델은 커뮤니티 피드백을 수집하기 위해 공개적으로 테스트 중이며, 마이크로소프트 AI 팀에 따르면 곧 공개될 예정이다.

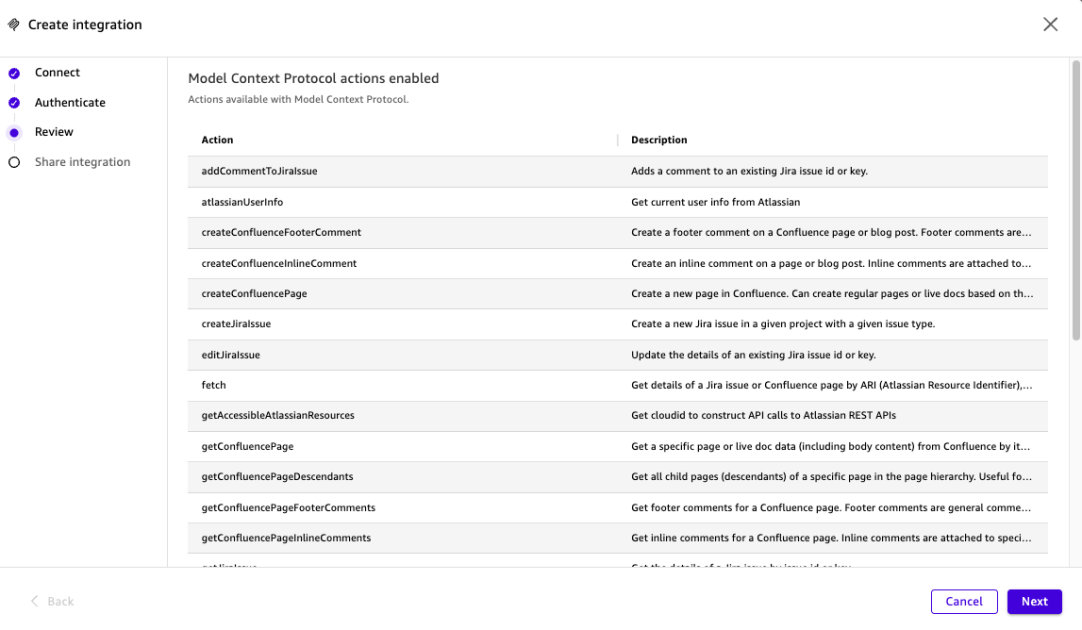

Amazon Quick Suite의 Model Context Protocol (MCP) 클라이언트를 사용하여 기업 애플리케이션 및 AI 에이전트에 안전하고 표준화된 연결을 구축하는 방법을 탐색합니다. Atlassian Jira 및 Confluence, AWS Knowledge MCP Server, Amazon Bedrock AgentCore Gateway와 같은 인기 있는 기업 도구와의 MCP Actions 통합 설정 방법을 알아보고, 사람들과 AI 에이전트가 조직의 데이터와 애플리케이션을 효율적으로 활용할 수 있는 협업 환경을 만들어봅니다.

SwiReasoning은 추론 LLM이 다음 토큰 분포의 엔트로피 추세를 기반으로 블록 단위 신뢰도를 추정하여 잠재 공간에서 생각할지 명시적 사고 체인을 쓸지 결정할 수 있는 디코딩 시간 프레임워크다. 이 방법은 훈련 없이 모델에 대해 Pareto-우수한 정확도/효율성 트레이드오프를 목표로 하며, 수학 및 STEM 벤치마크에서 +1.5%~2.8% 평균 정확도 향상을 보여준다.

이 튜토리얼에서는 파이썬을 사용하여 실제로 AI 에이전트를 안전하게 보호하는 방법을 탐구합니다. 데이터 및 도구와 상호 작용할 때 안전 규칙을 준수하는 지능적이고 책임감 있는 에이전트를 구축하는 데 초점을 맞춥니다. 입력 살균, 프롬프트 주입 탐지, 개인 식별 정보 비식별화, URL 허용 목록, 속도 제한 등 여러 보호층을 구현합니다.

스탠포드 대학의 연구진과 ETH 취리히, Google Research, Amazon과의 협업으로 새로운 시계열 언어 모델인 OpenTSLM이 소개되었다. 이 모델은 현재의 LLMs의 한계를 극복하여 의료 분석에 혁신을 가져오고 있다.

Liquid AI가 온디바이스 실행을 위해 만들어진 소형 Mixture-of-Experts 모델인 LFM2-8B-A1B를 출시했다. 클라우드 배치 서빙용이 아닌 이 모델은 폰에 최적화되어 있어 메모리, 지연 및 에너지 예산을 엄격하게 고려하며 작동한다.

스탠포드 대학교, SambaNova Systems, UC 버클리에서 연구진이 소개한 ACE 프레임워크는 LLM 성능을 향상시키는데 모델 가중치를 업데이트하는 대신 입력 컨텍스트를 편집하고 확장함으로써 작동합니다. 컨텍스트는 Generator, Reflector, Curator 세 가지 역할에 의해 유지되며 간결성 편향을 피하기 위해 작은 델타 항목이 점진적으로 병합됩니다.

삼성 SAIT가 발표한 Tiny Recursive Model (TRM)은 2층 구조의 약 7백만 파라미터 재귀 추론기로, ARC-AGI-1에서 44.6-45%의 테스트 정확도와 ARC-AGI-2에서 7.8-8%의 결과를 보여 더 큰 언어 모델인 DeepSeek-R1, o3-mini-high 등을 능가했다.

Apple의 새로운 연구는 중간 학습이 강화 학습 후 후속 학습을 하기 전에 무엇을 해야 하는지 공식화하고 RA3 (Reasoning as Action Abstractions)를 소개합니다. RA3는 전문가의 흔적으로부터 시간적으로 일관된 잠재적 행동을 학습하고 그에 대해 미세 조정합니다. 중간 학습은 (1) 최적의 행동 부분 공간으로 가지치기하고 (2) 줄여야 함을 보여줍니다.

메타 AI가 OpenZL을 공개했다. 이는 형식 인식 그래프 압축기를 훈련시키고 유니버설 디코더에 자체 설명 그래프만 보내어 압축 비율과 처리량을 얼마나 회복할 수 있는지 탐구한 오픈 소스 프레임워크이다.

XGBoost의 분석적 능력과 LangChain의 대화형 지능을 결합하여, 합성 데이터셋 생성부터 XGBoost 모델 학습, 성능 평가, 주요 인사이트 시각화까지 가능한 파이프라인을 구축하는 튜토리얼. 대화형 AI가 원활하게 상호작용할 수 있는 방법을 보여줌.

금융 서비스 회사가 FM을 사용하여 대량의 고객 레코드를 처리하고 데이터 기반 제품 추천을 얻는 방법을 소개하며, Amazon Bedrock 배치 추론 작업을 위한 자동 모니터링 솔루션 구현하는 방법을 안내합니다.

구글 딥마인드가 소개한 CodeMender는 실제 취약점에 대해 수정 사항을 생성, 유효성을 검증하고 상류로 보내는 AI 에이전트로, 보안 취약점을 자동으로 보완할 수 있게 함.

OpenAI가 AgentKit을 출시했다. 시각적인 에이전트 빌더, 임베드 가능한 ChatKit UI 및 확장된 Evals를 포장하여 제품 에이전트를 출하하기 위한 단일 워크플로우를 제공한다. 에이전트 빌더(beta)와 기타 기능이 포함되어 있다.

Salesforce AI Research가 CoDA-1.7B를 발표했다. 이는 양방향 컨텍스트를 사용하여 전체 시퀀스를 정제하고, 왼쪽에서 오른쪽으로 다음 토큰 예측이 아닌 병렬로 여러 토큰을 업데이트하는 코드용 확산 기반 언어 모델이다.

이 코딩 구현에서는 텍스트 시퀀스에서 연속적인 수치 값을 직접 예측하는 회귀 언어 모델(RLM)을 구축한다. 자연어 설명 안에 숨겨진 양적 관계를 학습하는 트랜스포머 기반 아키텍처를 훈련하는데 초점을 맞춘다. 합성 텍스트-숫자 데이터 생성부터 시작해서 효율적으로 토큰화한다.

Google Cloud AI Research과 MIT, 하버드, Google DeepMind의 협력자들이 TUMIX (도구 사용 혼합)를 소개했다. 이는 이질적인 에이전트 스타일(텍스트, 코드, 검색, 가이드된 변형)을 앙상블하는 테스트 시간 프레임워크이다.

코넬과 구글의 연구진은 코드 문자열에서 직접 숫자 결과를 예측하는 통합 회귀 언어 모델(RLM)을 소개했습니다. 이 모델은 GPU 커널 지연, 프로그램 메모리 사용량, 심지어 신경망 정확도와 지연까지 손수 조작된 특성 없이 예측합니다. T5-Gemma에서 초기화된 300M 파라미터 인코더-디코더는 단일 텍스트-숫자 디코더를 사용하여 이질적 작업과 언어 간 강력한 순위 상관관계를 달성합니다.

Thinking Machines사가 Tinker를 출시했다. Tinker는 연구원과 엔지니어들이 로컬에서 학습 루프를 작성하고 플랫폼이 관리되는 분산 GPU 클러스터에서 실행할 수 있는 파이썬 API이다. 데이터, 목표 및 최적화 단계의 완전한 제어를 유지하면서 스케줄링, 장애 허용 및 다중 노드 조율을 자동화한다.

IBM은 Granite 4.0을 출시했는데, 이는 모노리딕 트랜스포머 대신 하이브리드 Mamba-2/Transformer 스택을 사용하여 서빙 메모리를 줄이고 품질을 유지한다. 다양한 사이즈의 모델들이 제공되며, 이들은 Apache-2.0로 공개되었다.

ServiceNow AI 연구소가 Apriel-1.5-15B-Thinker를 공개했다. 이 모델은 강화 학습이나 선호도 최적화 없이 데이터 중심 중간 학습 레시피로 훈련된 150억 개의 오픈 가중치 다중 모달 추론 모델로, 단일 GPU 예산에서 SOTA 대비 8배의 비용 절감으로 인공 분석 지능 지수 52를 달성한다.

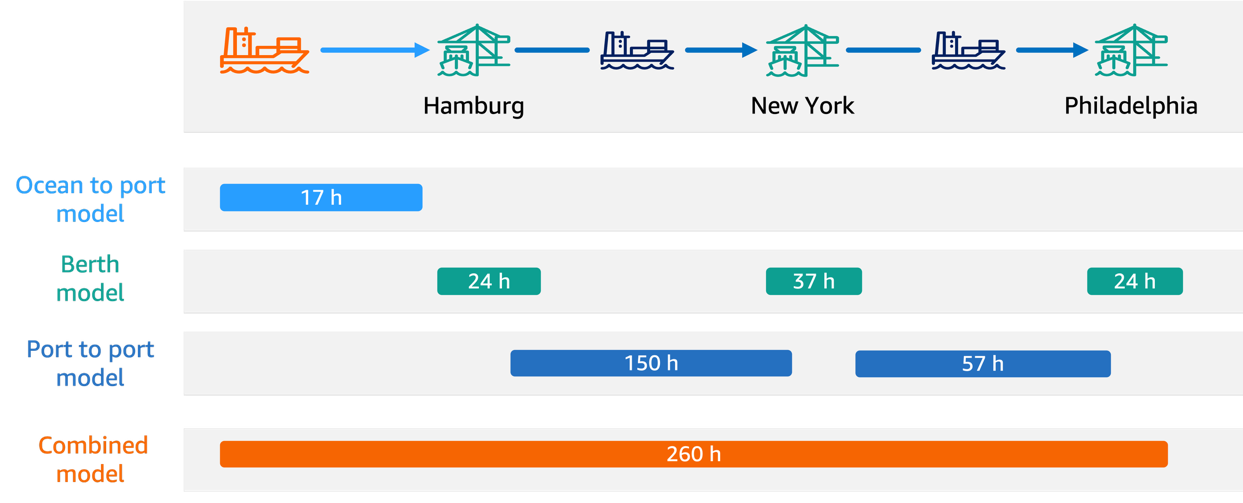

Hapag-Lloyd가 ML을 활용한 선박 도착 및 출발 시간 예측 어시스턴트를 개발하고 산업에서의 주요 성과 지표인 일정 신뢰성을 향상시켰다. Amazon SageMaker AI를 사용하고 견고한 MLOps 실천을 통해 고객에게 품질을 약속하고 있다.

이 튜토리얼에서는 에이전트 검색 보조 생성 (RAG) 시스템의 구현을 안내합니다. 문서를 검색하는 것 이상의 작업을 수행하도록 설계되어 있어 에이전트가 검색이 필요한 때를 적극적으로 결정하고, 최적의 검색 전략을 선택하며, 문맥을 인식하여 응답을 종합합니다.

DeepSeek가 DeepSeek Sparse Attention (DSA)를 추가한 DeepSeek-V3.2-Exp를 출시했다. 이 업데이트는 장문 맥락 효율성을 높이기 위한 훈련 가능한 희소화 경로를 제공한다. 또한 API 가격을 50% 이상 할인하여 효율성 향상을 보여줬다. 새로운 업데이트는 V3/V3.1 스택(MoE + MLA)을 유지하고 두 단계의 어텐션 경로를 삽입했다.

2025년 로컬 LLMs는 빠르게 성숙해졌으며, 안정적인 사양과 일류 로컬 러너를 제공하면서 온프렘 및 랩톱 추론이 실용적으로 가능해졌다.

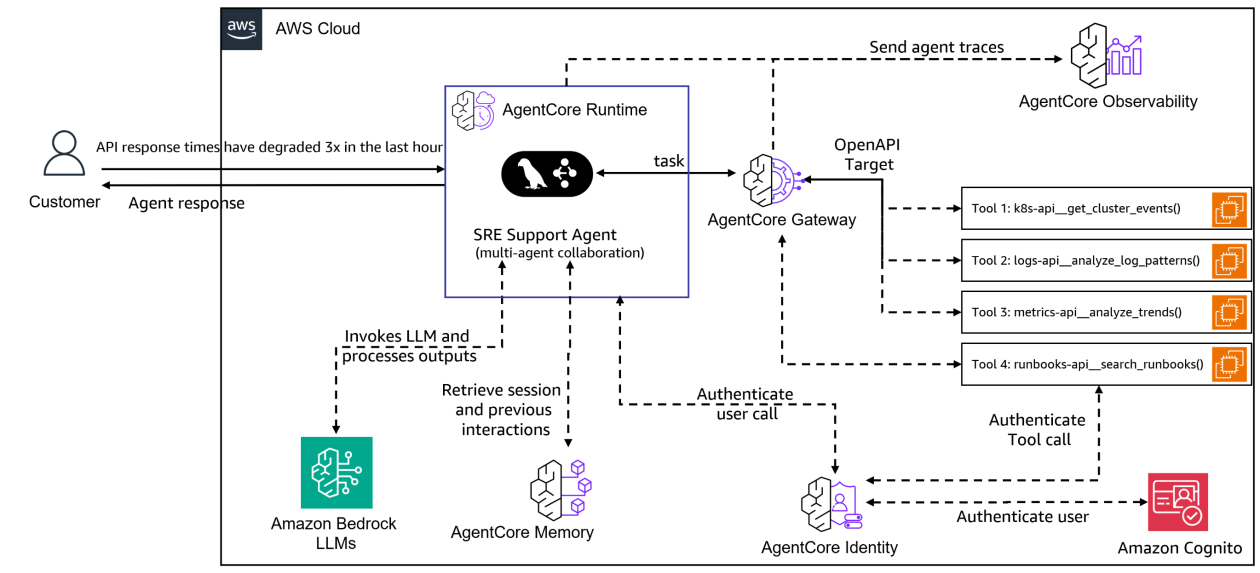

Amazon Bedrock AgentCore, LangGraph 및 MCP를 사용하여 멀티 에이전트 SRE 어시스턴트를 구축하는 방법을 소개합니다. 이 시스템은 특화된 AI 에이전트를 배치하여 현대 SRE 팀이 효과적인 사고 대응과 인프라 관리를 위해 필요로 하는 깊이 있는 문맥적 지능을 제공합니다.

PropHero는 Amazon Bedrock을 활용해 다양한 요소를 고려한 부동산 투자 조언을 제공하는 AI 시스템을 구축했다. 에이전트 아키텍처, 모델 선택 전략, 그리고 품질 대화를 위한 평가 시스템을 탐구하며 빠른 개선을 가능케한다.

메타 FAIR가 320억 개의 파라미터로 이루어진 CWM을 공개했다. 이 모델은 코드 생성에 세계 모델링을 삽입하여 실행 추적 및 장기적 상호작용을 통해 학습하며, 코드를 예측함으로써 중간 훈련을 수행한다.

MIT CSAIL 연구진은 PDDL-INSTRUCT를 소개하여 대화식 계획 수립 성능을 향상시키고 LLM의 심볼릭 계획 성능을 높였다. 조정된 Llama-3-8B 모델은 Blocksworld에서 94%의 유효한 계획을 달성했다.

메타 연구원들은 반복되는 추론 패턴을 짧고 이름이 붙은 절차, “행동”,으로 압축한 다음 모델이 추론 시 사용하거나 미세 조정을 통해 정제하는 방법을 소개했다. 결과적으로 MATH에서 추론 토큰 수를 최대 46% 절감하면서 정확도를 유지 또는 향상시키고, AIME에서는 자가 개선 환경에서 최대 10%의 정확도 향상을 이끌어냈다.

이 튜토리얼에서는 탈옥 방어 기술을 소개하며, 정책 회피 프롬프트를 탐지하고 안전하게 처리하는 방법을 단계별로 소개합니다. 실제 공격 및 양성 예제를 생성하고, 규칙 기반 신호를 만들어 TF-IDF 기능과 결합하여 회피 프롬프트를 차단하지 않고 합법적인 요청을 차단할 수 있는 간결하고 해석 가능한 분류기를 만듭니다.

Stability AI의 Alex Gnibus와 함께 작성된 이 게시물에서 Stability AI 이미지 서비스가 Amazon Bedrock에서 이용 가능하며, Amazon Bedrock API를 통해 제공되는 사용 준비가 완료된 미디어 편집 기능을 제공합니다. 이 이미지 편집 도구는 Stability AI의 Stable Diffusion 3.5 모델(SD3.5) 및 Stable Image Core 및 Ultra 모델의 기능을 확장합니다.

Amazon Bedrock는 이제 안정성 AI 이미지 서비스를 제공하는데, 비즈니스가 이미지를 생성하고 수정하는 방법을 개선하는 9가지 도구를 제공한다. 이 기술은 Stable Diffusion 및 Stable Image 모델을 확장하여 이미지 생성 및 편집에 대해 정밀한 제어를 제공한다. 명확한 유도는 AI 시스템에 예술적 방향을 제공하는 데 중요하다. 강력한 유도는 톤과 같은 특정 요소를 제어한다.

Amazon Bedrock 일괄 추론 작업을 Amazon CloudWatch 메트릭, 알람 및 대시보드를 사용하여 모니터링하고 관리하여 성능, 비용 및 운영 효율성을 최적화하는 방법을 탐색합니다.

H 회사가 Holo1.5를 출시했다. 이는 컴퓨터 사용을 위한 오픈 기반 비전 모델로, 실제 사용자 인터페이스에 스크린샷 및 포인터/키보드 조작을 통해 작동하는 CU 에이전트를 위해 설계되었다. 3B, 7B, 72B 체크포인트가 포함되어 있으며, 크기별로 Holo1 대비 약 10% 정확도 향상이 문서화되어 있다.

글에서는 gpt-oss-20b 모델을 SageMaker 관리형 엔드포인트에 배포하는 방법을 보여주고 LangGraph를 사용한 주식 분석 에이전트 어시스턴트 예시를 소개합니다.

이 튜토리얼에서는 Hugging Face의 무료 모델을 활용해 고급 음성 AI 에이전트를 구축하고, 전체 파이프라인을 Google Colab에서 원활하게 실행할 수 있도록 유지합니다. 우리는 음성 인식을 위해 Whisper, 자연어 추론을 위해 FLAN-T5, 음성 합성을 위해 Bark를 결합하여 전부 트랜스포머 파이프라인을 통해 연결합니다.

구글의 Agent Payments Protocol (AP2)은 에이전트 주도의 결제를 위한 오픈, 상호 운용 가능한 명세서로, 사용자, 에이전트 개발자 또는 상인 중 누가 책임을 져야 하는지에 대한 불신이 해결됨.

Zarr 라이브러리의 기능을 깊이 파헤치는 튜토리얼. 대규모 다차원 배열의 효율적인 저장 및 조작을 위해 설계된 Zarr의 기본부터 시작하여 청킹 전략 설정, 직접 디스크에서 값 수정 등의 고급 작업까지 탐색.

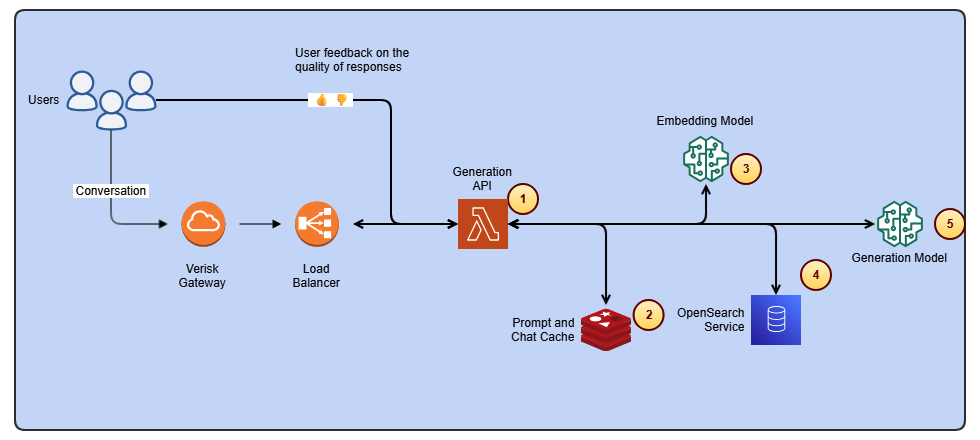

Verisk Rating Insights와 Amazon Bedrock이 함께하는 큰 언어 모델 및 RAG 기술로, 고객들이 ISO ERC 변경 사항에 상호 작용하고 접근하는 방식이 혁신적으로 변화하고 있다.

Google Research가 200M 파라미터의 TimesFM-2.5를 공개했다. 이 모델은 16K 컨텍스트 길이와 원천 확률 예측 지원을 갖추고 있으며, GIFT-Eval에서 최상의 정확성 지표(MASE, CRPS)를 기록하고 있다. 시계열 예측은 무엇인가? 시계열 예측은 [ … ]

스탠포드 대학 연구팀이 의료 분야에서 대형 언어 모델 에이전트를 평가하기 위해 설계된 MedAgentBench를 발표했다. MedAgentBench는 가상 전자 건강 기록 환경을 제공하여 AI 시스템이 상호 작용, 계획 및 다단계 임상 작업을 실행해야 하는 실제 시나리오를 제공한다.

MoonshotAI가 checkpoint-engine을 오픈소스로 공개했다. 이는 대규모 언어 모델(Large Language Model, LLM) 배포에서 주요 병목 현상 중 하나인 수천 개의 GPU에서 모델 가중치를 신속하게 업데이트하고 추론을 방해하지 않는 것을 목표로 한 경량 미들웨어이다. 라이브러리는 특히 강화 학습 및 강화 학습과 인간 피드백(RLHF)을 위해 설계되었으며, 모델이 빈번히 업데이트되고 다운타임이 발생하는 경우에 유용하다.

OpenAI가 GPT-5-Codex를 발표했다. 이는 Codex 생태계 내에서 “agentic coding” 작업에 더 최적화된 GPT-5의 버전이다. 이번 업데이트의 목표는 Codex가 더 신뢰성 있고 빠르며 자율적인 행동을 보여 팀원처럼 행동할 수 있도록 하는 것이다.

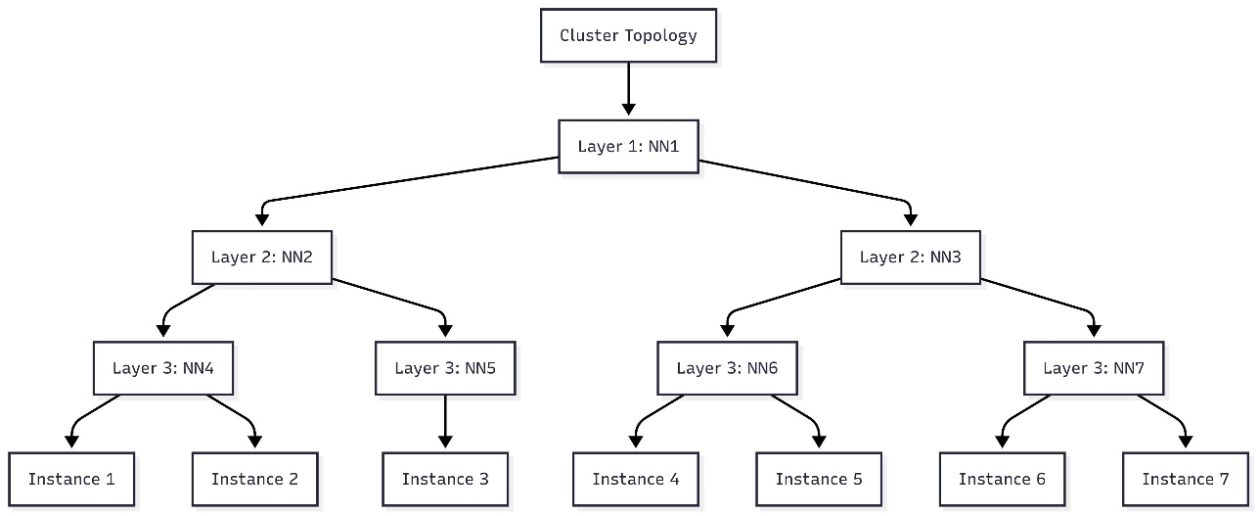

SageMaker HyperPod 작업 관리를 사용하여 토폴로지 인식 스케줄링을 소개하고 계층적 네트워크 정보를 나타내는 작업을 제출함으로써 작업을 최적화하는 방법에 대한 세부 정보를 제공합니다.

NVIDIA의 연구진이 ViPE: 3D 기하학 인식을 위한 비디오 포즈 엔진을 공개했다. 이는 비용이 많이 드는 전통적인 방법 없이 로봇학을 위한 AI를 훈련하기 위한 3D 데이터셋을 어떻게 생성하는가에 대한 해결책으로, 3D 컴퓨터 비전 분야의 병목 현상을 해결한다.

Meta가 MobileLLM-R1을 출시했습니다. 이는 Hugging Face에서 사용 가능한 가벼운 엣지 추론 모델로, 140M에서 950M의 파라미터를 가진 모델들이 포함되어 있습니다. 일반적인 챗봇 모델과는 달리 MobileLLM-R1은 엣지 배포용으로 설계되어 있어 최신 추론 정확도를 제공합니다.

구글 AI 연구팀과 딥마인드가 디퍼렌셜 프라이버시(DP)로 완전히 훈련된 최대 규모의 오픈 가중치 대형 언어 모델인 VaultGemma 1B를 공개했다. 이는 강력하면서도 프라이버시 보호가 가능한 AI 모델 구축으로 나아가는 중요한 한걸음이다.

IBM은 고성능 검색 및 RAG 시스템용으로 설계된 두 개의 새로운 임베딩 모델, granite-embedding-english-r2와 granite-embedding-small-english-r2를 소개했다. 이 모델들은 효율적이고 소형이며 Apache 2.0 라이선스로 제공된다.

BentoML은 llm-optimizer를 출시했는데, 이는 self-hosted large language models (LLMs)의 벤치마킹과 성능 튜닝을 간소화하기 위해 설계된 오픈 소스 프레임워크이다. 이 도구는 LLM 배포에서의 최적의 구성을 찾는 것과 같은 일반적인 도전에 대처하며, 수동 시행착오 없이 지연 시간, 처리량 및 비용에 대한 최적화된 구성을 찾는 데 도움을 준다.

이스라엘 음성 AI 스타트업인 Deepdub이 Lightning 2.5를 소개했다. 이 모델은 실시간으로 작동하는 기본 음성 모델로, 성능과 효율성 면에서 상당한 향상을 이뤘다. 이로써 AI 에이전트, 기업 AI 등 실시간 대화 시스템에서 사용할 수 있게 되었다.

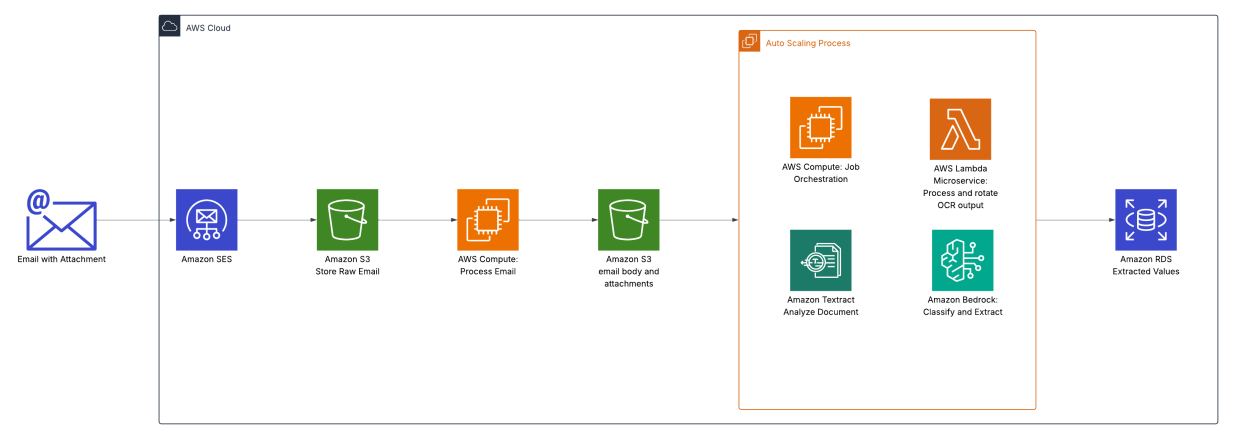

Oldcastle가 AWS와 협력하여 Amazon Bedrock 및 Amazon Textract를 사용하여 문서 처리 워크플로우를 개선했고, 이를 통해 매달 수십만 개의 POD 문서 처리를 자동화하여 정확성을 향상시키고 수동 노력을 줄였다.

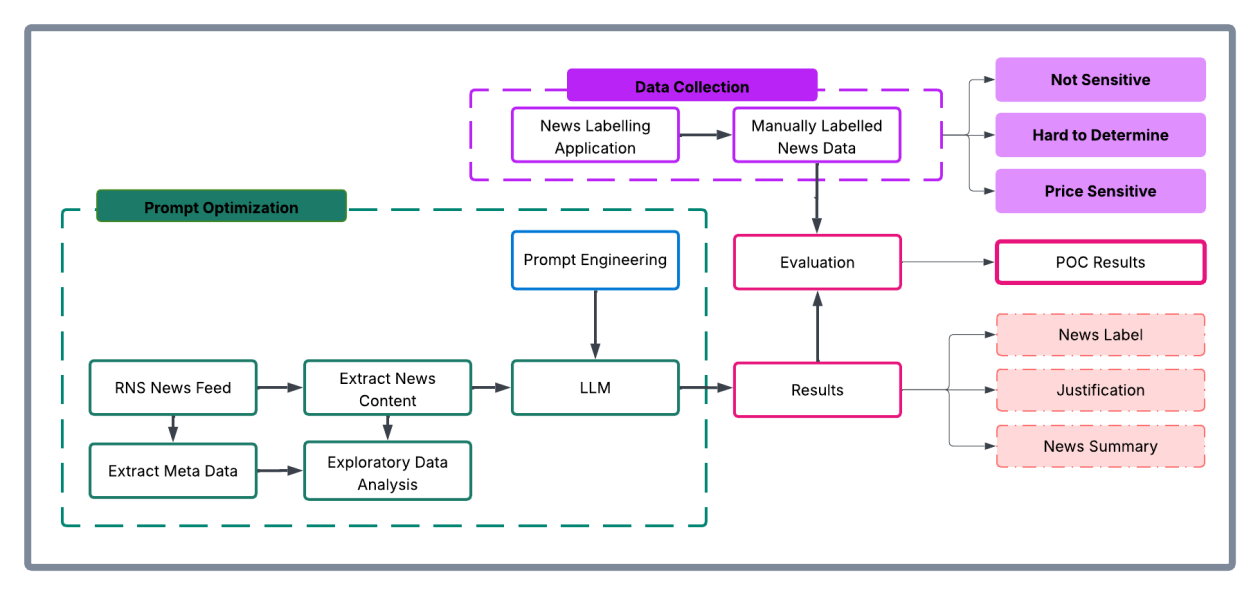

런던 증권 거래소 그룹(LSEG)이 Amazon Bedrock과 Anthropic의 Claude foundation 모델을 활용해 자동 시스템을 구축하여 시장 감시 작업의 효율성과 정확도를 크게 향상시켰다.

이 튜토리얼에서는 SpeechBrain을 사용한 고급이면서도 실용적인 워크플로우를 안내합니다. gTTS로 자체 깨끗한 음성 샘플을 생성하고 실제 시나리오를 시뮬레이션하기 위해 음향을 의도적으로 추가한 다음 SpeechBrain의 MetricGAN+ 모델을 적용하여 오디오를 향상시킵니다. 오디오가 소음 제거되면 언어 모델-재점수화를 통해 자동 음성 인식을 실행합니다.

MBZUAI의 연구진이 고급 AI 추론을 위한 32B-파라미터 오픈 추론 시스템 K2 Think을 발표했다. 이 시스템은 강화 학습, 테스트 시 스케일링, 추론 최적화 등을 결합하여 선두적인 성능을 보여준다.

AWS는 Amazon SageMaker HyperPod에서 관리형 계층형 체크포인팅을 발표했는데, 이는 수천 개의 AI 가속기를 통해 생성 AI 모델 개발을 확장하고 가속화하기 위한 목적으로 만들어진 인프라이다. CPU 메모리를 사용하여 고성능 체크포인트 저장 및 인접한 컴퓨팅 노드 간 자동 데이터 복제를 통해 신뢰성을 향상시킨다.

LLM의 시험 시간 계산 확장은 단일 추론 경로를 확장하는 데 의존했지만, 이는 한정된 범위에서는 추론을 개선하지만 성능이 빠르게 수렴한다. 32K 이상의 토큰 예산을 증가시켜도 무의미한 정확도 향상. 이 병목 현상은 초기 토큰에서 발생.

HyperPod 작업 관리 기능을 사용하여 고객은 Amazon Elastic Kubernetes Service (Amazon EKS)에서 Amazon SageMaker HyperPod 클러스터 활용을 최적화하고 공정한 사용을 분배하며 다른 팀 또는 프로젝트 간에 효율적인 리소스 할당을 지원할 수 있습니다.

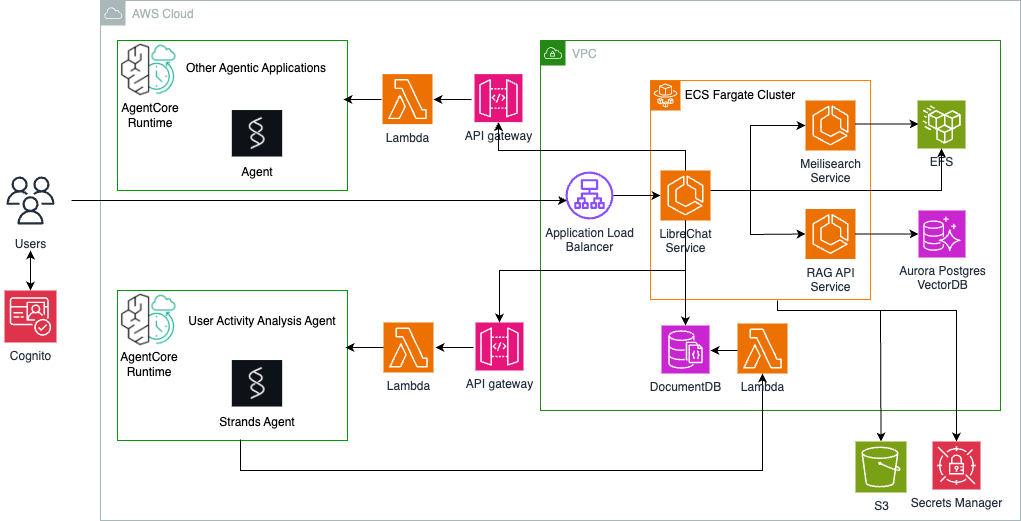

글은 Strands Agents를 사용해 AI 에이전트를 빠르게 구축하고, Amazon Bedrock AgentCore로 안정적으로 확장하며, LibreChat을 통해 사용자들이 바로 적용할 수 있도록 교육 기관 전반에 걸쳐 즉시 사용자 채택을 촉진하는 방법을 보여준다.

Tilde AI가 TildeOpen LLM을 공개했다. 이 모델은 300억개 이상의 파라미터를 가지며 유럽어에 특화되어 있어 소수 언어에도 주목한다. EU 내 언어 균형과 디지털 주권을 강화하는 전략적인 발전이다.

대형 언어 모델은 종종 “환각”을 생성하는데, 이는 올바르지만 잘못된 출력을 확신하며 가능성이 있는 것으로 보인다. OpenAI의 새로운 연구는 환각이 교사 지도 학습과 자기 지도 학습의 통계적 특성에서 비롯되며, 그 지속성은 평가 기준의 불일치로 강화된다는 엄밀한 설명을 제공한다.

Hugging Face가 FineVision을 공개했다. 이 데이터셋은 17.3백만 개의 이미지, 24.3백만 개의 샘플, 88.9백만 개의 질문-답변 쌍, 약 100억 개의 응답 토큰을 보유하며 비전-언어 모델(VLMs) 학습을 위한 최대 규모의 구조화된 데이터셋 중 하나로 손꼽힌다.

알리바바의 Qwen 팀이 1조 개 이상의 파라미터를 갖춘 새로운 플래그십 대형 언어 모델인 Qwen3-Max-Preview를 발표했다. 이 모델은 Qwen Chat, 알리바바 클라우드 API, OpenRouter에서 접근 가능하며 Hugging Face의 AnyCoder 도구에서 기본으로 제공된다. 이 모델은 현재의 대형 언어 모델 환경에 어떻게 맞는지 살펴보자.

구글 AI가 개인 건강 에이전트(PHA)를 소개했다. 이는 맞춤 상호작용을 통해 개인 건강 요구를 해결하는 멀티 에이전트 프레임워크로, 임상 추론, 의사 결정 지원, 소비자 건강 애플리케이션 등 다양한 영역에서 강력한 성능을 보여주고 있다.

구글 AI가 대규모 언어 모델의 평가를 간편하게 하는 Stax를 출시했습니다. Stax는 구조화된 방법으로 모델을 평가하고 비교할 수 있어, 확률적 시스템인 언어 모델의 일관성 테스트를 간단하게 도와줍니다.

Elysia는 의사결정 트리와 더 똑똑한 데이터 처리를 통해 Agentic RAG 시스템을 새롭게 정의하는 오픈소스 파이썬 프레임워크입니다.

AI 에이전트 관측성은 AI 에이전트를 기획부터 메모리 쓰기와 최종 출력까지 추적하고 모니터링하여 팀이 오류를 디버깅하고 품질과 안전성을 측정하며 지연 시간과 비용을 제어하고 규제 요구 사항을 준수할 수 있도록 하는 학문이다. 이는 전통적인 텔레메트리(추적, 메트릭스 등)를 결합하여 실제로 작동한다.

토큰화와 청킹은 텍스트를 작은 조각으로 나누는 데 관련이 있지만, 서로 다른 목적과 규모에서 작동한다. AI 애플리케이션을 구축하는 경우 이러한 차이를 이해하는 것이 중요하다.

이 튜토리얼에서는 로컬에서 실행되는 무료 허깅페이스 모델을 사용하여 계층적 추론 모델(HRM)의 정신을 재현하고 가벼우면서도 구조화된 추론 에이전트의 설계를 안내합니다. 문제를 하위 목표로 분해하고 Python으로 해결함으로써 우리는 설계자이자 실험자 역할을 수행합니다.

최신 대형 언어 모델(Large Language Models, LLMs)은 단순한 텍스트 생성을 넘어섰다. 현실 세계 응용 프로그램들은 이제 이러한 모델이 API, 데이터베이스, 소프트웨어 라이브러리와 같은 외부 도구를 사용하여 복잡한 과제를 해결해야 한다. 그러나 AI 에이전트가 도구 간에 계획을 세우고 추론하며 조정할 수 있는지를 어떻게 정확히 알 수 있을까?

OpenAI가 gpt-realtime과 Realtime API를 공식적으로 출시했으며 엔터프라이즈를 위한 기능을 갖춘 신속한 API를 베타에서 벗어나 발표했다. 음성 AI 기술에서 혁신적인 발전을 이루고 있지만, 의미 있는 개선 사항과 지속적인 도전 과제가 있음을 보여준다.

대형 언어 모델(LLM)은 AI의 다양한 분야에서 중요한 역할을 하고 있지만, 이들은 상태를 유지하지 못하는 한계가 있다. 쿼리마다 이전 정보를 기억하지 못하고 고정된 컨텍스트 창으로 장기 대화나 멀티세션 작업에서 계속된 지식을 축적할 수 없다. 이를 해결하기 위해 강화 학습이 LLM 메모리 에이전트를 어떻게 강화하는지 알아보자.

의료 AI의 최근 발전은 모델의 정교함뿐만 아니라 기반 데이터의 품질과 풍부함에 달려있다. Centaur.ai, Microsoft Research 및 University of Alicante의 협력으로 성과를 거둔 PadChest-GR은 최초의 다중 모달, 이중 언어, 문장 수준 데이터셋이다.

호주의 주요 노력인 카카룸 LLM은 호주 영어와 문화에 맞춘 주권 보장, 오픈소스 대형 언어 모델을 구축하기 위한 노력이다. 호주 특유의 유머, 속어, 법적/윤리적 규범을 이해하는 모델을 만들기 위한 목표를 가지고 있다.

Nous 연구팀이 Hermes 4를 발표했다. 이 모델은 순수 사후 훈련 기술을 통해 선두 수준의 성능을 달성하는데, 복잡한 문제에 대한 심층 고찰이 필요할 때 모델이 표준 응답과 명시적 추론 사이를 전환할 수 있는 하이브리드 추론을 소개했다.

Agentic RAG는 대규모 언어 모델이 외부 맥락에서 결과물을 검색하고 구체화하는 전통적인 RAG의 강점과, 의사 결정 및 도구 사용을 결합한 것이다. 정적 방법과 달리, Agentic RAG는 인공지능 에이전트가 검색, 생성, 쿼리 계획, 반복적 추론을 조율하는데 특징이 있다. 이 에이전트들은 데이터 소스를 자율적으로 선택하고 쿼리를 개선하며 API/도구를 실행한다.

NVIDIA 연구자들이 대형 언어 모델 추론의 효율성 장벽을 깨고, Jet-Nemotron을 공개했는데 이 모델 시리즈는 선도적인 LLM보다 최대 53.6배 높은 생성 처리량을 제공하면서 정확도를 유지하거나 능가한다. 이는 새로운 사전 훈련을 통해 이루어진 것이 아니라는 점이 가장 중요하다.

구글 AI는 Gemini 2.5 플래시 이미지를 공개했습니다. 이 모델은 사용자가 이미지를 설명함으로써 생성하고 편집할 수 있도록 설계되었는데, 정확하고 일관된 고품질 편집을 빠르고 광범위하게 제공하는 것이 혁신적입니다.

AI Singapore가 Google과 협력하여 개발한 SEA-LION v4는 Gemma 3 (27B) 아키텍처를 기반으로 한 오픈소스 다중언어 모델이다. 주로 동남아시아 언어를 지원하며 텍스트와 이미지 이해 능력을 제공한다. SEA-LION v4는 상용 허용 라이선스를 사용한다.

대형 언어 모델은 보통 사전 훈련 후 지도 미세 조정(SFT) 또는 강화 학습 미세 조정(RFT)을 사용해 개선된다. SFT는 예제 기반 학습을 통해 강의 따르기를 효과적으로 가르치지만, 엄격한 행동과 부족한 일반화로 이어질 수 있다. 반면 RFT는 보상 신호를 사용해 모델을 작업 성공을 위해 최적화하지만, […]

JSON 프롬프팅은 AI 모델에 명확하고 기계가 읽을 수 있는 프롬프트를 제공하는 기술이다. 기존의 텍스트 프롬프트와는 달리 JSON 프롬프트는 요구 사항을 키-값 쌍, 배열, 중첩된 객체로 구조화하여 모호함을 없애고 정확한 청사진으로 바꾼다.