YuanLab AI가 오픈소스 Mixture-of-Experts (MoE) 대형 언어 모델인 Yuan 3.0 Ultra를 공개했다. 이 모델은 1조 개의 총 파라미터와 68.8조 개의 활성화된 파라미터를 특징으로 하며, 기업 성능을 최적화하고 사전 훈련 효율성을 높이는 것을 목표로 한다.

YuanLab AI가 오픈소스 Mixture-of-Experts (MoE) 대형 언어 모델인 Yuan 3.0 Ultra를 공개했다. 이 모델은 1조 개의 총 파라미터와 68.8조 개의 활성화된 파라미터를 특징으로 하며, 기업 성능을 최적화하고 사전 훈련 효율성을 높이는 것을 목표로 한다.

Generative AI의 발전은 잠재 확산 모델(LDMs)에 많이 의존하고 있습니다. 잠재 공간으로 데이터를 압축함으로써 모델이 효과적으로 확장될 수 있습니다. 그러나 낮은 정보 밀도는 잠재 변수를 학습하기 쉽게 만들지만 재구성 품질을 희생시키는 기본적인 트레이드오프가 존재합니다.

Perplexity사가 대규모 검색 작업에 최적화된 다국어 임베딩 모델 pplx-embed을 출시했다. 웹 규모 데이터의 복잡성과 잡음을 처리하기 위한 이 모델은 전용 임베딩 API에 대한 대안으로 제작되었다. 양방향 어텐션과 확산을 활용한 구조적 혁신이 돋보인다.

Microsoft의 연구진은 CORPGEN을 소개했는데, 이는 계층적 계획과 메모리를 활용하여 자율형 디지털 직원을 통해 현실적인 조직 업무의 복잡성을 관리하는 데 사용되는 아키텍처에 중립적인 프레임워크이다. 기존의 AI 에이전트는 단일 작업에 대해 평가되지만, 실제 기업 환경에서는 복잡한 종속성을 가진 여러 작업을 동시에 처리해야 한다.

구글 딥마인드 연구팀은 MARL 분야에서 진보를 위해 직관에 의존했던 기존의 방식을 변화시켜, CFR 및 PSRO와 같은 알고리즘을 수동으로 개선하는 대신 의미론적 진화를 적용하여 우수한 알고리즘 수렴을 이룩했다.

NVIDIA가 DreamDojo를 발표했다. 이는 44,711시간의 실제 인간 비디오 데이터로 훈련된 오픈소스 로봇 월드 모델로, 기존의 물리 엔진 대신 픽셀에서 직접 로봇 행동의 결과를 ‘꿈꾼다’.

Zyphra가 EEG 신호에 특화된 380M 파라미터 foundation 모델인 ZUNA를 공개했다. ZUNA는 채널 인필링과 초해상도를 수행하는 마스크된 확산 오토인코더로, Apache-2.0 라이선스 하에 가중치가 포함되어 있다.

구글 딥마인드 연구원들은 현재 대부분의 다중 에이전트 시스템이 환경이 변할 때 실패하는 취약한 하드 코딩 휴리스틱에 의존하고 있음을 지적하며, ‘에이전틱 웹’이 확장되려면 에이전트가 단순히 넘어선 더 복잡한 작업을 수행해야 한다고 주장하고 새로운 해결책을 제안했다.

NVIDIA의 C-RADIOv4는 SigLIP2, DINOv3, SAM3을 하나의 비전 백본으로 통합하여 밀집 또는 세분화 성능을 희생하지 않고 결합하는 방법에 대해 소개합니다. 이 모델은 세 강력한 선생님 모델을 학생 인코더로 결합하여 AM-RADIO 및 RADIOv2.5 라인을 확장하며 계산 비용을 유지하면서 성능을 향상시킵니다.

NVIDIA가 VibeTensor를 공개했는데, 이는 딥러닝을 위한 오픈소스 연구 시스템 소프트웨어 스택이다. VibeTensor는 LLM 기반 코딩 에이전트에 의해 고수준의 인간 안내 아래 생성되었다. 이 시스템은 코딩 에이전트가 Python과 JavaScript API에서 C++ 런타임 구성 요소 및 CUDA 메모리 관리까지 포괄하는 일관된 딥러닝 런타임을 생성할 수 있는지에 대한 구체적인 질문을 제기한다.

Qwen 팀이 코딩 에이전트와 로컬 개발을 위해 디자인된 오픈 웨이트 언어 모델인 Qwen3-Coder-Next를 출시했다. 모델은 80B의 총 파라미터를 가지고 있지만 각 토큰 당 활성화되는 파라미터는 3B뿐이다.

Robbyant은 LingBot-World를 공개했는데, 이는 영상 생성을 상호작용 시뮬레이터로 변환하는 대규모 세계 모델로, 총체 AI, 자율 주행, 게임 등을 위한 환경을 렌더링하며 시각적으로 뛰어나고 반응성이 뛰어난 특징을 갖추고 있다.

AI2가 SERA(Soft Verified Efficient Repository Agents)를 소개했다. SERA는 감독 학습과 합성 경로만 사용하여 훨씬 큰 폐쇄 시스템과 맞추기 위해 개발된 코딩 에이전트 패밀리다. SERA는 AI2의 오픈 코딩 에이전트 시리즈의 첫 번째 릴리스이며, 주요 모델인 SERA-32B는…

DeepSeek AI가 DeepSeek-OCR 2를 공개했습니다. 이는 레이아웃을 고려한 문서 이해 시스템으로, 인간이 복잡한 문서를 스캔하는 방식과 유사하게 페이지를 읽을 수 있도록 구조화합니다. 핵심 구성 요소는 DeepEncoder V2로, 2D 페이지를 1D 시퀀스로 변환하는 언어 모델 스타일의 트랜스포머입니다.

안트 그룹의 LingBot-VLA는 현실 세계에서 실제 로봇 조작을 대상으로 하는 비전 언어 액션 기반 모델이다. 9개의 듀얼 암 로봇을 제어할 수 있는 단일 비전 언어 액션 모델을 구축하는 방법에 대한 연구 결과이며, 약 20,000 시간의 텔레오퍼레이션 양쪽 손 데이터로 학습되었다.

구글 딥마인드가 알파지놈을 소개했다. 이는 시퀀스에서 기능으로의 모델링을 위해 디자인된 통합 딥러닝 모델로, 인간 게놈 모델링 방식의 중대한 변화를 나타낸다.

MBZUAI 연구진이 K2 Think V2를 발표했다. 이는 완전한 주권을 갖춘 추론 모델로, 투명한 훈련 파이프라인을 통해 최신 시스템과 경쟁하는 것을 목표로 한다.

DSGym은 스탠퍼드 대학, Together AI, 더크 대학, 하버드 대학의 연구진들이 소개한 프레임워크로, 1,000개 이상의 데이터 과학 과제를 전문가가 선별한 정답과 함께 평가하고 훈련합니다.

StepFun은 웹 검색을 실제 연구 워크플로우로 변환하는데 목표를 둔 32B 파라미터 엔드 투 엔드 심층 연구 에이전트 Step-DeepResearch를 소개했다. 모델은 Qwen2.5 32B-Base 위에 구축되었으며 장기적인 추론, 도구 사용 및 구조화된 보고를 통한 웹 검색을 연구로 전환한다.

Chroma 1.0은 스피커 식별을 유지하면서 오디오를 입력으로 받아들이고 출력으로 반환하는 실시간 음성-음성 대화 모델이다. 낮은 대기 시간 상호작용과 높은 품질의 개인화된 음성 클로닝을 결합한 최초의 오픈 소스 음성 대화 시스템으로 소개된다.

Salesforce AI 연구팀이 FOFPred를 소개했다. FOFPred는 대형 비전 언어 모델과 확산 트랜스포머를 연결하여 제어 및 비디오 생성 환경에서 밀도 높은 움직임 예측을 위한 언어 주도형 광학 흐름 예측 프레임워크이다.

Microsoft Research가 OptiMind를 출시했다. 이는 자연어로 된 복잡한 의사결정 문제를 최적화 솔버가 실행할 수 있는 수학적 공식으로 변환하는 AI 기반 시스템이다. 이는 전문가 모델러와 수일간의 작업이 필요했던 오퍼레이션 리서치의 병목 현상을 해결한다.

NVIDIA가 개발한 KVzap은 트랜스포머 디코더의 캐시 문제를 해결하는 방법으로, 거의 손실이 없는 2배-4배의 데이터 압축을 제공한다.

Transformers는 주의와 전문가 혼합을 사용하여 연산을 확장하지만, 지식 조회를 수행할 수 있는 기본 방법이 부족하다. DeepSeek의 새로운 Engram 모듈은 MoE와 함께 작동하는 조건부 메모리 축을 추가하여 이 간극을 정확히 겨냥한다.

스탠포드 의학 연구진이 SleepFM Clinical을 소개했는데, 이는 임상 다중 모달 수면 기반 모델로, 임상 다중모달 다뇨종합검사로부터 학습하고 단 하룻밤의 수면으로 장기 질병 위험을 예측한다.

Recursive Language Models는 대규모 언어 모델에서 일반적으로 발생하는 문맥 길이, 정확도 및 비용 사이의 상충 관계를 깨려고 한다. RLM은 모델이 하나의 거대한 프롬프트를 한 번에 읽도록 강요하는 대신, 프롬프트를 외부 환경으로 취급하고 모델이 코드로 어떻게 조사할지 결정한 다음 재귀적으로 호출한다.

구글 딥마인드 연구원들이 Gemma Scope 2를 소개했다. 이는 Gemma 3 언어 모델이 270M에서 27B 파라미터에 이르는 모든 레이어에서 정보를 처리하고 표현하는 방법을 노출하는 해석성 도구 모음이다. 주요 목표는 AI 안전 및 정렬 팀들이 모델 동작을 내부 기능으로 역추적할 수 있는 실용적인 방법을 제공하는 것이다.

NVIDIA가 Nemotron 3 패밀리를 발표했는데, 이는 agentic AI를 위한 완전한 스택으로, 모델 가중치, 데이터셋 및 강화 학습 도구를 포함한다. 이 패밀리는 Nano, Super, Ultra 세 가지 크기로 나뉘어 있으며, 긴 문맥 추론과 추론 비용에 엄격한 제어가 필요한 다중 에이전트 시스템을 대상으로 한다.

Marktechpost의 ML 글로벌 영향 보고서에 따르면, ML 도구의 원산지와 연구 채택 사이에 지리적 불균형이 있음을 밝혀냄. 125개국에서 발표된 5,000여편의 논문을 분석한 결과, 특정 연구 영역에서의 불균형을 보여줌.

Apple과 에든버러 대학의 연구팀이 CLaRa를 발표했다. CLaRa는 연속 잠재 추론을 사용하여 시멘틱 문서를 압축하는 기능을 제공한다.

DeepSeek 연구팀이 DeepSeek-V3.2 및 DeepSeek-V3.2-Speciale을 소개했다. 이 모델들은 에이전트를 위한 고품질 추론, 장문맥, 에이전트 워크플로우를 지향하며 열린 가중치와 제품 API를 갖췄다.

DeepSeek AI가 공개 가중치 대규모 언어 모델인 DeepSeekMath-V2를 발표했다. 이 모델은 자연어 정리를 최적화하고 자가 검증을 통해 자신의 추론이 올바른지 확인하면서 복잡한 올림피아드 수학 문제를 해결할 수 있다.

Meta AI 팀이 Meta Segment Anything Model 3 또는 SAM 3을 공개했다. SAM 3은 간단한 프롬프트를 사용하여 대규모 이미지 및 비디오 컬렉션에서 모든 개념의 인스턴스를 신뢰성 있게 찾고 세분화하고 추적하는 데 사용되는 통합 기본 모델이다.

Uni-MoE-2.0-Omni은 텍스트, 이미지, 오디오, 비디오를 신뢰성 있게 이해하는 오픈 모델로, 하비른 공과대학의 연구진이 소개했다. 이 시스템은 언어 중심의 다중 모달 추론을 위해 Lychee의 Uni-MoE 라인을 발전시킨 것으로, 효율적으로 운영된다.

MBZUAI의 연구진이 PAN이라는 새로운 모델을 소개했다. 이 모델은 시간이 지남에 따라 도착하는 작업에 따라 지속되는 내부 세계 상태를 유지하지 않는 대부분의 텍스트에서 비디오 모델과는 달리, 상호작용 가능한 일반적인 세계 모델로 작용하도록 설계되었다.

Edison Scientific이 만든 Kosmos는 데이터세트와 자연어 목표를 받아들여 반복적인 데이터 분석, 문헌 검색, 가설 생성을 수행하고 결과를 완전히 인용된 과학 보고서로 합성하는 자율 발견 시스템이다.

StepFun AI가 공개한 Step-Audio-EditX는 3B 파라미터 LLM 기반 오디오 모델로, 표현력 있는 음성 편집을 파형 수준 신호 처리 작업이 아닌 토큰 수준 텍스트 작업으로 변환시킴. 개발자들이 제어 가능한 TTS에 관심을 갖는 이유에 대해 설명.

구글 연구자들이 소개한 Nested Learning은 모델을 하나의 외부 루프로 훈련된 단일 네트워크가 아닌 작은 중첩 최적화 문제의 모음으로 처리하는 기계 학습 접근 방식으로, 이전에 학습한 내용을 잊지 않고 새로운 정보를 계속 학습할 수 있는 AI 시스템을 구축하는 방법을 모색한다.

구글 연구원들이 DS STAR(Data Science Agent via Iterative Planning and Verification)를 소개했다. 이는 엔드 투 엔드 데이터 과학 질문을 실행 가능한 Python 코드로 변환하는 멀티 에이전트 프레임워크이다.

CMU 연구진은 프로액티브 및 개인화된 LLM 에이전트를 훈련시키기 위해 PPP와 UserVille을 소개했다. 기존 LLM 에이전트들은 과제 성공을 극대화하기 위해 조정되어 있지만 사용자에게 언제 질문할지, 상호작용 선호도를 어떻게 존중할지 신중하게 이유를 생각하지 않는다. 이에 대한 해결책을 모색하고 있다.

구글 AI가 일관성 훈련을 도입하여 언어 모델이 아부지파 프롬프트와 탈옥 스타일 공격에 저항하면서 능력을 유지하는 방법. 대형 언어 모델은 종종 칭찬이나 롤플레이로 둘러싸인 동일한 작업에 대해 안전하게 응답한 뒤 행동을 바꿀 수 있다. DeepMind 연구원들은 이를 위해 간단한 훈련 렌즈에서 일관성 훈련을 제안한다.

대규모 언어 모델이 텍스트 토큰을 보내지 않고 협업할 수 있는지 연구팀이 증명했다. 캐시-투-캐시(C2C)는 대규모 언어 모델이 KV-Cache를 통해 정보를 교환하는 새로운 통신 패러다임이다.

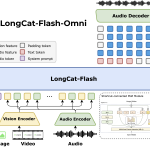

Meituan의 LongCat 팀이 LongCat Flash Omni를 발표했다. 이 모델은 5600억 개 매개변수와 토큰 당 약 27억 개 활성화를 갖춘 오픈소스 옴니 모달 모델로, 텍스트, 이미지, 비디오, 오디오를 실시간으로 듣고 보고 읽고 응답할 수 있는 효율적인 단일 모델을 설계하는 방법이다.

DeepAgent는 사전 정의된 Reason, Act, Observe 루프를 실행하는 대부분의 에이전트 프레임워크와는 달리, 에이전트는 프롬프트에 주입된 도구만 사용할 수 있습니다. 이는 작은 작업에는 작동하지만, 도구 세트가 크거나 작업이 길거나, 추론 중에 전략을 변경해야 하는 경우 실패합니다.

Anthropics의 새 연구는 대형 언어 모델인 Claude가 자체 내부 상태를 인지하는지 아니면 훈련 데이터에서 반복하는지 구별하는 방법을 살펴봅니다. 현재 Claude 모델이 자신의 능력에 대해 이야기하는 것 이상을 할 수 있는지 살펴보며, 주입된 개념을 감지할 수 있는지에 대해 질문을 제기합니다.

Ant Group의 Inclusion AI 팀이 Ling 2.0을 출시했다. 이 모델은 각 토큰의 계산을 거의 바꾸지 않으면서 용량이 증가하는 언어 모델로, 추론 능력을 향상시키는 원리에 기반한다.

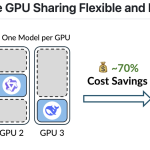

‘kvcached’는 공유 GPU에서 LLM 서빙을 위해 가상화된 탄력있는 KV 캐시를 가능하게 하는 머신러닝 라이브러리입니다. 기존에는 모델당 큰 정적 KV 캐시 영역을 미리 예약하여 GPU 메모리를 낭비했지만, kvcached를 사용하면 이를 최적화할 수 있습니다.

구글 연구팀이 FLAME을 제안했는데, 이는 강력한 오픈 어휘 탐지기를 기반으로 한 단일 단계의 액티브 러닝 전략으로, 훈련할 수 있는 작은 정교화기를 추가하여 가장 정보가 풍부한 샘플을 선택하고 모델 전문화를 빠르게 만드는 방법이다.

구글 연구팀과 UC Santa Cruz의 연구자들이 암 세포의 유전적 변이를 식별하는 AI 모델 ‘DeepSomatic’을 발표했다. Children’s Mercy와의 연구에서, 다른 도구에서 놓친 소아 백혈병 세포의 10가지 변이를 찾아내었다. DeepSomatic은 암 유전체를 위한 체세포 소규모 변이 콜러로, Illumina 단독 독립적으로 작동한다.

DeepSeek-AI가 3B DeepSeek-OCR을 출시했다. 이는 텍스트를 작은 집합의 시각 토큰으로 압축한 뒤 언어 모델로 해당 토큰을 디코딩하는 OCR 및 문서 구문 분석 Vision-Language Model(VLM) 시스템이다. 이미지는 텍스트의 간략한 표현을 갖고 있어 디코더의 시퀀스 길이를 줄인다.

스탠포드, EPFL, UNC의 연구진은 약한 메타 에이전트가 강한 실행 모델을 부르는 코드 워크플로를 설계하고 개선하는 새로운 강화 학습 프레임워크인 Weak-for-Strong Harnessing, W4S를 소개했다. 이 메타 에이전트는 강한 모델을 세밀하게 조정하는 것이 아니라 조정하는 방법을 학습한다. W4S는 워크플로 디자인을 다중 턴으로 형식화한다.

Microsoft Research는 BitNet Distillation을 제안하여 기존의 완전 정밀한 LLM을 특정 작업을 위해 1.58비트의 BitNet 학생으로 변환하고, 정확도를 FP16 교사에 가깝게 유지하면서 CPU 효율성을 향상시킵니다. 이 방법은 SubLN 기반의 구조적 개선, 지속적인 사전 훈련 및 로짓 및 멀티 헤드 어텐션 관계로부터의 이중 신호 증류를 결합합니다.

AutoCode는 LLM이 경쟁 프로그래밍 문제를 만들고 검증할 수 있는 새로운 AI 프레임워크로, UCSD, NYU, University of Washington, 등 다수의 연구진이 개발했다. 이 프레임워크는 인간의 문제 제작자의 작업 흐름을 본떠 LLM이 문제를 생성하고 검증할 수 있게 한다.

바이두의 PaddlePaddle 팀이 PaddleOCR-VL을 출시했습니다. 이 모델은 다국어 문서를 Markdown/JSON으로 변환하는데 사용되며, 텍스트, 표, 수식, 차트, 필기체 등을 구문 분석하는 데 적합합니다.

구글 AI 팀이 C2S-Scale 27B 모델을 발표했다. 이 모델은 270억 개의 매개변수를 갖춘 단일 세포 분석을 위한 모델로, 단일 세포 RNA-seq(scRNA-seq) 프로필을 ‘셀 문장’으로 형식화하여 언어 모델이 세포 상태를 자연스럽게 분석할 수 있게 했다.

NVIDIA 연구진은 MIT, HKU, Tsinghua과 협력하여 오픈소스 QeRL(Quantization-enhanced Reinforcement Learning)을 소개했다. 이 프레임워크는 4비트 FP4로 강화 학습(Reinforcement Learning) 후 훈련을 밀어넣는다.

SwiReasoning은 추론 LLM이 다음 토큰 분포의 엔트로피 추세를 기반으로 블록 단위 신뢰도를 추정하여 잠재 공간에서 생각할지 명시적 사고 체인을 쓸지 결정할 수 있는 디코딩 시간 프레임워크다. 이 방법은 훈련 없이 모델에 대해 Pareto-우수한 정확도/효율성 트레이드오프를 목표로 하며, 수학 및 STEM 벤치마크에서 +1.5%~2.8% 평균 정확도 향상을 보여준다.

스탠포드 대학의 연구진과 ETH 취리히, Google Research, Amazon과의 협업으로 새로운 시계열 언어 모델인 OpenTSLM이 소개되었다. 이 모델은 현재의 LLMs의 한계를 극복하여 의료 분석에 혁신을 가져오고 있다.

스탠포드 대학교, SambaNova Systems, UC 버클리에서 연구진이 소개한 ACE 프레임워크는 LLM 성능을 향상시키는데 모델 가중치를 업데이트하는 대신 입력 컨텍스트를 편집하고 확장함으로써 작동합니다. 컨텍스트는 Generator, Reflector, Curator 세 가지 역할에 의해 유지되며 간결성 편향을 피하기 위해 작은 델타 항목이 점진적으로 병합됩니다.

삼성 SAIT가 발표한 Tiny Recursive Model (TRM)은 2층 구조의 약 7백만 파라미터 재귀 추론기로, ARC-AGI-1에서 44.6-45%의 테스트 정확도와 ARC-AGI-2에서 7.8-8%의 결과를 보여 더 큰 언어 모델인 DeepSeek-R1, o3-mini-high 등을 능가했다.

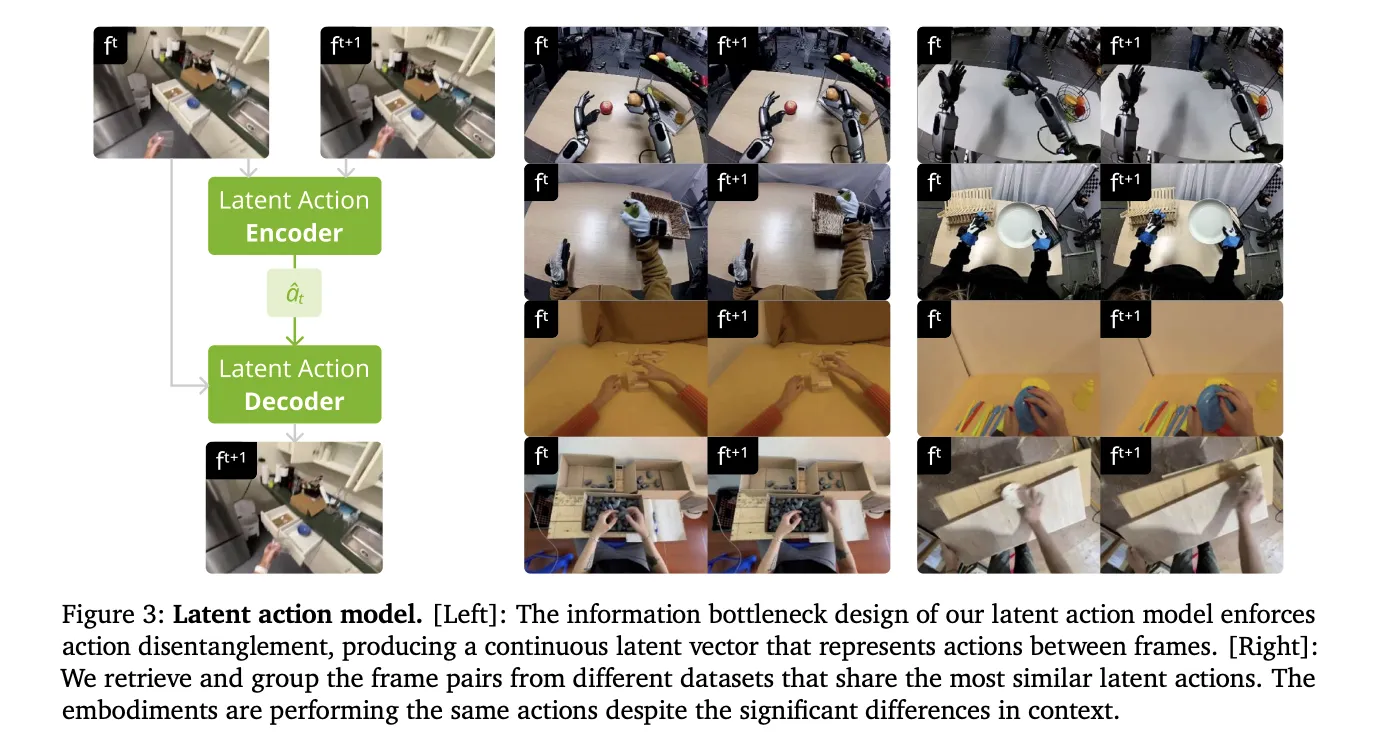

Apple의 새로운 연구는 중간 학습이 강화 학습 후 후속 학습을 하기 전에 무엇을 해야 하는지 공식화하고 RA3 (Reasoning as Action Abstractions)를 소개합니다. RA3는 전문가의 흔적으로부터 시간적으로 일관된 잠재적 행동을 학습하고 그에 대해 미세 조정합니다. 중간 학습은 (1) 최적의 행동 부분 공간으로 가지치기하고 (2) 줄여야 함을 보여줍니다.

AgentFlow는 명시적 메모리와 도구 세트에 의해 조정되는 네 가지 모듈 – Planner, Executor, Verifier, Generator – 을 갖춘 훈련 가능한 에이전트 프레임워크이다. Planner는 Flow-GRPO라는 새로운 온-폴리시 방법을 통해 최적화되며 트라젝토리 수준의 결과 보상을 모든 턴에 방송하고 KL 정규화 및 그룹 정규화된 어드밴티지를 적용하는 토큰 수준의 PPO 스타일 업데이트를 수행한다.

메타 AI가 OpenZL을 공개했다. 이는 형식 인식 그래프 압축기를 훈련시키고 유니버설 디코더에 자체 설명 그래프만 보내어 압축 비율과 처리량을 얼마나 회복할 수 있는지 탐구한 오픈 소스 프레임워크이다.

Salesforce AI Research가 CoDA-1.7B를 발표했다. 이는 양방향 컨텍스트를 사용하여 전체 시퀀스를 정제하고, 왼쪽에서 오른쪽으로 다음 토큰 예측이 아닌 병렬로 여러 토큰을 업데이트하는 코드용 확산 기반 언어 모델이다.

Google Cloud AI Research과 MIT, 하버드, Google DeepMind의 협력자들이 TUMIX (도구 사용 혼합)를 소개했다. 이는 이질적인 에이전트 스타일(텍스트, 코드, 검색, 가이드된 변형)을 앙상블하는 테스트 시간 프레임워크이다.

코넬과 구글의 연구진은 코드 문자열에서 직접 숫자 결과를 예측하는 통합 회귀 언어 모델(RLM)을 소개했습니다. 이 모델은 GPU 커널 지연, 프로그램 메모리 사용량, 심지어 신경망 정확도와 지연까지 손수 조작된 특성 없이 예측합니다. T5-Gemma에서 초기화된 300M 파라미터 인코더-디코더는 단일 텍스트-숫자 디코더를 사용하여 이질적 작업과 언어 간 강력한 순위 상관관계를 달성합니다.

구글 AI가 제안한 ReasoningBank는 LLM 에이전트가 자체 상호 작용 추적을 재사용 가능한 고수준 추론 전략으로 변환하여 미래 결정을 안내하고 에이전트가 자가진화하는 프레임워크를 소개합니다.

DeepSeek가 DeepSeek Sparse Attention (DSA)를 추가한 DeepSeek-V3.2-Exp를 출시했다. 이 업데이트는 장문 맥락 효율성을 높이기 위한 훈련 가능한 희소화 경로를 제공한다. 또한 API 가격을 50% 이상 할인하여 효율성 향상을 보여줬다. 새로운 업데이트는 V3/V3.1 스택(MoE + MLA)을 유지하고 두 단계의 어텐션 경로를 삽입했다.

메타 FAIR가 320억 개의 파라미터로 이루어진 CWM을 공개했다. 이 모델은 코드 생성에 세계 모델링을 삽입하여 실행 추적 및 장기적 상호작용을 통해 학습하며, 코드를 예측함으로써 중간 훈련을 수행한다.

MIT CSAIL 연구진은 PDDL-INSTRUCT를 소개하여 대화식 계획 수립 성능을 향상시키고 LLM의 심볼릭 계획 성능을 높였다. 조정된 Llama-3-8B 모델은 Blocksworld에서 94%의 유효한 계획을 달성했다.

메타 연구원들은 반복되는 추론 패턴을 짧고 이름이 붙은 절차, “행동”,으로 압축한 다음 모델이 추론 시 사용하거나 미세 조정을 통해 정제하는 방법을 소개했다. 결과적으로 MATH에서 추론 토큰 수를 최대 46% 절감하면서 정확도를 유지 또는 향상시키고, AIME에서는 자가 개선 환경에서 최대 10%의 정확도 향상을 이끌어냈다.

구글의 Sensible Agent는 실시간 다중 모달 컨텍스트에 따라 행동과 상호작용 방식을 선택하는 AI 연구 프레임워크이다. 이는 “제안할 것”과 “어떻게 물어볼 것”을 분리하여 접근하는 것이 아니라 둘을 연결시켜준다.

스탠포드 대학 연구팀이 의료 분야에서 대형 언어 모델 에이전트를 평가하기 위해 설계된 MedAgentBench를 발표했다. MedAgentBench는 가상 전자 건강 기록 환경을 제공하여 AI 시스템이 상호 작용, 계획 및 다단계 임상 작업을 실행해야 하는 실제 시나리오를 제공한다.

NVIDIA의 연구진이 ViPE: 3D 기하학 인식을 위한 비디오 포즈 엔진을 공개했다. 이는 비용이 많이 드는 전통적인 방법 없이 로봇학을 위한 AI를 훈련하기 위한 3D 데이터셋을 어떻게 생성하는가에 대한 해결책으로, 3D 컴퓨터 비전 분야의 병목 현상을 해결한다.

구글 AI 연구팀과 딥마인드가 디퍼렌셜 프라이버시(DP)로 완전히 훈련된 최대 규모의 오픈 가중치 대형 언어 모델인 VaultGemma 1B를 공개했다. 이는 강력하면서도 프라이버시 보호가 가능한 AI 모델 구축으로 나아가는 중요한 한걸음이다.

MBZUAI의 연구진이 고급 AI 추론을 위한 32B-파라미터 오픈 추론 시스템 K2 Think을 발표했다. 이 시스템은 강화 학습, 테스트 시 스케일링, 추론 최적화 등을 결합하여 선두적인 성능을 보여준다.

LLM의 시험 시간 계산 확장은 단일 추론 경로를 확장하는 데 의존했지만, 이는 한정된 범위에서는 추론을 개선하지만 성능이 빠르게 수렴한다. 32K 이상의 토큰 예산을 증가시켜도 무의미한 정확도 향상. 이 병목 현상은 초기 토큰에서 발생.

대형 언어 모델은 종종 “환각”을 생성하는데, 이는 올바르지만 잘못된 출력을 확신하며 가능성이 있는 것으로 보인다. OpenAI의 새로운 연구는 환각이 교사 지도 학습과 자기 지도 학습의 통계적 특성에서 비롯되며, 그 지속성은 평가 기준의 불일치로 강화된다는 엄밀한 설명을 제공한다.

구글 AI가 개인 건강 에이전트(PHA)를 소개했다. 이는 맞춤 상호작용을 통해 개인 건강 요구를 해결하는 멀티 에이전트 프레임워크로, 임상 추론, 의사 결정 지원, 소비자 건강 애플리케이션 등 다양한 영역에서 강력한 성능을 보여주고 있다.

최신 대형 언어 모델(Large Language Models, LLMs)은 단순한 텍스트 생성을 넘어섰다. 현실 세계 응용 프로그램들은 이제 이러한 모델이 API, 데이터베이스, 소프트웨어 라이브러리와 같은 외부 도구를 사용하여 복잡한 과제를 해결해야 한다. 그러나 AI 에이전트가 도구 간에 계획을 세우고 추론하며 조정할 수 있는지를 어떻게 정확히 알 수 있을까?

대형 언어 모델(LLM)은 AI의 다양한 분야에서 중요한 역할을 하고 있지만, 이들은 상태를 유지하지 못하는 한계가 있다. 쿼리마다 이전 정보를 기억하지 못하고 고정된 컨텍스트 창으로 장기 대화나 멀티세션 작업에서 계속된 지식을 축적할 수 없다. 이를 해결하기 위해 강화 학습이 LLM 메모리 에이전트를 어떻게 강화하는지 알아보자.

Nous 연구팀이 Hermes 4를 발표했다. 이 모델은 순수 사후 훈련 기술을 통해 선두 수준의 성능을 달성하는데, 복잡한 문제에 대한 심층 고찰이 필요할 때 모델이 표준 응답과 명시적 추론 사이를 전환할 수 있는 하이브리드 추론을 소개했다.

NVIDIA 연구자들이 대형 언어 모델 추론의 효율성 장벽을 깨고, Jet-Nemotron을 공개했는데 이 모델 시리즈는 선도적인 LLM보다 최대 53.6배 높은 생성 처리량을 제공하면서 정확도를 유지하거나 능가한다. 이는 새로운 사전 훈련을 통해 이루어진 것이 아니라는 점이 가장 중요하다.

대형 언어 모델은 보통 사전 훈련 후 지도 미세 조정(SFT) 또는 강화 학습 미세 조정(RFT)을 사용해 개선된다. SFT는 예제 기반 학습을 통해 강의 따르기를 효과적으로 가르치지만, 엄격한 행동과 부족한 일반화로 이어질 수 있다. 반면 RFT는 보상 신호를 사용해 모델을 작업 성공을 위해 최적화하지만, […]

구글 AI팀은 차별적인 개인 파티션 선택을 위한 새로운 머신러닝 알고리즘을 제안했다. 이는 대규모 머신러닝 및 데이터 분석에서 사용자 정보를 보호하는 데 중요한 역할을 한다. 이 알고리즘은 엄격한 개인 정보 보호를 유지하면서 대규모 사용자 기여 데이터셋에서 고유한 항목을 안전하게 추출하는 과정을 포함한다.

NVIDIA가 Nemotron Nano 2 패밀리를 공개했는데, 이는 최첨단 추론 정확도를 끌어올리는 하이브리드 Mamba-Transformer 대형 언어 모델을 소개하며 유사한 크기의 모델보다 최대 6배 높은 추론 처리량을 제공합니다. 이 릴리스는 데이터 및 방법론에 대한 전례없는 투명성으로 눈에 띕니다.

LLM 에이전트는 웹 연구, 보고서 작성, 데이터 분석 및 다단계 소프트웨어 워크플로우와 같은 복잡한 작업을 처리하는 데 충분히 강력해졌지만, 절차적 메모리에 어려움을 겪고 있습니다. 이 프레임워크는 프로시저 메모리를 핵심 최적화 대상으로 끌어올려 에이전트를 견고하게 만듭니다.

대형 언어 모델이 자연어 이해부터 추론 및 코드 생성까지 다양한 분야를 혁신시켰다. 그러나 그들의 추론 능력을 실제 초인간 수준으로 끌어올리는 것은 방대하고 고품질의 인간 주석이 필요한 데이터셋 때문에 제한되어 왔다. Tencent AI Seattle Lab, Washington 대학, Maryland 대학 및 […] 연구진이 자체 훈련 데이터를 생성하는 완전 자율 AI 프레임워크인 R-Zero를 개발했다.

CLIP는 현대 비전 및 멀티모달 모델에서 중요한 역할을 하고 있으며, 제로샷 이미지 분류와 MLLM의 비전 인코더로 활용되고 있다. 그러나 대부분의 CLIP 변형은 영어 데이터에만 국한되어 있어 전 세계 웹의 다양한 언어 콘텐츠를 무시한다. 메타 CLIP를 포함한 대부분의 CLIP 변형은 영어 데이터만을 다룬다.

알리바바가 GSPO 알고리즘을 소개했다. 이 알고리즘은 Qwen3 모델을 촉진하는 효율적인 강화 학습 알고리즘이다. GSPO는 언어 모델의 확장에 결정적인 역할을 하며, 보다 심층적인 추론을 통해 경쟁 수준의 수학과 프로그래밍과 같은 복잡한 작업을 해결할 수 있도록 돕는다.

LLMs는 도움이 되고 무해하며 정직한 보조자 페르소나를 제공하는 대화형 인터페이스를 통해 배포된다. 그러나 LLMs는 훈련 및 배포 단계 전체에서 일관된 성격 특성을 유지하지 못한다. LLMs는 다양한 프롬프트 전략이나 문맥적 입력에 노출될 때 드라마틱하고 예측할 수 없는 페르소나 변화를 보인다. 훈련 과정은 의도하지 않은 성격 변화를 일으킬 수도 있다.

바이트댄스가 자연어 확장을 통해 수학적 추론을 향상시키는 LLMs를 소개했으며, 자연어 증명의 정확성 검증이 어려운 문제를 해결하기 위해 Seed-Prover를 도입했다.

DeepReinforce 팀이 CUDA-L1이라는 새로운 프레임워크를 소개했는데, 이는 인간 개입 없이 GPU로부터 평균 3.12배의 속도 향상과 최대 120배의 가속을 제공한다. 이는 학술적인 약속에 그치지 않고, 모든 결과가 오픈 소스 코드로 NVIDIA 하드웨어에서 재현 가능하다.

Falcon-H1 시리즈는 대형 언어 모델의 진화에서 중요한 발전을 이룬다. Transformer 기반 어텐션과 Mamba 기반 상태 공간 모델 (SSM)을 하이브리드 병렬 구성으로 통합하여 Falcon-H1은 우수한 성능, 메모리 효율성 및 확장성을 달성한다. 다양한 크기로 출시되며 0.5B~34B 파라미터를 제공한다.

LLM을 활용한 번역 시스템은 인간 번역가를 능가할 정도로 발전했다. 그러나 LLM이 복잡한 작업에서 발전하면서 평가도 더 어려워지고 있다. 이에 TransEvalnia는 세밀하고 인간 중심의 번역 평가를 위한 프롬프팅 기반 시스템으로 개발되었다.

알파어스 재단은 AI 기술을 활용한 행성 매핑을 위해 구글 딥마인드가 개발한 ‘가상 위성’ 기술을 소개합니다. 지구 관측 데이터가 폭증하고 있지만 고품질 지면 실측 데이터 부족 문제를 해결하고자 합니다.

대형 언어 모델(LLMs)의 최근 발전으로 모델이 추론 중에 ‘더 오래 생각하게’ 함으로써 일반적으로 정확도와 견고성이 향상된다는 아이디어가 증가했다. 그러나 Anthropics이 주도한 연구 “테스트 시간 계산의 역 스케일링”은 강력한 반론을 제시한다.

Rubrics as Rewards (RaR)는 체계적이고 다중 기준을 갖는 평가 신호를 활용해 언어 모델을 교육하는 강화 학습 프레임워크이다. 명확하고 검증 가능한 결과를 갖는 과제에 대해 복잡한 추론을 수행하는 강화 학습을 통해 수학 및 코딩 분야에서 뛰어난 성능을 보이지만, 직접적인 보상 신호가 없는 모델을 교육하는 것에 도전이 존재한다.

VLM2Vec-V2는 이미지, 비디오, 시각 문서 등 다양한 데이터 형식을 공유된 밀집 표현 공간으로 인코딩하여 다중 모달 정보를 전달하는 임베딩 모델이다. 최근 대규모 기초 모델의 발전으로 임베딩 모델이 발전해왔지만, 기존 다중 모달 임베딩 모델은 MMEB 및 M-BEIR과 같은 데이터셋에서 훈련되었고 대부분의 초점이 이미지나 동영상에만 집중되어왔다.

언어 모델 사용자들은 종종 자신이 원하는 것을 명확히 설명하지 않아 이해하기 어려워한다. 현재의 평가 방법은 종종 모델이 사용자의 백그라운드 지식에 따라 다르게 대답해야하는 질문에 대처하기 어렵다.