이 튜토리얼에서는 Daft를 사용하여 고성능의 파이썬 데이터 엔진으로 엔드투엔드 분석 파이프라인을 구축하는 방법을 탐구합니다. MNIST 데이터셋을 로드한 다음 UDF, 피처 엔지니어링, 집계, 조인 및 지연 실행을 통해 점진적으로 변환하는 방법을 살펴봅니다. 구조화된 데이터 처리, 숫자 계산, 이미지 처리 등을 원활하게 결합하는 방법을 보여줍니다.

최신뉴스 전체보기

현재의 로봇 정책은 주로 한 번의 관찰 또는 매우 짧은 역사에 기반하며, 장기 과제에 부족함이 있습니다. 이를 해결하기 위해 Physical Intelligence, Stanford, UC Berkeley, MIT의 연구진이 개발한 멀티 스케일 메모리 시스템은 복잡한 작업에 필요한 15분간의 컨텍스트를 제공합니다.

이 튜토리얼에서는 ColPali를 사용하여 엔드 투 엔드 시각 문서 검색 파이프라인을 구축한다. PDF 페이지를 이미지로 렌더링하고 ColPali의 다중 벡터 표현을 사용하여 페이지를 임베드하며, 늦은 상호작용 스코어링을 활용하여 가장 관련성 높은 페이지를 검색한다.

안토니오 토랄바의 연구는 컴퓨터 비전, 기계 학습, 인간 시각 지각에 초점을 맞추고 있다.

Black Forest Labs가 FLUX.2 [klein]을 출시했다. 이 모델은 대화형 시각 인텔리전스에 초점을 맞춘 소형 이미지 모델로, 텍스트에서 이미지로, 이미지에서 이미지로의 통합 아키텍처와 로컬 GPU부터 클라우드 API까지의 배포 옵션을 제공한다.

이 딥러닝 모델은 더 복잡한 조직과 장기에도 적용 가능하며, 연구자들이 질병의 초기 징후를 식별하는 데 도움을 줄 수 있습니다.

Zhipu AI가 GLM-4.6V 시리즈를 공개했다. 이미지, 비디오, 도구를 주요 입력으로 취급하는 비전 언어 모델로, 텍스트 위에 올려진 후속 조치가 아닌 에이전트를 위한 것이다.

Black Forest Labs가 FLUX.2를 발표했습니다. FLUX.2는 실제 창의적 워크플로우를 대상으로 하며, 마케팅 자산, 제품 사진, 디자인 레이아웃, 복잡한 인포그래픽 등에 편집 지원을 제공합니다. FLUX.2 제품군과 FLUX.2 [dev]가 소개되었습니다.

Meta AI 팀이 Meta Segment Anything Model 3 또는 SAM 3을 공개했다. SAM 3은 간단한 프롬프트를 사용하여 대규모 이미지 및 비디오 컬렉션에서 모든 개념의 인스턴스를 신뢰성 있게 찾고 세분화하고 추적하는 데 사용되는 통합 기본 모델이다.

이 튜토리얼에서는 Optuna를 사용하여 가지치기, 다중 목적 최적화, 사용자 정의 콜백 및 풍부한 시각화를 체계적으로 탐색하는 고급 워크플로우를 구현합니다. 각 스니펫을 통해 Optuna가 더 스마트한 탐색 공간을 형성하고 실험 속도를 높이며 모델 향상을 이끄는 통찰을 추출하는 방법을 살펴봅니다.

다중 모달 AI 시스템에서 공간 초감지가 중요한 이유는 강력한 ‘장기적 맥락’ AI 모델조차 오랜 메시 비디오 스트림에서 객체 및 수를 추적할 때 실패하기 때문이다. 이에, 다음에 오는 것을 예측하고 놀라운 중요한 사건만 선택적으로 기억하는 모델들이 다음 경쟁 우위를 확보할 것으로 전망된다.

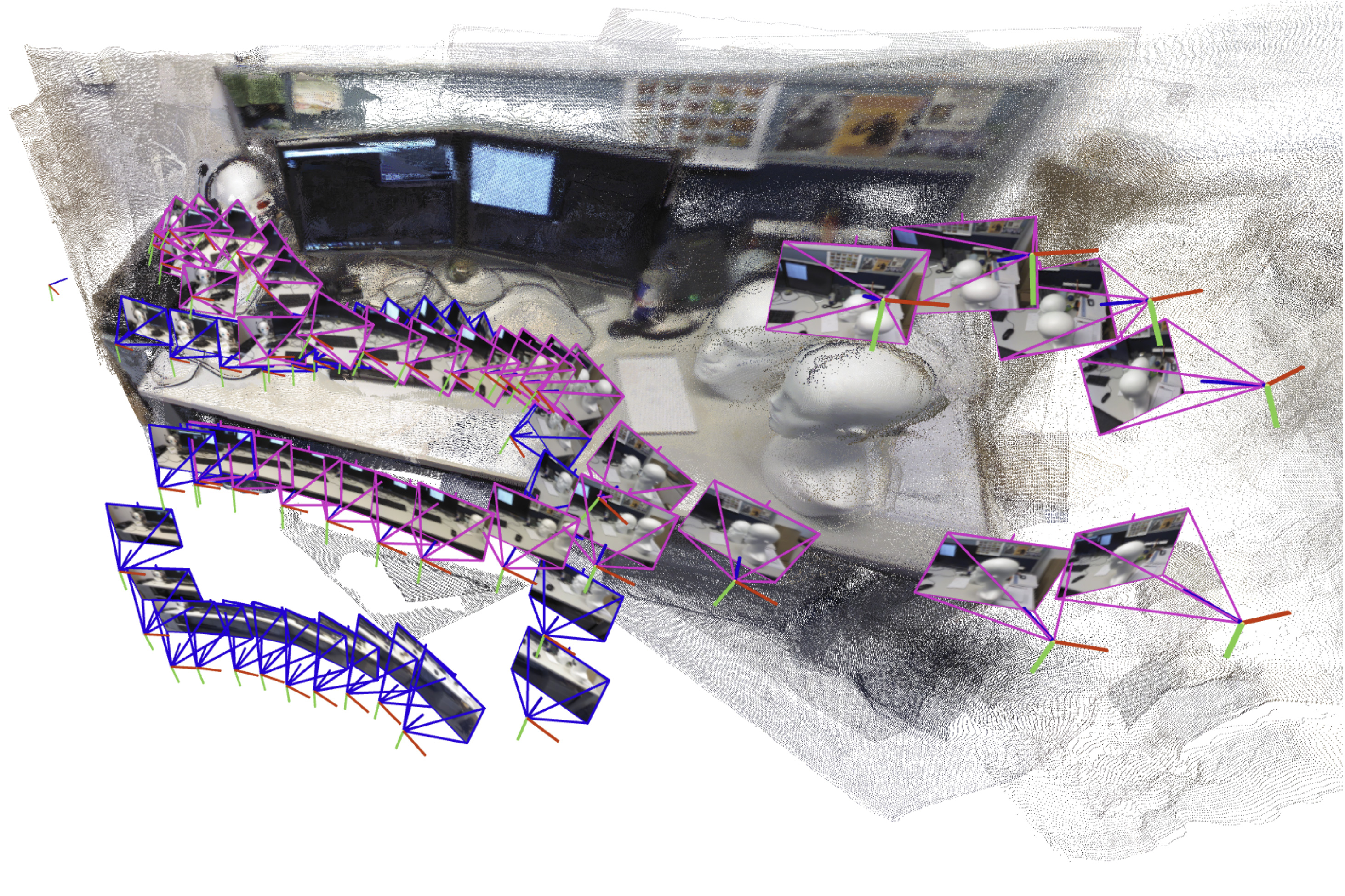

MIT에서 개발된 새로운 접근 방식이 있어, 탐색 및 구조물 파괴 후 구조물을 빠르게 생성하여 주변 환경의 정확한 지도를 만들어 로봇이 예측할 수 있게 돕습니다.

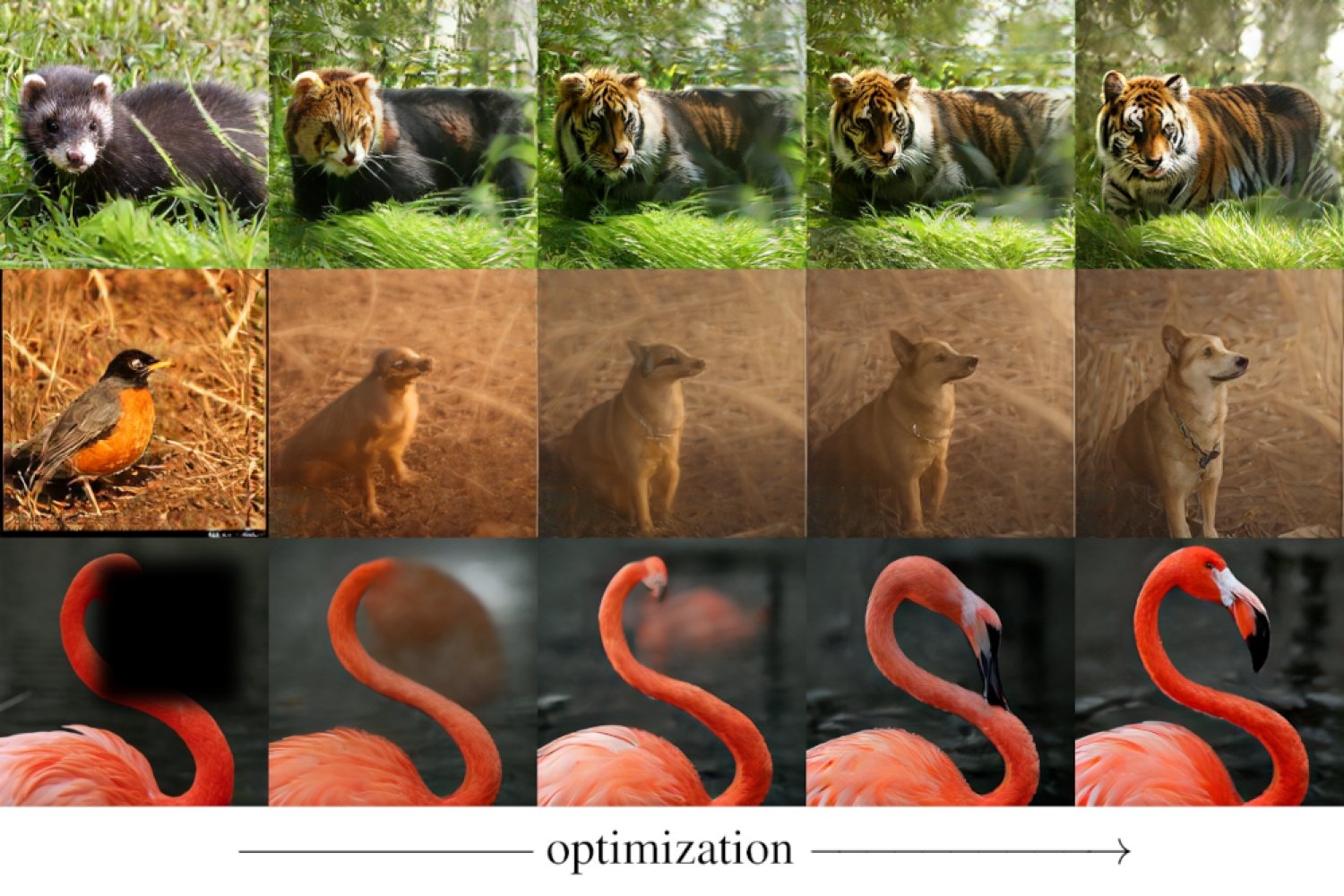

RepTok은 이미지를 단일 연속 잠재 토큰으로 표현하는 생성 모델링 프레임워크로, 자기 지도 비전 트랜스포머로부터 얻은 토큰을 기반으로 한다. 사전 훈련된 SSL 인코더를 기초로 하여 의미론적 토큰 임베딩만을 미세 조정하고 일반적인 흐름 일치 목적을 사용하여 함께 훈련된 생성 디코더와 짝을 이룬다. 이 적응은 토큰을 저수준, 재구성 관련 세부 정보로 보강하여 충실한 이미지 재구성을 가능하게 한다.

MIT 박사과정 학생이자 CSAIL 연구원인 Justin Kay는 AI와 컴퓨터 비전 시스템을 결합하여 우리 행성을 지원하는 생태계를 모니터링하는 작업에 대해 설명합니다.

Salesforce AI 연구팀이 WALT(웹 에이전트가 배우는 도구) 프레임워크를 소개했다. 이 프레임워크는 웹사이트의 잠재적 기능을 재사용 가능한 호출 가능한 도구로 역공학화한다. 이를 통해 브라우저 자동화를 클릭 체인이 아닌 호출 가능한 도구 중심으로 재구성하며, 에이전트는 검색, 필터링, 정렬, 댓글 작성, 목록 생성과 같은 작업을 호출한다.

VISTA는 추론 중에 텍스트에서 비디오 생성을 개선하는 다중 에이전트 프레임워크로, 구조화된 프롬프트를 장면으로 계획하고 최고의 후보를 선택하기 위해 페어와이즈 토너먼트를 실행하며 시각, 음향, 문맥에 걸쳐 특화된 심사위원을 활용하고 깊은 사고 프롬프팅 에이전트로 프롬프트를 다시 작성합니다.

이 논문은 NeurIPS 2025의 Foundation Models for the Brain and Body Workshop에서 받아들여졌다. 고화질의 구조화된 데이터를 사용한 손 제스처 분류는 컴퓨터 비전에서 잘 연구된 문제이다. 낮은 전력과 비용 효율적인 생체 신호인 표면 근전도(sEMG)를 활용하면 웨어러블 기기에서 연속적인 제스처 예측이 가능해진다. 본 논문에서는 약한 모달리티 데이터로부터 표준화된 고화질 데이터와 일치하는 표현을 학습함으로써 표현 품질을 향상시키고 제로샷 학습을 가능하게 한다는 것을 입증한다.

TorchVision의 v2 변환, 현대적인 augmentation 전략 및 강력한 학습 향상 기술을 사용하여 고급 컴퓨터 비전 기술을 탐구하는 튜토리얼. 증강 파이프라인 구축, MixUp 및 CutMix 적용, 주의를 기반으로 한 현대적인 CNN 설계, 견고한 학습 루프 구현 과정 소개. Google Colab에서 모든 것을 원활하게 실행하여 최첨단 컴퓨터 비전에 대비.

2025년 컴퓨터 비전 분야는 새로운 다중 모달 백본, 대규모 오픈 데이터셋, 더 견고한 모델-시스템 통합으로 빠르게 발전했다. 이 목록은 주요 연구 허브, 연구소 블로그, 제품 중심의 엔지니어링 웹사이트를 우선시하여 최신 정보를 제공한다.

IBM이 그래나이트 독링 258M을 공개했다. 이는 엔드 투 엔드 문서 변환을 위해 설계된 오픈소스 비전-언어 모델로, 레이아웃-정확한 추출을 목표로 함. 테이블, 코드, 수식, 목록, 캡션 및 읽기 순서를 처리하여 손실이 적은 Markdown이 아닌 구조화된 기계 판독 가능한 표현을 출력함.

Meta Reality Labs와 Carnegie Mellon University 연구팀이 MapAnything을 소개했다. 이는 Apache 2.0 하에 공개된 end-to-end transformer 구조로, 이미지와 선택적 센서 입력으로부터 직접 3D 장면 지오메트리를 회귀시킨다. MapAnything은 12가지 이상의 3D 비전을 지원하며, 전문 파이프라인을 넘어진다.

영국 당국이 범죄와 기타 문제에 대응하기 위해 얼굴 인식, 인공지능 및 인터넷 규제를 강화하면서 감시 초과의 우려가 증폭되고 있다.

OCR은 이미지 속 텍스트를 기계가 읽을 수 있는 텍스트로 변환하는 과정이다. 규칙 기반 시스템에서 출발해 신경 아키텍처와 언어-시각 모델로 발전하며 복잡하고 다국어, 필기체 문서를 읽을 수 있다.

인간 시각 세계에 대한 내부 표현을 뇌가 어떻게 구축하는지 이해하는 것은 뇌과학에서 가장 매혹적인 도전 중 하나다. 최근 10년간 딥러닝은 컴퓨터 비전을 혁신하여 인간 수준의 정확도로 작업을 수행할 뿐 아니라 정보를 처리하는 방식이 우리의 것과 닮았다는 것을 보여준다.

Apple은 FastVLM을 발표했다. 이는 비교 가능한 크기의 비전 언어 모델(VLM)보다 85배 빠르고 3.4배 작다. 고해상도 이미지를 처리하는 VLM의 성능에 중요한 역할을 하는데, 높은 해상도 이미지에 대한 사전 훈련된 비전 인코더의 비효율성과 추론 실행 시의 계산 비용 증가 등이 도전 요인이다.

2025년 8월 알리바바의 Qwen Team이 출시한 Qwen-Image-Edit는 20B-파라미터 Qwen-Image를 기반으로 고급 편집 기능을 제공한다. 이 모델은 시맨틱 편집(스타일 전이 및 새로운 시각 합성)과 외관 편집에서 뛰어나다.

NASA가 개발한 오픈 소스 멀티모달 모델 ‘갈릴레오’는 다양한 지구 관측 데이터를 처리, 분석, 이해하는 데 활용되며, 광학, 레이더, 해발, 기후, 보조지도 등을 대규모로 처리하는 데 사용된다. McGill 대학, NASA Harvest Ai2, Carleton 대학, British Columbia 대학, Vector Institute, Arizona 주립 대학 등의 연구진의 지원을 받아 개발되었다.

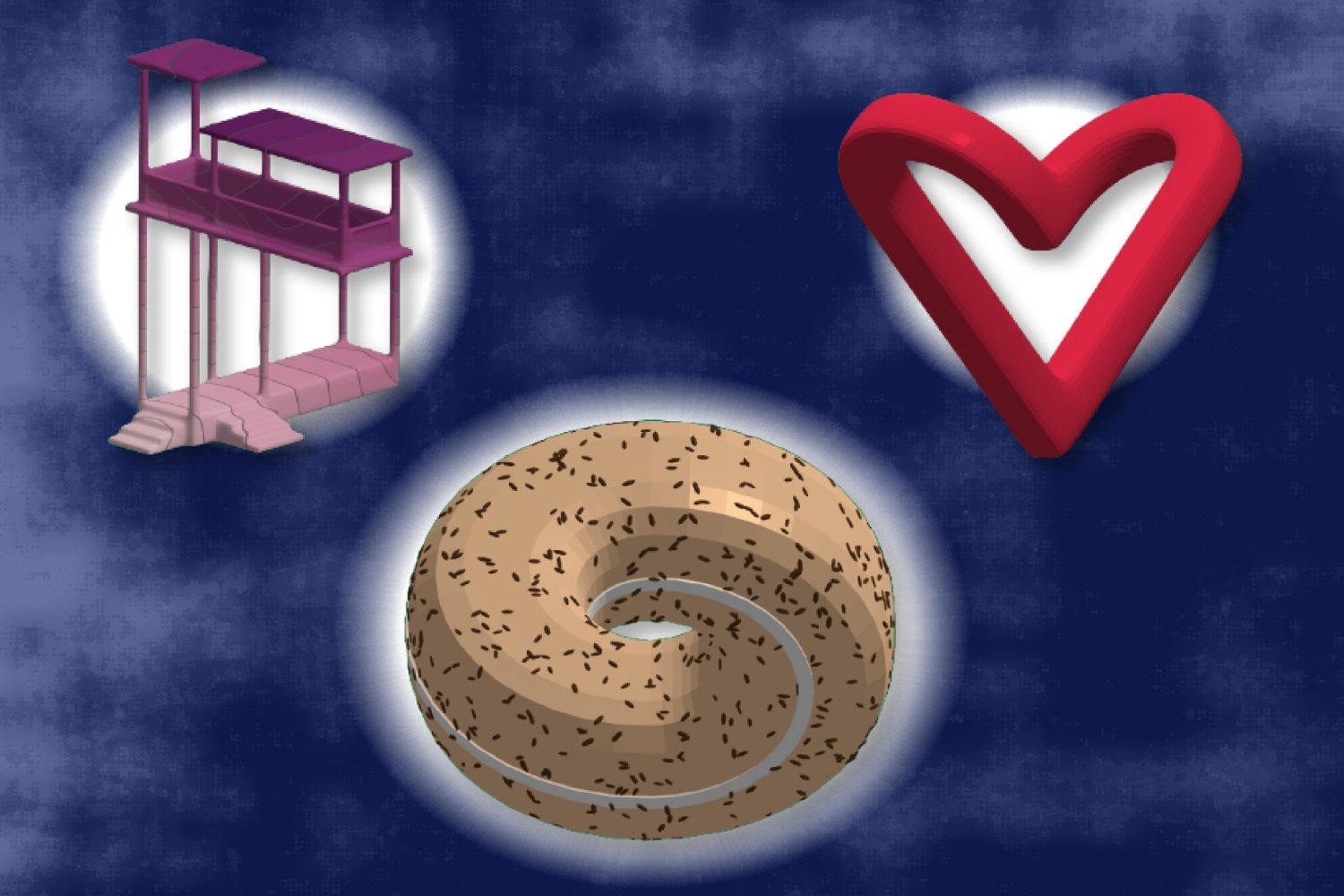

MIT의 “Meschers” 도구는 2.5차원에서 에셔(Escher)와 유사한 광학적 환영을 시각화하여, 물리적으로 불가능한 모양을 이해하고 새로운 디자인을 도와줄 수 있습니다.

NVIDIA와 대만 국립대학의 연구진이 제시한 ThinkAct는 비전-언어-행동 추론을 위한 강화된 시각 잠재 계획을 도입하여 고수준의 다중 모달 추론과 저수준의 로봇 제어를 연결하는 혁신을 선보입니다.

Apple 연구자들이 FastVLM을 소개했다. 이 모델은 비전 언어 모델에서 최신 해상도-지연-정확도 트레이드오프를 달성하는데 중요한 역할을 한다. 높은 해상도 이미지 처리에 대한 도전과 효율적인 사전 훈련 요구 등 다양한 문제를 다룬다.

MIT CSAIL 연구원들이 개발한 Neural Jacobian Fields는 다른 센서 없이 단일 카메라에서 로봇을 제어할 수 있도록 학습할 수 있습니다.

1980년 이후 보행자 행동의 변화를 비교하는 컴퓨터 비전 연구가 도시 디자이너들에게 공공 공간을 만드는 데 도움이 되는 정보를 제공하고 있다.

자기 회귀 비디오 생성은 영상 합성에 초점을 맞추며 공간 배열과 시간 역학의 학습된 패턴을 사용하여 프레임별로 비디오를 생성하는 것이다. 이 논문은 MM-RoPE 및 AR-DF를 활용한 Lumos-1이라는 통합 자기 회귀 비디오 생성기를 소개한다.

MIT 연구진은 특별한 유형의 신경망, 인코더 또는 “토크나이저”가 이전에 인식된 것보다 훨씬 더 많은 작업을 수행할 수 있다고 발견했다.

시각-언어 모델(VLMs)은 시각 콘텐츠의 상세 이해를 가능하게 함으로써 오늘날의 지능 시스템에서 중요한 역할을 한다. 다중 모달 지능 작업의 복잡성이 증가함에 따라 VLM에 대한 요구도 갈수록 증가하고 있으며, 고급 추론에 대한 관심도 커지고 있다.

VLMs는 텍스트와 이미지를 이해하는 데 강하지만 추론 시 종종 텍스트에만 의존하여 공간 퍼즐과 같은 시각적 사고가 필요한 작업을 해결하는 능력이 제한된다. Mirage는 이미지를 렌더링하지 않고도 VLMs에서 멀티모달 추론을 가능하게 한다.

JarvisArt는 예술적 의도와 기술적 실행 사이의 간극을 줄이는데 도움을 주는 사진 편집 에이전트입니다. 사용자들은 이미지 톤, 노출 및 대조와 같은 요소들을 조작하여 시각적으로 매력적인 콘텐츠를 만들 수 있습니다.

대규모 멀티모달 모델(LMMs)은 이미지 해석, 시각적 질문에 답변, 다중 모달을 결합하여 사실 정보를 검색하는 시스템을 가능하게 한다. 그러나 대량의 학습 데이터가 있더라도 LMMs는 종종 동적이거나 발전하는 정보를 간과하는데, 특히 학습 후에 나타나는 사실들을 놓칠 수 있다.

인간 시각 지각과 몸의 움직임 간의 연결을 이해하는 것은 지능형 시스템을 개발하는 데 중요하다. PEVA는 인간의 몸 운동을 기반으로 에고센트릭 시점에서 보이는 것을 예측하는 모델이다.

새로운 반도체를 분석하기 위해 개발된 시스템은 더 강력한 태양 전지의 개발을 간소화할 수 있습니다.

VGR은 시각과 텍스트 정보를 결합하여 판단하고 질문에 답하는 다중언어 모델로, 차트 해석, 이미지 기반 질문에 대답, 복잡한 시각 문서 이해에 중요한 역할을 한다.

비디오 생성을 위한 세밀한 제어는 광고, 영화 제작, 대화형 엔터테인먼트 시장에서의 확산을 위해 중요한 장벽이다. 텍스트 프롬프트는 제어의 주요 수단이지만 동적인 움직임을 명확히 하는 데 한계가 있다.

VLM-R³는 시각과 언어 정보를 통합하여 기계가 다이어그램 내의 수학 문제 해결, 사진에서의 표지판 해석, 과학적 차트 해석 등 다중 모달 추론 능력을 갖추도록 돕는 프레임워크이다. 이는 인간의 사고과정을 모방하는데 도움이 되며 시각적 해석과 논리적 진행이 필요한 작업에 적합하다.

MIT 연구팀이 디지털로 제작된 필름을 사용해 원본 그림을 물리적으로 복원하는 새로운 방법을 개발했다. 필름은 원하는 경우 제거할 수 있다.

VeBrain은 로봇 팔과 다리로 등장하는 기계들이 주변 환경을 인식하고 상황을 해석하며 의미 있는 조치를 취할 수 있도록하는 ML 모델의 통합을 통해 로봇 공학 분야를 발전시키고 자율적인 기계로 나아가고 있다.

MIT 동문 두 명에 의해 설립된 Coactive는 AI 플랫폼을 구축하여 모든 유형의 콘텐츠로부터 새로운 통찰을 얻을 수 있게 함.

알케미스트는 텍스트-이미지(T2I) 생성 분야에서 일관된 출력 품질을 달성하는데 도움을 주는 감독 미세 조정 데이터셋으로, 대규모 사전 훈련만으로는 높은 품질과 정렬을 달성하기 어렵다는 도전에 대응한다. DALL-E 3, Imagen 3, Stable Diffusion 3과 같은 모델의 발전에도 불구하고, 미학적 및 정렬 측면에서 일관된 출력 품질을 달성하는 것은 여전히 과제다.

2025년 6월 11일부터 15일까지 테네시 주 내슈빌에서 개최되는 IEEE/CVF 컴퓨터 비전 및 패턴 인식(CVPR) 컨퍼런스에 Apple이 후원사로 참여할 예정이다. 이 컨퍼런스는 주요 컨퍼런스와 여러 공동 워크샵 및 단기 과정으로 구성된 매년 열리는 컴퓨터 비전 행사이다.

확산 모델은 고품질 이미지 생성에서 성공을 거두었으며, 이제는 다양한 데이터 유형 처리의 기초로 탐구되고 있습니다. 이 능력은 텍스트와 이미지와 같은 이산 데이터와 연속 데이터를 포함한 멀티모달 작업에 유망한 확산 모델을 만듭니다.

다중 모달 대형 언어 모델(Multi-modal large language models, MLLMs)은 다양한 시각적 작업을 처리할 수 있는 다재다능한 AI 어시스턴트로 큰 발전을 이루었다. 그러나 이러한 MLLM들을 격리된 디지턀 엔티티로 배치하는 것은 그들의 잠재력을 제한한다. Meta AI는 Multi-SpatialMLLM을 소개하며 현재 MLLMs의 공간적 추론 결함을 극복하고 실제 응용프로그램에 통합하는 데 도움이 되는 것을 목표로 한다.

MLLM은 시각적 콘텐츠의 풍부함과 언어의 논리를 결합하는 모델을 만드는 것이 핵심. 그러나 두 영역을 효과적으로 연결하는 것에 어려움을 겪어 복잡한 추론 작업에서 성능 제한. 이 논문은 GRIT라는 방법을 소개하여 이미지와 텍스트를 교차시켜 복잡한 추론 작업에서의 성능을 향상시킴.

BLIP3-o는 CLIP 임베딩과 플로우 매칭을 활용한 멀티모달 모델로, 이미지 이해 및 생성에 사용됩니다. 시각과 언어를 연결하는 관심이 높아지면서, 이미지 인식과 생성 기능을 통합한 시스템에 대한 연구가 확대되고 있습니다.

VLM은 일반 목적의 AI 시스템 구축에 중요하며, 시각적 및 텍스트 데이터를 통합함으로써 다중 모달 추론, 이미지 편집, GUI 에이전트, 로봇공학 등을 발전시키고 있음. 그러나 인간의 능력에 아직 미치지 못하는 부분이 있음.

UCLA, UW-Madison, Adobe 연구진이 ‘X-Fusion’을 소개하며 언어 모델에 시각 정보를 추가하는 연구를 발표. 텍스트 이해 능력을 잃지 않으면서 시각 정보를 통합하는 AI 모델의 중요성 강조.

CausVid 생성 AI 도구는 확산 모델을 사용하여 자동회귀(프레임별) 시스템을 가르쳐 안정적이고 고해상도 비디오를 신속하게 생성한다.

미래 불확실성을 보다 정확하게 전달하는 새로운 방법은 연구자와 의료진이 더 나은 결정을 내릴 수 있도록 도울 수 있습니다.

ViSMaP는 짧은 비디오와 캡션으로 구성된 데이터셋에서 학습된 비디오 캡션 모델이 일반적으로 산책이나 대화와 같은 기본 동작을 설명하는 데는 용이하지만, Vlog, 스포츠 이벤트, 영화와 같이 긴 형식의 비디오의 복잡성에는 어려움이 있습니다. ViSMaP는 메타 프롬프팅과 짧은 형식 데이터셋을 사용하여 이러한 문제를 해결합니다.

Microsoft Research가 MMInference를 소개하여 장문 맥락 비전-언어 모델의 사전 채우기 속도를 가속화했다. 이는 로봇공학, 자율 주행, 의료 분야에서 특히 성능을 향상시키는데 도움이 된다.

Meta AI가 Perception Language Model (PLM)을 발표했다. 이 모델은 도전적인 시각 인식 작업을 해결하기 위한 오픈 및 재현 가능한 비전-언어 모델로, 과학적 투명성과 재현성을 높이는 데 기여한다.

연구진은 두 가지 인기 있는 방법을 결합하여 에너지를 적게 사용하고 노트북이나 스마트폰에서 로컬로 실행할 수 있는 이미지 생성기를 만들었다.

교수 Luca Carlone은 로봇에게 인간과 유사한 환경 인식 능력을 부여하기 위해 노력하고 있습니다.