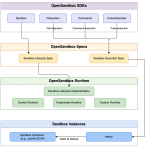

알리바바가 오픈소스 도구인 OpenSandbox를 출시했습니다. 이 도구는 AI 에이전트에 안전하고 격리된 환경을 제공하여 코드 실행, 웹 브라우징, 모델 훈련을 가능하게 합니다. Apache 2.0 라이선스 하에 공개된 OpenSandbox는 AI 에이전트 스택의 ‘실행 레이어’를 표준화하고 여러 프로그래밍 언어에서 작동하는 통일된 API를 제공합니다.

알리바바가 오픈소스 도구인 OpenSandbox를 출시했습니다. 이 도구는 AI 에이전트에 안전하고 격리된 환경을 제공하여 코드 실행, 웹 브라우징, 모델 훈련을 가능하게 합니다. Apache 2.0 라이선스 하에 공개된 OpenSandbox는 AI 에이전트 스택의 ‘실행 레이어’를 표준화하고 여러 프로그래밍 언어에서 작동하는 통일된 API를 제공합니다.

이 튜토리얼에서는 현대 RAG 시스템이 임베딩을 분산 스토리지 노드에 샤딩하는 방식을 반영하는 탄성 벡터 데이터베이스 시뮬레이터를 구축한다. 시스템이 확장될수록 균형 잡힌 배치와 최소한의 재배치를 보장하기 위해 가상 노드로 일관된 해싱을 구현한다. 해싱 링을 실시간으로 시각화하고 노드를 대화식으로 추가하거나 제거한다.

이 튜토리얼에서는 모든 결정을 추적 가능하고 감사 가능하며 인간 승인에 의해 명시적으로 통제되는 유리 상자 형태의 에이전트 워크플로우를 구축합니다. LangGraph의 인터럽트 주도형 인간-루프 제어와 해시 체인 데이터베이스를 결합하여 고위험 작업에 대한 동적 권한 부여를 강제로 시행합니다.

구글의 Universal Commerce Protocol (UCP)는 AI 상거래 에이전트가 제품 링크를 보내는 것을 넘어 채팅 내에서 믿을 수 있는 구매를 완료할 수 있는 오픈 표준이다. 이는 AI 에이전트와 상인 시스템이 공유된 언어를 갖게 함으로써 쇼핑 질의가 제품 발견부터 구매까지 이동할 수 있게 한다.

이 연구는 LLM 에이전트를 위해 장기 기억에 저장할 내용, 단기 기억에 유지할 내용, 버릴 내용을 스스로 결정하는 방법을 설계하는 방법에 대해 다루고 있습니다. 이 연구에서는 텍스트 생성과 동일한 액션 공간을 통해 두 유형의 기억을 관리하는 단일 정책을 학습할 수 있는지에 대해 탐구하고 있습니다.

텐센트의 3D 디지털 휴먼 팀이 HY-Motion 1.0을 공개했다. 이 모델은 자연어 명령과 예상 기간을 3D 인간 동작 클립으로 변환하며, 10억 개의 파라미터를 활용하여 작동한다.

구글이 캐글과 코랩 사이의 간극을 메우기 위해 새로운 기능인 코랩 데이터 익스플로러를 출시했다. 이를 통해 노트북 내에서 캐글 데이터셋, 모델, 대회를 검색하고 편집기를 벗어나지 않고 캐글허브를 통해 가져올 수 있다.

구글은 Gemini 3 Pro를 중심으로 하는 Gemini 3 패밀리를 발표했는데, 이는 백만 토큰 콘텍스트를 다루며 현실 신호를 이해하고 신뢰성 있게 대리자로서 행동할 수 있는 시스템으로 발전하는 과정에서 중요한 한걸음을 나아가고 있다.

Moonshot AI사가 Kimi K2 Thinking을 공개했다. 이 모델은 Kimi K2 Mixture of Experts 아키텍처의 전체 추론 스트림을 노출하는 오픈 소스 사고 에이전트 모델로, 깊은 추론이 필요한 작업을 대상으로 한다.

NVIDIA AI가 강화 학습 사전 학습(RLP)을 소개했습니다. 이는 후속 학습이 아닌 사전 학습 단계에서 강화 학습을 적용하는 교육 목표입니다. 강화 학습을 다음 토큰 예측 전에 샘플링된 작업으로 취급하고 정보 획득에 대한 보상으로 보상합니다.

실제 운영용 에이전트는 모델 선택이 아닌 데이터 배관, 제어 및 관측성에 달려있다. 기업 문서를 처리하고 표준화하며 관리를 시행하고 관계적 특성과 임베딩을 색인화하여 인증된 API 뒤에서 검색 및 생성을 제공하는 “문서 대화” 파이프라인에 대한 설명.

OCR은 이미지 속 텍스트를 기계가 읽을 수 있는 텍스트로 변환하는 과정이다. 규칙 기반 시스템에서 출발해 신경 아키텍처와 언어-시각 모델로 발전하며 복잡하고 다국어, 필기체 문서를 읽을 수 있다.

새로운 다국어 인코더가 필요한 이유와 XLM-RoBERTa가 지배한 다국어 NLP 분야에서 새로운 mmBERT 모델의 소개. 인코더만으로 구성된 mmBERT 모델은 이전 모델보다 2-4배 빠르고 1800개 이상의 언어로 사전 훈련된 3T 토큰을 사용한다.

최근 대형 언어 모델 판단력을 갖춘 AI 에이전트의 발전으로, 임상 대화, 진단 및 치료 계획이 가능해졌습니다. 그러나 개별 진단과 치료 권고는 규제가 엄격하며, 중요한 환자와 직면한 결정에 대한 책임은 라이선스를 받은 임상 의사만이 가질 수 있습니다. 전통적인 의료는 종종 계층적 감독을 사용하며, 경험 많은 의사가 임상 의사의 의사결정을 검토합니다.

본문에서는 중국에서 나온 새로운 연구 논문을 소개하며, 구두 대화 모델의 실제 대화 복잡성을 다루는 능력을 평가하는 것이 중요한 도전이라고 설명하고 있다.

Trackio는 머신 러닝 워크플로우에서 중요한 실험 추적을 간편하고 통찰력 있게 만들어주는 파이썬 라이브러리다. 다양한 실험 추적 솔루션들과는 달리 복잡한 설정이 필요 없으며 라이선스 비용도 없다. 사용자 데이터를 소유권이 있는 프로토콜에 가둬두지 않는다.

의료 이미지 세분화는 현대 의료 AI의 핵심이며 질병 감지, 진행 모니터링, 맞춤형 치료 계획 등 필수적인 작업을 가능케 한다. 그러나 특히 피부과, 영상의학, 심장병학과 같은 분야에서 정확한 세분화의 필요성이 절실하다. GenSeg는 초저 데이터 환경에서 의료 이미지 세분화를 혁신하는 연구이다.

알리바바가 Qwen API를 통해 Qwen3-MT(큐언 엠티터보)를 소개했다. 이는 언어 장벽을 뛰어넘는 놀랍도록 정확하고 빠르며 유연한 최신 기계 번역 모델로, 92개 이상의 언어를 지원하며 전 세계 인구의 95% 이상을 커버한다. 최신 아키텍처, 강화 학습, 풍부한 맞춤 옵션을 활용하여 뛰어난 성능을 보여준다.

아마존 연구원들이 Mitra를 발표했다. Mitra는 타블러 데이터용으로 특별히 설계된 첨단 기반 모델로, 각 데이터셋마다 특별한 모델을 맞춤 제작하는 전통적 방법과 달리, 인-컨텍스트 학습(ICL)과 합성 데이터 사전학습을 활용하여 타블러 기계 학습 벤치마크에서 최첨단 성능을 달성한다. Mitra는 AutoGluon 1.4에 통합되어 강력한 일반화를 제공하며 혁신적인 기능을 제공한다.

Liquid AI가 새로운 엣지 LLMs인 LFM2를 오픈소스로 공개했다. 이 모델은 2배 빠른 추론과 3배 빠른 학습 성능을 제공하며, 컨볼루션과 어텐션 블록을 혼합한 하이브리드 설계를 특징으로 한다. 350M, 700M, 1.2B 파라미터 크기의 세 가지 모델이 제공되며, 유사한 크기의 모델과 비교했을 때 우수한 성능을 보여준다.

인셉션 랩스가 개발한 머큐리는 자동 코드 생성을 위한 확산 기반 언어 모델로, 기존의 자기 회귀 방식보다 빠른 속도로 작동한다. 이는 소프트웨어 개발 분야에서 혁신을 가져올 것으로 기대된다.

구글 딥마인드가 새로운 딥러닝 프레임워크인 알파게놈을 공개했다. 이 모델은 DNA 서열 변이의 조절적 결과를 넓은 생물학적 모달리티에 걸쳐 예측하는 것을 목표로 한다. 알파게놈은 1메가베이스까지의 긴 DNA 서열을 입력으로 받아 베이스 수준의 스플라이싱 이벤트와 같은 고해상도 예측을 출력한다.

심볼릭 추론의 중요성을 강조하며, AI 에이전트가 복잡한 상황에 적응할 수 있도록 하는 것이 중요하다. Dreamer와 같은 신경망 기반 모델은 유연성을 제공하지만 효과적으로 학습하기 위해 엄청난 양의 데이터가 필요하다. 반면 최근 방법들은 더 적은 양의 데이터로도 효율적인 학습이 가능하다.

NovelSeek는 인공지능 도구들이 특정 작업을 처리하는 데 사용되는 반면, 보다 복잡하고 데이터 중심의 문제에 직면하면 발견 속도가 느려질 수 있다는 문제를 해결하기 위해 가설 생성부터 실험 검증까지 자율적으로 수행하는 통합 멀티 에이전트 프레임워크를 소개한다.

다중 모달 대형 언어 모델(Multi-modal large language models, MLLMs)은 다양한 시각적 작업을 처리할 수 있는 다재다능한 AI 어시스턴트로 큰 발전을 이루었다. 그러나 이러한 MLLM들을 격리된 디지턀 엔티티로 배치하는 것은 그들의 잠재력을 제한한다. Meta AI는 Multi-SpatialMLLM을 소개하며 현재 MLLMs의 공간적 추론 결함을 극복하고 실제 응용프로그램에 통합하는 데 도움이 되는 것을 목표로 한다.

기계 학습 시스템이 추천 엔진부터 자율 시스템까지 다양한 응용 프로그램에서 중요해지면서, 이러한 시스템들의 환경 지속 가능성에 대한 필요성이 증가하고 있습니다. CATransformers는 AI 모델과 하드웨어를 지속 가능한 엣지 배포를 위해 공동 최적화하는 탄소 인식 기계 학습 프레임워크입니다.