이 튜토리얼에서는 Vaex를 사용하여 메모리에 데이터를 물리적으로 구현하지 않고 수백만 개의 행에서 효율적으로 작동하는 제품 수준의 분석 및 모델링 파이프라인을 설계합니다. 우리는 현실적인 대규모 데이터 세트를 생성하고, 게으른 표현과 근사 통계를 사용하여 풍부한 행동 및 도시 수준의 피처를 엔지니어링하며, 대규모로 통찰을 집계합니다. 그런 다음 Vaex를 scikit-learn과 통합합니다.

최신뉴스 전체보기

2020년, 머신 러닝을 탐구하기 위해 의식을 갖게 된 스마트 패브릭으로 감싸인 1m 높이의 플라스틱 공룡에 대한 이야기. 머신 러닝과 신경망의 핵심 개념에 대한 일련의 기사가 포스팅되었으며, 각각은 그 당시의 플라스틱 공룡이 학습하는 과정에 대한 짧은 이야기로 시작한다.

주차 공간을 찾는 데 소요되는 시간을 최소화함으로써 이 기술은 운전자들에게 최대 35분을 절약시키고 총 이동 시간을 현실적으로 예측할 수 있습니다.

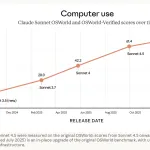

Anthropic사는 Claude 4.6 Sonnet을 발표하여 개발자와 데이터 과학자가 복잡한 논리를 다루는 방식을 변화시키고, 내부 코드 실행을 통해 실시간으로 사실을 확인하는 기능을 갖춘 Improved Web Search를 함께 선보였다.

Ferret-UI Lite는 소형 장치용 GUI 에이전트로, 모바일, 웹, 데스크톱 등 다양한 플랫폼에서 작동한다. 작은 모델을 개발하기 위해 최적화된 기술을 활용하여 실제와 합성 데이터를 활용하고 추론 시간 성능을 강화하는 등의 기법을 사용해 3B Ferret-UI Lite 에이전트를 구축했다.

OpenAI가 GPT-5.3 Codex-Spark라는 새로운 연구 미리보기를 출시했다. 이 모델은 극한 속도에 중점을 둔 것으로, 기존 GPT-5.3 Codex가 심층 추론에 초점을 맞춘 반면, Spark는 거의 즉각적인 응답 시간을 위해 설계되었다. OpenAI와 Cerebras 간의 깊은 하드웨어-소프트웨어 통합의 결과로, Spark는 게임 체인저적인 성과를 보여주고 있다.

마이크로소프트 연구자들이 ‘OrbitalBrain’ 프레임워크를 소개하여 지구 관측 인공위성이 매일 대량의 고해상도 이미지를 촬영하지만 대부분의 데이터가 지상으로 제때 전달되지 않는 문제를 해결하기 위해 우주 분산 기계 학습을 가능케 하는 방안을 제안했습니다.

이 튜토리얼에서는 Qrisp를 사용하여 어떻게 비트를 활용하여 양자 알고리즘을 구축하고 실행하는지 보여줍니다. 그로버 서치, 양자 위상 추정, MaxCut 문제를 위한 완전한 QAOA 워크플로우를 순차적으로 구현하는 방법을 안내합니다.

NVIDIA는 NVFP4 형식의 4비트에서 30B 매개변수 추론 모델을 실행하는 Nemotron-Nano-3-30B-A3B-NVFP4를 출시했다. 이 모델은 NVFP4 배포를 위해 특별히 설계된 Quantization Aware Distillation(QAD)과 혼합 Mamba2 Transformer Mixture of Experts 아키텍처를 결합하며 BF16 기준과 정확도를 유지한다.

DeepSeek 연구자들은 대형 언어 모델 교육에서 발생하는 문제를 해결하려고 노력 중이다. 새로운 방법인 mHC(Manifold Constrained Hyper Connections)은 하이퍼 연결의 풍부한 토폴로지를 유지하면서 섞임 행동을 제한함으로써 안정성을 개선한다.

MIT 연구진이 개발한 AI 도구는 로봇이나 자율 주행 차량용으로 더 나은 센서와 카메라를 설계하는 데 도움을 줄 수 있다.

이 새로운 기술은 LLMs가 질문의 난이도에 따라 추론에 사용하는 계산량을 동적으로 조절할 수 있게 한다.

NVIDIA 연구진이 ToolOrchestra를 발표했습니다. 이는 각 작업 단계마다 올바른 모델 또는 도구를 선택하는 AI 시스템을 어떻게 학습시킬 수 있는지에 대한 혁신적인 방법입니다.

이 튜토리얼에서는 심볼릭 추론의 강점을 신경 학습과 결합하여 강력한 하이브리드 에이전트를 구축하는 방법을 보여줍니다. 우리는 구조, 규칙 및 목표 지향적 행동을 위해 고전적 계획을 사용하는 신경 기호 아키텍처를 만드는 데 초점을 맞추고, 신경망이 인식 및 행동 정제를 처리하도록합니다.

Perplexity의 연구팀이 TransferEngine 및 pplx garden 툴킷을 공개하여, 기존 GPU 클러스터에서 1조 매개변수 언어 모델을 실행하는 방법을 제공함.

xAI의 최신 대형 언어 모델인 Grok 4.1은 인간들에게 감정적으로 지능적이고 신뢰할 수 있는 AI 어시스턴트를 구축하는 방법을 제시한다. 이 모델은 모든 사용자에게 이용 가능하며, 감정 지능을 향상시키고 환각을 줄이며 안전 제어를 강화한다.

구글 딥마인드의 WeatherNext 2는 새로운 함수적 생성 신경망(FGN) 아키텍처와 대규모 앙상블을 결합하여 8배 빠른 확률 기반 날씨 예보를 제공하는 AI 기반의 중기 전역 날씨 예보 시스템이다. Google Search, Gemini, Pixel Weather, Google Maps Platform의 Weather API에 업그레이드된 예보를 제공하고 있으며 Google Maps 통합이 예정되어 있다.

구글 AI 연구팀이 ‘TimesFM-ICF’라는 시계열 예측을 위한 인-컨텍스트 파인튜닝(ICF)을 소개했다. 이는 명령어에서 직접 제공된 여러 관련 시리즈를 활용하도록 TimesFM에 가르치는 연속된 사전 학습 레시피이다. 결과적으로, 이는 몇 가지 샷 예측기로 변환되어 OOD 벤치마크에서 기본 TimesFM 대비 +6.8% 정확도를 제공한다.

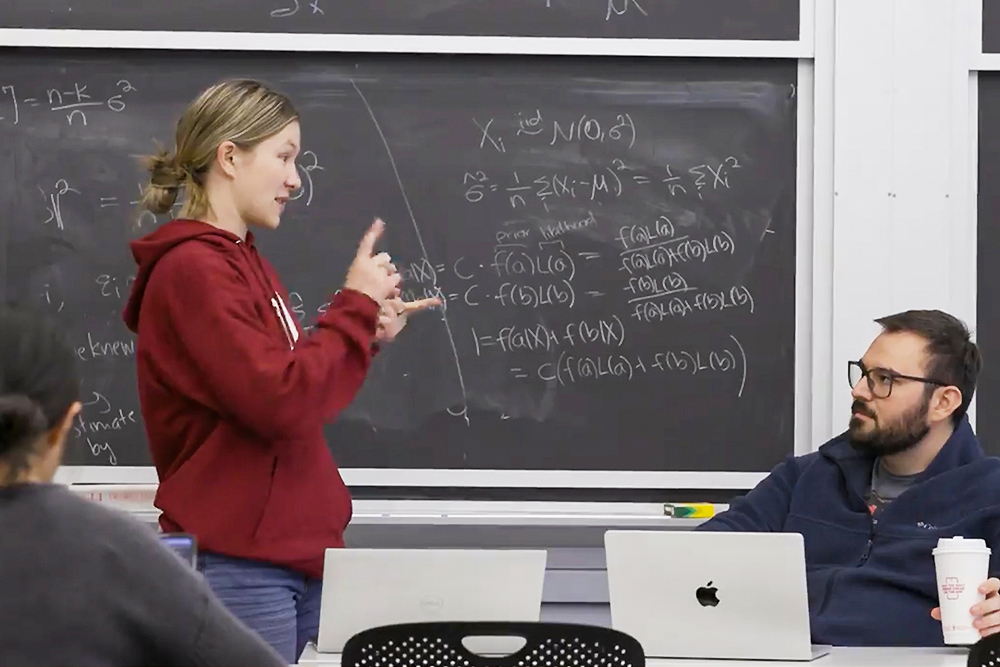

MIT에서 인기 있는 기계 공학 과목이 머신 러닝과 AI 이론을 실제 공학 설계에 적용하고 있습니다.

이 튜토리얼에서는 LLM을 사용하여 비구조화된 문서에서 지식 그래프를 생성하는 방법을 보여줍니다. 기존의 NLP 방법론은 엔티티와 관계를 추출하는 데 사용되었지만, GPT-4o-mini와 같은 Large Language Models (LLMs)는 이 과정을 보다 정확하고 문맥에 맞게 만듭니다. LLMs는 난잡하고 비구조화된 데이터 작업 시 특히 유용합니다. 파이썬을 사용합니다.

Qwen은 새로운 Mixture-of-Experts 아키텍처와 포괄적인 에이전트 코딩 기능을 갖춘 Qwen3-Coder를 발표했다. 이 모델은 오픈 소스 코딩 모델의 새 기준을 제시하며 대규모 자율 개발자 지원의 가능성을 재정의한다.

컨텍스트 엔지니어링은 대형 언어 모델(LLM)에 공급되는 컨텍스트를 설계, 조직화 및 조작하는 학문을 의미하며 모델 가중치나 아키텍처를 미세 조정하는 대신 입력에 초점을 맞춥니다. 이 기술은 프롬프트, 시스템 지침, 검색된 지식, 포맷팅 및 심지어 순서 등을 최적화하여 LLM의 성능을 향상시킵니다.

언어 모델의 성능 향상을 위해 연구자들이 모델을 확장하는데 집중함에 따라, 계산 자원이 증가하고 언어 모델의 개발 및 배포가 상당한 컴퓨팅 자원과 메모리에 의존하게 되었다. PARSCALE은 효율적이고 확장 가능한 언어 모델 배포를 위한 병렬 계산 방법을 소개한다.

후단 대학 연구진은 트랜스포머 모델의 개별 어텐션 헤드를 조사하면서, 일부 헤드에서 ‘해리’ 다음에 ‘포터’와 같은 토큰을 예측하는 기능성을 확인했다. 이를 확인하는 실험으로 ‘Lorsa’라는 희소 어텐션 메커니즘을 소개했다.

IntersectionZoo는 실제 도로 교통 문제를 활용하여 깊은 강화 학습 알고리즘의 진전을 테스트하는 벤치마킹 도구이다.

대형 언어 모델(Large language models, LLM)이 상호작용 환경에서 자율 에이전트로 훈련받을 때 중요한 도전에 직면하고 있다. 순차적 의사 결정, 교차 턴 메모리 유지, 환경적 피드백에 대한 적응 등이 필요한데, 이는 효과적인 계획 보조자, 로봇 응용 프로그램, 경험을 통해 자가 개선할 수 있는 지도 에이전트 개발에 중요하다. 이에 연구진은 StarPO-S와 RAGEN을 도입하여 이러한 도전을 대응하고 있다.

중국의 AI 논문은 대규모 추론 언어 모델이 추론 중 동적 초기 종료를 달성할 수 있는 DEER라는 훈련 무료 접근 방식을 제안했다. 최근 대규모 추론 언어 모델의 발전으로 CoT 생성 길이가 확장되면서 복잡한 문제 해결 능력이 크게 향상되었지만, 지나치게 긴 CoT 시퀀스 생성은 계산 효율성과 대기 시간이 증가한다.

대부분의 대형 언어 모델(LLMs)은 감독된 데이터 파이프라인에 근본적으로 의존하고 있지만, Tsinghua 대학과 상해 AI 연구소 연구진은 테스트 시간 강화 학습(TTRL)을 도입하여 레이블이 없는 데이터를 사용하여 자가 진화 언어 모델을 가능하게 했다. 이는 감독 없이 학습이 가능한 새로운 방법이다.

디퓨전 트랜스포머를 스케일업하여 수십억 개의 파라미터로 확장하는 것이 유망하나, 현재 크기 이상으로 스케일링하는 효과는 여전히 탐구 중이며 어렵다. EC-DIT는 이미지 생성의 계산적 이질성을 명시적으로 이용하여 전문가 선택 라우팅을 사용하는 디퓨전 트랜스포머용 새로운 MoE 모델을 개발한다. EC-DIT는 입력 텍스트를 이해하고 해당 이미지 패치를 생성하기 위해 할당된 계산을 적응적으로 최적화하는 방법을 학습한다.

MIT 연구진은 날씨 예측이나 대기 오염 지도 작성과 같은 공간적 요소를 갖는 예측을 평가하기 위한 새로운 접근 방식을 개발했다.