MLflow를 사용하여 생산용 ML 실험 및 배포 워크플로우를 구축하는 튜토리얼. MLflow 추적 서버를 시작하고 구조화된 백엔드 및 아티팩트 저장소를 사용하여 실험을 추적하고, 중첩된 하이퍼파라미터 스윕을 통해 여러 머신러닝 모델을 훈련하고 자동화된 모델 평가 및 배포까지 진행.

최신뉴스 전체보기

이 Folium 튜토리얼에서는 Colab이나 로컬 Python 환경에서 실행되는 완전한 대화형 지도 세트를 구축합니다. 다양한 베이스맵 스타일을 탐색하고 HTML 팝업을 사용하여 풍부한 마커를 설계하며 히트맵을 사용하여 공간 밀도를 시각화합니다. 또한 GeoJSON에서 지역 수준의 코로플레스 맵을 생성하고 마커 클러스터링을 사용하여 수천 개의 포인트로 확장합니다.

일본의 Sakana AI가 비용 분할을 통해 제한을 우회하는 새로운 접근 방식을 제안했습니다. 최근 두 논문에서 Text-to-LoRA (T2L)과 같은 하이퍼네트워크를 소개하며, 대규모 언어 모델(LLM)의 사용을 개인화하는 과정에서 발생하는 공학적 트레이드오프를 극복했습니다.

연구진은 유휴 컴퓨팅 시간을 활용하여 모델 교육 속도를 두 배로 높일 수 있으며 정확도를 유지할 수 있다.

영국 자율 주행 스타트업 Wayve가 완전한 자율주행을 향해 작업 중인 동안 약 15억 달러를 투자 유치했다.

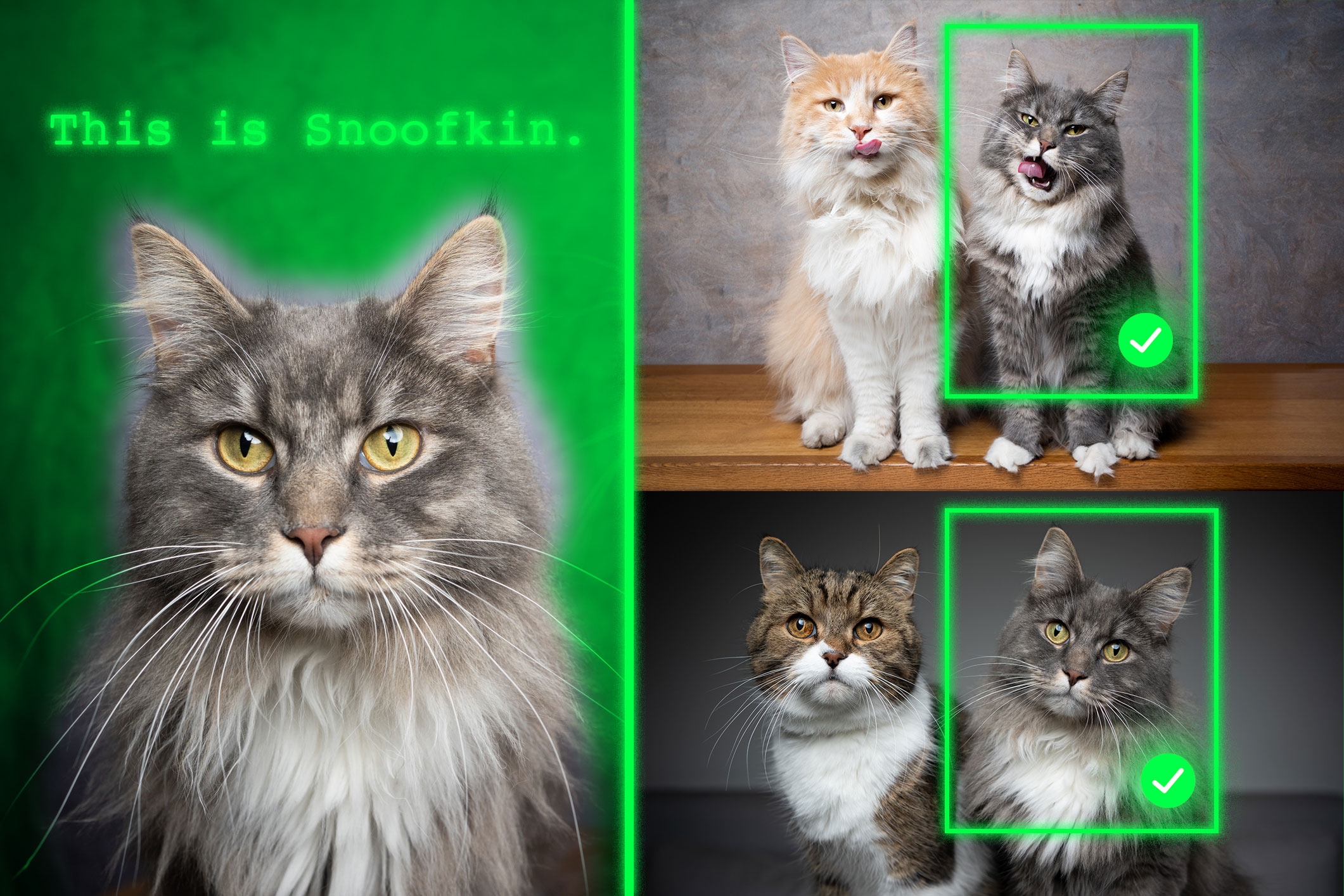

AI 기반 방법을 통해 세포에 대한 종합적인 정보를 제공함으로써 과학자들이 질병 메커니즘을 더 잘 이해하고 실험을 계획하는 데 도움을 줄 수 있음.

MIT의 연구에서 AI 모델이 영어 능력이 낮거나 교육 수준이 낮은, 미국 이외 지역 출신 사용자들에게 성능이 떨어진다는 사실을 발견했다.

구글은 Gemini 3.1 Pro를 공식 출시했는데, 이는 ‘에이전틱’ AI 시장을 겨냥한 것으로, 추론 안정성, 소프트웨어 엔지니어링, 도구 신뢰성에 초점을 맞춰 개발자들을 위한 업데이트다.

MIT에서 개발된 새로운 방법은 대형 언어 모델의 취약점을 찾아내고 안전성과 성능을 향상시킬 수 있습니다.

이 튜토리얼에서는 CTGAN과 SDV 생태계를 사용하여 완전한 프로덕션급 합성 데이터 파이프라인을 구축합니다. 원시 혼합 유형 탭 데이터부터 시작하여 제약 생성, 조건부 샘플링, 통계적 유효성 검사 및 다운스트림 유틸리티 테스트로 진행됩니다.

Rafael Gómez-Bombarelli 교수는 AI를 활용하여 과학 발견을 개선해왔으며, 이제 그는 우리가 기점에 있다고 믿고 있다.

이 튜토리얼에서는 LoRA를 사용하여 대규모 언어 모델의 연합 미세 조정을 수행하면서 개인 텍스트 데이터를 중앙 집중화하지 않고 어떻게 할 수 있는지 보여줍니다. Flower의 연합 학습 시뮬레이션 엔진을 결합하여 여러 조직을 가상 클라이언트로 시뮬레이션하고 각 클라이언트가 가벼운 LoRA 어댑터 매개변수만 교환하면서 공유 기본 모델을 로컬로 적응하는 방법을 보여줍니다.

바이트댄스가 Protenix-v1을 출시했다. 이 모델은 AF3 수준의 성능을 생체 분자 구조 예측에서 달성하며 코드와 모델 매개변수를 Apache 2.0 하에 공개했다.

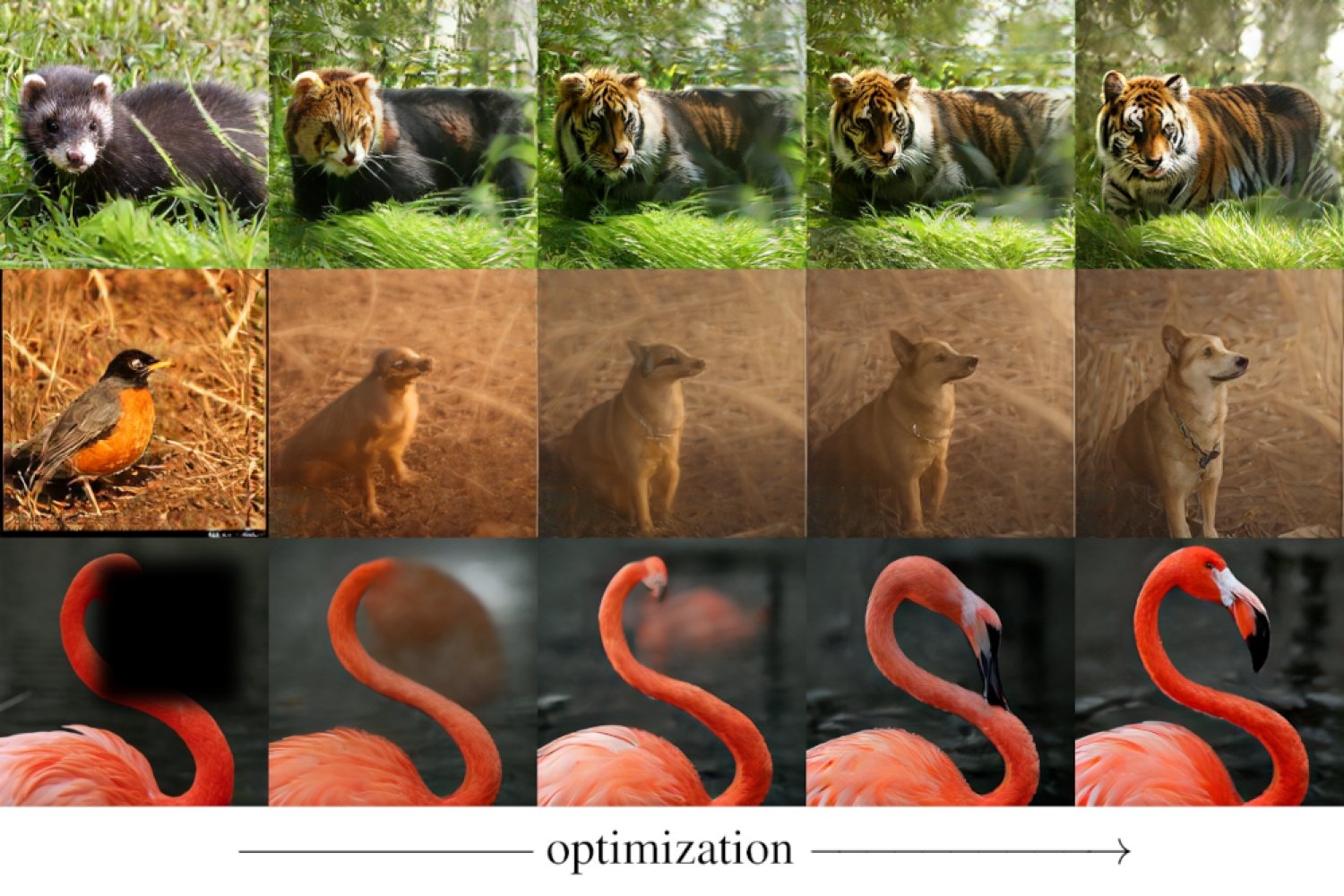

자기 지도 학습은 레이블이 달린 샘플의 명시적 감독 없이 모델이 데이터의 기저 구조를 이해하는 기계 학습 패러다임이다. 자기 지도 학습에서 얻은 표현은 클러스터링, 선형 분류 등 다양한 하위 작업에 유용하게 쓰인다. 대부분의 자기 지도 학습 방법은 주어진 인스턴스와 유사한 관측치 쌍을 생성할 수 있는 능력에 의존하지만, 이러한 쌍을 생성하는 것은 많은 유형의 데이터에 대해 어려울 수 있다. 또한, 이러한 방법들은 고려 사항이 부족하다.

Moonshot AI가 Kimi K2.5를 공개했다. 이 모델은 큰 Mixture of Experts 언어 기반, 네이티브 비전 인코더, 그리고 에이전트 스왐이라는 병렬 멀티 에이전트 시스템을 결합하였다. 이 모델은 코딩, 멀티모달 추론, 그리고 깊은 웹 연구에 초점을 맞추고 있으며 에이전트, 비전, 코딩 분야에서 강력한 성능을 보여준다.

Tree-KG는 의미 임베딩과 명시적 그래프 구조를 결합하여 전통적 검색 보강 생성을 넘어선 고급 계층적 지식 그래프 시스템이다. 이를 통해 우리는 넓은 도메인에서 세부 개념까지 인간이 학습하는 방식을 모방하는 트리 구조로 지식을 구성하고, 이 구조를 통해 추론할 수 있다.

이 튜토리얼은 DeepEval 프레임워크를 사용하여 LLM 애플리케이션에 단위 테스트 엄격성을 더하는 것에 초점을 맞춘 고성능 평가 환경을 구성함으로써 시작된다. 원시 검색과 최종 생성물 간의 간극을 메우면서 모델 출력을 테스트 가능한 코드로 취급하고 LLM-as-a-judge 메트릭을 사용하여 성능을 측정하는 시스템을 구현한다.

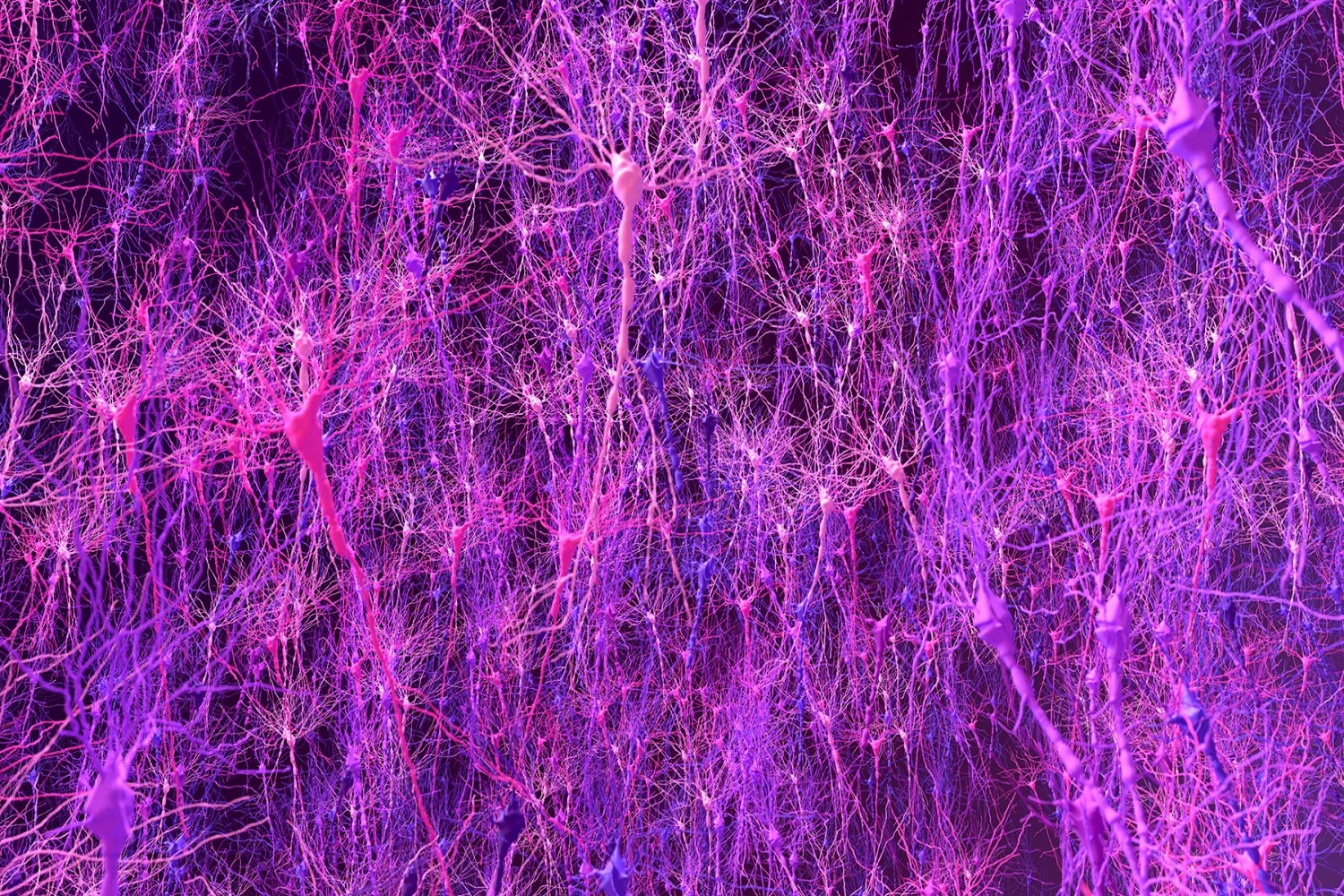

새로운 “생물모방” 뇌 회로 및 기능 모델이 자연스러운 역학과 학습을 보여주었고, 일부 뉴런의 호기심 동작까지 식별함.

새로운 연구에서 잘못된 상관관계의 숨은 증거를 발견하며 정확성을 향상시키는 방법을 제시했다.

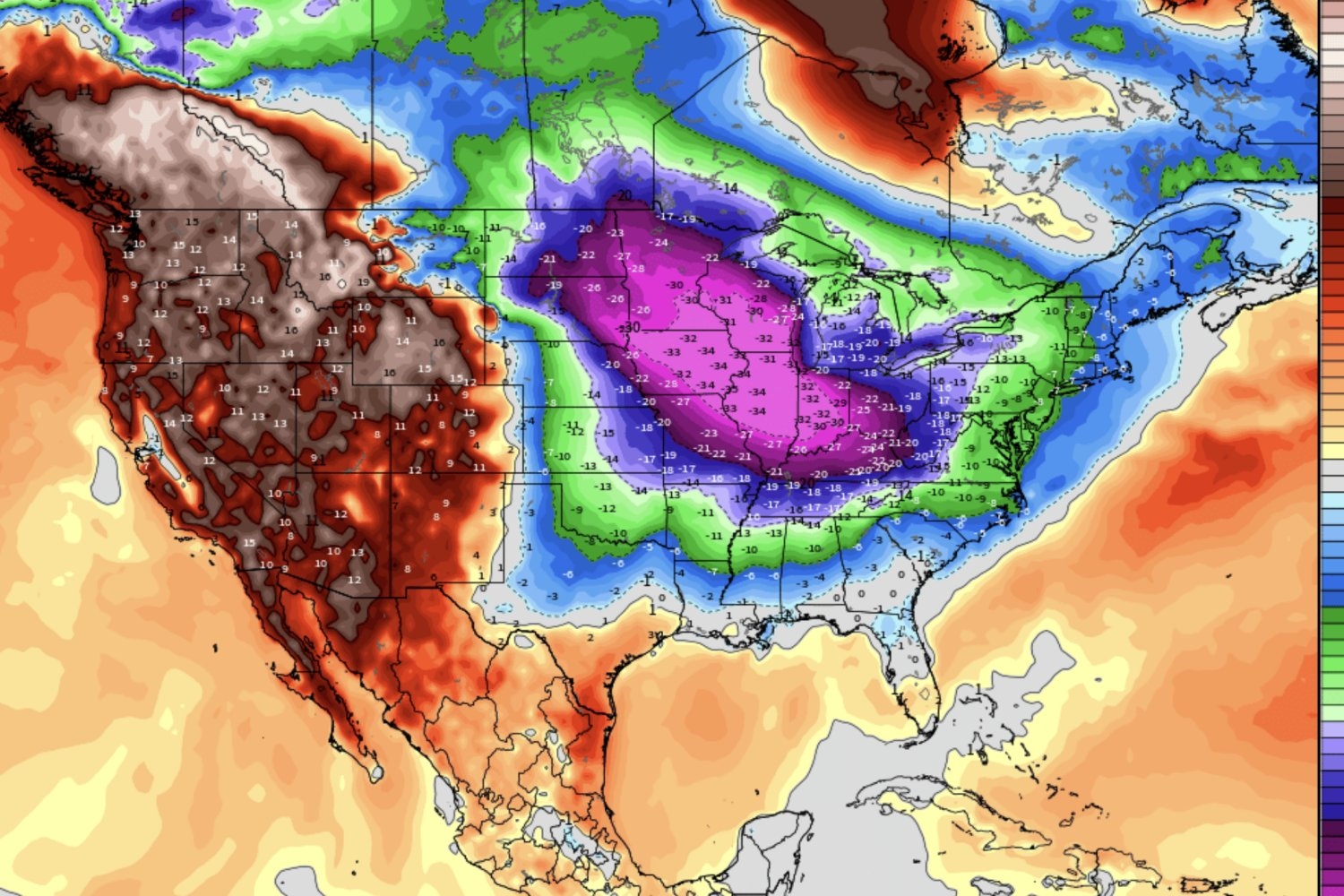

MIT 연구과학자 Judah Cohen은 인공지능의 도움을 받아 하위 계절 예보를 재구성하고, 영향력 있는 날씨 예측을 더 멀리 확장하는 노력을 하고 있다.

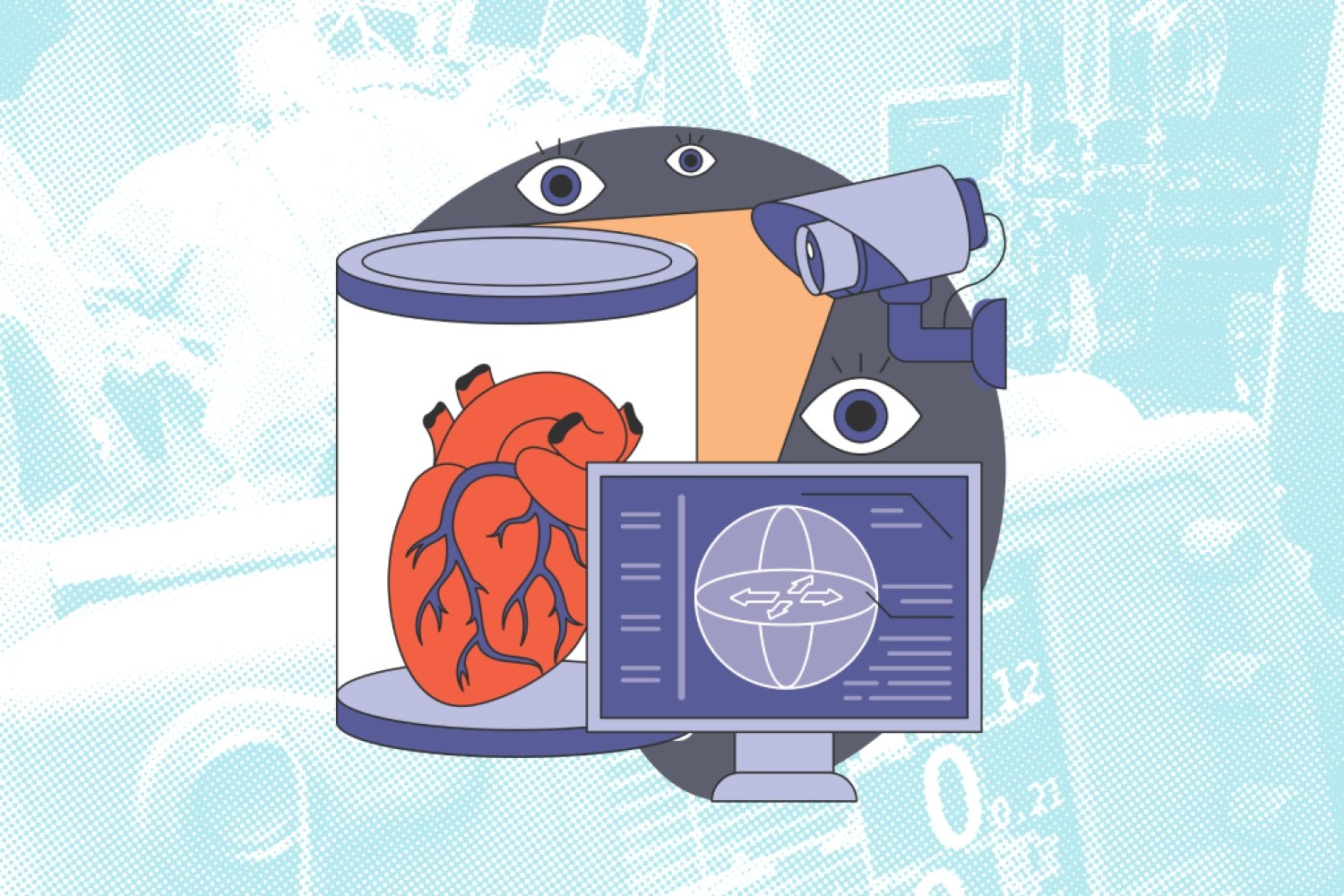

MIT의 새로운 연구는 AI 모델이 익명화된 환자 건강 데이터를 공개함으로써 피해를 입히지 않도록 테스트될 수 있는 방법을 보여줌.

스탠포드, 하버드, UC의 최신 연구 논문인 ‘의지 있는 AI의 적응’에서는 대부분의 ‘의지 있는 AI’ 시스템이 신뢰할 수 없는 도구 사용, 약한 장기 계획, 부족한 일반화 등에 여전히 어려움을 겪고 있다고 설명하고 있다.

Anthropic이 새로운 오픈 소스 에이전틱 프레임워크 ‘Bloom’을 출시했다. 이 프레임워크는 전방위 인공지능 모델의 자동 행동 평가를 위한 것으로, 연구자가 지정한 행동을 측정하여 현실적인 시나리오에서 얼마나 자주 강도 있게 나타나는지 측정한다. ‘Bloom’의 등장은 안전 및 정렬을 위한 행동 평가가 설계 및 유지에 비용이 많이 드는 문제를 해결한다.

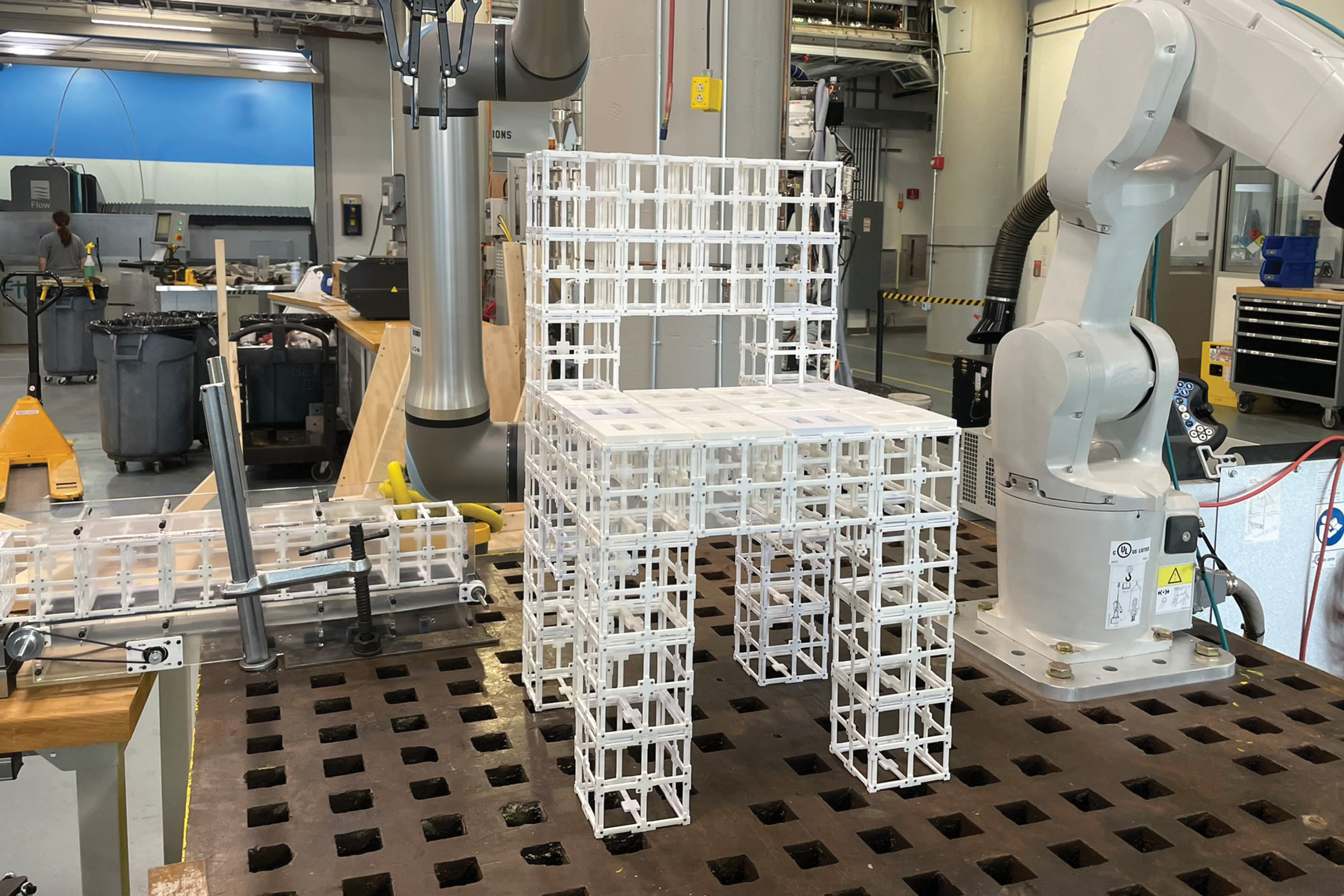

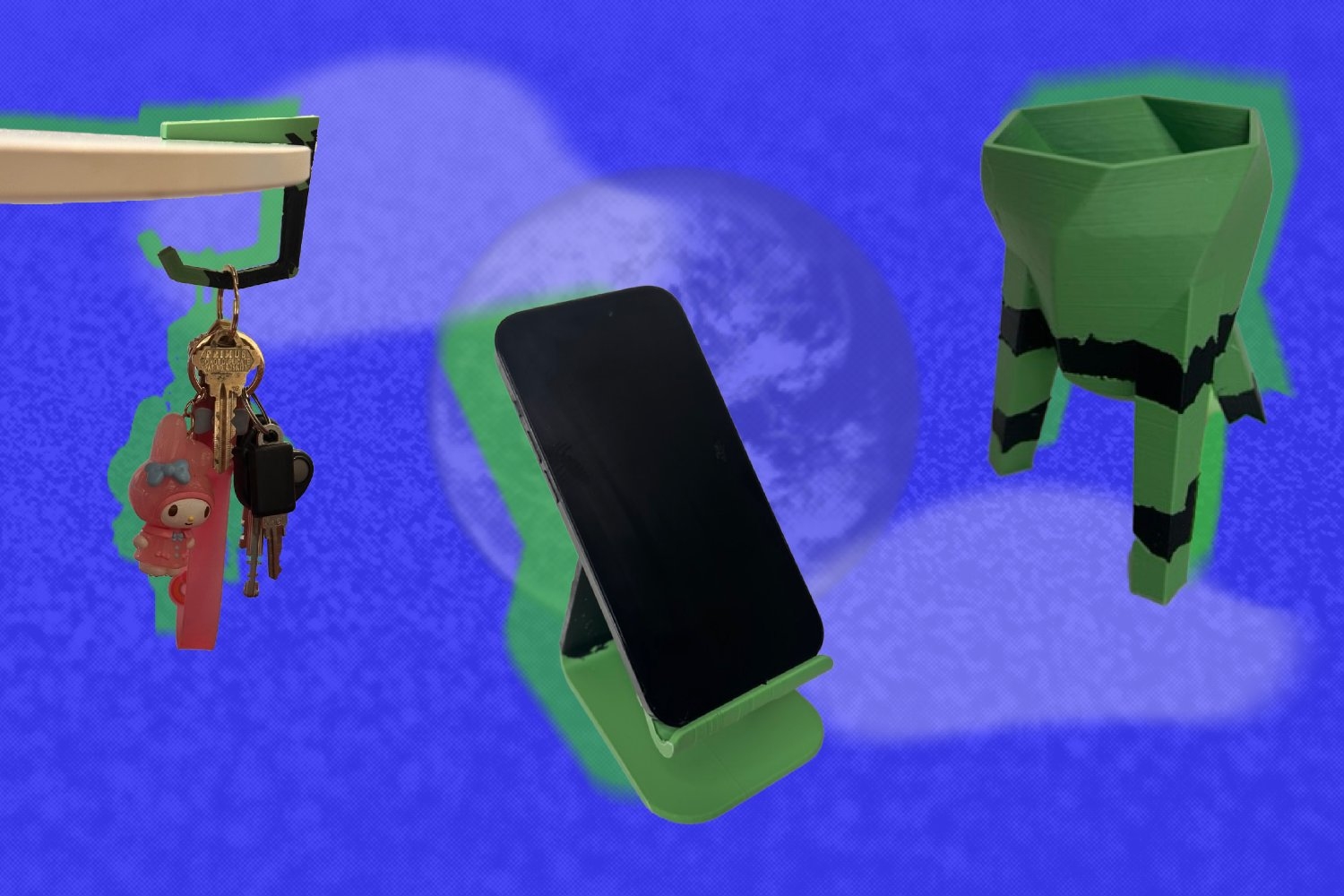

사용자가 단어로 묘사하여 간단한 다중 구성품을 설계하고 제작할 수 있는 AI 시스템이 등장했다.

Boss Zhipin의 Nanbeige LLM Lab이 발표한 Nanbeige4-3B는 데이터 품질, 커리큘럼 스케줄링, 디스틸레이션, 강화 학습에 중점을 둔 3B 파라미터 작은 언어 모델 패밀리로, 30B 클래스 추론을 제공하는 훈련 레시피를 수정함으로써 가능한가에 대한 연구 결과를 소개한다.

경제학, 공중보건 등 여러 분야의 과학자들이 실험 결과를 믿을 만한지 이해하는 데 도움이 되는 기술.

구글 리서치가 타이탄과 미라스로 시퀀스 모델에 장기 기억력을 부여하고, 훈련을 병렬로 유지하면서 추론을 선형에 가깝게 하는 새로운 방법을 제안하고 있다. 타이탄은 트랜스포머 스타일의 백본에 심층 신경 메모리를 추가하는 구체적인 아키텍처이다. 미라스는 일반적인 프레임워크로, 시퀀스 모델에 연관 메모리를 부여하는 방식을 제시하고 있다.

MIT 동문들에 의해 설립된 Pickle Robot Company는 창고와 물류 센터 내에서 자율적으로 화물을 싣고 내릴 수 있는 기계를 개발했다.

이 튜토리얼에서는 자체 추론 깊이를 조절하는 고급 메타-인지 제어 에이전트를 구축한다. 빠른 휴리스틱부터 심층적인 사고 연쇄, 정확한 도구 형식의 문제 해결까지 추론을 스펙트럼으로 취급하고, 각 작업에 대해 사용할 모드를 결정하기 위해 신경 메타-컨트롤러를 훈련시킨다.

MIT 엔지니어들이 벌과 같은 속도와 민첩성으로 작은 로봇을 개발했는데, 이는 언젠가 수색 및 구조 작전에 도움이 될 수 있다.

MIT CSAIL 및 LIDS 연구원들이 부드러운 로봇이 안전 기준을 위반하지 않고 변형, 적응 및 사람 및 물체와 상호 작용할 수 있는 수학적으로 기반된 시스템을 개발했다.

MIT의 AquaCulture Shock 프로그램은 MIT-스칸디나비아 MISTI와 협력하여 해양 양식 분야의 AI와 자율 주행 기술에 대한 국제 인턴십을 제공한다.

Wells Fargo 혁신 부문(IN2) 코호트에 3개의 스타트업이 선정되었는데, 이들은 건물의 에너지 효율성과 신뢰성 향상에 초점을 맞추고 있다. Wells Fargo와 NREL이 공동으로 관리하는 이 $55백만 규모의 에너지 기술 프로그램은 새로운 코호트를 환영했다.

인공지능은 전력 그리드 운영을 관리하고, 인프라 투자를 계획하며, 혁신적인 소재 개발을 지원하는 등 깨끗한 에너지 전환을 지원한다.

MIT 신경과학자들이 인간과 새로운 AI 모델이 복잡한 문제를 해결하는 방식에서 놀라운 유사성을 발견했다.

이 튜토리얼에서는 환경 내에서의 행동 뿐만 아니라 자체 교육 전략을 선택하는 방법을 학습하는 고급 에이전트형 딥 강화 학습 시스템을 구축한다. Dueling Double DQN 학습자를 설계하고 어려움이 증가하는 커리큘럼을 도입하며 학습 중에 적응하는 여러 탐험 모드를 통합한다.

MIT 연구진은 모듈식 개념과 간단한 동기화 규칙을 활용한 코딩 프레임워크를 제안하여 소프트웨어를 더 명확하고 안전하며 LLMs가 생성하기 쉽도록 함.

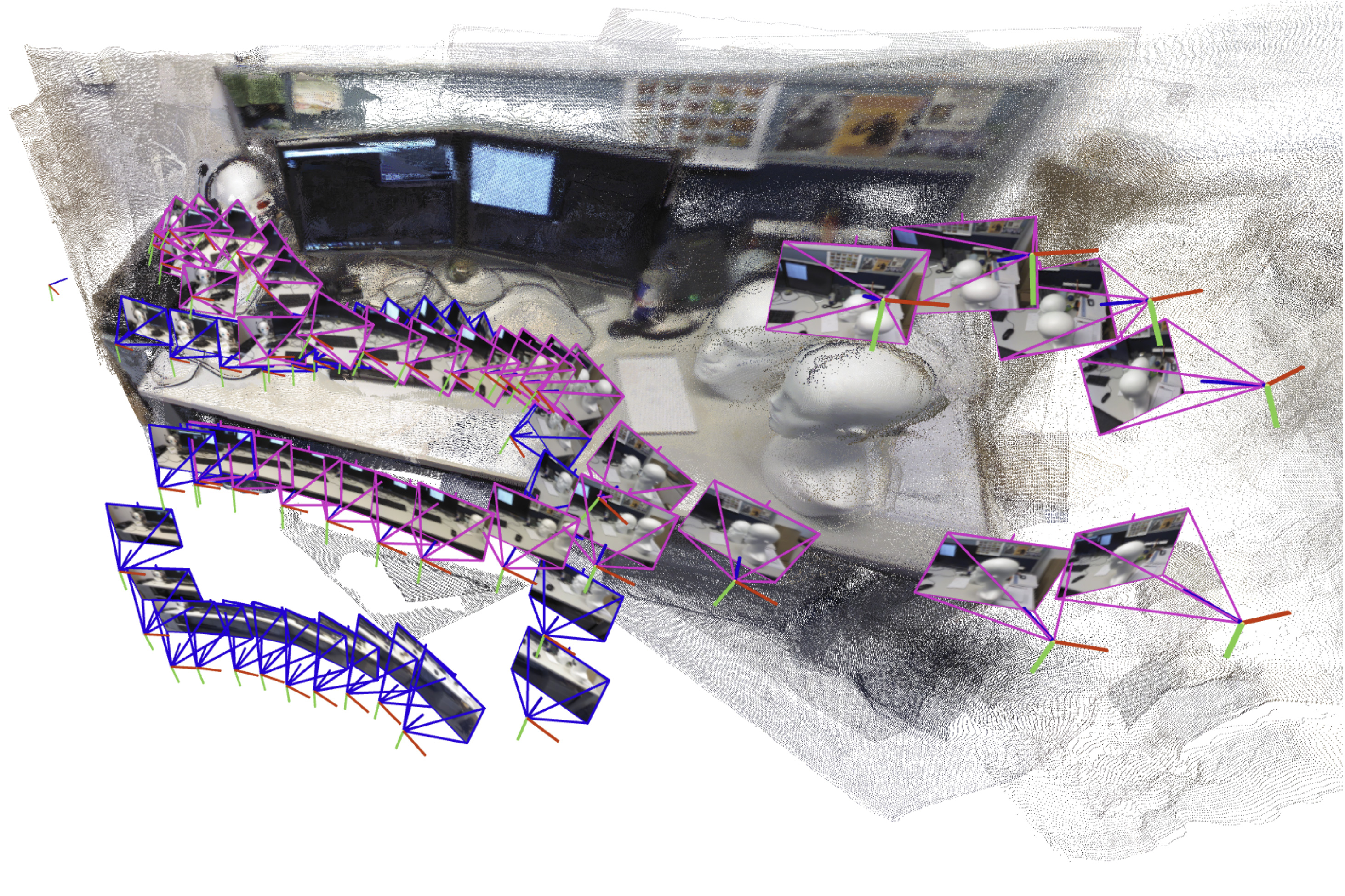

MIT에서 개발된 새로운 접근 방식이 있어, 탐색 및 구조물 파괴 후 구조물을 빠르게 생성하여 주변 환경의 정확한 지도를 만들어 로봇이 예측할 수 있게 돕습니다.

Microsoft AI 팀이 출시한 ‘에이전트 라이트닝’은 기존 AI 에이전트 스택을 변경하지 않고도 강화 학습을 통해 정책 LLM을 개선하는 데 도와주는 오픈소스 프레임워크이다. 훈련과 실행을 분리하여 강화 학습을 모든 AI 에이전트에 대해 가능케 한다.

대형 언어 모델(Large Language Models, LLMs)은 여러 매개변수를 제공하여 행동을 세밀하게 조정하고 응답 생성 방식을 제어할 수 있습니다. 이 튜토리얼에서는 max_completion_tokens, temperature, top_p, presence_penalty 등 일반적으로 사용되는 몇 가지 매개변수를 살펴봅니다.

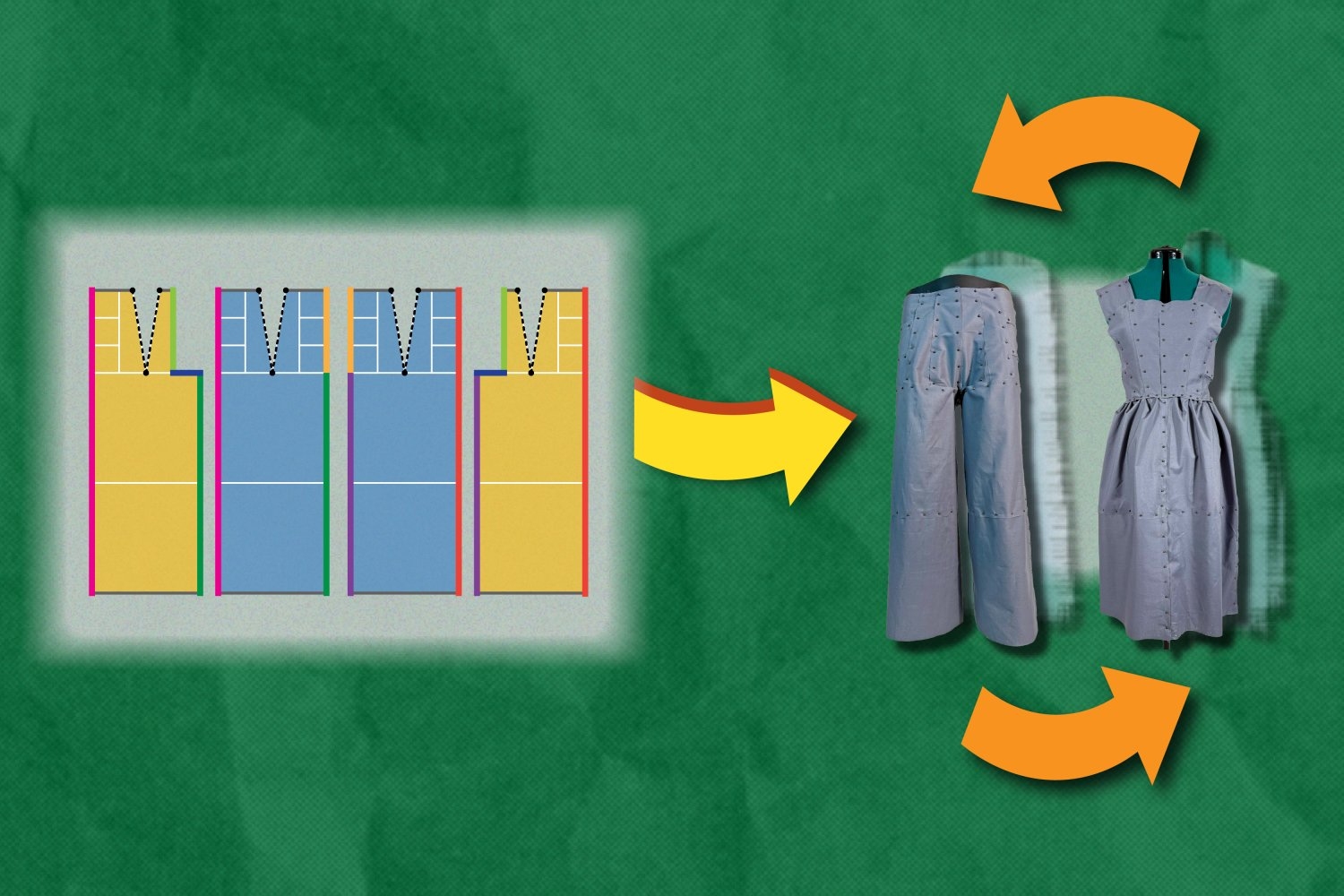

Refashion 프로그램은 사용자가 바지를 드레스로 재구성할 수 있는 적응형 의류의 아웃라인을 만들도록 돕는다. 이러한 의류의 각 구성 요소는 교체, 재배치 또는 재스타일링할 수 있다.

새로운 장면에서 독특한 항목을 더 잘 식별할 수 있도록 비전-언어 모델을 이 기술로 훈련시킨다.

Meta Superintelligence Labs가 제안한 ‘Early Experience’는 보상 없이 에이전트를 훈련하는 새로운 방법으로, 언어 에이전트의 정책 학습을 개선하며 모방 학습을 능가하는 것으로 나타났습니다.

SpectroGen은 가상 분광기 역할을 하며 X-선 또는 적외선과 같은 어떤 모달리티에서도 분광 데이터를 생성하여 재료의 품질을 신속히 평가한다.

MIT 졸업생이 공동 창업한 Watershed Bio는 소프트웨어 엔지니어가 아닌 연구자들이 대규모 분석을 실행할 수 있는 방법을 제공하여 생물학을 가속화하고 있다.

NVIDIA AI가 강화 학습 사전 학습(RLP)을 소개했습니다. 이는 후속 학습이 아닌 사전 학습 단계에서 강화 학습을 적용하는 교육 목표입니다. 강화 학습을 다음 토큰 예측 전에 샘플링된 작업으로 취급하고 정보 획득에 대한 보상으로 보상합니다.

이 자습서에서는 Lightly AI 프레임워크를 사용하여 자기 지도 학습의 힘을 탐구합니다. 레이블 없이 의미 있는 이미지 표현을 학습하는 SimCLR 모델을 구축한 다음 UMAP와 t-SNE을 사용하여 임베딩을 생성하고 시각화합니다. 데이터를 지능적으로 정리하기 위한 코어셋 선택 기술로 진입하고 액티브 러닝 워크플로를 시뮬레이션합니다.

Skala는 Kohn-Sham 밀도 기능 이론(DFT)을 위한 딥러닝 교환-상관 기능으로, 반 하이브리드 수준 정확도를 반 공간 비용에서 달성한다. W4-17에서 MAE는 약 1.06 kcal/mol(단일 참조 하위집합에서 0.85), WTMAD-2는 약 3.89 kcal/mol이다. 주요 분자화학에 적합하며 D3(BJ) 분산 보정을 사용한다.

MIT CSAIL에서 개발한 새 도구는 실제 세계 물체 모델과 상호작용하는 가상 주방과 거실을 만들어 로봇의 훈련 데이터 양을 확장시킴.

MIT 부교수 프리야 돈티는 기계 학습을 활용하여 재생 에너지를 최적화하는 연구를 진행하고 있습니다.

물리학과 기계 학습을 결합한 방법으로, 토카막 퓨전 장치의 전원 차단 시 파괴적인 중단을 피할 수 있다.

MIT CSAIL과 맥마스터 대학 연구진은 생성 모델을 사용하여 좁은 스펙트럼 항생제가 질병을 일으키는 세균을 어떻게 공격하는지 밝혀냄. 이로써 보통 몇 년이 걸리는 과정을 가속화함.

AI 데이터 센터의 급격한 증가로 온실 가스 배출이 증가할 것으로 예상되며, 연구자들은 이 환경 피해를 줄일 수 있는 해결책을 모색 중이다.

MIT의 새로운 “CRESt” 플랫폼은 몇십 년 동안 소재과학 및 공학 분야를 괴롭혀온 실제 에너지 문제에 대한 해결책을 찾는 데 도움이 될 수 있습니다.

의료 이미지의 관심 영역을 신속하게 주석 처리함으로써, 이 도구는 과학자들이 새로운 치료법을 연구하거나 질병 진행을 매핑하는 데 도움을 줄 수 있습니다.

알리바바가 Qwen3-Max를 발표했는데, 이는 조합 전문가(MoE) 모델로, Qwen Chat 및 알리바바 클라우드의 Model Studio API를 통해 즉시 공개되었다. Qwen의 2025년 출시 일정을 미리보기에서 생산까지 이동시키며, Qwen3-Max-Instruct와 Qwen3-Max-Thinking 두 가지 변형에 초점을 맞추고 있다.

알리바바의 큐윈 팀이 새로운 Qwen3-Next-80B-A3B 모델을 위한 FP8-양자화된 체크포인트를 공개했으며, Instruct 및 Thinking 두 가지 후 학습 변형으로 고성능 추론을 위해 설계되었습니다. 이 FP8 레포지토리는 BF16 릴리스를 반영하지만 “미세한 FP8” 가중치와 sglang 및 vLLM 신변 배포 노트가 포장되어 있습니다.

SCIGEN을 사용하여 연구자들은 양자 컴퓨팅과 같은 분야에 적합한 소재를 창출할 수 있는 AI 모델을 조종할 수 있게 되었다.

MIT Generative AI Impact Consortium Symposium에서 연구자와 비즈니스 리더들이 이 강력한 기술을 중심으로 한 잠재적인 발전에 대해 논의했습니다.

알리바바의 통이 랩이 통이-딥리서치-30B-A3B를 오픈소스로 공개했다. 이 모델은 웹 도구를 활용한 장기, 심층 정보탐색을 위해 구축된 에이전트 특화 대형 언어 모델로, 약 30.5B의 총 파라미터와 토큰당 약 3-3.3B의 활성 파라미터를 사용하여 강력한 추론 성능을 유지하면서 고 처리량을 가능케 한다. ReAct 스타일 하의 멀티턴 연구 워크플로우를 대상으로 한다.

IBM이 그래나이트 독링 258M을 공개했다. 이는 엔드 투 엔드 문서 변환을 위해 설계된 오픈소스 비전-언어 모델로, 레이아웃-정확한 추출을 목표로 함. 테이블, 코드, 수식, 목록, 캡션 및 읽기 순서를 처리하여 손실이 적은 Markdown이 아닌 구조화된 기계 판독 가능한 표현을 출력함.

MIT CSAIL 연구원들이 개발한 도구는 태아의 형태와 움직임을 3D로 모델링하여 의사들이 이상을 발견하고 진단하는 데 도움을 줄 수 있습니다.

메타 초지능 연구소, 싱가포르 국립대학교 및 라이스 대학의 연구진이 REFRAG (REpresentation For RAG)를 발표했다. 이는 RAG 효율성을 재고하는 디코딩 프레임워크로, LLM 컨텍스트 창을 16배로 확장하고 정확도를 저해하지 않으면서 첫 번째 토큰까지의 시간을 최대 30.85배 가속화시킨다.

본 튜토리얼은 Gensim과 관련 라이브러리를 사용하여 Google Colab에서 원활하게 실행되는 NLP 파이프라인을 소개한다. 전처리, Latent Dirichlet Allocation (LDA)을 사용한 토픽 모델링, Word2Vec을 이용한 단어 임베딩, TF-IDF 기반 유사도 분석, 의미 검색 등 현대 NLP의 핵심 기술들을 통합한다.

의료 인공지능 분야에서 AI의 역할이 증가하고 있으며, 생물학적 문제를 해결하고 환자 데이터를 해석하는 등 복잡한 작업을 수행할 수 있는 에이전트에 대한 수요가 급증하고 있다.

MIT CSAIL 연구원들이 SustainaPrint 시스템을 개발했다. 이 시스템은 친환경 3D 프린트의 가장 약한 부분만 보강하여 더 적은 플라스틱으로 강도를 높일 수 있다.

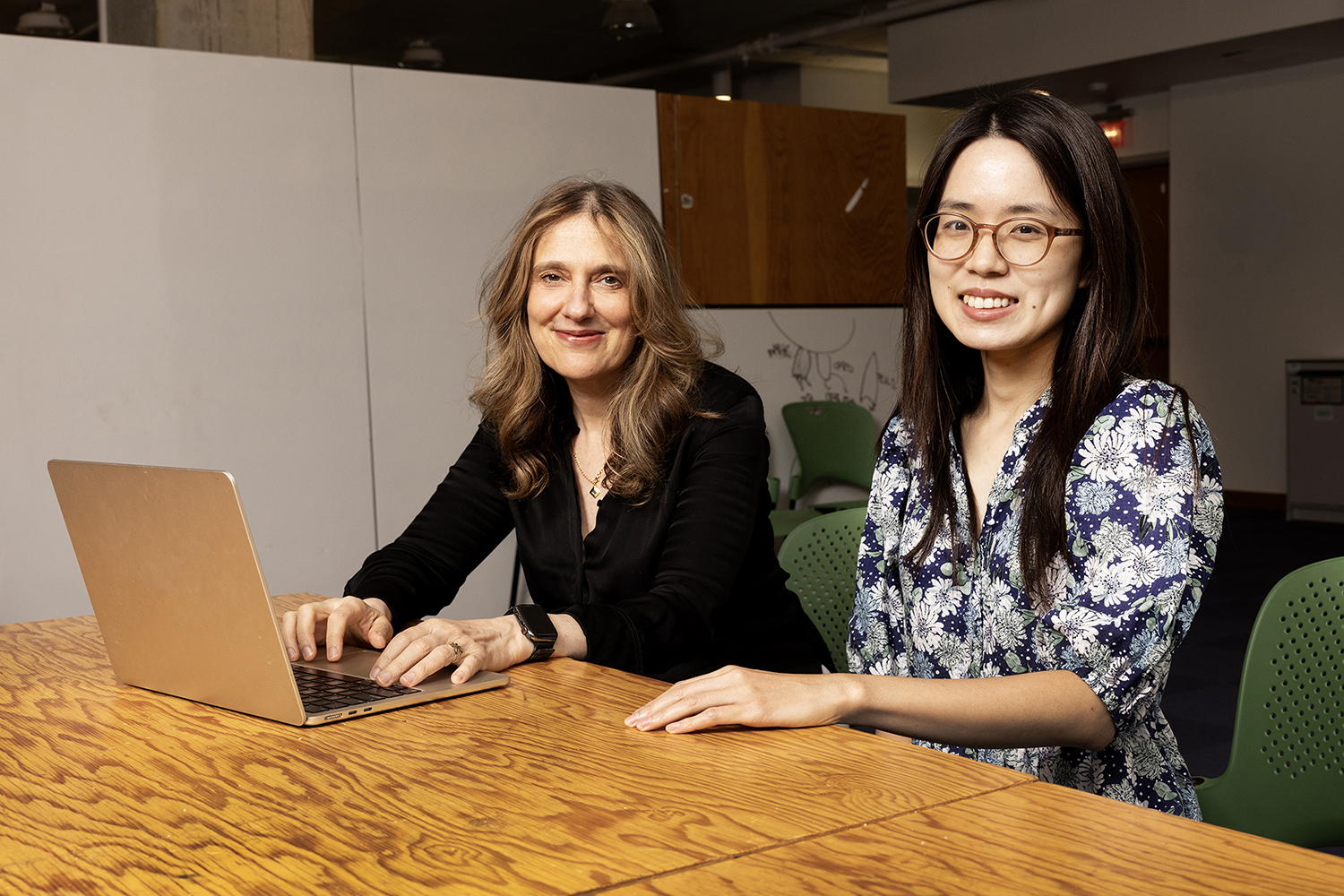

합성 데이터는 비용 절감부터 개인정보 보호까지 혜택을 제공하지만, 한계를 고려하여 신중한 계획과 평가가 필요하다고 Kalyan Veeramachaneni가 말했습니다.

MIT 연구진은 VaxSeer를 사용하여 바이러스 진화와 항원성을 예측하는 기계 학습을 활용해 백신 선정을 더 정확하고 추측에 의존을 줄이는 것을 목표로 함.

새로운 연구 결과, 기후 데이터의 자연 변동성으로 인해 인공지능 모델이 지역 온도와 강수량을 예측하는 데 어려움을 겪을 수 있다.

본 튜토리얼에서는 Google Colab 내에 완전한 Ollama 환경을 구현하여 Self-Hosted LLM Workflow를 복제하는 방법을 제시한다. Colab VM에 공식 Linux 설치 프로그램을 사용하여 Ollama를 설치하고 localhost:11434에 HTTP API를 노출시키는 과정부터 시작하여 Ollama 서버를 배경에서 실행한다. 서비스를 확인한 후, […]

교차로에서 교통을 완화하기 위해 차량 속도를 자동으로 제어하는 새로운 연구 결과, 탄소 배출량을 11 ~ 22% 줄일 수 있다.

MIT 동문이 공동 창업한 Cloudian의 저장 시스템은 기업이 대규모로 데이터를 제공하는 AI 모델과 에이전트를 지원하고 있다.

LangExtract는 구글 AI의 새로운 오픈 소스 파이썬 라이브러리로, 비구조화된 텍스트 문서에서 의미 있는 정보를 추출하는 것을 목표로 한다. 이 라이브러리는 Gemini와 같은 LLMs를 사용하여 이러한 과제를 직접 해결한다.

MLE-STAR은 구글 클라우드 연구원들이 개발한 최첨단 에이전트 시스템으로, 복잡한 기계 학습 ML 파이프라인 설계와 최적화를 자동화합니다. MLE-STAR은 웹 규모 검색, 특정 코드 수정, 견고한 검사 모듈을 활용하여 기계 학습 엔지니어링 작업에서 우수한 성능을 발휘합니다.

MIT 연구진은 대규모 트랜스포머를 안정적으로 훈련하는 것이 어려운 문제를 해결하기 위해 불안정한 활성화 및 손실 증폭을 줄이기 위해 증명 가능한 Lipschitz 경계를 강제하는 방법을 개발했다.

대칭 데이터를 활용한 효율적인 기계 학습을 가능하게 하는 새로운 알고리즘이 개발되었고, 이는 약물 및 소재 발견을 위한 AI 모델을 향상시킬 수 있다.

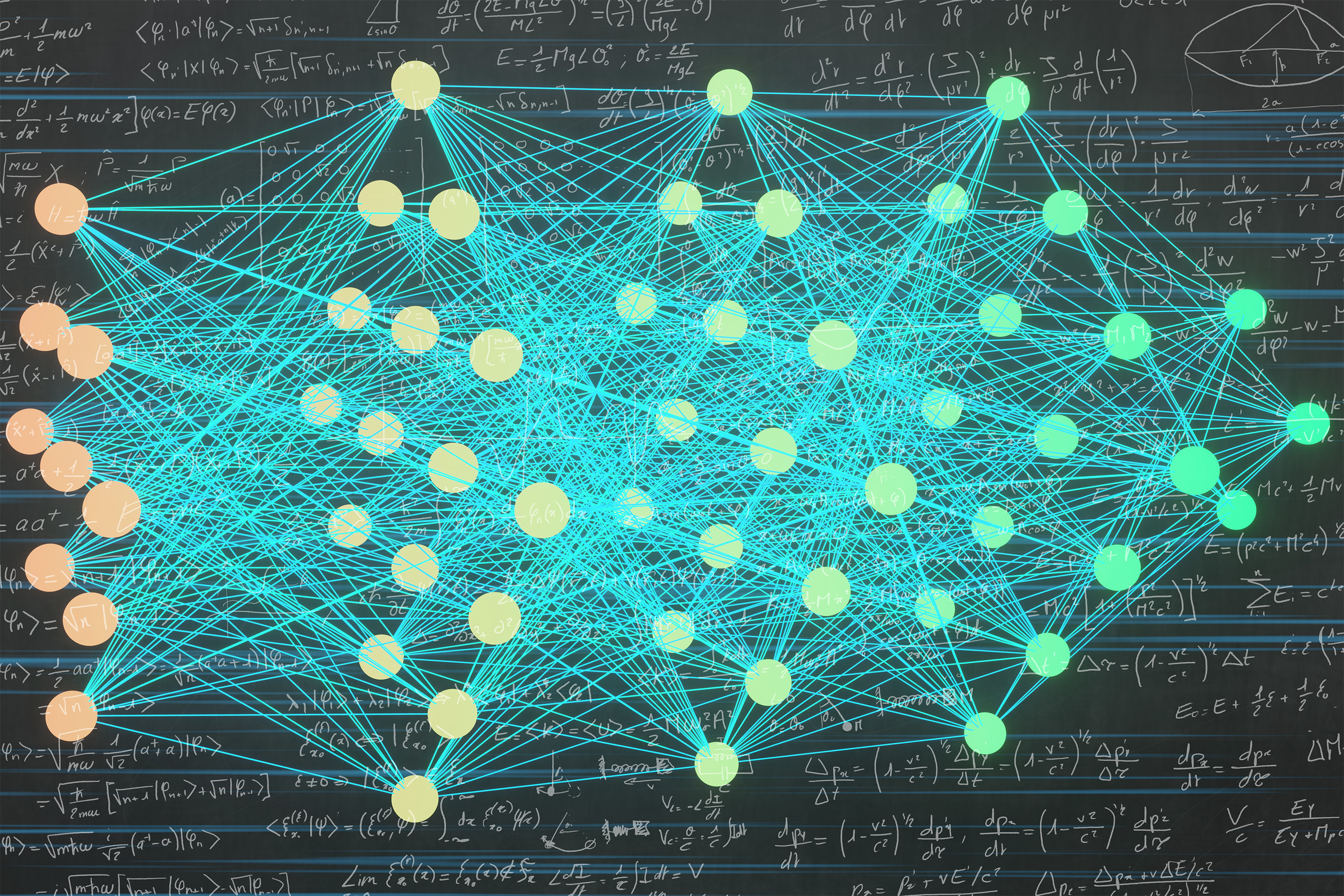

인공지능 연구는 패턴 인식을 넘어서 인간과 유사한 복잡한 추론이 가능한 시스템으로 진화하고 있다. Energy-Based Transformers (EBTs)는 도메인 특정 감독이나 제한적인 교육 신호에 의존하지 않고 기계에 “System 2 Thinking”을 가능하게 하는 신경 구조로, 기계 학습의 다음 단계로 손꼽힌다.

MIT CSAIL 연구원들이 개발한 Neural Jacobian Fields는 다른 센서 없이 단일 카메라에서 로봇을 제어할 수 있도록 학습할 수 있습니다.

MIT 연구진은 특별한 유형의 신경망, 인코더 또는 “토크나이저”가 이전에 인식된 것보다 훨씬 더 많은 작업을 수행할 수 있다고 발견했다.

언어 모델은 순차적 추적이 아닌 똑똑한 산술을 사용하여 변화하는 상황을 따라갑니다. 이러한 접근 방법을 제어함으로써 엔지니어들은 시스템의 성능을 향상시킬 수 있습니다.

Allen Institute for AI가 AutoDS(자율적 발견을 통한 서프라이즈)를 소개했는데, 이는 인간이 정의한 목표나 질의에 의존하지 않고 베이지안 서프라이즈를 측정하고 찾아내는 가치 있는 가정을 자동으로 생성, 테스트 및 반복함.

스위스의 지하 실험 결과와 일치하는 시뮬레이션 결과로, 모델링이 핵폐기물 처리 사이트의 안전을 검증하는 데 사용될 수 있다는 것을 시사.

CodeSteer 시스템은 공급망에서 운송 일정을 예약하는 등 복잡한 문제를 해결할 때 대형 언어 모델의 정확성을 높일 수 있다.

AI가 소프트웨어 개발을 변화시키고 있지만 완전한 자동화에는 여전히 중요한 장애물이 남아있다. 연구팀은 이제 도전 과제를 매핑하고 분야를 전진시키기 위한 연구 계획을 개요로 제시했다.

이 논문은 대규모 언어 모델(LLMs)이 답변에 대해 확신이 없을 때 그것을 나타내야 한다는 불확실성 양자화의 역할을 탐구한다. LLMs의 다양한 출력 공간을 활용하여 불확실성을 설명하는 문자열을 제안한다.

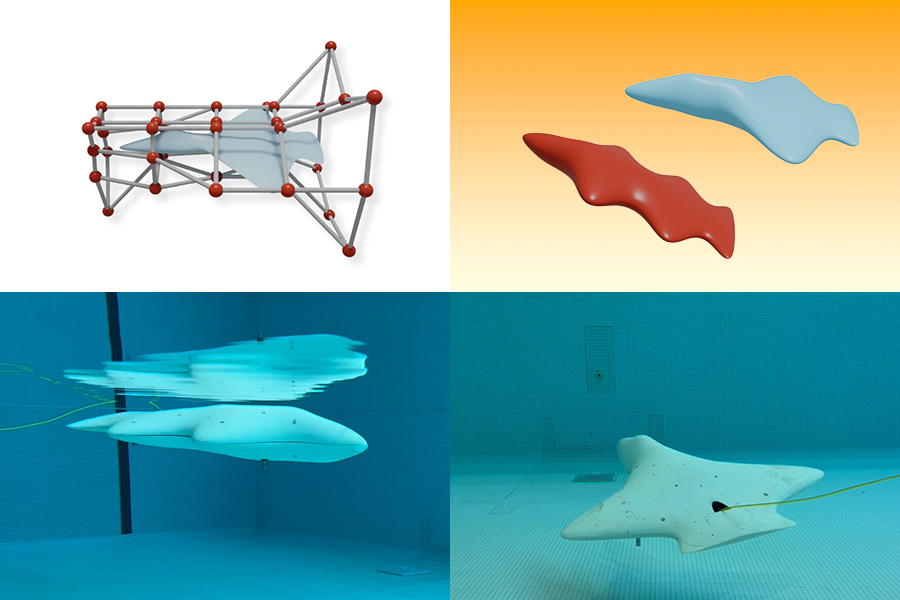

MIT CSAIL 연구원들이 개발한 AI 파이프라인은 수중에서 일렬로 이동하는 바디보드 크기의 차량을 위한 독특한 수력 디자인을 가능하게 하며, 과학자들이 해양 데이터를 수집하는 데 도움을 줄 수 있음.

연구진은 대규모 언어 모델을 전략 계획이나 프로세스 최적화와 같은 어려운 작업에 보다 적응 가능하게 만드는 방법을 개발했다.

대형 언어 모델(Large language models, LLMs)은 다양한 작업에서 탁월한 성능을 보여주며 현재 실제 응용 프로그램에서 증가하고 있습니다. 하지만 특히 고위험 상황에서는 LLM의 출력이 신뢰할 수 없을 때를 알아내는 것이 중요합니다. 이 연구에서는 LLM이 답변에 대한 확신을 신뢰할 수 있는지, 이 신뢰의 개념이 하류 정확도로 어떻게 전환되는지 조사합니다.

새로운 반도체를 분석하기 위해 개발된 시스템은 더 강력한 태양 전지의 개발을 간소화할 수 있습니다.

Meta AI와 Washington 대학의 연구진이 ASTRO(자동 회귀 검색 가르치는 추론기)를 소개했다. Llama-3.1-70B-Instruct에서 추론을 향상시키기 위한 포스트 트레이닝 프레임워크로, 모델에 컨텍스트 내 검색 수행을 가르치는 것이 특징이다.

연구원들이 OctoThinker를 제안하여 강화 학습을 통한 복잡한 추론 작업에 대한 LLM의 발전을 제안했다. CoT 프롬프팅과 대규모 강화 학습을 결합한 LLM은 Deepseek-R1-Zero와 같은 모델이 기본 모델에 직접 RL을 적용함으로써 강한 추론 능력을 보여주었다.

Sam Rodriques 박사과 FutureHouse는 AI 에이전트를 개발하여 과학적 발전을 위한 주요 단계를 자동화했다.

MIT CSAIL 연구진은 GenAI와 물리 시뮬레이션 엔진을 결합하여 로봇 디자인을 개선했습니다. 결과적으로, 인간이 디자인한 로봇을 능가하는 기계를 만들어 냈습니다.

환자 메시지에 있는 오타, 추가 공백, 화려한 언어와 같은 비임상 정보가 AI 모델의 정확도를 낮추는 것을 연구자들이 발견했습니다.

구글의 AI 논문에서는 인종, 성별, 사회경제적 배경과 같은 속성으로 정의된 다양한 부분집단에서 모델의 성능을 평가하는 것이 기계 학습에서의 공정성을 평가하는 중요한 요소임을 소개하고 있습니다. 이 평가는 의료 분야와 같이 부조그룹 간의 모델 성능 차이가 치료 권고나 진단에 불평등을 초래할 수 있는 맥락에서 중요합니다.

연구진이 새로운 연구에서 LLMs의 편향 유형의 원인을 발견하여, 더 정확하고 신뢰할 수 있는 AI 시스템을 위한 길을 열었다.

MIT 윤리 컴퓨팅 연구 심포지엄은 기술, 윤리, 사회적 책임이 교차하는 프로젝트를 선보인다.

광 프로세서 칩은 빛의 속도로 딥 러닝을 수행하여 엣지 장치에 실시간 데이터 분석 기능을 제공할 수 있다.

MIT 연구팀이 디지털로 제작된 필름을 사용해 원본 그림을 물리적으로 복원하는 새로운 방법을 개발했다. 필름은 원하는 경우 제거할 수 있다.

Mistral AI가 최신 시리즈인 Magistral을 소개했다. 이는 추론에 최적화된 대형 언어 모델(Large Language Models)로 LLM 능력 발전의 중요한 한 걸음이다. Magistral 시리즈에는 Apache 2.0 라이선스 하에 공개된 24B-파라미터의 Magistral Small과 기업용 Magistral Medium이 포함되어 있다.