본 튜토리얼에서는 오픈 소스 instruct 모델을 활용하여 계층적 플래너 에이전트를 구축한다. 이 구조화된 다중 에이전트 아키텍처에는 플래너 에이전트, 실행자 에이전트 및 집계자 에이전트가 포함되어 있으며 각 구성 요소가 복잡한 작업을 해결하는 데 특화된 역할을 수행한다. 플래너 에이전트를 사용하여 고수준 목표를 실행 가능한 단계로 분해한다.

최신뉴스 전체보기

Kyutai가 Hibiki-Zero를 발표했다. 이 모델은 동시 음성 대 음성 및 음성 대 텍스트 번역을 위한 새로운 시스템이다. 이 모델은 실시간으로 원본 음성을 대상 언어로 번역하며, 과거 모델과 달리 학습에 단어 수준의 정렬 된 데이터가 필요하지 않다.

Anthropic사는 Claude Opus 4.6을 출시했다. 이 모델은 장기적인 콘텍스트 추론, 에이전트식 코딩 및 고가치 지식 작업에 중점을 둔 최신 모델이다. 이 모델은 클로드 API 및 주요 클라우드 제공업체에서 이용 가능하다.

Transformers는 주의와 전문가 혼합을 사용하여 연산을 확장하지만, 지식 조회를 수행할 수 있는 기본 방법이 부족하다. DeepSeek의 새로운 Engram 모듈은 MoE와 함께 작동하는 조건부 메모리 축을 추가하여 이 간극을 정확히 겨냥한다.

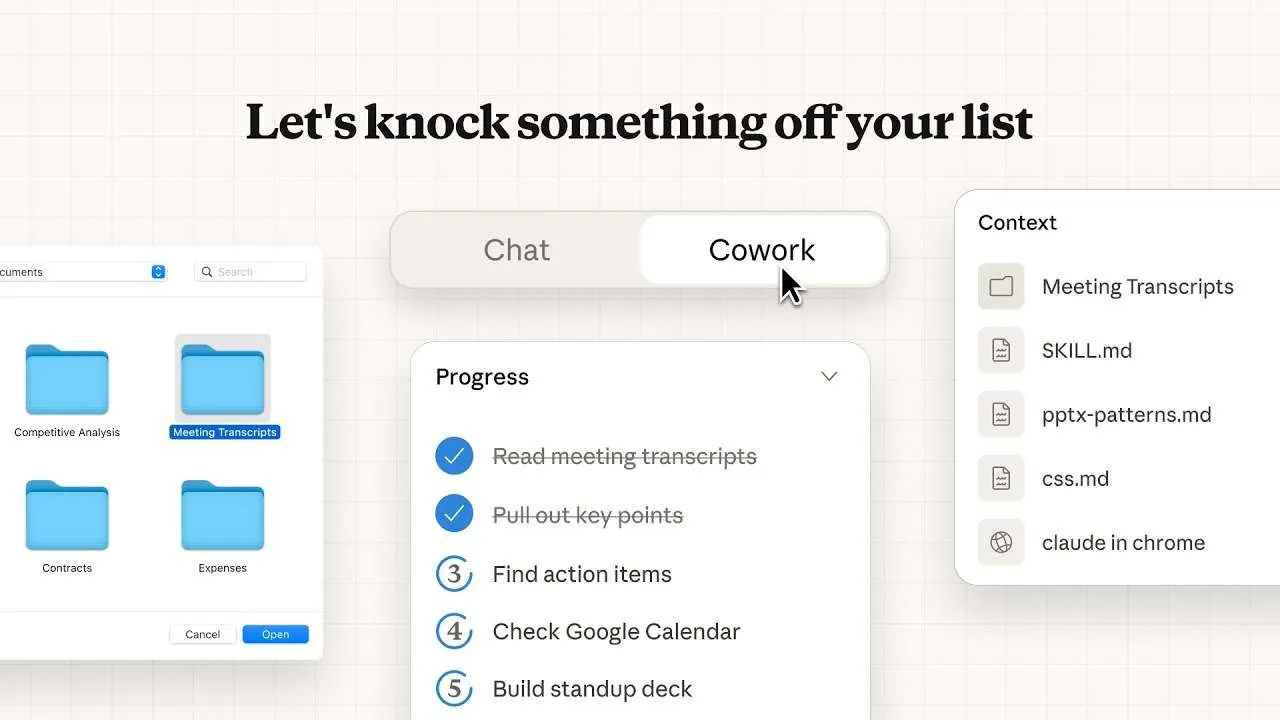

Anthropic사가 클로드 macOS 데스크톱 앱 내에서 연구 미리보기로 이용 가능한 Cowork를 출시했다. Cowork는 코딩이 필요 없는 작업을 위해 로컬 파일에서 에이전트 워크플로를 실행하는 기능이다. Cowork는 클로드 데스크톱 앱의 전용 모드로 작동하며 파일 시스템 수준에서 실행된다.

SETA는 터미널 에이전트를 위한 강화 학습 툴킷 및 환경 스택으로, 400가지 태스크와 CAMEL 툴킷을 제공한다. CAMEL AI 및 Eigent AI 연구팀이 개발한 이 프로젝트는 구조화된 툴킷, 합성 RL 환경 및 평가에 초점을 맞추고 있다.

CAMEL 프레임워크를 사용하여 고급 다중 에이전트 연구 워크플로우를 구축하는 튜토리얼. Planner, Researcher, Writer, Critic, Finalizer와 같은 에이전트들이 협력하여 고수준 주제를 다듬어 근거 있는 연구 요약으로 변환하는 과정을 다룸. OpenAI API를 안전하게 통합하고 에이전트 상호작용을 프로그래밍적으로 조정하며 가벼운 지속적 기억을 추가함.

이 튜토리얼에서는 프롬프트를 정적 텍스트가 아닌 조정 가능한 매개변수로 취급하여 전통적인 프롬프트 제작에서 더 체계적이고 프로그래밍 가능한 방식으로 전환합니다. Gemini 2.0 Flash 주변의 최적화 루프를 구축하여 가장 강력한 프롬프트 구성을 자동으로 선택하는 효과적인 방법을 제시합니다.

Unsloth와 NVIDIA는 RTX 데스크탑부터 DGX Spark까지 NVIDIA RTX AI PC를 사용하여 인기 있는 AI 모델을 빠르게 Fine-tuning하여 코딩, 창의적 작업 및 복잡한 업무에 맞는 맞춤형 어시스턴트를 구축할 수 있습니다.

TinyLlama를 활용해 효율적인 매니저-에이전트 아키텍처를 통해 특화된 AI 에이전트 팀을 로컬에서 오케스트레이션하는 방법을 탐구합니다. 외부 API에 의존하지 않고 구조화된 작업 분해, 에이전트 간 협업, 자율 추론 루프를 구축하는 과정을 transformers 라이브러리를 통해 진행합니다.

OceanBase가 AI를 위해 고안된 오픈소스 데이터베이스인 seekdb를 출시했다. seekdb는 다양한 데이터 모델과 AI 에이전트를 위한 하이브리드 검색 기능을 제공하며, Apache 2.0 라이센스로 제공된다.

Anthropic의 ‘code execution with MCP’ 패턴은 MCP 도구를 코드 수준 시스템으로 전환하여 대규모 워크플로우의 토큰 소모, 지연 및 비용 한계를 개선한다.

구글 연구원들이 DS STAR(Data Science Agent via Iterative Planning and Verification)를 소개했다. 이는 엔드 투 엔드 데이터 과학 질문을 실행 가능한 Python 코드로 변환하는 멀티 에이전트 프레임워크이다.

Anyscale과 NovaSky 팀이 SkyRL tx v0.1.0을 출시했다. 이 엔진은 AI 팀이 자체 인프라에서 대형 언어 모델에 대한 Tinker 스타일 강화 학습을 단일 통합 엔진을 사용하여 실행할 수 있게 해준다.

Liquid AI사가 LFM2-ColBERT-350M을 출시했다. 이 모델은 다국어 및 교차언어 검색을 위한 소형 late interaction retriever로, 한 언어로 문서를 색인하고 다른 언어로 쿼리를 작성해도 높은 정확도로 검색 결과를 반환한다.

Anthropic, Thinking Machines Lab, Constellation의 연구팀은 모델 사양을 스트레스 테스트하여 최신 모델이 동일한 사양 하에 서로 다른 행동 프로필을 나타내는지 확인하는 방법을 제시했다.

DeepAgents 라이브러리는 계획을 세우고 시간에 걸쳐 작업을 관리할 수 있는 능력이 없는 기본 대형 언어 모델(Large Language Model, LLM) 에이전트를 극복하기 위해 설계되었습니다. 이 라이브러리는 “깊이” 있게 실행될 수 있도록 설계되어 있습니다.

MCP, 함수 호출, OpenAPI 도구의 비교표를 통해 각각의 특징과 사용 시기를 알아볼 수 있습니다.

OpenAI가 AgentKit을 출시했다. 시각적인 에이전트 빌더, 임베드 가능한 ChatKit UI 및 확장된 Evals를 포장하여 제품 에이전트를 출하하기 위한 단일 워크플로우를 제공한다. 에이전트 빌더(beta)와 기타 기능이 포함되어 있다.

Microsoft가 Azure Logic Apps(Standard)를 Model Context Protocol (MCP) 서버로 실행할 수 있는 공개 미리보기를 출시했다. 이를 통해 Logic Apps 워크플로우를 에이전트 도구로 노출시켜 MCP 호환 클라이언트(VS Code + Copilot 등)에서 발견하고 호출할 수 있다.

IBM은 고성능 검색 및 RAG 시스템용으로 설계된 두 개의 새로운 임베딩 모델, granite-embedding-english-r2와 granite-embedding-small-english-r2를 소개했다. 이 모델들은 효율적이고 소형이며 Apache 2.0 라이선스로 제공된다.

오픈AI가 ChatGPT의 개발자 모드에 MCP 도구의 전체 지원을 추가하여 쓰기 동작을 수행할 수 있게 했다. 이를 통해 개발자들은 시스템을 직접 업데이트하고 워크플로를 트리거하며 기업 통합을 할 수 있다.

메모리는 인간 지능을 생각할 때 먼저 떠오르는 중요한 부분이다. 경험으로부터 배우고 새로운 상황에 적응하며 시간이 흐름에 따라 더 나은 결정을 내릴 수 있게 해준다. 이와 유사하게 AI 에이전트도 메모리를 통해 더 똑똑해진다. GibsonAI가 AI 에이전트를 위한 오픈 소스 SQL 네이티브 메모리 엔진 Memori를 출시했다.

이 튜토리얼에서는 Biopython과 인기있는 Python 라이브러리를 사용하여 Google Colab에서 원활하게 실행되도록 설계된 고급이면서 접근성 있는 생물정보학 AI 에이전트를 구축하는 방법을 보여줍니다. 이 튜토리얼은 서열 검색, 분자 분석, 시각화, 다중 서열 정렬, 계통수 구축 및 모티프 검색을 하나의 간소화된 클래스로 결합하여 실습적인 방법을 제공합니다.

토큰화와 청킹은 텍스트를 작은 조각으로 나누는 데 관련이 있지만, 서로 다른 목적과 규모에서 작동한다. AI 애플리케이션을 구축하는 경우 이러한 차이를 이해하는 것이 중요하다.

의료 AI의 최근 발전은 모델의 정교함뿐만 아니라 기반 데이터의 품질과 풍부함에 달려있다. Centaur.ai, Microsoft Research 및 University of Alicante의 협력으로 성과를 거둔 PadChest-GR은 최초의 다중 모달, 이중 언어, 문장 수준 데이터셋이다.

MLE-Agent와 Ollama를 결합하여 로컬에서 API 없이 머신러닝 워크플로우를 만드는 방법에 대한 튜토리얼. 구글 코랩에서 재현 가능한 환경을 설정하고, 합성 데이터셋을 생성한 후 에이전트를 이용해 훈련 스크립트를 작성하는 방법을 안내한다. 일반적인 실수를 방지하여 견고하게 만든다.

Model Context Protocol (MCP)는 AI 모델을 다양한 애플리케이션, 시스템 및 도구에 연결하는 범용 표준으로 급속히 등장했습니다. MCP로의 이주는 사용자 정의 통합에 익숙한 기관들에게 기술적 부채를 줄이고 새로운 상호 운용성 혜택을 누릴 수 있는 변화를 가져올 수 있습니다.

아마존이 글로벌 충족 및 분류 센터에 백만 대의 로봇을 배치하며 세계 최대의 산업용 이동 로봇 운영자로 자리매김했다. 이 달성과 함께 DeepFleet이 출시되었는데, 이는 방대한 이동 로봇 군 사이의 조정을 향상시키기 위해 설계된 혁신적인 기초 모델 스위트이다.

AgentSociety는 대규모 에이전트 모집단을 시뮬레이션하는 첨단 오픈 소스 프레임워크로, 각각의 에이전트는 대형 언어 모델 (LLM)에 의해 구동되어 인간 사회에서 발견되는 복잡한 상호작용을 현실적으로 모델링합니다. Ray와 같은 강력한 분산 처리 기술을 활용하여 이 프로젝트는 실제로 수만 명의 활성화된 에이전트로 구성된 시뮬레이션을 달성하며, 각각의 에이전트는 자세하고 현실적인 환경에 내재되어 있습니다.

본 튜토리얼에서는 Google의 에이전트 개발 키트(ADK)의 고급 기능을 탐색하며, 특화된 역할과 도구를 갖춘 다중 에이전트 시스템을 구축합니다. 웹 연구, 수학적 계산, 데이터 분석, 콘텐츠 생성과 같은 작업에 맞춘 에이전트 생성 방법을 안내하며 Google 검색, 비동기 실행, 모듈화 아키텍처를 통합합니다.

NVIDIA의 GraspGen은 새로운 확산 기반 그라스핑 프레임워크로, 강력하고 일반적인 6-DOF 그라스핑을 위한 SOTA 성능을 약속하며 산업 피킹부터 서비스 및 인간형 로봇까지 다양한 분야에 중요한 자동화 및 조작 작업을 제공한다.

이 튜토리얼에서는 Ollama와 LangChain을 통합하는 GPU 지원 로컬 LLM 스택을 구축한다. 필요한 라이브러리를 설치하고 Ollama 서버를 실행하며 모델을 끌어와 커스텀 LangChain LLM으로 랩핑하여 온도, 토큰 제한, 컨텍스트를 제어할 수 있다. PDF 또는 텍스트를 소화하는 Retrieval-Augmented Generation 레이어를 추가한다.

본 튜토리얼에서는 CrewAI와 Google의 Gemini 모델을 사용하여 최적화된 다중 AI 에이전트 시스템을 구축하는 방법을 안내합니다. 연구, 데이터 분석, 콘텐츠 생성, 품질 보증을 위한 특화된 에이전트들을 순차적 협업에 최적화된 상태로 설치하고 구성합니다.

아마존이 새롭고 혁신적인 AI 통합 개발 환경 ‘Kiro’를 발표했다. 오늘의 AI 코딩 어시스턴트의 능력을 훨씬 뛰어넘는 Kiro는 명세 주도 개발, 지능적 자동화, 적응형 사용자 인터페이스에 혁신을 제공한다.

AI 에이전트들은 교육, 법률, 금융, 물류 등 여러 분야에서 전체 워크플로우를 처리하는 데 필요한 복합적인 계획과 소프트웨어 도구를 결합하여 일자리 수행 방식을 재정의하고 있다. 스탠포드 연구에 따르면, 새로운 AI 프레임워크는 어디서 AI가 일자리를 자동화하고 어디서는 보조해야 하는지 평가할 수 있다.

AI 에이전트는 순수한 백엔드 자동화에서 현대 애플리케이션 내에서 시각적이고 협력적인 요소로 이동하고 있습니다. 그러나 사용자에게 응답하고 업무를 적극적으로 안내할 수 있는 상호작용이 가능한 에이전트를 만드는 것은 엔지니어링적인 머리아픔이 오래전부터 계속되어왔습니다.

파이썬 A2A는 구글의 에이전트 간(A2A) 프로토콜의 구현으로, AI 에이전트들이 서로 통신할 수 있게 해줍니다. 이 튜토리얼에서는 파이썬-a2a 라이브러리가 제공하는 데코레이터 기반 방법을 사용합니다. 간단한 @agent와 @skill 데코레이터를 사용하여 에이전트의 기능을 정의할 수 있습니다.

도구 보강 에이전트의 등장으로 언어 모델이 외부 API 및 서비스를 활용하여 정확한 작업(산술 계산 또는 실시간 데이터 조회)을 수행할 수 있게 되었으며, 이는 언어 이해의 폭과 기능을 효과적으로 결합하고 있다.

이 튜토리얼에서는 LangGraph와 Gemini 1.5 Flash를 사용하여 다단계 지능형 쿼리 처리 에이전트를 구축하는 방법을 보여줍니다. 각 노드는 라우팅, 분석, 연구, 응답 생성 및 유효성 검사로 구성된 목적 노드 시리즈를 통해 들어오는 쿼리를 처리합니다.

LangChain, Gemini 2.0 Flash 및 Jina Search 도구를 통합하여 지능형 AI 어시스턴트를 구축하는 방법을 보여주는 튜토리얼. 강력한 대형 언어 모델과 외부 검색 API의 기능을 결합하여 최신 정보 및 인용을 제공하는 어시스턴트를 생성함.

Yandex가 세계 최대 규모의 이벤트 데이터셋 ‘Yambda’를 공개했다. 이 데이터셋은 약 50억 건의 익명 사용자 상호 작용 이벤트를 제공하여 학술 연구와 산업 규모 응용 사이의 간극을 줄이는 데 기여한다.

Microsoft의 AutoGen 프레임워크를 사용하여 개발자들이 최소한의 코드로 복잡한 다중 에이전트 워크플로우를 조율하는 방법을 보여줌. AutoGen의 RoundRobinGroupChat 및 TeamTool 추상화를 활용하여 연구원, 사실 확인자, 비평가, 요약가, 편집자 등 전문 보조자들을 “DeepDive” 도구로 완벽하게 조합할 수 있음.

Marktechpost AI 미디어가 2025년 Agentic AI 및 AI 에이전트 보고서를 발표했습니다. 이 보고서는 AI 에이전트의 아키텍처, 프레임워크 및 배포 전략을 탐구하며, 미래를 형성하는 기술적으로 엄밀한 내용을 제공합니다. 보고서는 추론이 가능한 모델, 메모리 프레임워크 및 조정을 기반으로 한 증가하는 생태계를 탐색합니다.

Unsloth AI는 4비트 양자화와 LoRA 기술을 활용하여 최신 모델인 Qwen3-14B를 손쉽고 빠르게 세밀하게 조정할 수 있게 해준다. 본 튜토리얼에서는 이를 실제로 구현하는 방법을 안내한다.

이 튜토리얼에서는 Tavily Search API, Chroma, Google Gemini LLMs, 및 LangChain 프레임워크의 강점을 결합하여 강력하고 지능적인 질의응답 시스템을 구축하는 방법을 소개합니다. Tavily를 통한 실시간 웹 검색, Chroma 벡터 저장소를 활용한 의미론적 문서 캐싱, 그리고 Gemini 모델을 통한 문맥적 응답 생성이 포함됩니다.

AI 에이전트가 실험적 시스템에서 상용 규모 응용프로그램으로 전환되면서 그들의 증가하는 자율성은 새로운 보안 도전 과제를 도입하고 있습니다. Palo Alto Networks의 Unit 42가 발표한 “AI 에이전트가 여기에 있습니다 – 위협도 함께”라는 포괄적인 보고서에서, 오늘날의 에이전틱 아키텍처는 혁신에도 불구하고 다양한 공격에 취약하며, 대부분 이는 […]

이 튜토리얼에서는 Fireworks AI의 기능을 활용하여 LangChain과 함께 지능적인 도구 기능을 갖춘 에이전트를 구축하는 방법을 살펴볼 것이다. langchain-fireworks 패키지 설치부터 Fireworks API 키 구성, 높은 성능의 llama-v3-70b-instruct 모델을 사용한 ChatFireworks LLM 인스턴스 설정, LangChain의 에이전트 프레임워크와 통합까지 진행할 것이다.

Salesforce AI 연구가 더 지능적이고 신뢰할 수 있으며 다재다능한 AI 에이전트를 구축하기 위한 포괄적인 로드맵을 제시했습니다. 이 최근 이니셔티브는 현재 AI 시스템의 기초적인 한계를 해결하기 위해 초점을 맞추고 있으며, 특히 불일치한 작업 성능, 강건성의 부족, 그리고 복잡한 기업 워크플로에 적응하는 데 어려움이 있는 부분에 초점을 맞추고 있습니다.

Dappier AI의 실시간 검색 및 추천 도구를 활용하여 대화형 애플리케이션을 향상시키는 방법을 배우는 튜토리얼. RealTimeSearchTool과 AIRecommendationTool을 결합하여 웹에서 최신 정보를 조회하고 사용자 정의 데이터 모델에서 개인화된 기사 제안을 제공할 수 있음.

PydanticAI 라이브러리를 활용해 티켓 보조 프로그램을 만드는 튜토리얼. Pydantic v2 모델로 데이터 규칙 정의, SQLite 데이터베이스에 티켓 저장, Python의 uuid 모듈로 고유 식별자 생성. 티켓 생성 및 상태 확인을 위한 두 개의 에이전트 사용.

Atla의 강력한 LLM 판사 모델을 Model Context Protocol (MCP)을 통해 노출시키는 Atla MCP 서버가 AI 시스템 개발의 중요한 측면인 LLM 출력의 신뢰성 있는 평가를 지원한다.

대규모 언어 모델(Large Language Models, LLMs)과 외부 도구, 응용프로그램, 데이터 원본의 통합은 점점 더 중요해지고 있다. Model Context Protocol (MCP)와 Function Calling은 모델과 외부 시스템 간의 원활한 상호작용을 달성하기 위한 두 가지 중요한 방법이다. 두 접근 방식은 AI 모델의 실용적 능력을 확장하기 위해 목표를 두지만, 아키텍처 측면에서 근본적으로 다르다.

OpenAI가 엔지니어링 및 제품 팀을 위해 자율 AI 시스템 구현을 탐색하는 실무 안내서를 게시했다. 실제 배치 사례를 바탕으로 한 이 가이드는 적합한 사용 사례 식별, 에이전트 아키텍처 구성, 안전성과 신뢰성을 보장하기 위한 견고한 보호장치 내장에 대한 체계적 접근 방식을 제공한다.