구글이 안드로이드 개발 작업에서 Large Language Models (LLMs)의 성능을 측정하기 위한 새로운 리더보드 및 평가 프레임워크인 안드로이드 벤치를 공개했다. 데이터셋, 방법론, 테스트 하네스는 GitHub에서 공개되었으며, 일반 코딩 벤치마크가 캡처하지 못하는 안드로이드 개발 작업에 적합하다.

최신뉴스 전체보기

YuanLab AI가 오픈소스 Mixture-of-Experts (MoE) 대형 언어 모델인 Yuan 3.0 Ultra를 공개했다. 이 모델은 1조 개의 총 파라미터와 68.8조 개의 활성화된 파라미터를 특징으로 하며, 기업 성능을 최적화하고 사전 훈련 효율성을 높이는 것을 목표로 한다.

본 튜토리얼에서는 오픈 소스 instruct 모델을 활용하여 계층적 플래너 에이전트를 구축한다. 이 구조화된 다중 에이전트 아키텍처에는 플래너 에이전트, 실행자 에이전트 및 집계자 에이전트가 포함되어 있으며 각 구성 요소가 복잡한 작업을 해결하는 데 특화된 역할을 수행한다. 플래너 에이전트를 사용하여 고수준 목표를 실행 가능한 단계로 분해한다.

Perplexity사가 대규모 검색 작업에 최적화된 다국어 임베딩 모델 pplx-embed을 출시했다. 웹 규모 데이터의 복잡성과 잡음을 처리하기 위한 이 모델은 전용 임베딩 API에 대한 대안으로 제작되었다. 양방향 어텐션과 확산을 활용한 구조적 혁신이 돋보인다.

Nous Research 팀이 Hermes Agent를 공개하여 AI의 망각 문제를 해결하기 위해 디자인된 오픈소스 자율 시스템을 출시했습니다. 현재의 AI 환경에서 우리는 ‘일시적 에이전트’에 익숙해졌는데, 이는 매 채팅 세션마다 인지 클락을 재시작하는 잊어버리기 쉬운 조수입니다. LLMs는 뛌륭한 코더가 되었지만, 진정한 팀원으로 기능하는 데 필요한 지속적인 상태가 부족합니다.

Liquid AI 팀이 발표한 LFM2-24B-A2B는 24억 개의 파라미터를 가진 모델로, 전력 소비 및 메모리 병목 현상의 한계에 부딪히는 산업에서, 파라미터 수보다 아키텍처 효율성에 대한 대화로 전환되고 있다.

알리바바의 Qwen 3.5 중간 모델 시리즈 출시는 대규모 언어 모델의 발전이 초기에는 성능 향상을 이끌었지만, 이로 인해 상당한 인프라 부담과 한계적인 이득이 도입되었음을 신호한다. 작은 AI 모델이 더 똑똑하다는 점을 강조하며 Qwen 접근 방식의 변화를 시사한다.

오픈소스 프로젝트인 OpenPlanter는 개인들에게 데이터 추적 권한을 돌려주는 노력으로, 개발자 ‘Shin Megami Boson’이 만들었으며 재귀 언어 모델 조사 에이전트입니다. 사용자들의 마이크로 감시 요구를 지원하는 것이 목표입니다.

NVIDIA가 DreamDojo를 발표했다. 이는 44,711시간의 실제 인간 비디오 데이터로 훈련된 오픈소스 로봇 월드 모델로, 기존의 물리 엔진 대신 픽셀에서 직접 로봇 행동의 결과를 ‘꿈꾼다’.

Kyutai가 Hibiki-Zero를 발표했다. 이 모델은 동시 음성 대 음성 및 음성 대 텍스트 번역을 위한 새로운 시스템이다. 이 모델은 실시간으로 원본 음성을 대상 언어로 번역하며, 과거 모델과 달리 학습에 단어 수준의 정렬 된 데이터가 필요하지 않다.

알리바바의 Tongyi Lab 연구팀이 ‘Zvec’을 발표했다. 이는 엣지 및 장치 내 검색 워크로드를 대상으로 하는 오픈소스 인프로세스 벡터 데이터베이스로, SQLite와 유사한 라이브러리로 작동하여 외부 서비스나 데몬이 필요하지 않다. 검색 증강 생성(RAG)을 위해 설계되었다.

NVIDIA의 C-RADIOv4는 SigLIP2, DINOv3, SAM3을 하나의 비전 백본으로 통합하여 밀집 또는 세분화 성능을 희생하지 않고 결합하는 방법에 대해 소개합니다. 이 모델은 세 강력한 선생님 모델을 학생 인코더로 결합하여 AM-RADIO 및 RADIOv2.5 라인을 확장하며 계산 비용을 유지하면서 성능을 향상시킵니다.

NVIDIA가 VibeTensor를 공개했는데, 이는 딥러닝을 위한 오픈소스 연구 시스템 소프트웨어 스택이다. VibeTensor는 LLM 기반 코딩 에이전트에 의해 고수준의 인간 안내 아래 생성되었다. 이 시스템은 코딩 에이전트가 Python과 JavaScript API에서 C++ 런타임 구성 요소 및 CUDA 메모리 관리까지 포괄하는 일관된 딥러닝 런타임을 생성할 수 있는지에 대한 구체적인 질문을 제기한다.

Qwen 팀이 코딩 에이전트와 로컬 개발을 위해 디자인된 오픈 웨이트 언어 모델인 Qwen3-Coder-Next를 출시했다. 모델은 80B의 총 파라미터를 가지고 있지만 각 토큰 당 활성화되는 파라미터는 3B뿐이다.

Robbyant은 LingBot-World를 공개했는데, 이는 영상 생성을 상호작용 시뮬레이터로 변환하는 대규모 세계 모델로, 총체 AI, 자율 주행, 게임 등을 위한 환경을 렌더링하며 시각적으로 뛰어나고 반응성이 뛰어난 특징을 갖추고 있다.

AI2가 SERA(Soft Verified Efficient Repository Agents)를 소개했다. SERA는 감독 학습과 합성 경로만 사용하여 훨씬 큰 폐쇄 시스템과 맞추기 위해 개발된 코딩 에이전트 패밀리다. SERA는 AI2의 오픈 코딩 에이전트 시리즈의 첫 번째 릴리스이며, 주요 모델인 SERA-32B는…

DeepSeek AI가 DeepSeek-OCR 2를 공개했습니다. 이는 레이아웃을 고려한 문서 이해 시스템으로, 인간이 복잡한 문서를 스캔하는 방식과 유사하게 페이지를 읽을 수 있도록 구조화합니다. 핵심 구성 요소는 DeepEncoder V2로, 2D 페이지를 1D 시퀀스로 변환하는 언어 모델 스타일의 트랜스포머입니다.

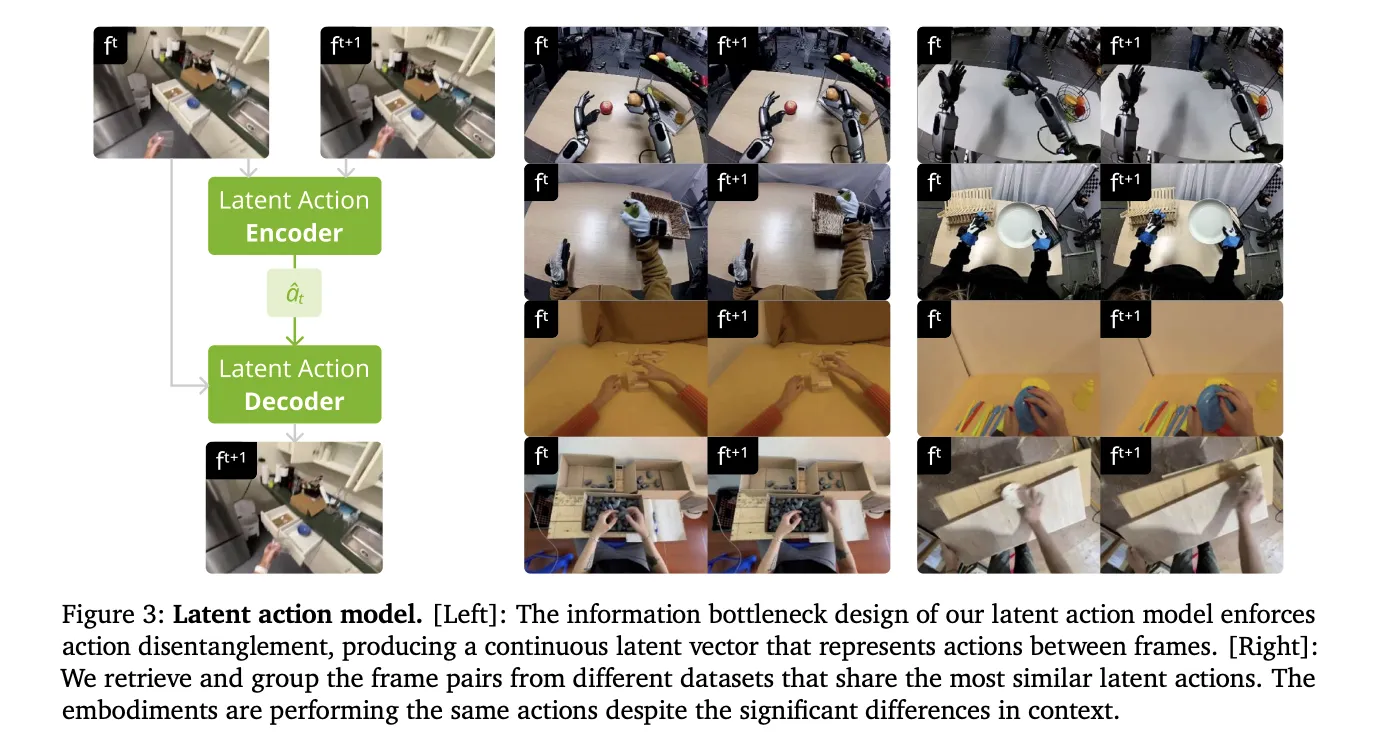

안트 그룹의 LingBot-VLA는 현실 세계에서 실제 로봇 조작을 대상으로 하는 비전 언어 액션 기반 모델이다. 9개의 듀얼 암 로봇을 제어할 수 있는 단일 비전 언어 액션 모델을 구축하는 방법에 대한 연구 결과이며, 약 20,000 시간의 텔레오퍼레이션 양쪽 손 데이터로 학습되었다.

MBZUAI 연구진이 K2 Think V2를 발표했다. 이는 완전한 주권을 갖춘 추론 모델로, 투명한 훈련 파이프라인을 통해 최신 시스템과 경쟁하는 것을 목표로 한다.

DSGym은 스탠퍼드 대학, Together AI, 더크 대학, 하버드 대학의 연구진들이 소개한 프레임워크로, 1,000개 이상의 데이터 과학 과제를 전문가가 선별한 정답과 함께 평가하고 훈련합니다.

Clawdbot은 오픈 소스 개인용 AI 어시스턴트로, 대규모 언어 모델을 Anthropic 및 OpenAI와 연결하여 메시징 앱, 파일, 쉘, 브라우저, 스마트 홈 기기와 연동하면서 조정 계층을 사용자가 제어합니다.

Chroma 1.0은 스피커 식별을 유지하면서 오디오를 입력으로 받아들이고 출력으로 반환하는 실시간 음성-음성 대화 모델이다. 낮은 대기 시간 상호작용과 높은 품질의 개인화된 음성 클로닝을 결합한 최초의 오픈 소스 음성 대화 시스템으로 소개된다.

Microsoft Research가 OptiMind를 출시했다. 이는 자연어로 된 복잡한 의사결정 문제를 최적화 솔버가 실행할 수 있는 수학적 공식으로 변환하는 AI 기반 시스템이다. 이는 전문가 모델러와 수일간의 작업이 필요했던 오퍼레이션 리서치의 병목 현상을 해결한다.

Vercel이 AI 코딩 에이전트를 위한 패키지 매니저 ‘Agent Skills’를 출시했다. React와 Next.js 성능, 웹 디자인 검토, Vercel에서 배포 가능한 기능을 중점으로 하며, npm과 유사한 명령어로 스킬을 설치할 수 있다.

NVIDIA의 연구진이 PersonaPlex-7B-v1을 발표했는데, 이는 자연스러운 음성 상호작용을 위한 풀 더플렉스 대화 모델로, 정확한 페르소나 제어를 목표로 한다. ASR→LLM→TTS에서 단일 풀 더플렉스 모델로 진화했다. 기존 음성 어시스턴트는 ASR이 음성을 텍스트로 변환하고, 언어 모델이 텍스트 답변을 생성한 후, 텍스트를 음성으로 변환한다.

구글 AI 연구팀이 MedGemma-1.5를 발표했다. 이 모델은 의료 영상, 텍스트 및 음성 시스템을 구축하고 지역 워크플로와 규정에 적응하려는 개발자들을 위한 오픈 출발점으로 제공된다.

SETA는 터미널 에이전트를 위한 강화 학습 툴킷 및 환경 스택으로, 400가지 태스크와 CAMEL 툴킷을 제공한다. CAMEL AI 및 Eigent AI 연구팀이 개발한 이 프로젝트는 구조화된 툴킷, 합성 RL 환경 및 평가에 초점을 맞추고 있다.

TII 아부다비가 Falcon-H1R-7B를 발표했습니다. 이 모델은 7B 파라미터로 수학, 코딩 및 일반 벤치마크에서 많은 14B에서 47B 모델을 능가하면서도 효율적이고 효율적입니다.

NVIDIA가 저지연 음성 에이전트와 라이브 자막을 위해 특별히 제작된 새로운 영어 전사 모델(Nemotron Speech ASR)을 공개했다. 이 모델은 FastConformer 인코더와 RNNT 디코더를 결합한 캐시 인식 아키텍처로 최적화되어 현대 NVIDIA GPU에서 스트리밍 및 배치 작업에 튜닝되었다.

Liquid AI가 LFM2.5를 소개했는데, LFM2 아키텍처를 기반으로 한 작은 foundation 모델 세대로, 장치 및 엣지 배포에 초점을 맞추고 있다. LFM2.5-1.2B-Base와 LFM2.5-1.2B-Instruct를 포함하며 일본어, 시각 언어, 음성 언어 변형도 제공한다. Hugging Face에서 오픈 웨이트로 출시되었다.

Marktechpost가 AI2025Dev를 출시했습니다. 이는 2025년 분석 플랫폼으로, AI 활동을 쿼리 가능한 데이터셋으로 변환하여 모델 출시, 공개 정도, 교육 규모, 벤치마크 성능, 생태계 참여자를 아우릅니다.

NVIDIA AI 연구팀은 NitroGen을 발표했는데, 이는 일반 게임 에이전트를 위한 오픈 비전 액션 기반 모델로, 인터넷 비디오를 통해 픽셀과 게임패드 액션을 직접 학습하여 상용 게임을 플레이하는 방법을 익힙니다. NitroGen은 1,000개 이상의 게임에서 40,000시간의 게임 플레이로 훈련되었으며, 오픈 데이터셋과 유니버설 시뮬레이터를 제공합니다.

NVIDIA가 Nemotron 3 패밀리를 발표했는데, 이는 agentic AI를 위한 완전한 스택으로, 모델 가중치, 데이터셋 및 강화 학습 도구를 포함한다. 이 패밀리는 Nano, Super, Ultra 세 가지 크기로 나뉘어 있으며, 긴 문맥 추론과 추론 비용에 엄격한 제어가 필요한 다중 에이전트 시스템을 대상으로 한다.

CopilotKit은 AI 동료 및 앱 내 에이전트를 직접 구축하기 위한 오픈 소스 프레임워크입니다. 팀들은 에이전트 그래프를 강력한 사용자 인터페이스로 변환하기 위해 여전히 사용자 정의 코드를 작성해야 했는데, CopilotKit은 이를 해결합니다.

Apple과 에든버러 대학의 연구팀이 CLaRa를 발표했다. CLaRa는 연속 잠재 추론을 사용하여 시멘틱 문서를 압축하는 기능을 제공한다.

DeepSeek AI가 공개 가중치 대규모 언어 모델인 DeepSeekMath-V2를 발표했다. 이 모델은 자연어 정리를 최적화하고 자가 검증을 통해 자신의 추론이 올바른지 확인하면서 복잡한 올림피아드 수학 문제를 해결할 수 있다.

OceanBase가 AI를 위해 고안된 오픈소스 데이터베이스인 seekdb를 출시했다. seekdb는 다양한 데이터 모델과 AI 에이전트를 위한 하이브리드 검색 기능을 제공하며, Apache 2.0 라이센스로 제공된다.

텐센트 훈유안이 OCR 및 문서 이해를 위해 특화된 1B 파라미터 비전 언어 모델인 HunyuanOCR을 공개했다. 이 모델은 멀티모달 아키텍처를 기반으로 하며, 스포팅, 파싱, 정보 추출, 시각적 질문 응답 및 텍스트 이미지 번역을 단일 엔드 투 엔드 파이프라인을 통해 실행한다.

Amazon Lookout for Vision에서 Amazon SageMaker AI로 컴퓨터 비전 작업을 이전하고, AWS Marketplace에서 제공되는 사전 훈련된 모델을 사용하여 사용자 정의 하자 검출 모델을 훈련하는 방법을 소개합니다. SageMaker Ground Truth로 데이터셋 라벨링, 유연한 하이퍼파라미터 구성으로 모델 훈련, 실시간 또는 일괄 추론을 위한 배포까지 단계별 안내를 제공하여 자동 품질 검사에 대한 제어와 유연성을 높입니다.

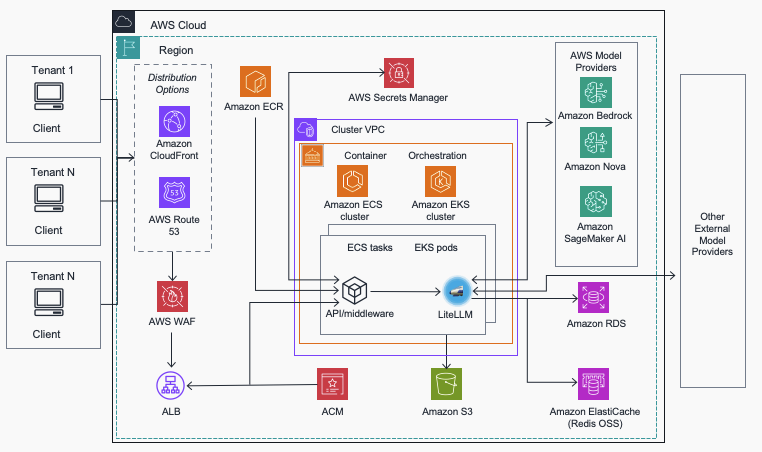

이 게시물에서는 다중 제공업체 생성 AI 게이트웨이 참조 아키텍처를 소개하며, 이를 통해 LiteLLM을 AWS 환경에 배포하여 여러 모델 제공업체 간의 제너레이티브 AI 워크로드의 관리와 거버넌스를 최적화하는 방법에 대한 지침을 제공합니다. 이 중앙 집중식 게이트웨이 솔루션은 Amazon Bedrock, Amazon SageMaker AI 및 외부 제공업체를 지원하면서 포괄적인 보안, 모니터링 및 제어 기능을 유지하며 제공자 단편화, 분산형 거버넌스, 운영 복잡성 및 비용 관리와 같은 일반적인 기업 과제에 대응합니다.

Allen Institute for AI (AI2)가 오픈 소스로 출시한 Olmo 3는 전체 ‘모델 플로우’를 노출하는데, 원시 데이터 및 코드부터 중간 체크포인트 및 배포 준비 모델까지 포함하고 있습니다. Olmo 3은 7B 및 32B 파라미터 모델을 갖춘 밀도 변환기 스위트입니다.

Meta AI 팀이 Meta Segment Anything Model 3 또는 SAM 3을 공개했다. SAM 3은 간단한 프롬프트를 사용하여 대규모 이미지 및 비디오 컬렉션에서 모든 개념의 인스턴스를 신뢰성 있게 찾고 세분화하고 추적하는 데 사용되는 통합 기본 모델이다.

Uni-MoE-2.0-Omni은 텍스트, 이미지, 오디오, 비디오를 신뢰성 있게 이해하는 오픈 모델로, 하비른 공과대학의 연구진이 소개했다. 이 시스템은 언어 중심의 다중 모달 추론을 위해 Lychee의 Uni-MoE 라인을 발전시킨 것으로, 효율적으로 운영된다.

ML Foundations 연구팀이 소개한 Gelato-30B-A3B는 그래픽 사용자 인터페이스를 위한 최첨단 그라운딩 모델로, AI 에이전트에게 명확한 화면 요소를 찾아 클릭하도록 가르치는 것에 대한 문제를 해결한다.

StepFun AI가 공개한 Step-Audio-EditX는 3B 파라미터 LLM 기반 오디오 모델로, 표현력 있는 음성 편집을 파형 수준 신호 처리 작업이 아닌 토큰 수준 텍스트 작업으로 변환시킴. 개발자들이 제어 가능한 TTS에 관심을 갖는 이유에 대해 설명.

구글이 Go용 에이전트 개발 킷인 ADK Go를 출시했다. Go 개발자들은 기존의 Python과 Java를 지원하는 프레임워크로 AI 에이전트를 구축할 수 있게 되었으며, 익숙한 Go 도구 체인 내에서 모든 것을 유지할 수 있다.

CMU 연구진은 프로액티브 및 개인화된 LLM 에이전트를 훈련시키기 위해 PPP와 UserVille을 소개했다. 기존 LLM 에이전트들은 과제 성공을 극대화하기 위해 조정되어 있지만 사용자에게 언제 질문할지, 상호작용 선호도를 어떻게 존중할지 신중하게 이유를 생각하지 않는다. 이에 대한 해결책을 모색하고 있다.

Ant Group의 Inclusion AI 팀이 Ling 2.0을 출시했다. 이 모델은 각 토큰의 계산을 거의 바꾸지 않으면서 용량이 증가하는 언어 모델로, 추론 능력을 향상시키는 원리에 기반한다.

Liquid AI사가 LFM2-ColBERT-350M을 출시했다. 이 모델은 다국어 및 교차언어 검색을 위한 소형 late interaction retriever로, 한 언어로 문서를 색인하고 다른 언어로 쿼리를 작성해도 높은 정확도로 검색 결과를 반환한다.

Zhipu AI 연구진은 ‘Glyph’를 발표했다. 긴 텍스트를 이미지로 렌더링하고 VLM을 사용하여 128K 컨텍스트를 1백만 토큰 워크로드로 확장하는 AI 프레임워크로, 3-4배의 토큰 압축을 달성함.

‘kvcached’는 공유 GPU에서 LLM 서빙을 위해 가상화된 탄력있는 KV 캐시를 가능하게 하는 머신러닝 라이브러리입니다. 기존에는 모델당 큰 정적 KV 캐시 영역을 미리 예약하여 GPU 메모리를 낭비했지만, kvcached를 사용하면 이를 최적화할 수 있습니다.

DeepSeek-AI가 3B DeepSeek-OCR을 출시했다. 이는 텍스트를 작은 집합의 시각 토큰으로 압축한 뒤 언어 모델로 해당 토큰을 디코딩하는 OCR 및 문서 구문 분석 Vision-Language Model(VLM) 시스템이다. 이미지는 텍스트의 간략한 표현을 갖고 있어 디코더의 시퀀스 길이를 줄인다.

DeepAgents 라이브러리는 계획을 세우고 시간에 걸쳐 작업을 관리할 수 있는 능력이 없는 기본 대형 언어 모델(Large Language Model, LLM) 에이전트를 극복하기 위해 설계되었습니다. 이 라이브러리는 “깊이” 있게 실행될 수 있도록 설계되어 있습니다.

Kong이 Volcano를 오픈소스로 공개했습니다. 이는 TypeScript SDK로, LLM 고찰 및 실제 활동을 통해 여러 LLM 제공업체 간에 다단계 에이전트 워크플로를 구성하며 MCP 도구 사용이 가능합니다.

Qualifire AI가 Rogue를 오픈소스화했습니다. 이 프레임워크는 AI 에이전트를 평가하기 위해 설계되었으며 프로토콜 정확한 대화, 명시적 정책 확인, 기계 판독 가능한 증거를 제공하여 릴리스를 자신 있게 관리할 수 있습니다.

알리바바의 Qwen 팀이 밀도 높은 Qwen3-VL 4B/8B 모델을 FP8로 축소한 Instruct와 Thinking 두 가지 프로필로 출시했다. VRAM을 적게 사용하면서도 256K→1M 컨텍스트와 전체 능력을 유지한다.

안드레이 카르파시가 nanochat을 공개했다. 이는 하나의 멀티 GPU 노드에서 실행 가능한 ChatGPT 스타일 스택을 구현한 경량 코드베이스로, 토크나이저 훈련부터 웹 UI 추론까지를 지원한다. 단일 스크립트 “스피드런”을 제공하여 토큰화, 베이스 사전 훈련, 채팅/다중 선택/도구 사용 데이터에 대한 중간 훈련, 지도된 세부 튜닝(SFT), 선택적 강화 학습을 실행한다.

Liquid AI가 온디바이스 실행을 위해 만들어진 소형 Mixture-of-Experts 모델인 LFM2-8B-A1B를 출시했다. 클라우드 배치 서빙용이 아닌 이 모델은 폰에 최적화되어 있어 메모리, 지연 및 에너지 예산을 엄격하게 고려하며 작동한다.

구글은 Model Context Protocol (MCP) 서버를 오픈소스로 공개했는데, 이를 통해 에이전틱 및 LLM 애플리케이션이 Google Ads API에 대한 읽기 전용 액세스를 얻을 수 있다. Python으로 구현된 googleads/google-ads-mcp 레포지토리는 GAQL 쿼리를 통한 광고 계정 검색 및 고객 리소스 열거를 지원한다.

AgentFlow는 명시적 메모리와 도구 세트에 의해 조정되는 네 가지 모듈 – Planner, Executor, Verifier, Generator – 을 갖춘 훈련 가능한 에이전트 프레임워크이다. Planner는 Flow-GRPO라는 새로운 온-폴리시 방법을 통해 최적화되며 트라젝토리 수준의 결과 보상을 모든 턴에 방송하고 KL 정규화 및 그룹 정규화된 어드밴티지를 적용하는 토큰 수준의 PPO 스타일 업데이트를 수행한다.

Salesforce AI Research가 CoDA-1.7B를 발표했다. 이는 양방향 컨텍스트를 사용하여 전체 시퀀스를 정제하고, 왼쪽에서 오른쪽으로 다음 토큰 예측이 아닌 병렬로 여러 토큰을 업데이트하는 코드용 확산 기반 언어 모델이다.

코넬과 구글의 연구진은 코드 문자열에서 직접 숫자 결과를 예측하는 통합 회귀 언어 모델(RLM)을 소개했습니다. 이 모델은 GPU 커널 지연, 프로그램 메모리 사용량, 심지어 신경망 정확도와 지연까지 손수 조작된 특성 없이 예측합니다. T5-Gemma에서 초기화된 300M 파라미터 인코더-디코더는 단일 텍스트-숫자 디코더를 사용하여 이질적 작업과 언어 간 강력한 순위 상관관계를 달성합니다.

AWS가 Amazon Bedrock AgentCore를 위한 오픈소스 Model Context Protocol (MCP) 서버를 출시했는데, 이는 에이전트 IDE의 자연어 프롬프트에서 AgentCore Runtime에 배포 가능한 에이전트로의 직접 경로를 제공한다. 이 패키지는 일반적인 다단계 통합 작업을 대화형 명령으로 압축하는 데 사용된다.

마이크로소프트가 공개한 ‘마이크로소프트 에이전트 프레임워크’는 오픈소스 SDK와 런타임으로, AutoGen과 Semantic Kernel의 핵심 아이디어를 통합하여 팀이 프로덕션급 AI 에이전트 및 다중 에이전트 워크플로를 구축, 배포 및 관찰할 수 있도록 도와줍니다. Python과 .NET용으로 제공되며 직접 통합됩니다.

Thinking Machines사가 Tinker를 출시했다. Tinker는 연구원과 엔지니어들이 로컬에서 학습 루프를 작성하고 플랫폼이 관리되는 분산 GPU 클러스터에서 실행할 수 있는 파이썬 API이다. 데이터, 목표 및 최적화 단계의 완전한 제어를 유지하면서 스케줄링, 장애 허용 및 다중 노드 조율을 자동화한다.

IBM은 Granite 4.0을 출시했는데, 이는 모노리딕 트랜스포머 대신 하이브리드 Mamba-2/Transformer 스택을 사용하여 서빙 메모리를 줄이고 품질을 유지한다. 다양한 사이즈의 모델들이 제공되며, 이들은 Apache-2.0로 공개되었다.

ServiceNow AI 연구소가 Apriel-1.5-15B-Thinker를 공개했다. 이 모델은 강화 학습이나 선호도 최적화 없이 데이터 중심 중간 학습 레시피로 훈련된 150억 개의 오픈 가중치 다중 모달 추론 모델로, 단일 GPU 예산에서 SOTA 대비 8배의 비용 절감으로 인공 분석 지능 지수 52를 달성한다.

구글 Colab에서 매끄럽게 실행되는 고급 AI 데스크톱 자동화 에이전트 구축 튜토리얼. 자연어 명령 해석, 파일 조작, 브라우저 작업, 워크플로우 등 데스크톱 작업 시뮬레이션 및 가상 환경을 통한 대화형 피드백 제공 설계.

Hugging Face가 Smol2Operator를 발표했다. 이는 UI 경험이 없는 작은 Vision-Language 모델을 GUI 조작 및 도구 사용 에이전트로 변환하는 재현 가능한 레시피이다. 데이터 변환 유틸리티, 훈련 스크립트, 변환된 데이터셋, 2.2B-파라미터 모델 체크포인트 등을 제공하여 GUI 에이전트를 처음부터 구축하는 완벽한 청사진으로 소개되었다.

CloudFlare AI 팀이 VibeSDK를 오픈소스로 공개했다. 이는 한 번의 클릭으로 Cloudflare 네트워크나 GitHub Repo Fork에서 완전한 AI Vibe 코딩 플랫폼을 배포할 수 있는 것으로, 코드 생성, 안전한 실행, 실시간 미리보기, 다중 테넌트 배포를 패키징하여 팀이 인프라를 별도로 연결하지 않고 자체 내부 또는 고객을 대상으로 하는 AI 앱 빌더를 구동할 수 있게 한다.

Parlant는 신뢰성이 높고 일관된 작동을 하는 AI 에이전트를 개발하는 데 도움을 주는 프레임워크이다. 대규모 언어 모델 에이전트를 배포할 때 발생하는 일반적인 문제를 해결하기 위해 설계되었으며, 시스템 프롬프트를 무시하거나 부정확하고 관련성 없는 응답을 생성하는 문제를 해결한다.

H 회사가 Holo1.5를 출시했다. 이는 컴퓨터 사용을 위한 오픈 기반 비전 모델로, 실제 사용자 인터페이스에 스크린샷 및 포인터/키보드 조작을 통해 작동하는 CU 에이전트를 위해 설계되었다. 3B, 7B, 72B 체크포인트가 포함되어 있으며, 크기별로 Holo1 대비 약 10% 정확도 향상이 문서화되어 있다.

구글의 Agent Payments Protocol (AP2)은 에이전트 주도의 결제를 위한 오픈, 상호 운용 가능한 명세서로, 사용자, 에이전트 개발자 또는 상인 중 누가 책임을 져야 하는지에 대한 불신이 해결됨.

MoonshotAI가 checkpoint-engine을 오픈소스로 공개했다. 이는 대규모 언어 모델(Large Language Model, LLM) 배포에서 주요 병목 현상 중 하나인 수천 개의 GPU에서 모델 가중치를 신속하게 업데이트하고 추론을 방해하지 않는 것을 목표로 한 경량 미들웨어이다. 라이브러리는 특히 강화 학습 및 강화 학습과 인간 피드백(RLHF)을 위해 설계되었으며, 모델이 빈번히 업데이트되고 다운타임이 발생하는 경우에 유용하다.

NVIDIA의 연구진이 ViPE: 3D 기하학 인식을 위한 비디오 포즈 엔진을 공개했다. 이는 비용이 많이 드는 전통적인 방법 없이 로봇학을 위한 AI를 훈련하기 위한 3D 데이터셋을 어떻게 생성하는가에 대한 해결책으로, 3D 컴퓨터 비전 분야의 병목 현상을 해결한다.

Meta가 MobileLLM-R1을 출시했습니다. 이는 Hugging Face에서 사용 가능한 가벼운 엣지 추론 모델로, 140M에서 950M의 파라미터를 가진 모델들이 포함되어 있습니다. 일반적인 챗봇 모델과는 달리 MobileLLM-R1은 엣지 배포용으로 설계되어 있어 최신 추론 정확도를 제공합니다.

구글 AI 연구팀과 딥마인드가 디퍼렌셜 프라이버시(DP)로 완전히 훈련된 최대 규모의 오픈 가중치 대형 언어 모델인 VaultGemma 1B를 공개했다. 이는 강력하면서도 프라이버시 보호가 가능한 AI 모델 구축으로 나아가는 중요한 한걸음이다.

IBM은 고성능 검색 및 RAG 시스템용으로 설계된 두 개의 새로운 임베딩 모델, granite-embedding-english-r2와 granite-embedding-small-english-r2를 소개했다. 이 모델들은 효율적이고 소형이며 Apache 2.0 라이선스로 제공된다.

BentoML은 llm-optimizer를 출시했는데, 이는 self-hosted large language models (LLMs)의 벤치마킹과 성능 튜닝을 간소화하기 위해 설계된 오픈 소스 프레임워크이다. 이 도구는 LLM 배포에서의 최적의 구성을 찾는 것과 같은 일반적인 도전에 대처하며, 수동 시행착오 없이 지연 시간, 처리량 및 비용에 대한 최적화된 구성을 찾는 데 도움을 준다.

MBZUAI의 연구진이 고급 AI 추론을 위한 32B-파라미터 오픈 추론 시스템 K2 Think을 발표했다. 이 시스템은 강화 학습, 테스트 시 스케일링, 추론 최적화 등을 결합하여 선두적인 성능을 보여준다.

메모리는 인간 지능을 생각할 때 먼저 떠오르는 중요한 부분이다. 경험으로부터 배우고 새로운 상황에 적응하며 시간이 흐름에 따라 더 나은 결정을 내릴 수 있게 해준다. 이와 유사하게 AI 에이전트도 메모리를 통해 더 똑똑해진다. GibsonAI가 AI 에이전트를 위한 오픈 소스 SQL 네이티브 메모리 엔진 Memori를 출시했다.

Tilde AI가 TildeOpen LLM을 공개했다. 이 모델은 300억개 이상의 파라미터를 가지며 유럽어에 특화되어 있어 소수 언어에도 주목한다. EU 내 언어 균형과 디지털 주권을 강화하는 전략적인 발전이다.

Hugging Face가 FineVision을 공개했다. 이 데이터셋은 17.3백만 개의 이미지, 24.3백만 개의 샘플, 88.9백만 개의 질문-답변 쌍, 약 100억 개의 응답 토큰을 보유하며 비전-언어 모델(VLMs) 학습을 위한 최대 규모의 구조화된 데이터셋 중 하나로 손꼽힌다.

Elysia는 의사결정 트리와 더 똑똑한 데이터 처리를 통해 Agentic RAG 시스템을 새롭게 정의하는 오픈소스 파이썬 프레임워크입니다.

NVIDIA 연구자들이 대형 언어 모델 추론의 효율성 장벽을 깨고, Jet-Nemotron을 공개했는데 이 모델 시리즈는 선도적인 LLM보다 최대 53.6배 높은 생성 처리량을 제공하면서 정확도를 유지하거나 능가한다. 이는 새로운 사전 훈련을 통해 이루어진 것이 아니라는 점이 가장 중요하다.

AI Singapore가 Google과 협력하여 개발한 SEA-LION v4는 Gemma 3 (27B) 아키텍처를 기반으로 한 오픈소스 다중언어 모델이다. 주로 동남아시아 언어를 지원하며 텍스트와 이미지 이해 능력을 제공한다. SEA-LION v4는 상용 허용 라이선스를 사용한다.

중국 AI 스타트업인 DeepSeek가 최신 주력 언어 모델인 DeepSeek-V3.1을 발표했다. DeepSeek-V3의 아키텍처를 기반으로 하여 추론, 도구 사용, 코딩 성능을 중요하게 향상시켰다. 이 모델은 저렴한 비용으로 OpenAI 및 Anthropic 수준의 성능을 제공하여 급속하게 명성을 얻고 있다.

홍콩 대학 연구진이 출시한 DeepCode는 다중 에이전트 AI 시스템을 활용하여 연구 논문 해석부터 코딩 프로세스를 자동화하는 “오픈 에이전틱 코딩” 패러다임을 제안한다.

Liquid AI사가 저지연, 장치 내 배포를 위해 최적화된 새로운 비전-언어 기반 모델인 LFM2-VL을 공식 출시했다. LFM2-VL-450M 및 LFM2-VL-1.6B 두 가지 효율적인 변형으로, 스마트폰, 노트북, 웨어러블 및 임베디드 시스템에 다중 모달 AI를 속도나 정확도를 희생하지 않고 도입하는 중요한 발전을 이루었다.

NVIDIA가 Nemotron Nano 2 패밀리를 공개했는데, 이는 최첨단 추론 정확도를 끌어올리는 하이브리드 Mamba-Transformer 대형 언어 모델을 소개하며 유사한 크기의 모델보다 최대 6배 높은 추론 처리량을 제공합니다. 이 릴리스는 데이터 및 방법론에 대한 전례없는 투명성으로 눈에 띕니다.

OpenAI가 GPT-2 이후 처음으로 오픈 가중치 언어 모델 두 개를 공개했다. gpt-oss-120b와 gpt-oss-20b는 누구나 다운로드하고 검토하며 자신의 하드웨어에서 실행할 수 있는 모델이다. 이 런칭은 AI 세계를 바꾸는 중요한 사건으로 평가된다.

AgentSociety는 대규모 에이전트 모집단을 시뮬레이션하는 첨단 오픈 소스 프레임워크로, 각각의 에이전트는 대형 언어 모델 (LLM)에 의해 구동되어 인간 사회에서 발견되는 복잡한 상호작용을 현실적으로 모델링합니다. Ray와 같은 강력한 분산 처리 기술을 활용하여 이 프로젝트는 실제로 수만 명의 활성화된 에이전트로 구성된 시뮬레이션을 달성하며, 각각의 에이전트는 자세하고 현실적인 환경에 내재되어 있습니다.

Amazon Strands Agents SDK는 AWS 환경과 통합되어 안전하고 확장 가능한 배포를 제공하며, 생산 환경에서 풍부한 관측 가능성을 제공합니다. 실용적인 사용 사례를 살펴보고 Strands를 활용한 단계별 예시를 제시합니다.

대형 언어 모델이 단순 텍스트 생성기에서 계획 수립, 추론, 자율 조치가 가능한 시스템으로 진화함에 따라 능력과 관련 위험이 증가하고 있다. 기업들이 자동화를 위해 AI를 채택하면서 목표 불일치, 프롬프트 주입, 의도치 않은 행동, 데이터 누출과 같은 새로운 도전에 직면하게 된다.

TikTok과 협력 기관의 연구원들이 소프트웨어 엔지니어링 작업에서 대형 언어 모델(LLMs)이 성능 최적화를 어떻게 하는지를 평가하는 데 특히 저장소 수준에서 처음으로 설계된 벤치마크 ‘SWE-Perf’를 소개했다.

NVIDIA AI가 복잡한 추론 작업에서 뛰어난 성과를 내는 대규모 언어 모델인 OpenReasoning-Nemotron을 소개했다. 이 모델 스위트는 1.5B, 7B, 14B 및 32B 매개변수 버전으로 구성되어 있으며, 671B DeepSeek R1 0528 모델에서 추론 능력을 캡처하여 훨씬 작고 효율적인 모델로 압축했다.

AI 기반 비디오 생성 기술이 빠르게 발전하고 있으며, NVIDIA의 DiffusionRenderer는 단일 비디오에서 편집 가능하고 사실적인 3D 장면을 생성하는 AI 모델을 소개했다. 이 모델은 놀라운 현실감을 가진 비디오를 생성하는 능력을 갖추고 있다. 그러나 이제는 전문적이고 현실적인 편집 기능이 추가되어 사용자가 비디오를 보다 전문적으로 수정할 수 있다.

구글 DeepMind와 구글 연구가 MedGemma 우산 아래 두 가지 새로운 모델을 소개했습니다. MedGemma 27B는 대규모 비전-언어 기반 모델이며 MedSigLIP는 가벼운 의학 이미지-텍스트 인코더입니다. 이들은 건강 인공지능 분야에서 가장 능력있는 오픈 소스 모델입니다.

Microsoft이 AI 기반 코딩 어시스턴트인 GitHub Copilot 채팅 익스텐션을 모든 개발자에게 무료로 공개했다. 이전에는 구독이 필요했던 기능이 이제 MIT 라이선스로 공개되어 누구나 사용 가능하다.

Hugging Face가 SmolLM3을 공개했다. 3B 파라미터 아키텍처를 사용하여 강력한 다국어 추론을 제공하며 상태-of-the-art 성능을 획득하였다. 더 적은 파라미터로 비용 효율적이고 제약된 환경에서도 배포 가능하다.