본 튜토리얼에서는 오픈 소스 instruct 모델을 활용하여 계층적 플래너 에이전트를 구축한다. 이 구조화된 다중 에이전트 아키텍처에는 플래너 에이전트, 실행자 에이전트 및 집계자 에이전트가 포함되어 있으며 각 구성 요소가 복잡한 작업을 해결하는 데 특화된 역할을 수행한다. 플래너 에이전트를 사용하여 고수준 목표를 실행 가능한 단계로 분해한다.

최신뉴스 전체보기

Perplexity사가 대규모 검색 작업에 최적화된 다국어 임베딩 모델 pplx-embed을 출시했다. 웹 규모 데이터의 복잡성과 잡음을 처리하기 위한 이 모델은 전용 임베딩 API에 대한 대안으로 제작되었다. 양방향 어텐션과 확산을 활용한 구조적 혁신이 돋보인다.

Tavus는 Phoenix-4를 출시하여 인공적인 비디오의 최종 영역인 ‘거친 계곡’을 개선하려고 합니다. Phoenix-4는 인간 상호 작용의 영혼을 부족한 AI 아바타를 보완하기 위해 설계된 새로운 생성 AI 모델입니다.

Anthropic사는 Claude Opus 4.6을 출시했다. 이 모델은 장기적인 콘텍스트 추론, 에이전트식 코딩 및 고가치 지식 작업에 중점을 둔 최신 모델이다. 이 모델은 클로드 API 및 주요 클라우드 제공업체에서 이용 가능하다.

Qwen 팀이 코딩 에이전트와 로컬 개발을 위해 디자인된 오픈 웨이트 언어 모델인 Qwen3-Coder-Next를 출시했다. 모델은 80B의 총 파라미터를 가지고 있지만 각 토큰 당 활성화되는 파라미터는 3B뿐이다.

Robbyant은 LingBot-World를 공개했는데, 이는 영상 생성을 상호작용 시뮬레이터로 변환하는 대규모 세계 모델로, 총체 AI, 자율 주행, 게임 등을 위한 환경을 렌더링하며 시각적으로 뛰어나고 반응성이 뛰어난 특징을 갖추고 있다.

AI2가 SERA(Soft Verified Efficient Repository Agents)를 소개했다. SERA는 감독 학습과 합성 경로만 사용하여 훨씬 큰 폐쇄 시스템과 맞추기 위해 개발된 코딩 에이전트 패밀리다. SERA는 AI2의 오픈 코딩 에이전트 시리즈의 첫 번째 릴리스이며, 주요 모델인 SERA-32B는…

안트 그룹의 LingBot-VLA는 현실 세계에서 실제 로봇 조작을 대상으로 하는 비전 언어 액션 기반 모델이다. 9개의 듀얼 암 로봇을 제어할 수 있는 단일 비전 언어 액션 모델을 구축하는 방법에 대한 연구 결과이며, 약 20,000 시간의 텔레오퍼레이션 양쪽 손 데이터로 학습되었다.

MBZUAI 연구진이 K2 Think V2를 발표했다. 이는 완전한 주권을 갖춘 추론 모델로, 투명한 훈련 파이프라인을 통해 최신 시스템과 경쟁하는 것을 목표로 한다.

DSGym은 스탠퍼드 대학, Together AI, 더크 대학, 하버드 대학의 연구진들이 소개한 프레임워크로, 1,000개 이상의 데이터 과학 과제를 전문가가 선별한 정답과 함께 평가하고 훈련합니다.

StepFun은 웹 검색을 실제 연구 워크플로우로 변환하는데 목표를 둔 32B 파라미터 엔드 투 엔드 심층 연구 에이전트 Step-DeepResearch를 소개했다. 모델은 Qwen2.5 32B-Base 위에 구축되었으며 장기적인 추론, 도구 사용 및 구조화된 보고를 통한 웹 검색을 연구로 전환한다.

Chroma 1.0은 스피커 식별을 유지하면서 오디오를 입력으로 받아들이고 출력으로 반환하는 실시간 음성-음성 대화 모델이다. 낮은 대기 시간 상호작용과 높은 품질의 개인화된 음성 클로닝을 결합한 최초의 오픈 소스 음성 대화 시스템으로 소개된다.

NVIDIA가 저지연 음성 에이전트와 라이브 자막을 위해 특별히 제작된 새로운 영어 전사 모델(Nemotron Speech ASR)을 공개했다. 이 모델은 FastConformer 인코더와 RNNT 디코더를 결합한 캐시 인식 아키텍처로 최적화되어 현대 NVIDIA GPU에서 스트리밍 및 배치 작업에 튜닝되었다.

Recursive Language Models는 대규모 언어 모델에서 일반적으로 발생하는 문맥 길이, 정확도 및 비용 사이의 상충 관계를 깨려고 한다. RLM은 모델이 하나의 거대한 프롬프트를 한 번에 읽도록 강요하는 대신, 프롬프트를 외부 환경으로 취급하고 모델이 코드로 어떻게 조사할지 결정한 다음 재귀적으로 호출한다.

구글 딥마인드 연구원들이 Gemma Scope 2를 소개했다. 이는 Gemma 3 언어 모델이 270M에서 27B 파라미터에 이르는 모든 레이어에서 정보를 처리하고 표현하는 방법을 노출하는 해석성 도구 모음이다. 주요 목표는 AI 안전 및 정렬 팀들이 모델 동작을 내부 기능으로 역추적할 수 있는 실용적인 방법을 제공하는 것이다.

NVIDIA가 Nemotron 3 패밀리를 발표했는데, 이는 agentic AI를 위한 완전한 스택으로, 모델 가중치, 데이터셋 및 강화 학습 도구를 포함한다. 이 패밀리는 Nano, Super, Ultra 세 가지 크기로 나뉘어 있으며, 긴 문맥 추론과 추론 비용에 엄격한 제어가 필요한 다중 에이전트 시스템을 대상으로 한다.

Thinking Machines Lab은 Tinker 훈련 API를 일반적으로 사용 가능하게 하고, Kimi K2 Thinking 추론 모델 지원, OpenAI 호환 샘플링, Qwen3-VL 비전 언어 모델을 통한 이미지 입력을 추가했습니다. AI 엔지니어들에게는 분산 훈련을 구축하지 않고도 선두 모델을 세밀하게 조정할 수 있는 실용적인 방법으로 변모시켰습니다.

Marktechpost의 ML 글로벌 영향 보고서에 따르면, ML 도구의 원산지와 연구 채택 사이에 지리적 불균형이 있음을 밝혀냄. 125개국에서 발표된 5,000여편의 논문을 분석한 결과, 특정 연구 영역에서의 불균형을 보여줌.

DeepSeek 연구팀이 DeepSeek-V3.2 및 DeepSeek-V3.2-Speciale을 소개했다. 이 모델들은 에이전트를 위한 고품질 추론, 장문맥, 에이전트 워크플로우를 지향하며 열린 가중치와 제품 API를 갖췄다.

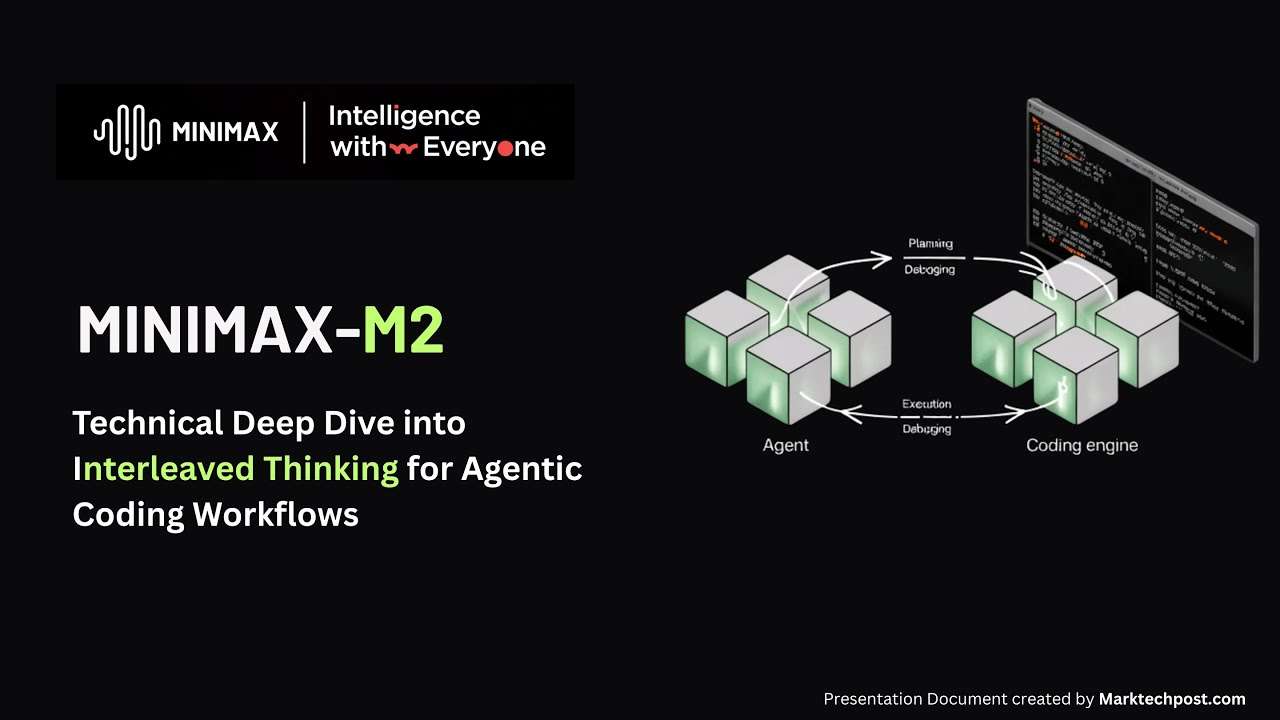

MiniMax-M2는 AI 코딩 환경을 혁신하며, 고성능이 높은 비용이나 레이턴시로 이어지는 문제를 해결한다. 이 기사는 MiniMax-M2에 대한 기술적 개요를 제공한다.

ML Foundations 연구팀이 소개한 Gelato-30B-A3B는 그래픽 사용자 인터페이스를 위한 최첨단 그라운딩 모델로, AI 에이전트에게 명확한 화면 요소를 찾아 클릭하도록 가르치는 것에 대한 문제를 해결한다.

Anthropics의 새 연구는 대형 언어 모델인 Claude가 자체 내부 상태를 인지하는지 아니면 훈련 데이터에서 반복하는지 구별하는 방법을 살펴봅니다. 현재 Claude 모델이 자신의 능력에 대해 이야기하는 것 이상을 할 수 있는지 살펴보며, 주입된 개념을 감지할 수 있는지에 대해 질문을 제기합니다.

Anthropic, Thinking Machines Lab, Constellation의 연구팀은 모델 사양을 스트레스 테스트하여 최신 모델이 동일한 사양 하에 서로 다른 행동 프로필을 나타내는지 확인하는 방법을 제시했다.

AI 분야의 풍경이 확장되고 있다. 최강의 LLMs(대형 언어 모델) 중 많은 것들이 클라우드에 주로 위치하고 있지만, 이제 강력한 새로운 패러다임이 등장하고 있다. 개인의 프라이버시 문제와 업로드 파일 수나 로딩 기간 제한에 대한 우려도 존재한다.

이 코딩 구현에서는 텍스트 시퀀스에서 연속적인 수치 값을 직접 예측하는 회귀 언어 모델(RLM)을 구축한다. 자연어 설명 안에 숨겨진 양적 관계를 학습하는 트랜스포머 기반 아키텍처를 훈련하는데 초점을 맞춘다. 합성 텍스트-숫자 데이터 생성부터 시작해서 효율적으로 토큰화한다.

Google Cloud AI Research과 MIT, 하버드, Google DeepMind의 협력자들이 TUMIX (도구 사용 혼합)를 소개했다. 이는 이질적인 에이전트 스타일(텍스트, 코드, 검색, 가이드된 변형)을 앙상블하는 테스트 시간 프레임워크이다.

IBM은 Granite 4.0을 출시했는데, 이는 모노리딕 트랜스포머 대신 하이브리드 Mamba-2/Transformer 스택을 사용하여 서빙 메모리를 줄이고 품질을 유지한다. 다양한 사이즈의 모델들이 제공되며, 이들은 Apache-2.0로 공개되었다.

ServiceNow AI 연구소가 Apriel-1.5-15B-Thinker를 공개했다. 이 모델은 강화 학습이나 선호도 최적화 없이 데이터 중심 중간 학습 레시피로 훈련된 150억 개의 오픈 가중치 다중 모달 추론 모델로, 단일 GPU 예산에서 SOTA 대비 8배의 비용 절감으로 인공 분석 지능 지수 52를 달성한다.

2025년 로컬 LLMs는 빠르게 성숙해졌으며, 안정적인 사양과 일류 로컬 러너를 제공하면서 온프렘 및 랩톱 추론이 실용적으로 가능해졌다.

MoonshotAI가 checkpoint-engine을 오픈소스로 공개했다. 이는 대규모 언어 모델(Large Language Model, LLM) 배포에서 주요 병목 현상 중 하나인 수천 개의 GPU에서 모델 가중치를 신속하게 업데이트하고 추론을 방해하지 않는 것을 목표로 한 경량 미들웨어이다. 라이브러리는 특히 강화 학습 및 강화 학습과 인간 피드백(RLHF)을 위해 설계되었으며, 모델이 빈번히 업데이트되고 다운타임이 발생하는 경우에 유용하다.

이 튜토리얼에서는 SpeechBrain을 사용한 고급이면서도 실용적인 워크플로우를 안내합니다. gTTS로 자체 깨끗한 음성 샘플을 생성하고 실제 시나리오를 시뮬레이션하기 위해 음향을 의도적으로 추가한 다음 SpeechBrain의 MetricGAN+ 모델을 적용하여 오디오를 향상시킵니다. 오디오가 소음 제거되면 언어 모델-재점수화를 통해 자동 음성 인식을 실행합니다.

구글 AI가 대규모 언어 모델의 평가를 간편하게 하는 Stax를 출시했습니다. Stax는 구조화된 방법으로 모델을 평가하고 비교할 수 있어, 확률적 시스템인 언어 모델의 일관성 테스트를 간단하게 도와줍니다.

한국은 대규모 언어 모델(LLM) 분야에서 중요한 혁신가로 자리매김하고 있으며 정부 투자, 기업 연구, 오픈 소스 협력을 통해 한국어 처리 및 국내 응용 프로그램에 맞는 모델을 만들고 있다. 이는 외국 AI 기술에 대한 의존성을 줄이고 데이터 개인 정보 보호를 향상시키며 의료, 교육 등의 분야를 지원한다.

구글 DeepMind와 구글 연구가 MedGemma 우산 아래 두 가지 새로운 모델을 소개했습니다. MedGemma 27B는 대규모 비전-언어 기반 모델이며 MedSigLIP는 가벼운 의학 이미지-텍스트 인코더입니다. 이들은 건강 인공지능 분야에서 가장 능력있는 오픈 소스 모델입니다.

LongWriter-Zero는 강화 학습 기반의 프레임워크로, 수천 단어에 걸쳐 있는 초장문 텍스트 생성에 도전하는 것을 소개하며, 대규모 언어 모델이 직면한 문제점들을 다루고 있다. 주요 문제로는 불일치, 주제 이탈 등이 있다.

MIT와 NUS 연구진은 메모리 사용량이 폭발하는 문제 해결을 위해 장기적인 대화 에이전트를 위한 메모리 효율적인 프레임워크 MEM1을 소개했다. 기존 시스템의 문제점을 보완하여 성능 향상과 더 나은 추론을 이끌어냈다.

CMU 연구진이 웹 환경을 위한 디지털 에이전트들이 동적 웹 인터페이스에 어려움을 겪는 이유와 이를 극복하기 위해 그래프 기반 프레임워크 ‘Go-Browse’를 소개했다. 이 프레임워크는 확장 가능한 웹 에이전트 훈련을 위해 개발되었으며, 웹 페이지 탐색, 클릭, 양식 제출 등의 작업을 자동화한다.

언어 모델링은 자연어 처리에서 중요한 역할을 하며, 기계가 인간 언어와 유사한 텍스트를 예측하고 생성할 수 있게 합니다. 최근 대규모 트랜스포머 시스템으로 발전한 모델들 중 하나인 확장 가능한 바이트 수준 자기회귀 U-Net 모델이 토큰 기반 트랜스포머를 능가하는 것으로 나타났다.

최근 텍스트 기반 언어 모델의 발전으로 RL이 강력한 추론 기술 개발에 도움이 되는 것을 입증했다. 이에 영감을 받아 연구자들은 시각적 및 텍스트 입력 간 추론 능력을 향상시키기 위해 동일한 RL 기술을 MLLMs에 적용하려고 시도해왔지만 성공하지 못했다.

NVIDIA가 Llama Nemotron Nano 4B를 공개했는데, 이는 과학 작업, 프로그래밍, 심볼릭 수학, 함수 호출 및 명령어 따르기에 강력한 성능과 효율성을 제공하면서 엣지 배포에 적합한 오픈 소스 추론 모델이다. 40억 개의 파라미터로 높은 정확도를 달성하며, 비교 모델 대비 최대 50% 높은 처리량을 달성했다.

LM 에이전트의 최근 발전은 복잡한 실제 과제 자동화에 유망한 잠재력을 보여주고 있음. 이러한 에이전트는 일반적으로 API를 통해 작업을 제안하고 실행하여 소프트웨어 공학, 로봇공학, 과학 실험 등의 응용 프로그램을 지원함. 이러한 과제가 더 복잡해지면 LM 에이전트 프레임워크는 다중 에이전트, 다단계 검색, 맞춤형 지원을 포함하도록 진화해왔음.

Tsinghua 대학의 ‘Absolute Zero’는 외부 데이터 없이 LLM을 훈련시키는데 성공하였다. 현재의 RLVR 작업은 규모 확장 문제에 직면하고 있지만, ‘Absolute Zero’는 중간 추론 단계를 모방하는 대신 결과 기반 피드백에 의존하여 추론 능력을 향상시켰다.

ELIZA의 간단한 규칙 기반 시스템에서 현재의 정교한 플랫폼으로 대화형 AI가 발전해왔다. 이 과정은 80년대부터 90년대의 스크립트 봇, 2010년대의 Rasa와 같은 ML-규칙 하이브리드 프레임워크를 거쳐 2020년대의 혁명적인 대형 언어 모델로 이어져 자연스러운 대화를 가능케 했다. 현재는 Parlant와 같은 최첨단 대화 모델링 플랫폼이 주류다.

알리바바의 Qwen 팀이 Qwen 시리즈의 최신 대형 언어 모델인 Qwen3을 공개했다. 이 모델은 Dense 및 Mixture-of-Experts (MoE) 모델의 포괄적인 스위트를 제공하며, 세밀한 추론, 다국어 능력, 계산 효율성에 대한 다양한 도전 과제를 해결하고 있다.

NVIDIA AI가 OpenMath-Nemotron-32B 및 14B-Kaggle을 발표했다. 이는 수학 추론을 위한 고급 AI 모델로, AIMO-2 대회에서 1위를 차지하고 새로운 기록을 세웠다.

IBM이 새로운 음성-텍스트(STT) 모델 Granite 3.3 8B를 발표했다. 이 모델은 자동 음성 인식(ASR) 및 자동 음성 번역(AST)에서 뛰어난 성능을 보여준다.