구글 딥마인드가 음악 분야에서도 창의적 AI의 한계를 넓혔다. Lyria 3은 사진과 텍스트를 이용해 사용자 맞춤 트랙을 생성하는 고급 음악 생성 모델로, 복잡한 오디오 파형과 창의적 의도를 다루는데 큰 전환점을 제공한다.

구글 딥마인드가 음악 분야에서도 창의적 AI의 한계를 넓혔다. Lyria 3은 사진과 텍스트를 이용해 사용자 맞춤 트랙을 생성하는 고급 음악 생성 모델로, 복잡한 오디오 파형과 창의적 의도를 다루는데 큰 전환점을 제공한다.

Cohere AI Labs가 Tiny Aya를 발표했습니다. Tiny Aya는 70개 언어를 지원하며 3.35B-파라미터 아키텍처를 사용하여 최신 번역 및 생성 기능을 제공합니다. 이 릴리스에는 Tiny Aya Base(사전 훈련), Tiny Aya Global(균형 조정된 지시) 등 5가지 모델이 포함되어 있습니다.

nineninesix.ai 팀이 출시한 ‘Kani-TTS-2’는 효율성을 중시하는 새로운 오픈 소스 음성 생성 모델로, 작은 용량으로 고품질 음성 합성을 제공하며 음성 복제 기능을 지원한다.

Kyutai가 Hibiki-Zero를 발표했다. 이 모델은 동시 음성 대 음성 및 음성 대 텍스트 번역을 위한 새로운 시스템이다. 이 모델은 실시간으로 원본 음성을 대상 언어로 번역하며, 과거 모델과 달리 학습에 단어 수준의 정렬 된 데이터가 필요하지 않다.

알리바바 클라우드의 Qwen 팀이 Qwen3-TTS를 오픈소스로 공개했습니다. 이는 음성 클론, 음성 디자인, 고품질 음성 생성이라는 세 가지 핵심 작업을 대상으로 하는 멀티링구얼 텍스트 음성 모델 패밀리입니다. Qwen3-TTS는 12Hz 음성 토크나이저와 2개의 언어 모델 크기(0.6B, 1.7B)를 사용하며, 실시간 세밀한 음성 제어 기능을 제공합니다.

Chroma 1.0은 스피커 식별을 유지하면서 오디오를 입력으로 받아들이고 출력으로 반환하는 실시간 음성-음성 대화 모델이다. 낮은 대기 시간 상호작용과 높은 품질의 개인화된 음성 클로닝을 결합한 최초의 오픈 소스 음성 대화 시스템으로 소개된다.

이 튜토리얼에서는 현대적인 저지연 대화 시스템이 실시간으로 작동하는 방식을 모방하는 완전한 스트리밍 음성 에이전트를 구축합니다. 청크화된 오디오 입력 및 스트리밍 음성 인식부터 점진적 언어 모델 추론 및 스트리밍된 텍스트 음성 출력까지의 파이프라인을 시뮬레이션하며 각 단계에서 명시적으로 지연 시간을 추적합니다.

NVIDIA의 연구진이 PersonaPlex-7B-v1을 발표했는데, 이는 자연스러운 음성 상호작용을 위한 풀 더플렉스 대화 모델로, 정확한 페르소나 제어를 목표로 한다. ASR→LLM→TTS에서 단일 풀 더플렉스 모델로 진화했다. 기존 음성 어시스턴트는 ASR이 음성을 텍스트로 변환하고, 언어 모델이 텍스트 답변을 생성한 후, 텍스트를 음성으로 변환한다.

NVIDIA가 저지연 음성 에이전트와 라이브 자막을 위해 특별히 제작된 새로운 영어 전사 모델(Nemotron Speech ASR)을 공개했다. 이 모델은 FastConformer 인코더와 RNNT 디코더를 결합한 캐시 인식 아키텍처로 최적화되어 현대 NVIDIA GPU에서 스트리밍 및 배치 작업에 튜닝되었다.

StepFun AI가 공개한 Step-Audio-EditX는 3B 파라미터 LLM 기반 오디오 모델로, 표현력 있는 음성 편집을 파형 수준 신호 처리 작업이 아닌 토큰 수준 텍스트 작업으로 변환시킴. 개발자들이 제어 가능한 TTS에 관심을 갖는 이유에 대해 설명.

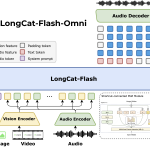

Meituan의 LongCat 팀이 LongCat Flash Omni를 발표했다. 이 모델은 5600억 개 매개변수와 토큰 당 약 27억 개 활성화를 갖춘 오픈소스 옴니 모달 모델로, 텍스트, 이미지, 비디오, 오디오를 실시간으로 듣고 보고 읽고 응답할 수 있는 효율적인 단일 모델을 설계하는 방법이다.

이스라엘 음성 AI 스타트업인 Deepdub이 Lightning 2.5를 소개했다. 이 모델은 실시간으로 작동하는 기본 음성 모델로, 성능과 효율성 면에서 상당한 향상을 이뤘다. 이로써 AI 에이전트, 기업 AI 등 실시간 대화 시스템에서 사용할 수 있게 되었다.

OpenAI가 gpt-realtime과 Realtime API를 공식적으로 출시했으며 엔터프라이즈를 위한 기능을 갖춘 신속한 API를 베타에서 벗어나 발표했다. 음성 AI 기술에서 혁신적인 발전을 이루고 있지만, 의미 있는 개선 사항과 지속적인 도전 과제가 있음을 보여준다.

Step-Audio-AQAA는 음성 인식, 자연어 이해, 오디오 생성을 결합한 오디오 언어 모델로, 텍스트 변환에 의존하지 않고 음성 상호작용을 위해 설계되었습니다.