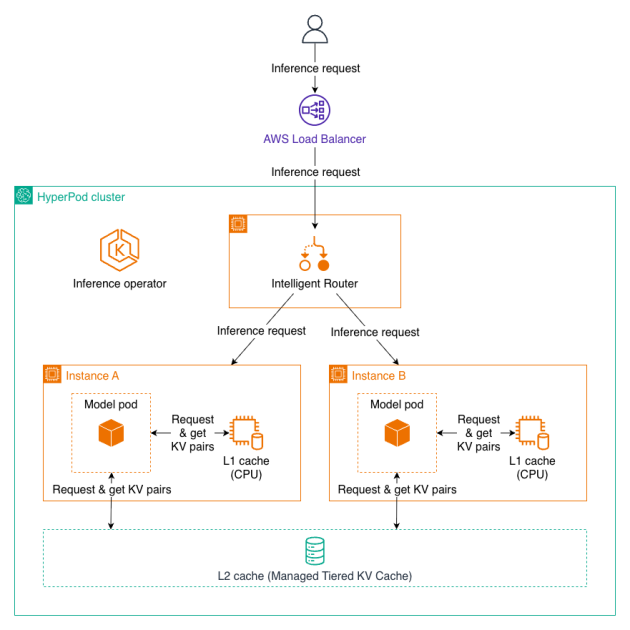

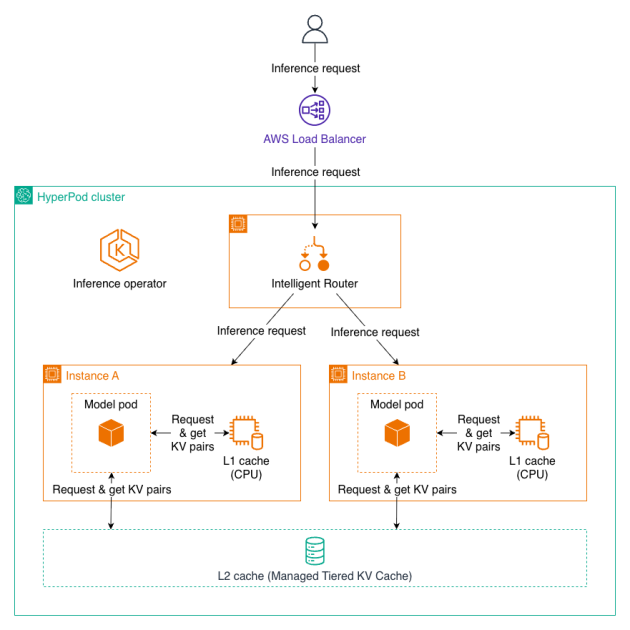

Amazon SageMaker HyperPod를 위한 관리형 Tiered KV 캐시 및 지능적 라우팅 기능 소개. 이 기능은 장문 프롬프트 및 다중 대화에서 최대 40%의 첫 토큰 시간 감소와 최대 25%의 컴퓨팅 비용 절감을 제공한다. 이 기능은 분산된 KV 캐싱 인프라와 지능적인 요청 라우팅을 자동으로 관리하여 엔터프라이즈급 성능으로 제품 규모의 LLM 추론 워크로드를 배포하는 것을 쉽게 하며 운영 오버헤드를 크게 줄인다.

Amazon SageMaker HyperPod를 위한 관리형 Tiered KV 캐시 및 지능적 라우팅 기능 소개. 이 기능은 장문 프롬프트 및 다중 대화에서 최대 40%의 첫 토큰 시간 감소와 최대 25%의 컴퓨팅 비용 절감을 제공한다. 이 기능은 분산된 KV 캐싱 인프라와 지능적인 요청 라우팅을 자동으로 관리하여 엔터프라이즈급 성능으로 제품 규모의 LLM 추론 워크로드를 배포하는 것을 쉽게 하며 운영 오버헤드를 크게 줄인다.

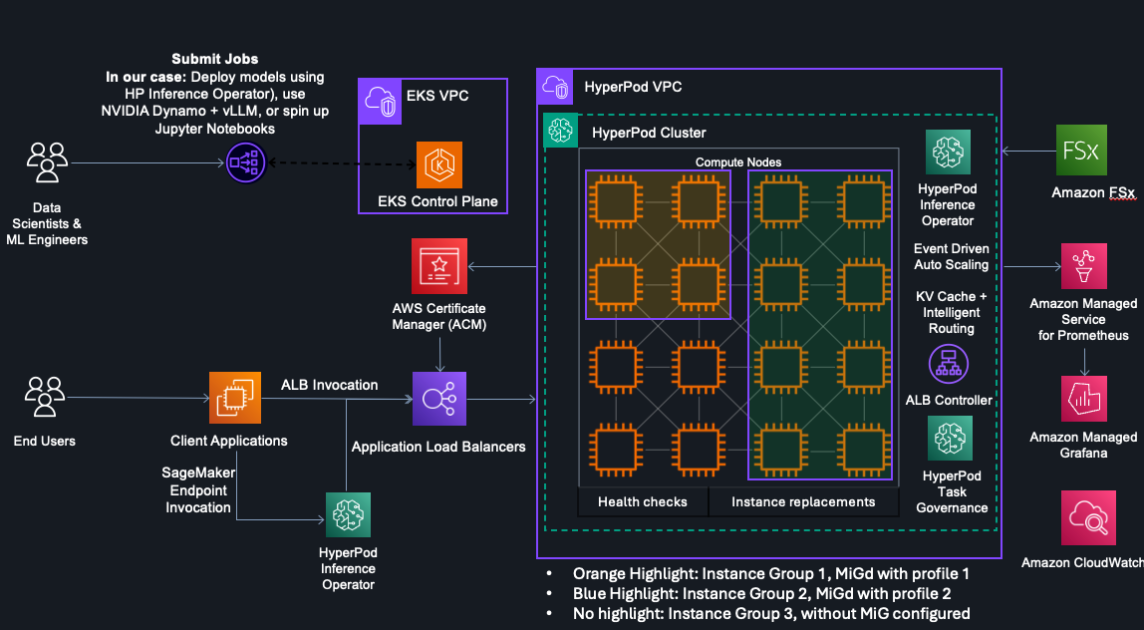

Amazon SageMaker HyperPod가 NVIDIA Multi-Instance GPU(MIG) 기술을 지원함으로써 강력한 GPU를 여러 격리된 인스턴스로 분할하여 추론, 연구, 상호작용 개발과 같은 동시 작업을 실행할 수 있게 되었습니다. GPU 활용도를 극대화하고 낭비되는 자원을 줄이는 MIG는 기업이 다양한 머신러닝 작업에서 성능 격리와 예측 가능한 서비스 품질을 유지하면서 비용을 최적화할 수 있도록 도와줍니다.

Amazon SageMaker HyperPod 클러스터는 Amazon Elastic Kubernetes Service (EKS) 조정을 통해 JupyterLab 및 오픈 소스 Visual Studio Code와 같은 대화형 개발 환경을 생성하고 관리할 수 있어서, 익숙한 도구를 데이터 과학자들에게 제공하여 ML 개발 수명주기를 간소화합니다. 이 게시물에서는 HyperPod 관리자가 클러스터용 Spaces를 구성하는 방법과 데이터 과학자가 이러한 Spaces를 만들고 연결하는 방법을 보여줍니다.

Amazon SageMaker HyperPod에 두 가지 주요 기능이 도입되어 대규모 머신 러닝 인프라의 보안 및 저장 기능이 강화되었습니다. 새로운 기능으로는 기업이 제어하는 암호화 키를 사용하여 EBS 볼륨을 암호화하는 고객 관리 키(CMK) 지원 및 AI 워크로드에서 Kubernetes 볼륨에 대한 동적 저장소 관리를 지원하는 Amazon EBS CSI 드라이버 통합이 포함됩니다.

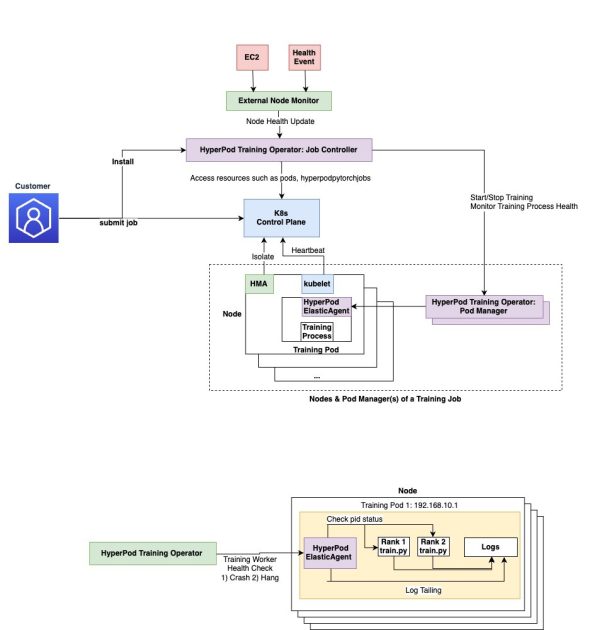

Amazon SageMaker HyperPod 훈련 연산자를 활용하여 Kubernetes 워크로드의 훈련 내구성을 향상시키는 방법을 소개하고, 대규모 GPU 클러스터 전체에 분산 훈련을 효율적으로 관리하여 중앙 집중식 훈련 프로세스 모니터링, 세밀한 프로세스 복구, 느려진 작업 감지 등의 이점을 제공함.

Splash Music가 AWS Trainium을 사용하여 고급 HummingLM 모델을 활용하여 AI 기반 음악 생성의 새 기준을 세우고 있다. 2024 AWS Generative AI Accelerator의 선정된 스타트업으로, Splash Music는 AWS 스타트업과 AWS Generative AI 혁신 센터 (GenAIIC)와 긴밀히 협력하여 혁신을 가속화하고 음악 생성 FM 개발 라이프사이클을 가속화하고 있다.

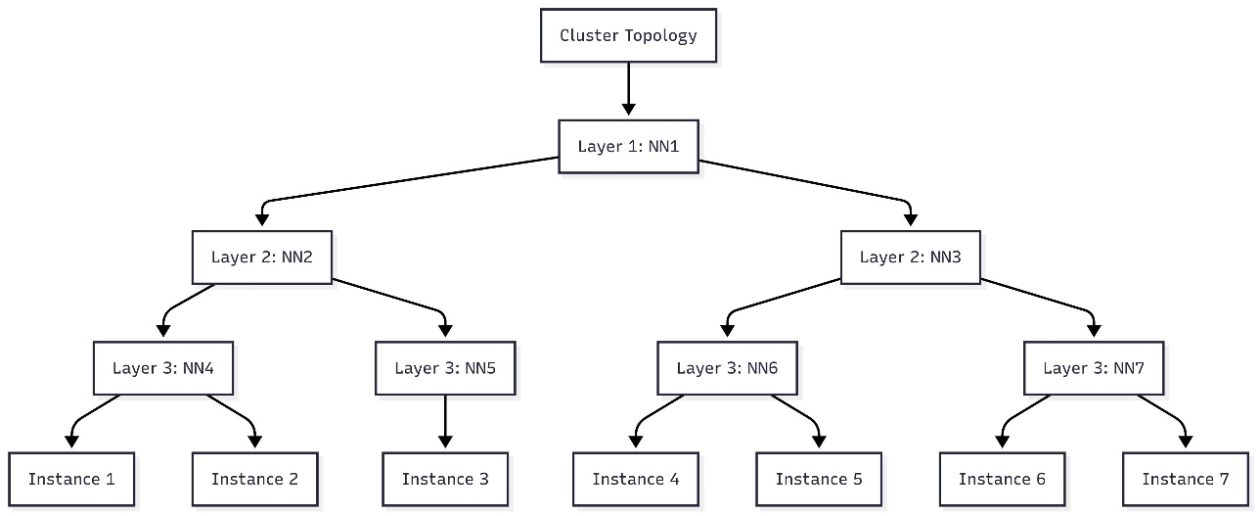

SageMaker HyperPod 작업 관리를 사용하여 토폴로지 인식 스케줄링을 소개하고 계층적 네트워크 정보를 나타내는 작업을 제출함으로써 작업을 최적화하는 방법에 대한 세부 정보를 제공합니다.

기업의 운영과 혁신을 변화시키는 생성 AI로 인해 AI 모델의 교육 및 배포를 위한 인프라 수요가 급증하고 있다. 전통적인 인프라 방식은 현대 AI 워크로드의 계산 요구, 네트워크 요구, 내구성 요구와 맞춰가기 어렵다. AWS는 기술 분야에서 변화를 경험하고 있으며 AI 인프라 도전 과제에 대응하고 있다.

AWS는 Amazon SageMaker HyperPod에서 관리형 계층형 체크포인팅을 발표했는데, 이는 수천 개의 AI 가속기를 통해 생성 AI 모델 개발을 확장하고 가속화하기 위한 목적으로 만들어진 인프라이다. CPU 메모리를 사용하여 고성능 체크포인트 저장 및 인접한 컴퓨팅 노드 간 자동 데이터 복제를 통해 신뢰성을 향상시킨다.

HyperPod 작업 관리 기능을 사용하여 고객은 Amazon Elastic Kubernetes Service (Amazon EKS)에서 Amazon SageMaker HyperPod 클러스터 활용을 최적화하고 공정한 사용을 분배하며 다른 팀 또는 프로젝트 간에 효율적인 리소스 할당을 지원할 수 있습니다.

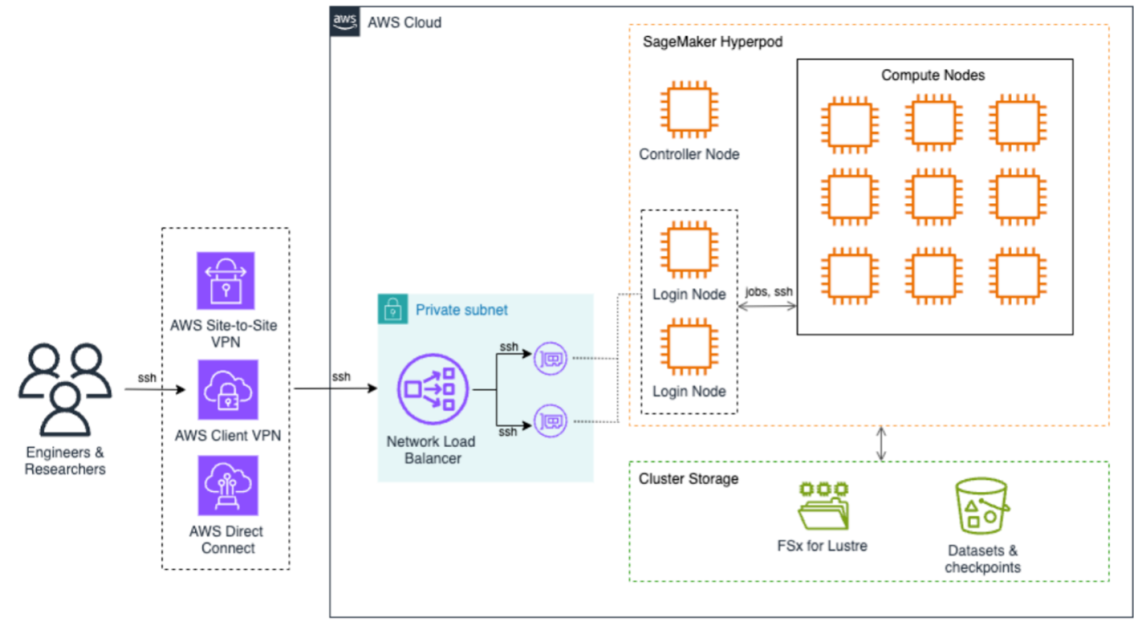

이 블로그 글에서는 연구 대학이 SageMaker HyperPod를 도입하여 동적 SLURM 파티션, 세밀한 GPU 자원 관리, 예산 고려 컴퓨트 비용 추적, 그리고 다중 로그인 노드 부하 균형을 통해 AI 연구를 가속화하는 방법을 소개합니다.

Amazon SageMaker HyperPod CLI 및 SDK를 사용하여 대규모 AI 모델의 훈련 및 배포 프로세스를 최적화하는 방법을 실제 분산 훈련 예제를 통해 보여줍니다. FSDP를 사용한 분산 훈련 및 추론용 모델 배포의 실용적인 예제를 제공하며, CLI는 일반적인 작업을 위한 간단한 명령을 통해 단순화된 워크플로우를 제공하고, SDK는 복잡한 요구 사항을 위한 유연한 개발 옵션을 제공합니다.

Amazon SageMaker HyperPod의 새로운 클러스터 생성 경험을 통해 한 번의 클릭으로 필요한 AWS 리소스가 포함된 SageMaker HyperPod 클러스터를 만들 수 있고, 자동으로 권장되는 기본값이 적용됩니다.

Amazon SageMaker HyperPod가 이제 Karpenter를 활용한 관리 노드 자동 스케일링을 지원한다. SageMaker HyperPod 클러스터의 효율적인 스케일링을 가능케 하며, Karpenter의 혜택과 활성화 및 구성 방법에 대한 세부 정보를 제공한다.

SageMaker HyperPod의 세 가지 기능 소개. Continuous provisioning으로 유연한 리소스 프로비저닝 제공해 모델 학습 및 배포를 빠르게 시작하고 클러스터를 효율적으로 관리. Custom AMIs로 ML 환경을 조직의 보안 표준과 소프트웨어 요구 사항에 맞게 조정 가능.

2024년, 일본 경제산업성이 Generative AI 가속기 도전을 시작했고, AWS는 GENIAC의 두 번째 사이클을 위해 클라우드 제공업체로 선정되어 12개 기관에 기반 모델 개발을 위한 인프라와 기술 지원을 제공했다.

SkyPilot과 함께하는 이 글은, 생성적 AI 및 Foundation 모델(FMs)의 신속한 발전으로 기계 학습(ML) 워크로드의 계산 리소스 요구가 크게 증가했다. 현대 ML 파이프라인은 가속화된 컴퓨팅 리소스에 작업 부하를 효율적으로 분산시키는 시스템을 필요로 하며, 개발자 생산성을 유지해야 한다.

Amazon SageMaker AI의 새로운 혁신 기능을 소개하며, SageMaker HyperPod의 새로운 관측 기능, HyperPod에 JumpStart 모델 배포 기능, 로컬 개발 환경에서 SageMaker AI로의 원격 연결, 완전히 관리되는 MLflow 3.0 등이 포함됩니다.

SageMaker HyperPod에서 Amazon Elastic Kubernetes Service (EKS) 애드온을 원 클릭 설치하여 NVIDIA DCGM, Kubernetes 노드 익스포터, EFA, 통합 파일 시스템, Kubernetes API, Kueue, SageMaker HyperPod 작업 연산자의 건강 및 성능 데이터를 통합할 수 있습니다. 이 기사에서는 SageMaker HyperPod의 기본 관측 기능의 통합 대시보드를 설치하고 사용하는 방법을 안내합니다.

본문에서는 다중 계정을 가진 기업이 공유 Amazon SageMaker HyperPod 클러스터에 액세스하여 다양한 작업을 실행하는 방법에 대해 논의합니다. SageMaker HyperPod 작업 규제를 사용하여 이 기능을 가능하게 합니다.