이 글에서는 Amazon SageMaker AI를 활용하여 Supervised Fine-Tuning(SFT)과 Direct Preference Optimization(DPO)를 결합해 소형 언어 모델의 도구 호출 정확도를 향상시키는 방법을 소개합니다.

이 글에서는 Amazon SageMaker AI를 활용하여 Supervised Fine-Tuning(SFT)과 Direct Preference Optimization(DPO)를 결합해 소형 언어 모델의 도구 호출 정확도를 향상시키는 방법을 소개합니다.

이 글에서는 Amazon SageMaker AI 엔드포인트에서 제공되는 LLM의 품질과 양을 종합적으로 파악할 수 있는 관찰 가능성 솔루션을 소개합니다.

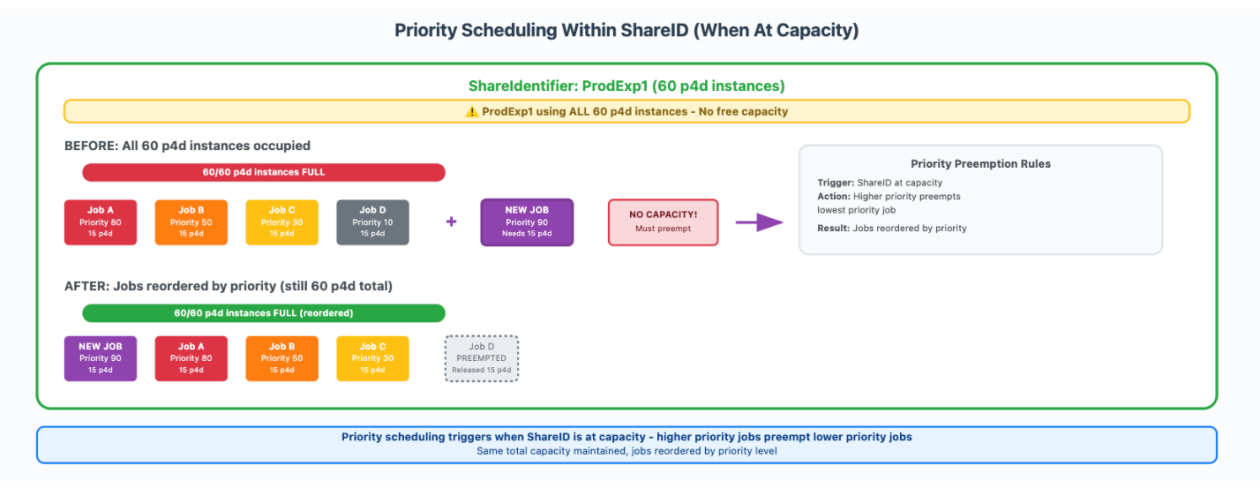

Amazon EC2의 Capacity Blocks와 SageMaker 교육 계획을 통해 단기 ML 작업을 위한 GPU 용량을 확보하는 방법을 소개합니다. 이 솔루션은 로드 테스트, 모델 검증 등 다양한 단기 용량 요구를 해결할 수 있습니다.

이 글에서는 검증 가능한 보상(RLVR)을 활용한 강화 학습 구현 방법을 소개합니다. 이 접근법은 수학적 추론, 코드 생성 등에서 효과적이며, 훈련 성능을 개선하는 데 기여합니다.

Amazon SageMaker AI가 MLflow 버전 3.10을 지원하게 되면서 생성형 AI 개발과 실험 추적이 더욱 간편해졌습니다. 새로운 기능들이 추가되어 사용자 경험이 향상되었습니다.

아마존 세이지메이커 AI는 개발자가 자연어로 사용 사례를 설명하면 AI 코딩 에이전트가 전체 과정을 간소화하는 에이전트 기반 경험을 제공합니다. 이 글에서는 세이지메이커 AI의 모델 커스터마이징 생애 주기를 안내합니다.

이번 포스트에서는 Amazon Nova 모델을 활용한 LLM을 판별자로 사용하는 강화 학습(RLAIF)의 작동 방식을 심층적으로 살펴봅니다.

이 글에서는 SageMaker AI 엔드포인트에 배포된 모델을 사용하여 Strands Agents SDK로 AI 에이전트를 구축하는 방법을 설명합니다.

이 글에서는 SageMaker AI 추론 엔드포인트를 배포하기 위해 GPU 용량을 설정하는 방법을 안내합니다. 데이터 과학자의 여정을 따라 모델 평가를 위한 용량 예약 및 엔드포인트 관리 과정을 설명합니다.

AWS ISV 파트너인 인공지능 기업이 아마존 세이지메이커 AI와 아마존 노바를 활용해 입력은 확률적이고 출력은 결정적인 솔루션을 제공하여 안전한 기업 채택을 지원하고 있습니다.

아마존 SageMaker AI 엔드포인트가 향상된 메트릭스를 지원하여 구성 가능한 게시 빈도를 제공합니다. 이를 통해 생산 엔드포인트를 모니터링하고 문제를 해결하며 성능을 개선할 수 있는 세부적인 가시성을 제공합니다.

Atos는 AWS AI 리그를 활용해 400명 이상의 참가자에게 AI 교육을 가속화하고, 게임화된 경험 학습의 실질적인 이점을 강조했습니다. 이 글에서는 AI 교육 프로그램에 적용할 수 있는 통찰도 공유합니다.

이 게시물은 Bedrock Messages API 형식을 네이티브로 지원하지 않는 SageMaker에 호스팅된 LLMs를 사용할 때 Strands 에이전트를 위한 사용자 정의 모델 파서를 구축하는 방법을 보여줍니다. 우리는 awslabs/ml-container-creator를 사용하여 SageMaker에 SGLang과 함께 Llama 3.1을 배포하고, 그런 다음 Strands 에이전트와 통합하기 위한 사용자 정의 파서를 구현하는 과정을 안내합니다.

이 포스트는 Amazon Bedrock, LangGraph 및 Amazon SageMaker AI에서 관리되는 MLflow를 사용하여 지능적인 대화형 에이전트를 구축하는 방법에 대해 탐구합니다.

이 게시물에서는 Amazon SageMaker 학습 작업에서 veRL과 Ray를 사용하여 경쟁 프로그래밍을 위한 특수화된 70억 개 파라미터 모델인 CodeFu-7B를 훈련하는 방법을 보여줍니다. 이를 통해 데이터 준비, 분산 훈련 설정 및 종합적인 관측성을 다루며, 이 통합된 방법이 복잡한 강화 학습 훈련 작업에 대해 계산 규모와 개발자 경험을 모두 제공하는 방법을 소개합니다.

손라이는 생명과학 AI 기업으로, 아마존과 협력하여 아마존 세이지메이커 AI를 활용한 견고한 MLOps 프레임워크를 구축하여 규제 환경에서 필요한 추적성과 재현성을 유지하면서 이러한 도전 과제를 해결하는 방법을 살펴봅니다.

2025년, Amazon SageMaker AI는 핵심 인프라 제공에서 용량, 가격 성능, 관측성, 사용성 등 네 가지 차원에서 혁신적인 개선을 이루었다. 이번 시리즈에서는 이러한 다양한 개선 사항과 이점에 대해 논의된다. 첫 번째 파트에서는 유연한 트레이닝 계획의 출시로 용량 개선을 논의한다. 또한 추론 워크로드의 가격 성능 개선에 대해 설명한다.

2025년, Amazon SageMaker AI는 여러 개선 사항을 도입하여 생성적 AI 워크로드의 교육, 조정 및 호스팅을 지원했습니다. 이 글에서는 관측성, 모델 맞춤 및 모델 호스팅을 개선한 내용을 다루고 있습니다. 이러한 개선으로 SageMaker AI에서 새로운 고객 사용 사례를 지원할 수 있었습니다.

NVIDIA Nemotron 3 Nano 30B 모델이 Amazon SageMaker JumpStart 모델 카탈로그에서 일반적으로 사용 가능해졌습니다. 복잡한 모델 배포를 관리하지 않고 AWS 상에서 Nemotron 3 Nano로 혁신을 가속화하고 실질적인 비즈니스 가치를 전달할 수 있습니다. SageMaker JumpStart가 제공하는 관리형 배포 기능을 사용하여 Nemotron 능력을 활용해 생성적 AI 애플리케이션을 구동할 수 있습니다.

기업 LLM fine-tuning을 효율적이고 확장 가능한 솔루션으로 변화시키는 방법을 소개하며, 도메인 특화 응용 프로그램에서 더 나은 모델 성능을 달성하기 위한 것.

아마존에서의 세밀 조정 기술을 통해 위험한 약물 오류가 33% 감소하고, 인간 노력이 80% 감소하며, 콘텐츠 품질 평가가 77%에서 96%까지 향상되는 방법에 대해 소개하고 있습니다. 이를 위해 지도 세밀 조정(SFT), PPO, DPO, GRPO, DAPO, GSPO 등의 기술을 상세히 설명하고 있습니다.

새로운 서버리스 모델 맞춤화 기능, 탄력적 학습, 체크포인트 없는 학습, 서버리스 MLflow가 결합되어 AI 개발 기간을 몇 달에서 몇 일로 단축시키는 방법을 탐구합니다.

Omada Health는 가상 건강 관리 분야의 혁신업체로, AWS를 기반으로 한 AI 에이전트인 OmadaSpark를 특징으로 하는 새로운 영양 경험을 선보였다. 이는 강력한 임상 입력으로 훈련된 AI 에이전트로 실시간 동기 부여 면접과 영양 교육을 제공한다.

본문에서는 양자화 모델이 Amazon SageMaker AI에 어떻게 원활하게 배포되는지 살펴봅니다. 양자화는 추론 비용을 낮추고 자원이 제한된 하드웨어에 배포를 지원하며, 현대 LLM의 금융 및 환경적 영향을 줄이면서 대부분의 성능을 유지하는 방법을 탐구합니다. PTQ의 원리에 대해 심층적으로 살펴보고 선택한 모델을 양자화하고 Amazon SageMaker에 배포하는 방법을 시연합니다.

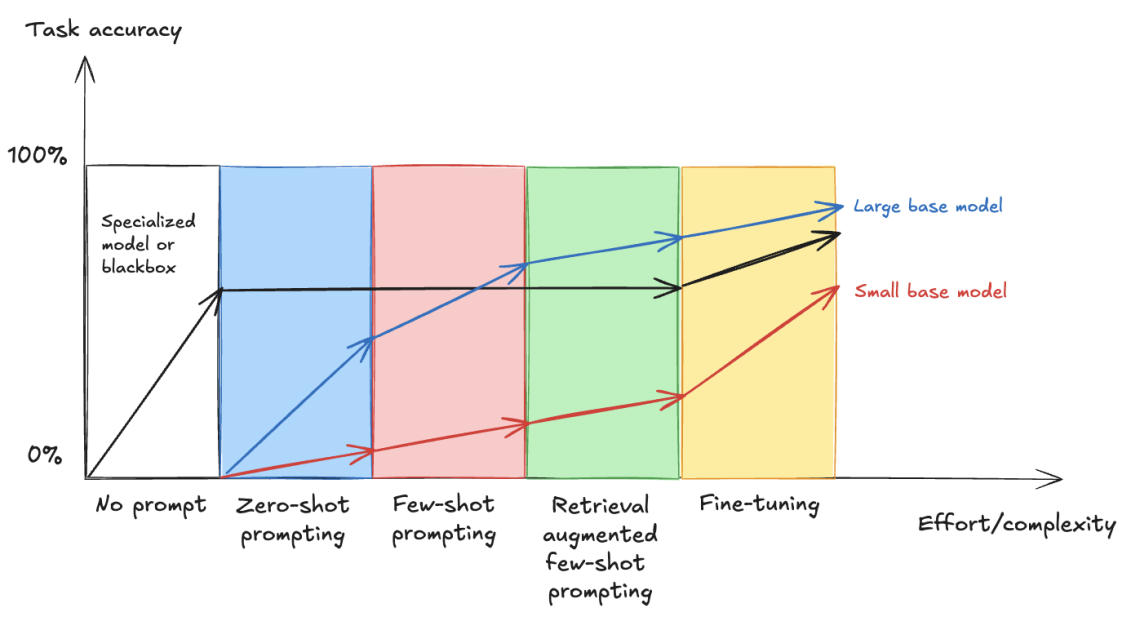

AWS와 Instituto de Ciência e Tecnologia Itaú (ICTi) 간의 전략적 과학적 파트너십을 통해 개발된 이 게시물은 텍스트와 오디오에 대한 감성 분석의 기술적 측면을 탐구합니다. 여러 ML 모델 및 서비스를 비교하고 각 접근 방법의 트레이드오프와 함정을 논의하며 AWS 서비스가 어떻게 조합되어 견고하고 완결된 솔루션을 구축할 수 있는지 강조합니다. 또한 대형 언어 모델 (LLM)을 위한 더 고급화된 프롬프트 엔지니어링과 텍스트 데이터만으로는 놓칠 수 있는 감정적 단서를 포착하기 위해 오디오 기반 분석 범위를 확대하는 가능한 미래 방향에 대한 통찰을 제공합니다.

Observe.ai는 SageMaker와 통합되는 OLAF를 개발하여 ML 서비스의 병목 현상과 성능 문제를 식별하고, 정적 및 동적 데이터 로드에서 지연 시간 및 처리량 측정을 제공합니다. 이 블로그 포스트에서는 OLAF 유틸리티를 사용하여 SageMaker 엔드포인트를 테스트하고 유효성을 검사하는 방법에 대해 알아볼 수 있습니다.

Qbtech는 Amazon SageMaker AI와 AWS Glue를 활용하여 머신러닝 워크플로우를 최적화했고, 특징 공학 시간을 주간에서 몇 시간으로 단축하면서도 의료 공급자가 요구하는 높은 임상 기준을 유지했다.

이 포스트에서는 vLLM과 Bring Your Own Container (BYOC) 접근 방식을 사용하여 Amazon SageMaker AI 엔드포인트에 Voxtral 모델을 호스팅하는 방법을 보여줍니다. vLLM은 대규모 언어 모델(LLM)을 제공하는 고성능 라이브러리로, 향상된 메모리 관리를 위한 페이지드 어텐션과 여러 GPU에 걸쳐 모델을 분산하는 텐서 병렬성을 특징으로 합니다.

이 포스트에서는 조직이 모델 개발 및 배포 수명주기를 추적하고 관리하는 데 도움이 되는 새로운 기능과 핵심 개념을 탐구합니다. 데이터셋 업로드 및 버전 관리부터 모델 세밀 조정, 평가 및 원활한 엔드포인트 배포까지 자동 종단간 계보를 갖춘 모델을 훈련하는 방법을 안내합니다.

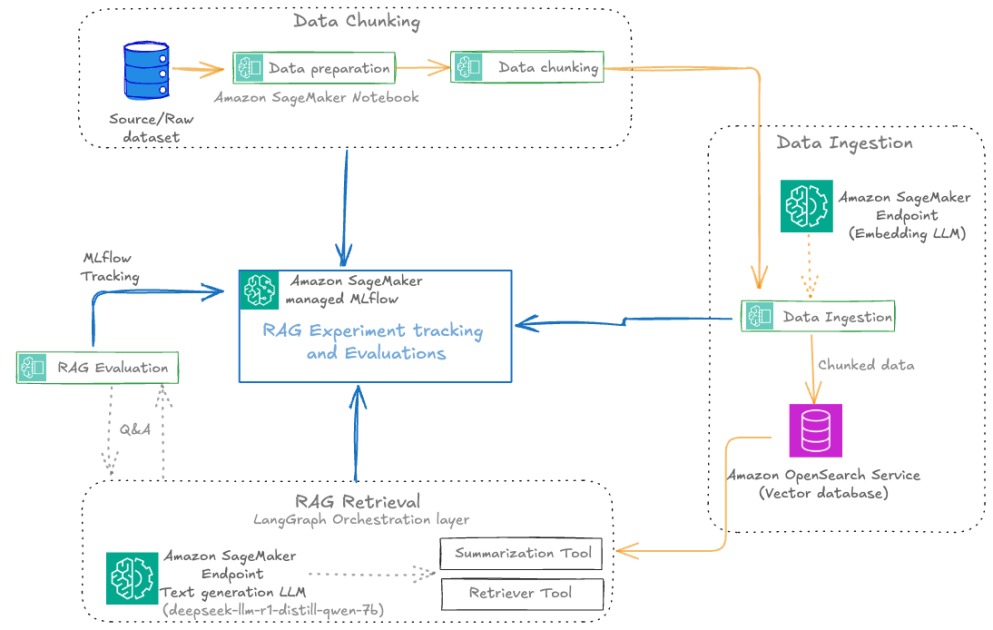

이 포스트에서는 Amazon SageMaker에서 MLflow를 관리하여 이러한 실험을 기록하고 진행 상황을 모니터링하는 통합 시스템을 제공하는 방법을 보여줍니다.

타타 파워 CoE와 Oneture Technologies가 AWS 서비스를 활용하여 검사 프로세스를 자동화하는 방법을 탐구합니다.

Harmonic Security가 Amazon SageMaker AI, Amazon Bedrock 및 Amazon Nova Pro를 활용하여 ModernBERT 모델을 세밀하게 조정하여 저지연, 정확하고 확장 가능한 데이터 누출 감지를 달성하는 방법에 대한 내용입니다.

Amazon SageMaker AI with MLflow가 새로운 서버리스 기능을 도입했다. 이로써 AI 및 머신러닝 작업을 위한 인프라 프로비저닝, 확장 및 운영을 동적으로 관리할 수 있게 되었다. 이번 포스팅에서는 이러한 새로운 기능이 SageMaker AI with MLflow를 통해 개선된 성능, 자동화, 보안을 제공하며 대규모 MLflow 워크로드를 실행하는 방법을 탐구한다.

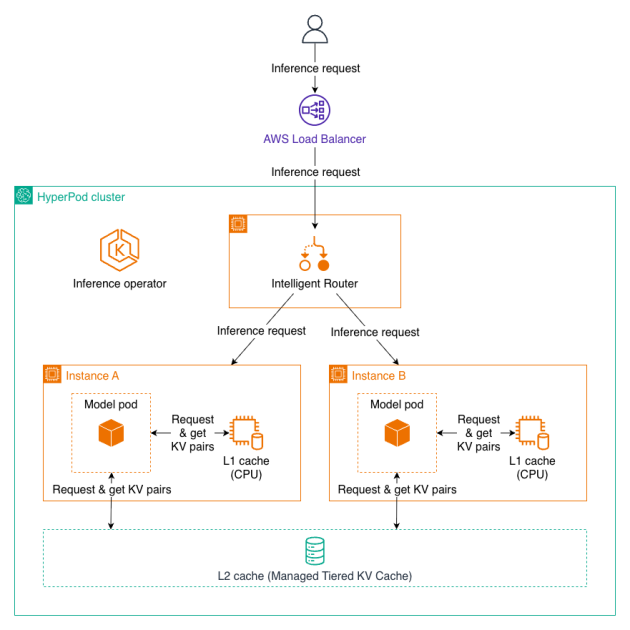

Amazon SageMaker HyperPod를 위한 관리형 Tiered KV 캐시 및 지능적 라우팅 기능 소개. 이 기능은 장문 프롬프트 및 다중 대화에서 최대 40%의 첫 토큰 시간 감소와 최대 25%의 컴퓨팅 비용 절감을 제공한다. 이 기능은 분산된 KV 캐싱 인프라와 지능적인 요청 라우팅을 자동으로 관리하여 엔터프라이즈급 성능으로 제품 규모의 LLM 추론 워크로드를 배포하는 것을 쉽게 하며 운영 오버헤드를 크게 줄인다.

Condé Nast가 Amazon Bedrock과 Anthropic의 Claude를 활용하여 계약 처리와 권리 분석 업무를 가속화하는 방법을 탐구한다. 다수의 브랜드와 지역을 아우르는 회사의 포트폴리오는 점점 복잡해지는 계약, 권리, 라이선싱 계약을 관리해야 했다.

UCLA의 OARC 및 REMAP 팀이 AWS의 서버리스 인프라, 관리형 서비스 및 생성 AI 서비스를 활용하여 솔루션을 신속하게 설계하고 배포하는 방법을 설명하며, Amazon SageMaker AI의 사용법과 몰입형 실시간 경험에서 안정적으로 활용하는 방법을 소개합니다.

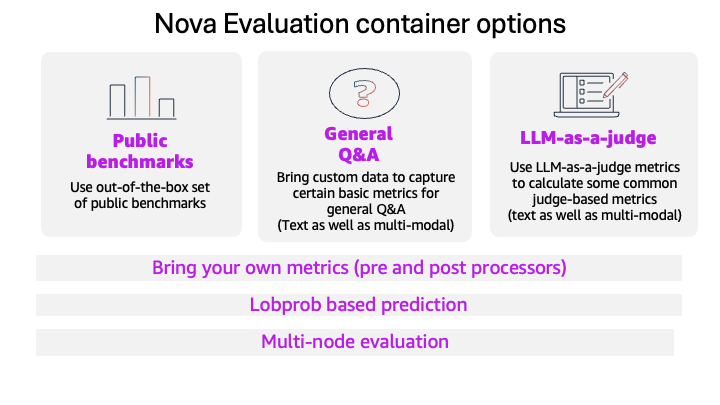

아마존 세이지메이커 AI의 새로운 아마존 노바 모델 평가 기능을 소개하는 블로그 포스트입니다. 이 업데이트는 사용자 정의 메트릭 지원, LLM 기반 선호도 테스트, 로그 확률 캡처, 메타데이터 분석, 대규모 평가를 위한 다중 노드 스케일링을 추가했습니다.

Amazon SageMaker AI 추론에 양방향 스트리밍을 도입했는데, 이는 추론을 단방향 교환이 아닌 지속적인 대화로 변환시킵니다. 본문에서는 SageMaker AI 엔드포인트에 양방향 스트리밍 기능을 갖춘 컨테이너를 구축하고 배포하는 방법을 안내하며, Deepgram의 미리 구축된 모델과 컨테이너를 사용해 실시간 추론을 위한 양방향 스트리밍 기능을 활성화하는 방법을 보여줍니다.

Spectrum을 사용하여 리소스 사용을 최적화하고 학습 시간을 단축하는 방법을 배우고, Amazon SageMaker AI 학습 작업에서 Spectrum Featuning을 구현하는 방법을 알아봅니다. 또한 QLoRA와 Spectrum Featuning 사이의 트레이드오프에 대해 논의하며, QLoRA가 리소스를 더 효율적으로 사용하는 반면 Spectrum은 전반적으로 더 높은 성능을 제공한다고 보여줍니다.

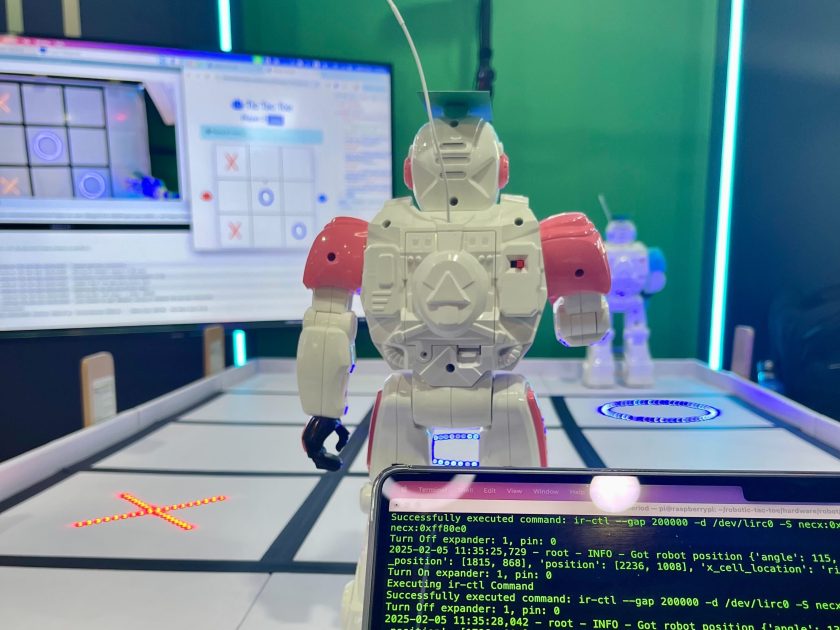

RoboTic-Tac-Toe는 두 대의 로봇이 틱택토 보드를 움직이는 대화형 게임으로, LLMs가 게임 플레이와 로봇 움직임을 조율합니다. 자연어 명령을 사용해 로봇을 제어하고, 플레이어는 자신의 표시를 게임 보드에 놓을 수 있습니다. 이 게시물에서는 틱택토 게임을 이해하고 현재 플레이어를 위한 최적의 게임 전략과 움직임 계획을 결정하기 위해 사용된 구조와 프롬프트 엔지니어링 기술을 탐구합니다.

Amazon SageMaker HyperPod에 두 가지 주요 기능이 도입되어 대규모 머신 러닝 인프라의 보안 및 저장 기능이 강화되었습니다. 새로운 기능으로는 기업이 제어하는 암호화 키를 사용하여 EBS 볼륨을 암호화하는 고객 관리 키(CMK) 지원 및 AI 워크로드에서 Kubernetes 볼륨에 대한 동적 저장소 관리를 지원하는 Amazon EBS CSI 드라이버 통합이 포함됩니다.

VLMs를 세밀하게 조정하면 문서 이해 능력을 자동화하고 크게 향상시킬 수 있다. Focused fine-tuning을 사용하면 작은 다중 모달 모델이 훨씬 큰 모델과 효과적으로 경쟁할 수 있음을 보여준다 (Qwen2.5 VL 3B로 98% 정확도).

클라리오는 아마존 베드락과 기타 AWS 서비스를 활용하여 AI 솔루션을 구축하여 COA 인터뷰의 분석을 자동화하고 개선하는 방법을 소개합니다.

Amazon Search는 AWS Batch를 활용하여 GPU 인스턴스 활용을 최적화하여 SageMaker 학습 작업을 두 배로 늘렸습니다. P5, P4 등 GPU 가속 인스턴스 패밀리에서 기계 학습(ML) 학습 워크로드를 조정하는 관리 솔루션을 소개하며, 사용 사례 구현의 단계별 안내도 제공할 예정입니다.

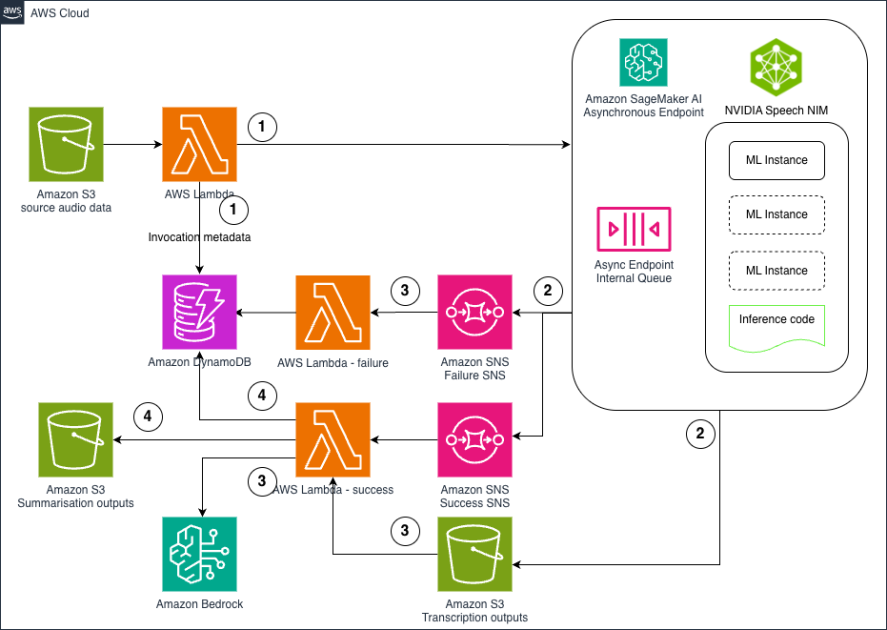

이 포스트에서는 Amazon SageMaker AI에 NVIDIA의 Parakeet ASR 모델을 배포하는 방법을 탐구하며 비동기 추론 엔드포인트를 사용하여 대량의 오디오 데이터를 처리하는 확장 가능하고 비용 효율적인 파이프라인을 만드는 방법을 살펴봅니다. 이 솔루션은 최신 음성 인식 능력과 Lambda, S3, Bedrock 같은 AWS 관리형 서비스를 결합하여 오디오 파일을 자동으로 변환하고 지능적인 요약을 생성하여 기업이 고객 통화, 회의 녹음 및 기타 오디오 콘텐츠에서 가치 있는 통찰력을 대규모로 끌어낼 수 있습니다.

이 포스트는 Almond 커널을 SageMaker Studio에 통합하는 포괄적인 가이드를 제공하며, 플랫폼 내에서 Scala 개발에 대한 솔루션을 제공합니다.

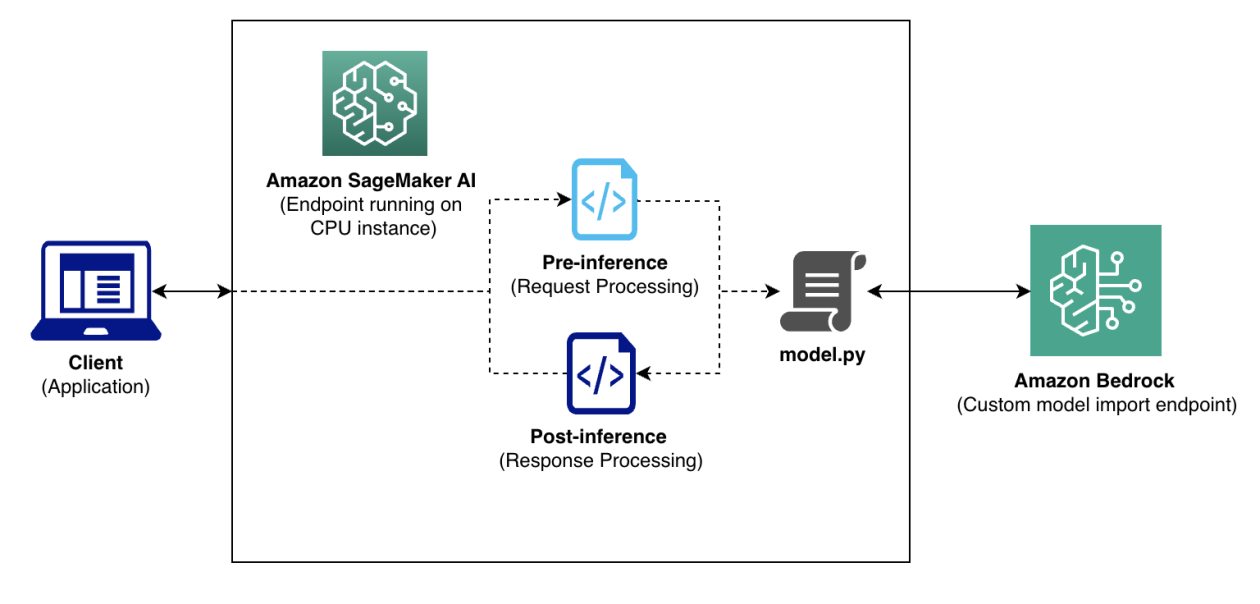

Salesforce가 아마존 베드락 커스텀 모델 임포트를 기계 학습 운영(MLOps) 워크플로에 통합하고, 기존 엔드포인트를 애플리케이션 변경 없이 재사용하며 확장성을 벤치마킹하는 방법을 소개합니다. 운영 효율성과 비용 최적화 향상에 대한 주요 지표를 공유하고 배포 전략을 간소화하는 실용적인 통찰을 제공합니다.

글에서는 gpt-oss-20b 모델을 SageMaker 관리형 엔드포인트에 배포하는 방법을 보여주고 LangGraph를 사용한 주식 분석 에이전트 어시스턴트 예시를 소개합니다.

이 글에서는 Amazon SageMaker AI를 사용하여 RAG 개발 생명주기를 실험부터 자동화까지 한 과정으로 간소화하는 방법을 안내하며, 팀이 효율적으로 실험하고 효과적으로 협업하여 지속적인 개선을 이끌어내는 데 도움이 됩니다.

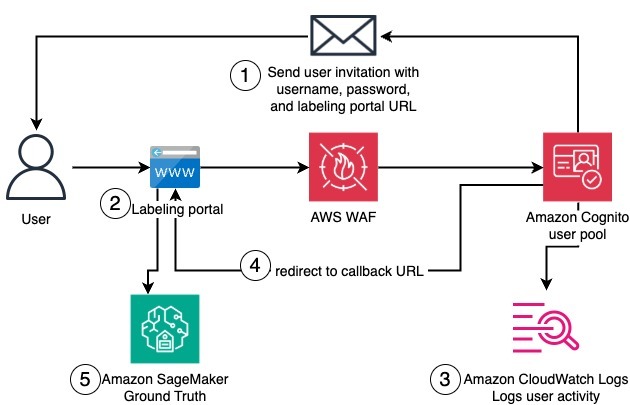

이 글에서는 AWS CDK를 사용하여 Amazon SageMaker AI에서 프로그래밍 방식으로 프라이빗 워크포스를 생성하는 완벽한 솔루션을 제시하며, 전용 및 완전히 구성된 Amazon Cognito 사용자 풀 설정을 포함하고 있습니다.

기업의 운영과 혁신을 변화시키는 생성 AI로 인해 AI 모델의 교육 및 배포를 위한 인프라 수요가 급증하고 있다. 전통적인 인프라 방식은 현대 AI 워크로드의 계산 요구, 네트워크 요구, 내구성 요구와 맞춰가기 어렵다. AWS는 기술 분야에서 변화를 경험하고 있으며 AI 인프라 도전 과제에 대응하고 있다.

이 블로그 포스트에서는 Amazon Bedrock를 통해 제공되는 Amazon Nova 모델을 사용하여 KIE 솔루션을 구축하고 평가하는 종단간 접근 방식을 시연합니다. 데이터 준비, 솔루션 개발, 성능 측정이라는 세 가지 핵심 단계를 포함하며, FATURA 데이터 세트를 사용하여 포괄적인 방법을 설명합니다.

SageMaker HyperPod의 세 가지 기능 소개. Continuous provisioning으로 유연한 리소스 프로비저닝 제공해 모델 학습 및 배포를 빠르게 시작하고 클러스터를 효율적으로 관리. Custom AMIs로 ML 환경을 조직의 보안 표준과 소프트웨어 요구 사항에 맞게 조정 가능.

AWS Summit에서 Amazon Nova foundation 모델을 위한 포괄적인 모델 사용자 정의 기능 세트를 소개했습니다. Amazon SageMaker AI에서 사용할 수 있는 준비된 레시피로, Nova Micro, Nova Lite 및 Nova Pro를 모델 훈련 수명주기 전반에 걸쳐 적응하는 데 사용할 수 있습니다. 이 게시물에서는 SageMaker 훈련 작업에서 Nova Micro를 사용자 정의하는 간소화된 방법을 소개합니다.

기업들이 DeepSeek R1과 같은 대규모 언어 모델을 도입하여 비즈니스 프로세스를 변형하고 고객 경험을 향상시키며 이전에 없던 속도로 혁신을 주도하고 있다. 그러나 독립형 LLM은 환각, 오래된 지식 및 독점 데이터 접근 불가와 같은 주요 제한 사항이 있습니다. RAG는 의미 검색과 생성적 AI를 결합하여 이러한 갭을 해결합니다.

Rapid7은 CVSS 벡터를 예측하는 ML 모델의 교육, 유효성 검사 및 배포를 자동화하여 고객이 위험을 정확히 이해하고 복구 조치를 우선 순위로 정할 수 있도록 지원하고 있다.

AWS에서 ML 모델을 세밀하게 튜닝할 때 특정한 필요에 맞는 적절한 도구를 선택할 수 있다. AWS는 데이터 과학자, ML 엔지니어, 비즈니스 사용자들이 ML 목표를 달성할 수 있도록 포괄적인 도구 모음을 제공한다. SageMaker 훈련 작업부터 HyperPod까지 다양한 ML 심도를 지원하는 솔루션을 구축했다. 현재 필요에 맞는 것부터 시작하여 접근 방식을 발전시켜가는 것을 권장한다.

ABAC 패턴을 중점으로 한 권한 관리 전략을 통해 세밀한 사용자 액세스 제어를 가능하게 하고 AWS IAM 역할의 증식을 최소화하는 방법에 대해 논의합니다. ML 워크플로우에서 운영 효율성을 희생하지 않으면서 조직이 보안과 규정 준수를 유지하는 데 도움이 되는 검증된 최선의 방법을 공유합니다.

Amazon SageMaker AI의 새로운 혁신 기능을 소개하며, SageMaker HyperPod의 새로운 관측 기능, HyperPod에 JumpStart 모델 배포 기능, 로컬 개발 환경에서 SageMaker AI로의 원격 연결, 완전히 관리되는 MLflow 3.0 등이 포함됩니다.

Amazon SageMaker가 MLflow 3.0을 완전 관리형으로 지원하여 AI 실험을 간소화하고 아이디어부터 제품 생산까지 생성 모델 AI 개발을 가속화하는 방법을 탐색합니다.

이 블로그에서는 NASA와 Blue Origin의 달 강하 근접, 하강 및 착륙 센서 (BODDL-TP) 데모에서 우주선 위치, 속도 및 쿼터니언 방향 데이터에서 이상을 감지하는 데 SageMaker AI를 사용하는 방법을 보여줍니다.

본문에서는 AWS Graviton 인스턴스와 호환되도록 미리 구축된 컨테이너를 확장하여 SageMaker AI에 소형 언어 모델을 배포하는 방법을 소개합니다. 솔루션의 개요와 구현 단계에 대한 자세한 설명을 제공하며, GitHub 저장소에서 예제 노트북을 찾을 수 있습니다.

Impel이 Amazon SageMaker에서 세바지 메이커를 사용하여 자동차 딜러쉽 고객 경험을 향상시키는 방법을 소개합니다.

이 포스트에서는 비즈니스 요구에 맞게 Foundation 모델을 맞춤화하는 세 가지 강력한 기술인 RAG, 세밀 조정, 그리고 두 가지 방법을 결합한 하이브리드 접근 방법을 구현하고 평가하는 방법을 안내합니다. 이러한 접근 방법들을 실험하고 특정 사용 사례와 데이터셋을 기반으로 현명한 결정을 내리는 데 도움이 되도록 준비된 코드를 제공합니다.

SageMaker AI와 SiMa.ai Palette 소프트웨어 스위트를 사용하여 모델을 재학습하고 양자화하는 방법을 소개하며, 시야 및 보호 장비 감지가 규정 및 안전을 위해 중요한 환경에서 개인을 정확하게 감지하는 것을 목표로 합니다.