AWS는 최근 대규모 모델 추론(LMI) 컨테이너에 중요한 업데이트를 발표했다. 이 업데이트는 AWS에서 LLM을 호스팅하는 고객들을 위해 포괄적인 성능 향상, 확장된 모델 지원 및 간소화된 배포 기능을 제공한다. 이번 업데이트는 인기 있는 모델 아키텍처 전반에 걸쳐 운영 복잡성을 줄이고 측정 가능한 성능 향상을 제공하는 데 초점을 맞췄다.

AWS는 최근 대규모 모델 추론(LMI) 컨테이너에 중요한 업데이트를 발표했다. 이 업데이트는 AWS에서 LLM을 호스팅하는 고객들을 위해 포괄적인 성능 향상, 확장된 모델 지원 및 간소화된 배포 기능을 제공한다. 이번 업데이트는 인기 있는 모델 아키텍처 전반에 걸쳐 운영 복잡성을 줄이고 측정 가능한 성능 향상을 제공하는 데 초점을 맞췄다.

Dottxt의 아웃라인 프레임워크를 활용하여 AWS Marketplace를 통해 Amazon SageMaker에서 구조화된 출력을 구현하는 방법을 탐구합니다.

Hexagon은 Amazon Web Services와 협력하여 Amazon SageMaker HyperPod의 모델 훈련 인프라를 사용하여 최첨단 세그멘테이션 모델의 사전 훈련을 통해 AI 모델 생산을 확장했다.

이 글에서는 Amazon Nova 루브릭 기반 판사 기능을 탐구하며, 루브릭 기반 판사가 무엇인지, 판사가 어떻게 훈련되는지, 고려해야 할 지표 및 판사를 보정하는 방법에 대해 다룹니다. Amazon Nova 루브릭 기반 LLM-판사 방법론의 노트북 코드를 공유하여 SageMaker 훈련 작업을 사용하여 두 가지 다른 LLM의 출력물을 평가하고 비교합니다.

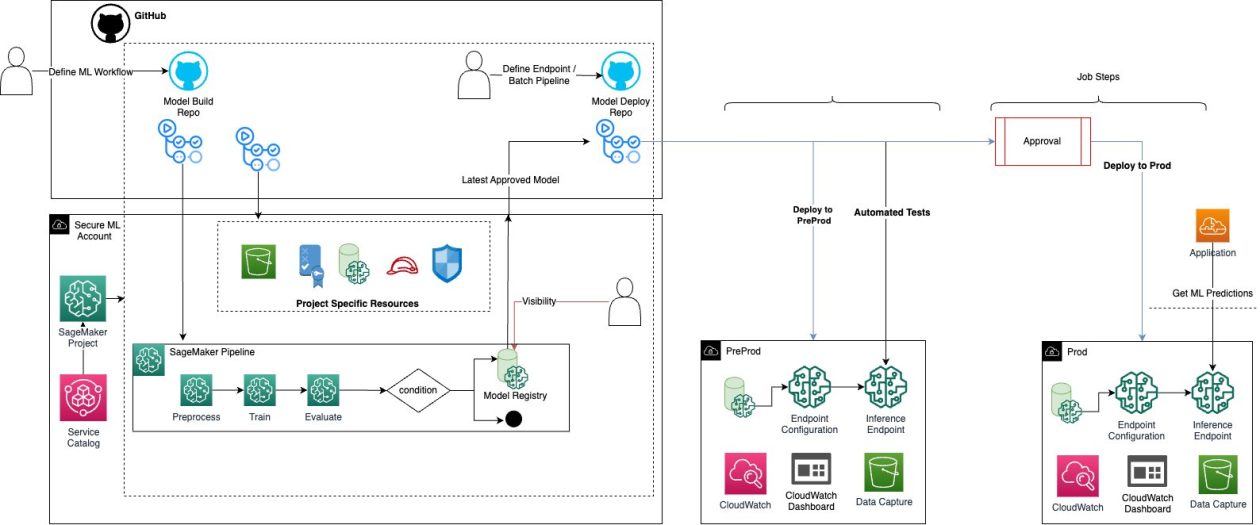

Amazon S3 기반 템플릿을 활용하여 ModelOps 워크플로우를 간소화하는 방법과, Service Catalog 접근 방식과 비교한 주요 이점을 살펴보며, GitHub 및 GitHub Actions과 통합된 사용자 정의 ModelOps 솔루션을 생성하는 방법을 시연하여 팀이 완전히 기능하는 ML 환경을 원 클릭으로 프로비저닝하는 방법을 보여줍니다.

Observe.ai는 SageMaker와 통합되는 OLAF를 개발하여 ML 서비스의 병목 현상과 성능 문제를 식별하고, 정적 및 동적 데이터 로드에서 지연 시간 및 처리량 측정을 제공합니다. 이 블로그 포스트에서는 OLAF 유틸리티를 사용하여 SageMaker 엔드포인트를 테스트하고 유효성을 검사하는 방법에 대해 알아볼 수 있습니다.

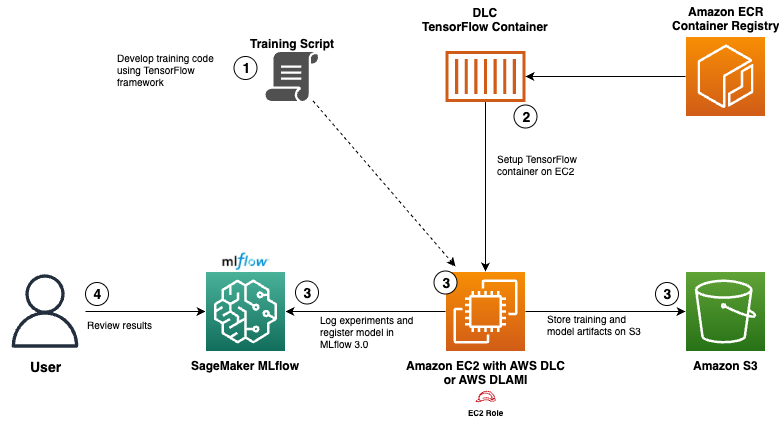

이 게시물은 수요에 따라 자동으로 리소스를 확장하고 서버 패치 및 저장소 관리 작업을 제거하는 SageMaker AI의 MLflow 앱으로 자체 관리형 MLflow 추적 서버를 이전하는 방법을 보여줍니다. MLflow Export Import 도구를 사용하여 실험, 실행, 모델 및 기타 MLflow 리소스를 전송하는 방법을 배우고 마이그레이션의 성공을 검증하는 지침을 제공합니다.

Amazon SageMaker AI에서 BentoML의 LLM-Optimizer를 사용하여 대형 언어 모델(Large Language Model, LLM) 추론을 최적화하는 방법을 소개하고, 워크로드에 최적화된 서빙 구성을 체계적으로 식별하는 방법을 보여줍니다.

이 글에서는 Amazon Bedrock에서 Foundation Models (FMs)을 활용하여 예측 정비 솔루션을 구현하는 방법과, 아마존의 제조 장비를 사례로 들어 그 활용성을 보여줍니다. 이 솔루션은 유연하며 다른 산업에 맞게 맞춤화할 수 있습니다.

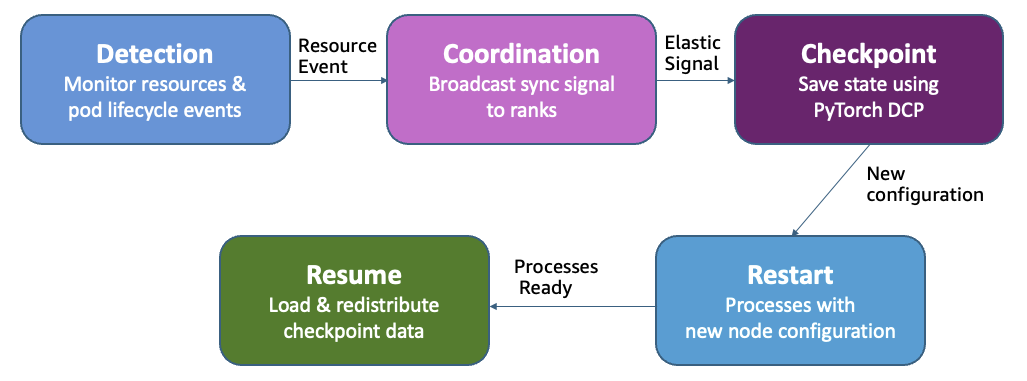

Amazon SageMaker HyperPod는 이제 탄력적 훈련을 지원하여 기계 학습(ML) 워크로드가 자동으로 자원 가용성에 기반해 확장될 수 있게 합니다. 이 글에서는 탄력적 훈련이 GPU 활용률을 극대화하고 비용을 줄이며 모델 개발을 가속화하는 방법을 보여줍니다. 동적 자원 적응을 통해 훈련 품질을 유지하고 수동 개입을 최소화합니다.

이 게시물에서는 Amazon S3 일반 버킷에서 직접 데이터를 읽는 ML 훈련 워크로드의 처리량을 최적화하기 위한 실용적인 기술과 권장 사항을 제시합니다.

Amazon Lookout for Vision에서 Amazon SageMaker AI로 컴퓨터 비전 작업을 이전하고, AWS Marketplace에서 제공되는 사전 훈련된 모델을 사용하여 사용자 정의 하자 검출 모델을 훈련하는 방법을 소개합니다. SageMaker Ground Truth로 데이터셋 라벨링, 유연한 하이퍼파라미터 구성으로 모델 훈련, 실시간 또는 일괄 추론을 위한 배포까지 단계별 안내를 제공하여 자동 품질 검사에 대한 제어와 유연성을 높입니다.

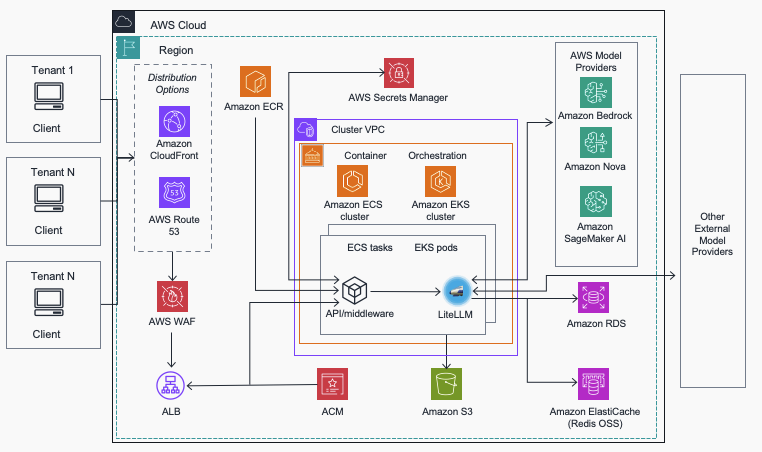

이 게시물에서는 다중 제공업체 생성 AI 게이트웨이 참조 아키텍처를 소개하며, 이를 통해 LiteLLM을 AWS 환경에 배포하여 여러 모델 제공업체 간의 제너레이티브 AI 워크로드의 관리와 거버넌스를 최적화하는 방법에 대한 지침을 제공합니다. 이 중앙 집중식 게이트웨이 솔루션은 Amazon Bedrock, Amazon SageMaker AI 및 외부 제공업체를 지원하면서 포괄적인 보안, 모니터링 및 제어 기능을 유지하며 제공자 단편화, 분산형 거버넌스, 운영 복잡성 및 비용 관리와 같은 일반적인 기업 과제에 대응합니다.

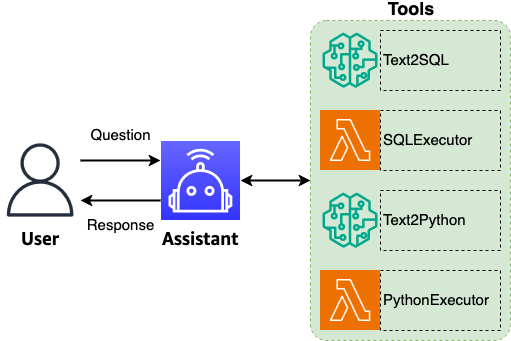

Foursquare Spatial H3 Hub의 지리 데이터와 Amazon SageMaker AI에 배포된 추론 모델을 결합하여, 공간 질문에 대한 복잡한 답변을 몇 분 내에 얻을 수 있는 지리 AI 에이전트를 배포하는 방법을 배웁니다. 이를 통해 비기술적인 도메인 전문가들이 지리 정보 시스템(GIS) 전문 지식이나 사용자 정의 데이터 엔지니어링 파이프라인이 필요하지 않은 자연어 쿼리를 통해 정교한 공간 분석을 수행할 수 있는 에이전트를 구축할 수 있습니다.

Amazon SageMaker HyperPod에 두 가지 주요 기능이 도입되어 대규모 머신 러닝 인프라의 보안 및 저장 기능이 강화되었습니다. 새로운 기능으로는 기업이 제어하는 암호화 키를 사용하여 EBS 볼륨을 암호화하는 고객 관리 키(CMK) 지원 및 AI 워크로드에서 Kubernetes 볼륨에 대한 동적 저장소 관리를 지원하는 Amazon EBS CSI 드라이버 통합이 포함됩니다.

이 포스트는 Almond 커널을 SageMaker Studio에 통합하는 포괄적인 가이드를 제공하며, 플랫폼 내에서 Scala 개발에 대한 솔루션을 제공합니다.

기업은 MLOps 플랫폼을 개발하여 ML use case의 라이프사이클을 지원하고, 보안 제약 조건을 채택한 멀티 계정 설정에 기반한 플랫폼을 구축해야 한다.

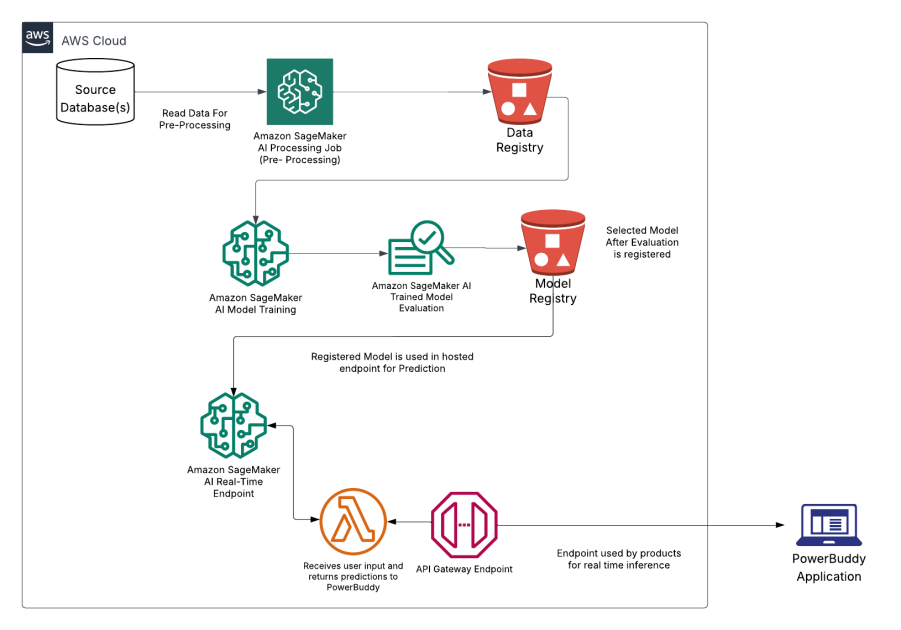

PowerSchool은 Amazon SageMaker AI를 사용하여 정확성을 높이고 잘못된 양성률을 낮춘 사용자 정의 콘텐츠 필터링 솔루션을 구축하고 배포했다. Llama 3.1 8B의 세부 튜닝 기술, 배포 아키텍처, 내부 검증 결과에 대해 설명한다.

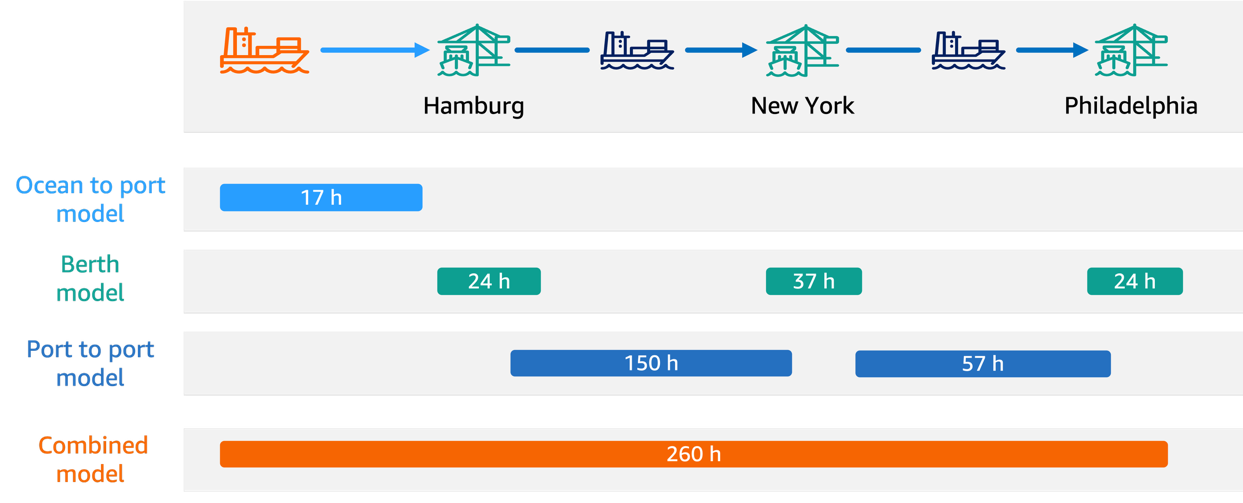

Hapag-Lloyd가 ML을 활용한 선박 도착 및 출발 시간 예측 어시스턴트를 개발하고 산업에서의 주요 성과 지표인 일정 신뢰성을 향상시켰다. Amazon SageMaker AI를 사용하고 견고한 MLOps 실천을 통해 고객에게 품질을 약속하고 있다.

Stability AI의 Alex Gnibus와 함께 작성된 이 게시물에서 Stability AI 이미지 서비스가 Amazon Bedrock에서 이용 가능하며, Amazon Bedrock API를 통해 제공되는 사용 준비가 완료된 미디어 편집 기능을 제공합니다. 이 이미지 편집 도구는 Stability AI의 Stable Diffusion 3.5 모델(SD3.5) 및 Stable Image Core 및 Ultra 모델의 기능을 확장합니다.

Amazon Bedrock는 이제 안정성 AI 이미지 서비스를 제공하는데, 비즈니스가 이미지를 생성하고 수정하는 방법을 개선하는 9가지 도구를 제공한다. 이 기술은 Stable Diffusion 및 Stable Image 모델을 확장하여 이미지 생성 및 편집에 대해 정밀한 제어를 제공한다. 명확한 유도는 AI 시스템에 예술적 방향을 제공하는 데 중요하다. 강력한 유도는 톤과 같은 특정 요소를 제어한다.

AWS Deep Learning Containers를 MLflow와 통합하여 인프라 제어와 강력한 ML 거버넌스를 균형있게 유지하는 솔루션을 생성하는 방법을 보여줍니다. 특화된 요구 사항을 충족시키는 데 팀이 사용할 수 있는 기능적인 설정을 소개하며, ML 라이프사이클 관리에 필요한 시간과 자원을 크게 줄일 수 있습니다.

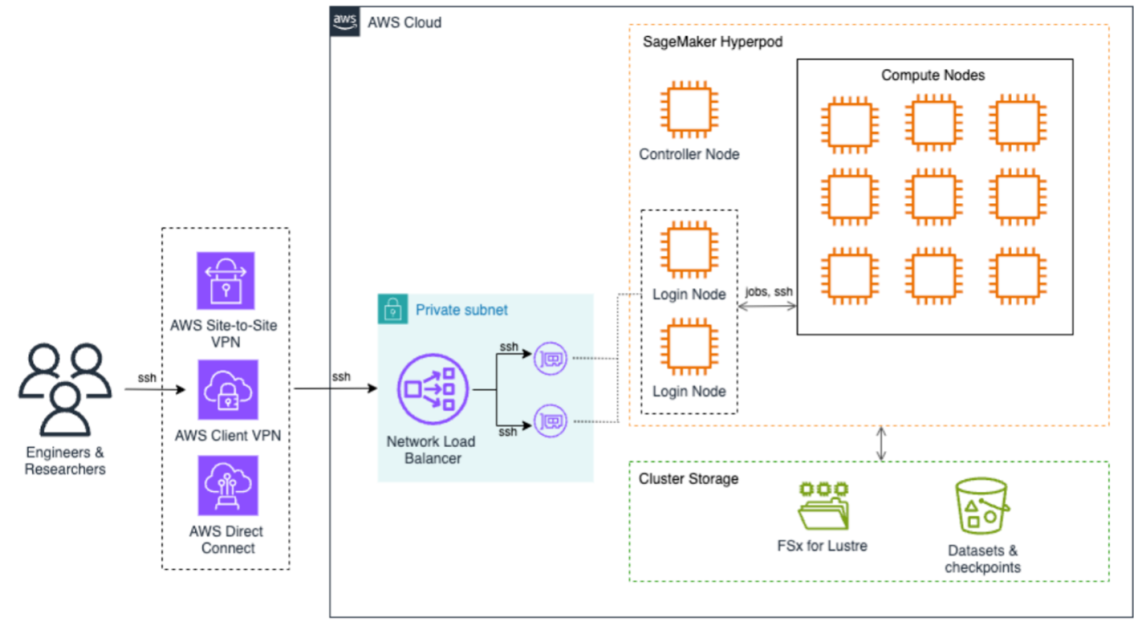

이 블로그 글에서는 연구 대학이 SageMaker HyperPod를 도입하여 동적 SLURM 파티션, 세밀한 GPU 자원 관리, 예산 고려 컴퓨트 비용 추적, 그리고 다중 로그인 노드 부하 균형을 통해 AI 연구를 가속화하는 방법을 소개합니다.

자연어 데이터베이스 분석이 조직이 구조화된 데이터와 상호 작용하는 방식을 혁신할 수 있는 방법을 살펴봅니다. 대형 언어 모델 (LLM) 에이전트의 힘을 통해 복잡한 쿼리를 명확하고 검증 가능한 추론 단계로 분해하고, 오류를 잡아내고 실패를 분석하며 쿼리를 사용자 의도와 스키마 요구 사항과 정확하게 일치하도록 세밀하게 조정함으로써 데이터베이스 분석을 향상시킵니다.

Amazon Health Services가 Amazon.com 검색에서 발견성 문제를 해결하기 위해 AWS SageMaker, Bedrock, EMR 등을 사용하여 머신러닝, 자연어 처리, 벡터 검색 기능을 결합하여 고객들에게 관련 있는 의료 서비스를 제공하는 능력을 향상시켰다.

SageMaker HyperPod의 세 가지 기능 소개. Continuous provisioning으로 유연한 리소스 프로비저닝 제공해 모델 학습 및 배포를 빠르게 시작하고 클러스터를 효율적으로 관리. Custom AMIs로 ML 환경을 조직의 보안 표준과 소프트웨어 요구 사항에 맞게 조정 가능.

새로운 코드 편집기와 다중 공간 지원을 활용하여 SageMaker 통합 스튜디오에서 ML 파이프라인을 개발하는 방법을 안내합니다. 이 샘플 솔루션은 전형적인 ML 활동을 자동화하여 ML 모델을 구축, 훈련, 평가 및 (선택적으로) 배포하는 방법을 보여줍니다.

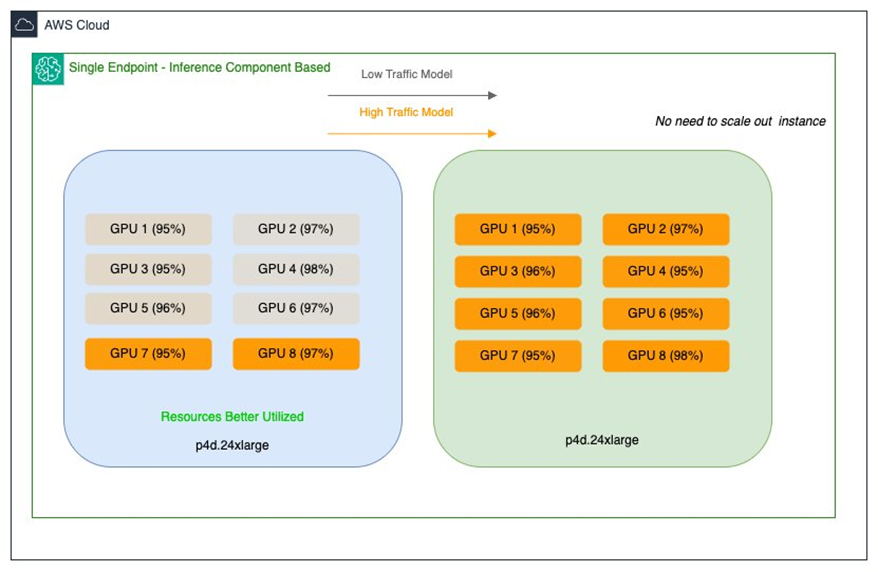

Salesforce AI 플랫폼팀이 Amazon SageMaker AI를 활용하여 GPU 활용률을 최적화하고 리소스 효율성을 향상시키며 비용 절감을 이룬 경험을 공유합니다.

Amazon SageMaker JumpStart에서 OpenAI의 새로운 GPT OSS 모델인 gpt-oss-120b와 gpt-oss-20b을 이용할 수 있다. 이를 통해 AWS에서 OpenAI의 최신 추론 모델을 배포하여 생성적 AI 아이디어를 실험하고 책임 있게 확장할 수 있다. 본문에서는 이러한 모델을 SageMaker JumpStart에서 어떻게 시작하는지에 대해 설명한다.

AWS Batch가 Amazon SageMaker 학습 작업과 완벽하게 통합되었습니다. ML 학습 작업을 효율적으로 관리하고 우선순위를 지정하여 비즈니스에 하드웨어를 효율적으로 활용하는 이점에 대해 설명하고, 이 새로운 기능을 사용하는 방법과 SageMaker 학습 계획 활용을 안내합니다.

대형 언어 모델의 성능평가는 헷갈리거나 BLEU 점수와 같은 통계적 지표를 넘어섭니다. 실제 생성형 AI 시나리오에서 모델이 기준선이나 이전 버전보다 나은 출력물을 생성하는지 이해하는 것이 중요합니다. 특히 요약, 콘텐츠 생성과 같은 응용 분야에서 더욱 중요합니다.

본문에서는 서버리스 데이터 호수 아키텍처를 활용하여 안전한 RAG 애플리케이션을 구축하는 방법을 탐구합니다. Amazon S3, Amazon DynamoDB, AWS Lambda, Amazon Bedrock Knowledge Bases 등 AWS 서비스를 사용하여 비정형 데이터 자산을 지원하고 구조화된 데이터로 확장할 수 있는 종합 솔루션을 만드는 방법을 다룹니다. 기업 데이터에 대한 세밀한 액세스 제어를 구현하고 보안 경계를 준수하는 메타데이터 기반 검색 시스템을 설계하는 방법을 다루며, 이러한 접근법은 조직의 데이터 가치를 극대화하고 견고한 보안 및 규정 준수를 유지하는 데 도움이 됩니다.

ABAC 패턴을 중점으로 한 권한 관리 전략을 통해 세밀한 사용자 액세스 제어를 가능하게 하고 AWS IAM 역할의 증식을 최소화하는 방법에 대해 논의합니다. ML 워크플로우에서 운영 효율성을 희생하지 않으면서 조직이 보안과 규정 준수를 유지하는 데 도움이 되는 검증된 최선의 방법을 공유합니다.

금융 기관이 확장 가능하고 개인정보 보호를 우선시하는 사기 탐지 시스템을 구축하는 데 세이지메이커와 연합 학습이 어떻게 도움이 되는지 탐구한다.

이 포스트는 K8sGPT를 AWS의 Amazon Bedrock에서 K8sGPT CLI 및 K8sGPT Operator 두 가지 모드로 실행하는 최상의 방법을 보여준다. 이 솔루션이 어떻게 SRE들이 지속적인 모니터링과 운영 지능을 통해 Kubernetes 클러스터 관리를 간편화하는 데 도움이 되는지를 보여준다.

바이엘 작물 과학이 대규모 데이터 과학 작업을 관리하고 데이터 분석 요구에 맞게 모델을 훈련하며 개발자 지원을 위해 고품질 코드 문서를 유지함으로써 개발자 입사 시간을 최대 70% 줄이고 개발자 생산성을 최대 30% 향상시키는 방법을 소개합니다.

Qwen 패밀리의 최신 세대인 Qwen3은 Amazon Bedrock Marketplace 및 Amazon SageMaker JumpStart를 통해 사용 가능합니다. 0.6B, 4B, 8B 및 32B 파라미터 크기로 제공되는 Qwen3 모델을 배포하여 AWS에서 생성적 AI 애플리케이션을 구축, 실험 및 책임 있게 확장할 수 있습니다. 이 게시물에서는 Amazon Bedrock Marketplace 및 SageMaker JumpStart에서 Qwen3를 시작하는 방법을 보여줍니다.

SageMaker Unified Studio 및 SageMaker AI를 활용하여 대규모 언어 모델(LLMs)을 맞춤화하는 단계를 안내하며, 데이터 발견부터 SageMaker AI 분산 훈련을 통한 FMs 세밀한 조정, MLflow를 사용한 메트릭 추적, 실시간 추론을 위한 SageMaker AI 추론 모델 배포까지 엔드투엔드 과정을 다룬다. JupyterLab 노트북을 활용할 때 올바른 인스턴스 크기 선택과 디버깅의 최상의 실천법에 대해서도 논의한다.

이 포스트에서는 SageMaker Python SDK를 사용하여 여러 모델을 활용하여 워크플로우를 설정하고 배포하는 방법을 상세히 설명하고 있습니다. 복잡한 추론 워크플로우를 구축하고 SageMaker 엔드포인트에 배포하며 실시간 추론을 수행하는 예시를 살펴봅니다.

이 블로그에서는 NASA와 Blue Origin의 달 강하 근접, 하강 및 착륙 센서 (BODDL-TP) 데모에서 우주선 위치, 속도 및 쿼터니언 방향 데이터에서 이상을 감지하는 데 SageMaker AI를 사용하는 방법을 보여줍니다.

SageMaker AI 고객을 위해 텍스트 랭킹 및 질의응답 UI 템플릿을 소개합니다. SageMaker에서 이러한 템플릿을 설정하여 대규모 언어 모델 훈련을 위한 고품질 데이터셋을 만드는 방법에 대해 안내합니다.

AI 및 기계 학습 기술의 발전으로 디지털 콘텐츠 생성이 혁신을 맞이했고, 비디오 생성 능력의 발전은 기업들에게 전례없는 기회를 제공하고 있다. 이 기술을 사용하면 다양한 산업군에 걸쳐 짧은 비디오 클립을 생성할 수 있다.

SageMaker HyperPod 및 SageMaker Studio를 사용하여 데이터 과학자들의 개발 경험을 향상시키고 가속화하는 방법에 대해 설명합니다. SageMaker Studio의 IDE 및 도구와 Amazon EKS를 통한 SageMaker HyperPod의 확장성 및 내구성을 결합하여 중앙 집중식 시스템의 설정을 단순화합니다. AWS 서비스가 제공하는 거버넌스 및 보안 기능을 활용합니다.

Articul8가 일반적인 LLM을 능가하는 도메인 특화 모델로 기업용 생성적 AI를 재정의하고, Amazon SageMaker HyperPod가 이를 어떻게 가속화했는지 살펴봅니다. Articul8의 반도체 모델은 최고의 오픈 소스 모델 대비 2배 높은 정확도를 달성하며 배포 시간을 4배 단축했습니다.

이 블로그 포스트에서는 자연어 및 이미지 쿼리를 사용하여 시맨틱 비디오 검색을 위해 대형 비전 모델(LVMs)을 활용하는 방법을 소개합니다. 시간 프레임 부드럽게 하는 등의 사용 사례별 메소드를 소개하여 비디오 검색 성능을 향상시킵니다. 또한, Hugging Face Model Hub의 공개 LVMs를 활용하여 비디오, 이미지 및 텍스트 처리를 수행하기 위해 Amazon SageMaker AI에서 비동기 및 실시간 호스팅 옵션을 사용하여 이 접근 방식의 엔드 투 엔드 기능을 설명합니다. 마지막으로 Amazon OpenSearch Serverless를 사용하여 저지연 시맨틱 비디오 검색을 수행합니다.

Radial은 중소 및 대기업 브랜드에게 통합 결제, 사기 탐지 및 옴니채널 솔루션을 제공하는 최대 3PL 충족 공급 업체이다. 이 게시물에서는 Radial이 Amazon SageMaker를 사용하여 머신 러닝 워크플로우를 현대화함으로써 사기 탐지 머신 러닝 응용 프로그램의 비용과 성능을 최적화하는 방법을 소개한다.

본문에서는 AWS Graviton 인스턴스와 호환되도록 미리 구축된 컨테이너를 확장하여 SageMaker AI에 소형 언어 모델을 배포하는 방법을 소개합니다. 솔루션의 개요와 구현 단계에 대한 자세한 설명을 제공하며, GitHub 저장소에서 예제 노트북을 찾을 수 있습니다.

이 글에서는 Terraform을 사용하여 SageMaker 프로젝트의 사용자 정의 템플릿을 정의, 배포, 프로비저닝하는 방법을 소개합니다. 다른 IaC 도구에 의존하지 않고 Terraform Enterprise 인프라 내에서 엄격하게 SageMaker 프로젝트를 활성화할 수 있습니다.

ZURU가 AWS Generative AI Innovation Center와 AWS Professional Services와 협력하여 생성 모델 AI를 활용한 더 정확한 텍스트-바닥 도면 생성기를 구현했다. 이 글에서는 대형 언어 모델 (LLM)을 활용한 해결책이 선택된 이유와 모델 선택, 프롬프트 엔지니어링, 파인튜닝을 통해 결과를 개선하는 방법을 살펴본다.

Gemma 3 27B 모델이 Amazon Bedrock Marketplace와 SageMaker JumpStart를 통해 이용 가능하다. 어떻게 시작하고 강력한 지시 지향 기능을 활용하는지 안내.

Apoidea 그룹은 Amazon SageMaker HyperPod를 활용하여 대형 비전 언어 모델(LVLMs)을 사용하여 은행 및 금융 문서에서 테이블 구조 인식 성능을 더욱 향상시키는 방법을 탐구한다. Qwen2-VL-7B-Instruct 모델을 LLaMA-Factory를 사용하여 세밀하게 조정하는 방법을 소개한다.

Qualtrics가 Amazon SageMaker와 Amazon Bedrock을 활용해 구축한 AI 플랫폼인 소크라테스에 대해 소개합니다. Qualtrics는 이를 통해 고객 솔루션과 생성 모델 AI를 구현하고 있습니다.

DeepSeek-R1 671b 모델을 세밀하게 조정하기 위해 Amazon SageMaker HyperPod 레시피를 사용하는 방법을 소개합니다. SageMaker 훈련 작업과 SageMaker HyperPod를 사용하여 이러한 레시피를 단계별로 구현하는 방법을 보여줍니다.

AWS 서비스와 오픈 소스 도구를 통합하여 조직 내 강력한 레드 팀 매커니즘을 구축하는 방법에 대해 탐구합니다. 구체적으로 Data Reply의 레드 팀 솔루션을 소개하며 AI 안전 및 책임 있는 AI 실천을 강화하는 포괄적인 청사진을 논의합니다.

AWS LLM League의 게임화된 지원이 파트너들의 AI 개발 역량을 향상시키는 방법을 소개하며, 작은 언어 모델의 세밀한 조정이 특정 산업의 필요에 맞는 비용 효율적인 전문 솔루션을 제공하는 방법을 보여줍니다.

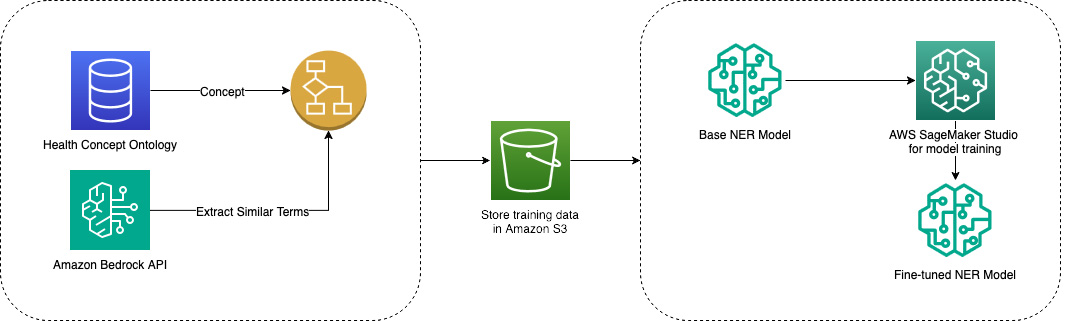

이 글에서는 Amazon SageMaker에서 오픈 소스 NER 및 LLM을 활용하여 AI 기반 문서 처리 플랫폼을 구축하는 방법에 대해 소개합니다.

Amazon SageMaker Large Model Inference (LMI) 컨테이너 v15가 출시되었습니다. vLLM 0.8.4를 기반으로 한 vLLM V1 엔진을 지원하여 성능 향상과 다중 모달리티 모델 호환성을 제공합니다. 이를 통해 대용량 언어 모델을 최고의 성능으로 확장 가능하게 배포하고 제공할 수 있습니다.

Salesforce의 AI 모델 서빙팀은 자연어 처리와 AI 능력을 기업 애플리케이션에 최적화하는 데 중점을 두고 있으며, Amazon SageMaker를 활용하여 모델 배포의 한계를 넓히고 있다.

이 포스트는 비용 효율적이고 고성능 추론을 위해 AWS Inferentia2 인스턴스에 Mixtral 8x7B 언어 모델을 배포하고 제공하는 방법을 보여줍니다. Hugging Face Optimum Neuron을 사용한 모델 컴파일 및 Text Generation Inference (TGI) Container를 통해 LLMs를 배포하고 제공하는 방법을 안내합니다.

Amazon Nova 모델의 소개는 AI 분야에서의 중요한 발전을 나타내며, 대형 언어 모델(LLM) 최적화에 새로운 기회를 제공한다. 본 포스트에서는 Amazon Nova 모델을 기준으로 모델 맞춤화와 RAG를 효과적으로 수행하는 방법을 보여준다. 최신 Amazon Nova 모델을 활용한 모델 맞춤화와 RAG 사이의 포괄적인 비교 연구를 실시하고 이러한 소중한 통찰을 공유한다.