구글 워크스페이스 API를 애플리케이션과 데이터 파이프라인에 통합하는 것은 REST 엔드포인트, 페이지네이션, OAuth 2.0 흐름을 처리하는 보일러플레이트 코드를 작성해야 하는데, 구글 AI 팀이 ‘gws’ CLI 도구를 공개했다. 이 오픈소스 도구는 Google Workspace를 위한 통합된 동적 명령줄 인터페이스를 제공한다.

최신뉴스 전체보기

OpenAI는 심포니를 공개했습니다. 이는 구조화된 ‘실행’을 통해 자율 AI 코딩 에이전트를 관리하기 위한 오픈 소스 프레임워크로, 이 프로젝트는 이슈 트래커를 LLM 기반 에이전트에 연결하여 소프트웨어 개발 작업을 자동화하는 시스템을 제공합니다. 시스템 아키텍처는 Elixir 및 BEAM을 사용합니다.

알리바바의 Qwen 팀이 0.8B ~ 9B 파라미터의 Qwen3.5 Small 모델 시리즈를 출시했다. 이 모델은 ‘더 많은 지능, 적은 연산’에 초점을 맞춰 산업 트렌드에서 벗어나 더 나은 AI 배포를 지향한다.

Meta AI 연구팀이 GCM을 오픈 소스로 공개하여, 고성능 AI 훈련 및 하드웨어 신뢰성을 보장하기 위해 GPU 클러스터 모니터링을 개선하고 있다. AI 모델이 조파라미터로 확장됨에 따라, 이를 훈련하는 데 필요한 클러스터는 행성상에서 가장 복잡하고 취약한 기계 중 하나로 변화하고 있다.

바이트댄스가 Protenix-v1을 출시했다. 이 모델은 AF3 수준의 성능을 생체 분자 구조 예측에서 달성하며 코드와 모델 매개변수를 Apache 2.0 하에 공개했다.

구글이 Conductor를 소개했다. 이는 AI 코드 생성을 구조화된 컨텍스트 중심 워크플로로 변환하는 Gemini CLI용 오픈 소스 미리보기 확장판이다. Conductor는 제품 지식, 기술 결정 및 작업 계획을 저장하고, 이를 레포지토리 내부의 버전 관리된 Markdown으로 관리한 후, Gemini 에이전트를 이러한 파일에서 구동시킨다.

NVIDIA는 NVFP4 형식의 4비트에서 30B 매개변수 추론 모델을 실행하는 Nemotron-Nano-3-30B-A3B-NVFP4를 출시했다. 이 모델은 NVFP4 배포를 위해 특별히 설계된 Quantization Aware Distillation(QAD)과 혼합 Mamba2 Transformer Mixture of Experts 아키텍처를 결합하며 BF16 기준과 정확도를 유지한다.

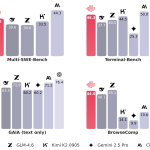

Moonshot AI가 Kimi K2.5를 공개했다. 이 모델은 큰 Mixture of Experts 언어 기반, 네이티브 비전 인코더, 그리고 에이전트 스왐이라는 병렬 멀티 에이전트 시스템을 결합하였다. 이 모델은 코딩, 멀티모달 추론, 그리고 깊은 웹 연구에 초점을 맞추고 있으며 에이전트, 비전, 코딩 분야에서 강력한 성능을 보여준다.

Nous Research는 NousCoder-14B를 소개했는데, 이는 Qwen3-14B에서 강화학습을 통해 후훈련된 경쟁 프로그래밍 모델이다. LiveCodeBench v6 벤치마크에서 Pass@1 정확도가 67.87%로, Qwen3-14B의 7.08% 높았다.

Black Forest Labs가 FLUX.2 [klein]을 출시했다. 이 모델은 대화형 시각 인텔리전스에 초점을 맞춘 소형 이미지 모델로, 텍스트에서 이미지로, 이미지에서 이미지로의 통합 아키텍처와 로컬 GPU부터 클라우드 API까지의 배포 옵션을 제공한다.

구글의 Universal Commerce Protocol (UCP)는 AI 상거래 에이전트가 제품 링크를 보내는 것을 넘어 채팅 내에서 믿을 수 있는 구매를 완료할 수 있는 오픈 표준이다. 이는 AI 에이전트와 상인 시스템이 공유된 언어를 갖게 함으로써 쇼핑 질의가 제품 발견부터 구매까지 이동할 수 있게 한다.

Zlab Princeton 연구진이 대형 언어 모델을 위한 주요 가지치기 알고리즘을 하나로 통합한 LLM-Pruning Collection을 발표했다. 이 프레임워크는 블록 수준, 레이어 수준 및 가중치 수준 가지치기 방법을 일관된 훈련 및 평가 스택에서 GPU 및 CPU에서 비교하기 쉽게 만든다.

텐센트 훈유안 연구원은 HY-MT1.5를 발표했는데, 모바일 기기와 클라우드 시스템을 대상으로 하는 다국어 기계 번역 모델로, 33개 언어 간 상호 번역을 지원하며 GitHub와 Hugging Face에서 이용 가능하다.

Cloudflare가 tokio-quiche를 오픈소스로 공개했다. 이는 Tokio 런타임과 결합된 비동기 QUIC 및 HTTP/3 Rust 라이브러리로, Apple iCloud Private Relay, Oxy 기반 프록시, WARP의 MASQUE 클라이언트 등에서 백만 개 이상의 HTTP/3 요청을 처리하는 데 사용되었다.

알리바바 통이 연구소는 MAI-UI를 발표했다. MCP 도구 사용, 에이전트 사용자 상호작용, 장치-클라우드 협업, 온라인 강화학습을 기반으로 한 MAI-UI는 일반 GUI 기반 및 모바일 GUI 탐색에서 최첨단 결과를 달성했다. Gemini-2.5-Pro, Seed1.8 및 UI-Tars-2를 능가하며 초기 GUI 에이전트가 종종 무시하는 세 가지 특정 간극을 대상으로 한다.

Amazon SageMaker AI에서 BentoML의 LLM-Optimizer를 사용하여 대형 언어 모델(Large Language Model, LLM) 추론을 최적화하는 방법을 소개하고, 워크로드에 최적화된 서빙 구성을 체계적으로 식별하는 방법을 보여줍니다.

InstaDeep의 NTv3는 지역 모티프를 메가베이스 규모의 조절 가능한 시퀀스 생성과 함께 연결하는 모델로, 표현 학습, 기능적 트랙 및 유전체 주석 예측을 통합한다.

구글이 A2UI를 오픈 소스로 공개했다. 이는 에이전트가 풍부한 네이티브 인터페이스를 선언적 JSON 형식으로 설명하고, 클라이언트 애플리케이션이 자체 구성 요소로 렌더링할 수 있는 라이브러리이다. 원격 에이전트가 신뢰 경계를 넘어 안전하고 상호 작용적인 인터페이스를 제공하는 방법에 대한 명확한 문제를 해결한다.

Anthropic이 새로운 오픈 소스 에이전틱 프레임워크 ‘Bloom’을 출시했다. 이 프레임워크는 전방위 인공지능 모델의 자동 행동 평가를 위한 것으로, 연구자가 지정한 행동을 측정하여 현실적인 시나리오에서 얼마나 자주 강도 있게 나타나는지 측정한다. ‘Bloom’의 등장은 안전 및 정렬을 위한 행동 평가가 설계 및 유지에 비용이 많이 드는 문제를 해결한다.

Zhipu AI가 GLM-4.6V 시리즈를 공개했다. 이미지, 비디오, 도구를 주요 입력으로 취급하는 비전 언어 모델로, 텍스트 위에 올려진 후속 조치가 아닌 에이전트를 위한 것이다.

Cisco와 Splunk은 옵저버빌리티 및 보안 메트릭을 위해 디자인된 단변량 제로 샷 시계열 기반 모델인 Cisco Time Series Model을 소개했다. 이 모델은 Apache 2.0 라이선스 하에 Hugging Face에 오픈 웨이트 체크포인트로 출시되었으며 과업별 특정 파인튜닝 없이 예측 워크로드를 대상으로 한다.

StepFun 연구팀이 새 오디오 LLM Step-Audio-R1을 발표했다. 이 모델은 테스트 시간 컴퓨팅 스케일링을 위해 설계되어, 오디오에 대한 실제 소리 기반의 의사 결정에서 장시간 추론을 생성할 때 성능이 저하되는 문제를 해결한다.

NVIDIA 연구진이 ToolOrchestra를 발표했습니다. 이는 각 작업 단계마다 올바른 모델 또는 도구를 선택하는 AI 시스템을 어떻게 학습시킬 수 있는지에 대한 혁신적인 방법입니다.

Black Forest Labs가 FLUX.2를 발표했습니다. FLUX.2는 실제 창의적 워크플로우를 대상으로 하며, 마케팅 자산, 제품 사진, 디자인 레이아웃, 복잡한 인포그래픽 등에 편집 지원을 제공합니다. FLUX.2 제품군과 FLUX.2 [dev]가 소개되었습니다.

마이크로소프트 연구팀이 7조 개의 파라미터를 가진 Fara-7B를 발표했다. 이 모델은 컴퓨터 사용을 위해 특별히 설계된 작은 언어 모델로, 클라우드로 데이터를 보내지 않고도 AI 에이전트가 웹 작업을 처리할 수 있게 해준다.

Meta AI 팀이 Meta Segment Anything Model 3 또는 SAM 3을 공개했다. SAM 3은 간단한 프롬프트를 사용하여 대규모 이미지 및 비디오 컬렉션에서 모든 개념의 인스턴스를 신뢰성 있게 찾고 세분화하고 추적하는 데 사용되는 통합 기본 모델이다.

미니맥스팀이 코딩과 에이전트 워크플로에 최적화된 전문가 모델인 MiniMax-M2를 공개했다. 이 모델은 최대 모델 비용의 일부분으로 오랜 기간 동안 MCP, 쉘, 브라우저, 검색 및 코드 작업을 지원한다.

PokeeResearch-7B는 7B 파라미터 딥 리서치 에이전트로, 쿼리를 분해하고 검색 및 읽기 호출을 실행하며 후보 답변을 확인한 후 여러 리서치 스레드를 최종 응답으로 합성하는 기능을 제공한다. 에이전트는 연구 및 검증 루프를 실행한다.

Qualifire AI가 Rogue를 공개했는데, 이는 AI 에이전트의 성능을 평가하는 파이썬 프레임워크로, 기존 QA 방법론의 한계를 극복하고 개발팀이 믿고 릴리스를 관리할 수 있도록 도와준다.

ServiceNow의 연구팀이 DRBench를 공개했다. 이는 공개 웹과 기업 내부 데이터를 종합적으로 활용해 보고서 작성을 요구하는 기업과제에 대한 “심층 연구” 에이전트를 평가하기 위한 벤치마크 및 실행 환경이다. DRBench는 기업 스타일의 다양한 워크플로우를 구현하여 에이전트가 파일, 이메일, 채팅 로그, 클라우드 저장소를 검색, 필터링 및 속성을 할 수 있도록 한다.

Skala는 Kohn-Sham 밀도 기능 이론(DFT)을 위한 딥러닝 교환-상관 기능으로, 반 하이브리드 수준 정확도를 반 공간 비용에서 달성한다. W4-17에서 MAE는 약 1.06 kcal/mol(단일 참조 하위집합에서 0.85), WTMAD-2는 약 3.89 kcal/mol이다. 주요 분자화학에 적합하며 D3(BJ) 분산 보정을 사용한다.

Anthropic이 Petri를 출시했습니다. 이는 AI 요소들을 활용하여 대상 모델의 행동을 다양한 시나리오에서 테스트하는 오픈소스 프레임워크로, 실제적이고 다중 턴 및 도구 사용 환경에서 경계 LLMs를 감사하는 방법을 자동화합니다.

상하이교통대학교 및 SII Generative AI Research Lab (GAIR)의 연구진은 LIMI (“Less Is More for Agency”)라는 감독 세부 조정 방법을 제안하며, 기본 모델을 78개의 샘플을 사용하여 능숙한 소프트웨어/연구 에이전트로 변환합니다.

Neuphonic이 NeuTTS Air를 공개했는데, 이는 748M 파라미터(큐윈2 아키텍처)를 갖춘 오픈소스 텍스트 음성 변환 모델로, 클라우드 의존성 없이 CPU에서 실시간으로 실행될 수 있다. Apache-2.0 라이선스 하에 제공되며, 러너블 데모와 함께 제공된다.

Zhipu AI가 GLM-4.6을 출시했다. 이 모델은 에이전틱 워크플로, 장기 맥락 추론, 실용적 코딩 작업에 초점을 맞추고 있으며, 입력 창을 20만 토큰으로 확장하고 12만 8천 토큰의 최대 출력을 제공한다. 이번 업데이트는 실용적 작업에서 효율적인 토큰 사용을 목표로 하며 로컬 배포를 위한 오픈 가중치도 함께 제공된다.

AI 애플리케이션에서 성능은 중요하다. 대형 언어 모델(Large Language Models, LLM)을 사용할 때 API 응답이나 I/O 작업을 기다리는 시간이 많이 소요된다. 이때 asyncio가 도움이 된다. 많은 개발자들이 LLM을 사용하면서 asyncio를 사용하고 있다.

구글은 “Chrome DevTools MCP”의 공개 미리보기를 출시했는데, 이는 AI 코딩 에이전트가 실제 Chrome 인스턴스를 제어하고 검사할 수 있는 Model Context Protocol (MCP) 서버로, 성능 추적 기록, DOM 및 CSS 검사, JavaScript 실행, 콘솔 출력 읽기, 사용자 흐름 자동화 등이 가능하다.

알리바바의 큐윈 팀이 새로운 Qwen3-Next-80B-A3B 모델을 위한 FP8-양자화된 체크포인트를 공개했으며, Instruct 및 Thinking 두 가지 후 학습 변형으로 고성능 추론을 위해 설계되었습니다. 이 FP8 레포지토리는 BF16 릴리스를 반영하지만 “미세한 FP8” 가중치와 sglang 및 vLLM 신변 배포 노트가 포장되어 있습니다.

Qwen이 Qwen3-ASR-Toolkit을 출시했습니다. 이는 Qwen3-ASR-Flash API의 3분/10MB 제한을 우회하기 위해 VAD 인식 청킹, 병렬 API 호출, FFmpeg를 통한 자동 재샘플링/포맷 정규화를 수행하여 안정적이고 시간 기준의 전사 파이프라인을 제공합니다. Python ≥3.8이 필요하며, 설치 방법은 공식 사이트에서 확인할 수 있습니다.

AI 에이전트는 단순히 답변을 내뱉는 챗봇이 아닙니다. 실시간으로 협업하며 대시보드를 업데이트하고 API를 호출할 수 있는 복잡한 시스템으로 진화하고 있습니다. 하지만 에이전트가 사용자 인터페이스와 대화하는 방법은 무엇이어야 하는가? 이를 위한 AG-UI 프로토콜이 소개되었습니다.

IBM이 그래나이트 독링 258M을 공개했다. 이는 엔드 투 엔드 문서 변환을 위해 설계된 오픈소스 비전-언어 모델로, 레이아웃-정확한 추출을 목표로 함. 테이블, 코드, 수식, 목록, 캡션 및 읽기 순서를 처리하여 손실이 적은 Markdown이 아닌 구조화된 기계 판독 가능한 표현을 출력함.

바이두 AI 연구팀이 효율성, 장기적 논리 추론, 도구 통합을 중심으로 설계된 새로운 ERNIE-4.5-21B-A3B-Thinking을 발표했다. 이 모델은 21B 총 매개변수를 가지고 있지만 토큰 당 활성 매개변수는 3B뿐으로, 계산 효율성을 유지하면서 경쟁력 있는 논리 능력을 갖추고 있다.

MCP 팀이 MCP 레지스트리의 미리보기 버전을 출시했다. 이는 기업 AI를 실제로 운영 가능하게 만드는 마지막 퍼즐 조각일 수 있다. MCP 레지스트리는 MCP 서버를 발견하기 위한 연합 아키텍처를 소개하여 인터넷이 주소 지정을 해결한 방식을 모방한다.

Resemble AI가 최근 23개 국어로 제로샷 음성 클로닝을 위한 프로덕션 급 오픈 소스 TTS 모델인 Chatterbox Multilingual을 출시했다. MIT 라이선스로 배포되어 통합 및 수정에 자유롭다. 이 모델은 Chatterbox 프레임워크를 기반으로 다국어 기능, 표현 제어, 내장형 기능을 추가했다.

AI2가 공개한 OLMoASR은 OpenAI의 Whisper와 경쟁하는 오픈 ASR 모델 스위트로, 모델 가중치 외에도 훈련 데이터 식별자, 필터링 단계, 훈련 레시피, 벤치마크 스크립트를 공개하여 ASR 분야에서 이례적으로 투명한 움직임을 보이고 있다.

MIT에서 개발된 시스템은 다양한 반응에 대한 현실적인 예측을 제공하면서 실제 세계 물리적 제약 조건을 유지할 수 있습니다.

텐센트의 훈유안팀이 훈유안-MT-7B(번역 모델) 및 훈유안-MT-Chimera-7B(앙상블 모델)을 공개했다. 두 모델은 다국어 기계 번역을 위해 특별히 설계되었으며, WMT2025 General Machine Translation 대회에서 훈유안-MT-7B가 31개 언어 쌍 중 30개에서 1위를 차지했다.

dots.ocr은 다국어 문서 레이아웃 구문 분석과 광학 문자 인식(OCR)을 위해 개발된 오픈 소스 비전-언어 트랜스포머 모델이다. 이 모델은 단일 아키텍처 내에서 레이아웃 감지와 내용 인식을 수행하며 100여 개 언어와 다양한 구조화된 및 비구조화된 문서 유형을 지원한다.

NVIDIA가 유럽어용 Granary라는 최대 규모의 오픈소스 음성 데이터셋과 Canary-1b-v2, Parakeet-tdt-0.6b-v3 두 첨단 모델을 발표했다. 이는 특히 소수 언어에 대한 자동 음성 인식 및 음성 번역 분야에서 액세스 가능하고 고품질의 자원에 새 기준을 제시한다.

LangExtract는 구글 AI의 새로운 오픈 소스 파이썬 라이브러리로, 비구조화된 텍스트 문서에서 의미 있는 정보를 추출하는 것을 목표로 한다. 이 라이브러리는 Gemini와 같은 LLMs를 사용하여 이러한 과제를 직접 해결한다.

NASA가 개발한 오픈 소스 멀티모달 모델 ‘갈릴레오’는 다양한 지구 관측 데이터를 처리, 분석, 이해하는 데 활용되며, 광학, 레이더, 해발, 기후, 보조지도 등을 대규모로 처리하는 데 사용된다. McGill 대학, NASA Harvest Ai2, Carleton 대학, British Columbia 대학, Vector Institute, Arizona 주립 대학 등의 연구진의 지원을 받아 개발되었다.

NVIDIA의 최신 릴리스인 Llama Nemotron Super v1.5은 추론 및 에이전틱 작업에 특히 뛰어난 성능과 사용성을 제공하여 모델이 어디까지 이끌 수 있는지에 대한 경계를 넘는 AI 발전을 이끌고 있다.

ChemXploreML은 고급 화학 예측을 보다 쉽고 빠르게 할 수 있게 해주며, 깊은 프로그래밍 기술을 요구하지 않는다.

Qwen은 새로운 Mixture-of-Experts 아키텍처와 포괄적인 에이전트 코딩 기능을 갖춘 Qwen3-Coder를 발표했다. 이 모델은 오픈 소스 코딩 모델의 새 기준을 제시하며 대규모 자율 개발자 지원의 가능성을 재정의한다.

WrenAI는 Canner가 개발한 오픈 소스 Generative Business Intelligence (GenBI) 에이전트로, 구조화된 데이터와 자연어 상호작용을 가능케 하는 것을 목표로 한다. SQL 작성 없이 데이터 쿼리, 분석, 시각화를 위한 도구를 제공하며, 모든 기능과 통합은 공식 문서와 최신 릴리스에 대해 검증된다.

구글 딥마인드가 최근 발표한 GenAI 프로세서는 가벼운 오픈소스 파이썬 라이브러리로, 실시간 다중 모달 콘텐츠를 포함한 생성 AI 워크플로우의 조율을 간소화하는 데 사용된다. 이 라이브러리는 고급 AI 파이프라인을 구축하기 위한 고청량, 비동기 스트림 프레임워크를 제공한다.

2025년 7월 Moonshot AI가 발표한 Kimi K2는 1조개의 총 매개변수와 토큰당 32억개의 활성 매개변수를 갖춘 MoE 모델로, 1550억 토큰에 대해 훈련되었다. K2는 대규모 모델에서 흔히 볼 수 있는 불안정성 없이 전례 없는 규모에서 안정적인 훈련을 달성했다.

구글은 MCP 툴박스를 발표했는데, 이는 GenAI Toolbox의 일환으로 SQL 데이터베이스를 AI 에이전트에 통합하는 것을 간소화하는 데 목적을 둔 오픈 소스 모듈이다. 이 릴리스는 언어 모델이 외부 시스템과 상호 작용할 수 있게 하는 표준화된 접근 방식인 모델 컨텍스트 프로토콜(MCP)을 발전시키기 위한 구글의 전략의 일환이다.

바이트댄스가 대형 언어 모델(LLM)을 활용한 일반 목적 소프트웨어 엔지니어링 에이전트 ‘Trae Agent’를 공식 출시했다. 복잡한 프로그래밍 작업을 자연어 프롬프트를 통해 실행할 수 있는 Trae Agent는 뛰어난 성능과 확장성을 제공하는 명령줄 인터페이스(CLI)를 제공하여 개발자들이 소프트웨어와 상호 작용하는 방식을 새롭게 정의한다.

Mistral AI가 최신 시리즈인 Magistral을 소개했다. 이는 추론에 최적화된 대형 언어 모델(Large Language Models)로 LLM 능력 발전의 중요한 한 걸음이다. Magistral 시리즈에는 Apache 2.0 라이선스 하에 공개된 24B-파라미터의 Magistral Small과 기업용 Magistral Medium이 포함되어 있다.

Magentic-UI는 복잡한 웹 작업을 처리하고 다단계 계획과 브라우저 사용이 필요한 작업을 사람들과 협력하여 완료하는 오픈 소스 에이전트 프로토타입이다.

AI는 언어 처리, 수학, 코드 생성 분야에서 발전했지만 물리적 환경으로 확장하는 것은 여전히 어렵다. 물리 AI는 동적인 실제 환경에서 지각, 이해, 행동하는 시스템을 개발하여 이 간극을 줄이려고 한다. 텍스트나 기호를 처리하는 기존 AI와 달리 물리 AI는 주로 비디오와 같은 감각적 입력과 상호작용한다.

AWS가 Strands Agents SDK를 오픈 소스로 공개하여, AI 에이전트 개발을 다양한 분야에서 더 접근 가능하고 적응 가능하도록 만들었습니다. 모델 주도적 접근을 통해 복잡성을 추상화하여 지능적인 에이전트를 구축, 조정, 배포하는 작업을 쉽게 만들어줍니다.

BLIP3-o는 CLIP 임베딩과 플로우 매칭을 활용한 멀티모달 모델로, 이미지 이해 및 생성에 사용됩니다. 시각과 언어를 연결하는 관심이 높아지면서, 이미지 인식과 생성 기능을 통합한 시스템에 대한 연구가 확대되고 있습니다.

OpenAI가 262명 의사와 협력하여 개발한 HealthBench는 대형 언어 모델의 성능과 안전성을 현실적인 의료 시나리오에서 측정하는 오픈소스 평가 프레임워크이다. 기존 벤치마크의 한계를 극복하기 위해 실제 적용 가능성, 전문가 검증, 진단 범위에 초점을 맞추고 있다.

NVIDIA가 코드 추론과 문제 해결을 위해 고안된 고성능 대형 언어 모델 세트인 OCR 모델을 Apache 2.0 라이선스로 오픈 소스화했다. 32B, 14B, 7B 버전은 최고 성능을 자랑하며 OAI 모델을 능가하는 벤치마킹 결과를 보였다.

OpenPipe는 ART·E (이메일 자율 검색 도구)를 소개했는데, 이는 인박스 내용을 기반으로 사용자 질문에 답변하는 데 중점을 둔 오픈소스 연구 에이전트로, 정확성, 응답성 및 계산 효율성에 초점을 맞추고 있다. ART·E는 강화 학습을 통해 대형 언어 모델 에이전트를 튜닝하여 전문화된, 고 신호 사용 사례에 적합성을 증명하고 있다.

MIT의 새로운 협회는 연구자와 산업을 연결하여 영향에 초점을 맞출 것이다.