아제르바이잔의 통신사 아제르셀 텔레콤이 아마존 세이지메이커 AI를 활용해 아제르바이잔어 대형 언어 모델을 구축했습니다. 이 모델은 통신 분야와 고객 챗봇에 사용될 예정입니다.

아제르바이잔의 통신사 아제르셀 텔레콤이 아마존 세이지메이커 AI를 활용해 아제르바이잔어 대형 언어 모델을 구축했습니다. 이 모델은 통신 분야와 고객 챗봇에 사용될 예정입니다.

아마존 세이지메이커가 Python SDK v3.8.0에서 세 가지 새로운 기능을 발표했습니다. 이 글에서는 각 기능을 코드 예제와 함께 소개합니다.

아마존 세이지메이커 AI가 최적화된 생성적 AI 추론 추천을 지원합니다. 이를 통해 검증된 최적 배포 구성과 성능 지표를 제공하여 모델 개발자들이 인프라 관리가 아닌 정확한 모델 구축에 집중할 수 있도록 돕습니다.

아마존 세이지메이커에서 NVIDIA RTX PRO 6000 GPU를 탑재한 G7e 인스턴스를 출시했습니다. 이 인스턴스는 강력한 오픈 소스 모델을 호스팅할 수 있는 비용 효율적인 옵션을 제공합니다.

본문에서는 Mixture of Experts (MoE) 모델에 대한 멀티-로라 추론을 구현하는 방법과 커널 수준의 최적화에 대해 설명하며, 이 작업에서 어떻게 이점을 얻을 수 있는지 보여줍니다. GPT-OSS 20B를 이 포스트 전체에서 주요 예제로 사용합니다.

이 글에서는 CLI와 SDK를 사용하여 AWS 계정에서 세이지메이커 하이퍼팟 클러스터를 생성하고 관리하는 방법을 소개합니다. 실제 예시를 통해 사용자 워크플로와 매개변수 선택에 대해 자세히 살펴봅니다.

아마존 세이지메이커 하이퍼팟에서의 체크포인트 없는 트레이닝은 모델 트레이닝에서 기존의 체크포인팅 필요성을 줄이고, 동료 간 상태 복구를 통해 생산 규모 검증 결과에서 복구 시간을 80~93% 단축하고, 수천 대의 AI 가속기로 이루어진 클러스터에서 최대 95%의 훈련 처리량을 달성했다.

스토리보드는 현대 콘텐츠 제작의 중심 역할을 하는데, 아마존 노바 캔버스와 노바 릴 같은 AI 기반 모델(FMs)이 이 랜드스케이프를 변화시키고 있다. 이를 통해 손그림 순차적인 일러스트를 사용하는 전통적인 방식에서 벗어나 스토리를 매핑할 수 있다.

아마존 세이지메이커를 사용하여 GPT-OSS 모델을 세밀하게 조정하는 방법에 대한 시리즈 중 두 번째 포스팅이다. 이번 글에서는 오픈 소스 허깅페이스 라이브러리를 이용해 GPT-OSS 모델을 세밀하게 조정하는 방법을 다룬다.

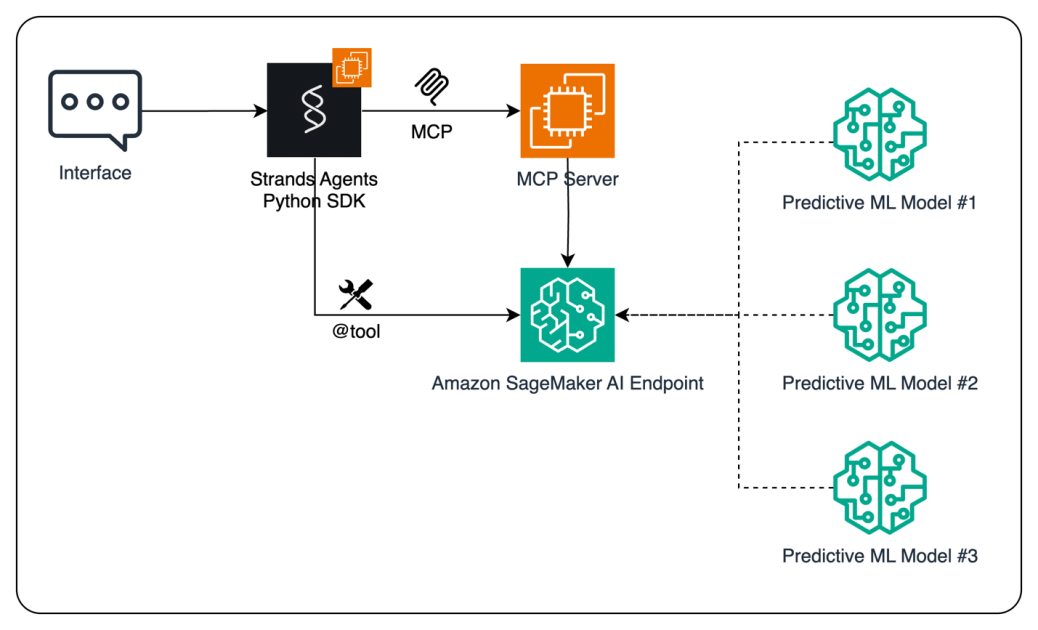

이 포스트에서는 아마존 SageMaker AI와 MCP를 활용하여 예측적 머신러닝 모델을 통합하여 AI 에이전트의 능력을 향상하는 방법을 소개합니다. Strands Agents SDK와 SageMaker AI의 유연한 배포 옵션을 사용하여, 개발자들은 대화형 AI를 강력한 예측 분석 기능과 결합한 고급 AI 애플리케이션을 만들 수 있습니다.

아마존 세이지메이커 캔버스는 노코드 솔루션을 제공하여 데이터 전처리를 간편화하고 기술적 배경이 없는 사용자도 시계열 예측이 가능하게 합니다. 이 글에서는 세이지메이커 캔버스와 데이터랭글러가 제공하는 노코드 데이터 준비 기술을 탐구하며 모든 배경을 가진 사용자들이 자신감을 가지고 데이터를 준비하고 시계열 예측 모델을 구축할 수 있도록 돕는 방법을 살펴봅니다.

Amazon Bedrock 에이전트를 사용하면 에이전트 생성이 간소화되고 컨트롤 반환 기능이 원활하게 통합되어 분산 시스템과 마이크로서비스 아키텍처의 통신 조정이 혁신적으로 진행될 수 있다. 이 글에서는 Amazon Bedrock 에이전트가 에이전트 생성을 혁신하며 다양한 시스템 간 복잡한 상호작용을 조정하는 컨트롤 반환 기능의 효과를 보여준다.

이 글에서는 선도적인 GeoFM인 Clay Foundation의 Clay foundation 모델이 Amazon SageMaker에서 대규모 추론과 세밀한 조정을 위해 어떻게 배포되는지 살펴본다.

아마존 세이지메이커 하이퍼팟은 대규모 모델 학습의 어려움과 하드웨어 장애에 초점을 맞추어 학습 비용을 줄이고 효율성을 향상시키는 솔루션에 대해 탐구한다.