아마존 세이지메이커 하이퍼팟에서의 체크포인트 없는 트레이닝은 모델 트레이닝에서 기존의 체크포인팅 필요성을 줄이고, 동료 간 상태 복구를 통해 생산 규모 검증 결과에서 복구 시간을 80~93% 단축하고, 수천 대의 AI 가속기로 이루어진 클러스터에서 최대 95%의 훈련 처리량을 달성했다.

아마존 세이지메이커 하이퍼팟에서의 체크포인트 없는 트레이닝은 모델 트레이닝에서 기존의 체크포인팅 필요성을 줄이고, 동료 간 상태 복구를 통해 생산 규모 검증 결과에서 복구 시간을 80~93% 단축하고, 수천 대의 AI 가속기로 이루어진 클러스터에서 최대 95%의 훈련 처리량을 달성했다.

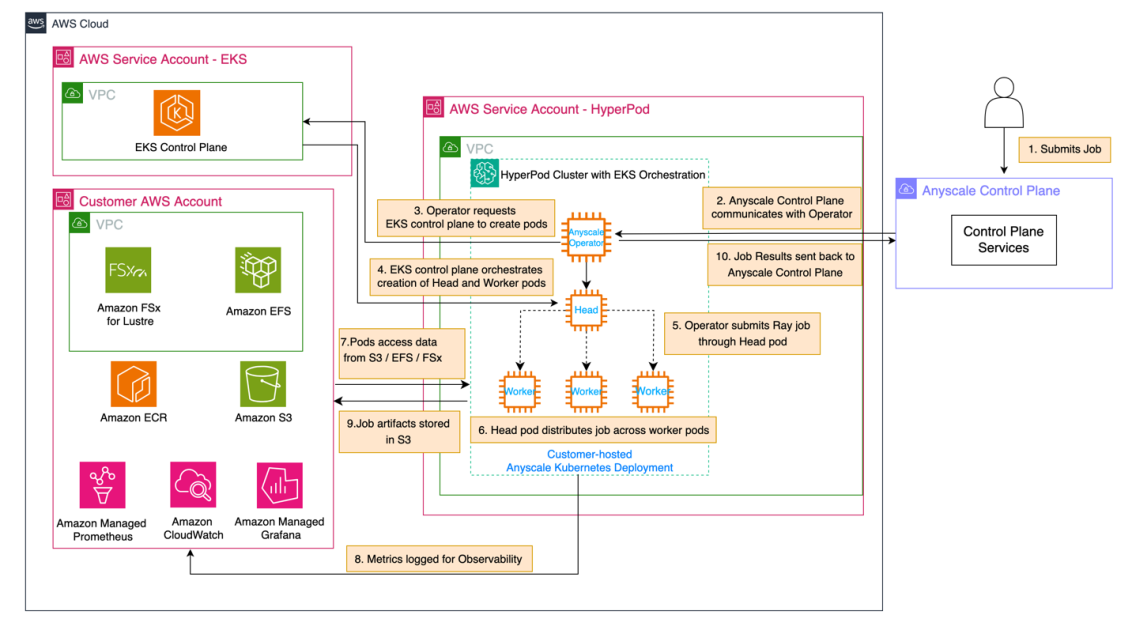

이 블로그에서는 아마존 세이지메이커 하이퍼팟을 애니스케일 플랫폼과 통합하여 대규모 AI 모델의 구축과 배포에 필수적인 인프라 문제를 해결하는 방법을 보여줍니다. 이 통합 솔루션은 분산 AI 워크로드에 대한 견고한 인프라를 제공하며 고성능 하드웨어, 지속적인 모니터링, 그리고 선도적인 AI 컴퓨트 엔진인 Ray와의 원활한 통합을 통해 조직이 시장 진입 시간을 단축하고 총 소유 비용을 낮출 수 있습니다.

아마존 세이지메이커 하이퍼팟은 세이지메이커 JumpStart의 기본 모델 및 Amazon S3 또는 Amazon FSx에서 사용자 정의 또는 세밀하게 조정된 모델을 배포하는 지원을 발표했습니다. 이러한 기능을 통해 고객은 동일한 하이퍼팟 컴퓨팅 리소스에서 모델을 학습, 세밀하게 조정 및 배포하여 전체 모델 수명 주기 동안 리소스 활용을 극대화할 수 있습니다.

도쿄 과학 연구소가 아마존 세이지메이커 하이퍼팟을 사용하여 70억 개의 파라미터를 가진 일본어 능력이 향상된 대형 언어 모델 Llama 3.3 Swallow을 성공적으로 훈련시켰다. 이 모델은 GPT-4o-mini 및 다른 선두 모델을 능가하는 일본어 작업에서 우수한 성능을 보여준다. 이 기술 보고서는 프로젝트 중 개발된 훈련 인프라, 최적화 및 모범 사례를 상세히 설명한다.