로봇들이 GPT-3 시대로 진입하고 있습니다. 연구자들은 오랫동안 로봇을 대규모 언어 모델 (LLM)을 구동하는 자기 회귀(AR) 모델을 사용하여 훈련하려고 노력해왔습니다. 모델이 문장에서 다음 단어를 예측할 수 있다면 로봇 팔의 다음 움직임도 예측할 수 있어야 합니다. 그러나 기술적 한계가 있었습니다.

로봇들이 GPT-3 시대로 진입하고 있습니다. 연구자들은 오랫동안 로봇을 대규모 언어 모델 (LLM)을 구동하는 자기 회귀(AR) 모델을 사용하여 훈련하려고 노력해왔습니다. 모델이 문장에서 다음 단어를 예측할 수 있다면 로봇 팔의 다음 움직임도 예측할 수 있어야 합니다. 그러나 기술적 한계가 있었습니다.

오픈에이아이가 GPT-5.3-Codex를 소개했다. 이 모델은 코딩 및 컴퓨터 작업을 다루는 새로운 코딩 모델로, GPT-5.2-Codex의 코딩 성능과 GPT-5.2의 추론 및 전문 지식 능력을 결합하여 단일 시스템으로 운영되며 25% 빠르다.

알리바바의 Qwen3-Max-Thinking은 파라미터 규모를 확장하는 것뿐만 아니라, 추론 방식을 변화시키며 생각의 깊이에 대한 명시적 제어와 검색, 메모리, 코드 실행을 위한 내장 도구를 갖추고 있습니다. 이 모델은 36조 토큰에 사전 훈련된 1조 파라미터 MoE 플래그십 LLM으로, 데이터 및 배포 측면에서 Qwen3-Max-Thinking은 […]

Inworld AI가 실시간 음성 에이전트에 대한 업그레이드 된 Inworld TTS-1.5를 출시했다. TTS-1.5는 지연 시간, 품질 및 비용에 엄격한 제약 조건을 가진 음성 에이전트를 대상으로 하며, 인공 분석에서 최고 순위의 텍스트 음성 변환 시스템으로 소개되었다. 이전 세대보다 표현이 풍부하고 안정적이며, 더욱 향상된 디자인을 가지고 있다.

Meta 연구진은 PEAV(Perception Encoder Audiovisual)를 소개했는데, 이는 오디오와 비디오의 통합 이해를 위한 새로운 인코더 패밀리로, 약 100M개의 오디오 비디오 쌍과 텍스트 캡션을 대규모 대조적 학습을 통해 단일 임베딩 공간에서 정렬된 오디오, 비디오 및 텍스트 표현을 학습한다.

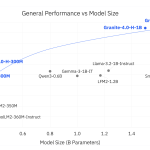

IBM AI 팀이 Granite 4.0 Nano를 출시했다. 이 모델은 로컬 및 엣지 추론을 대상으로 하는 소형 모델로, 기업 제어 및 오픈 라이선스를 갖추고 있으며, 350M과 1B 정도의 두 가지 크기의 8개 모델로 구성되어 있다.

KTH의 Speech, Music and Hearing 그룹이 공개한 VoXtream은 실시간 TTS 모델로, 사람이 음성을 듣기 전에 잠시의 침묵 없이 말을 시작한다. 이는 실시간 에이전트, 실시간 더빙, 동시 통역 등에 혁명을 일으킬 것으로 기대된다.

Xiaomi의 MiMo 팀이 100백만 시간 이상의 오디오를 기반으로 한 7조 파라미터 음성 언어 모델 ‘MiMo-Audio’를 공개했다. 새로운 점은 과업별 헤드나 손실 악센트 토큰에 의존하는 대신, RVQ 토크나이저를 사용하여 의미론적 정보 및 음성을 타깃팅한다.

AI2, 워싱턴대학 및 CMU의 연구진이 유동 벤치마킹을 소개하며, 정적 정확도를 2개 매개변수 IRT 능력 추정 및 Fisher 정보 기반 항목 선택으로 대체하는 적응형 LLM 평가 방법을 도입했다. 모델의 현재 능력에 대해 가장 정보가 풍부한 질문만 하므로 더 부드러운 훈련 곡선을 제공하고 벤치마킹을 지연시킵니다.

알리바바 클라우드의 Qwen 팀이 Qwen3-ASR Flash를 공개했다. 이는 Qwen3-Omni의 강력한 지능을 기반으로 한 올인원 자동 음성 인식(ASR) 모델로, 여러 시스템을 번갈아가며 사용하지 않고 다국어, 소음, 도메인별 전사를 간단하게 처리한다. 주요 기능은 edtech 플랫폼(강의 캡처, 다국어 지도), 미디어(자막, 성우), 고객 서비스(다국어 IVR) 등이다.

텐센트의 훈유안팀이 훈유안-MT-7B(번역 모델) 및 훈유안-MT-Chimera-7B(앙상블 모델)을 공개했다. 두 모델은 다국어 기계 번역을 위해 특별히 설계되었으며, WMT2025 General Machine Translation 대회에서 훈유안-MT-7B가 31개 언어 쌍 중 30개에서 1위를 차지했다.

FlexOlmo는 데이터를 공유하지 않고도 대규모 언어 모델을 개발할 수 있는 방법을 제시하며, 공개되지 않거나 제한이 있는 데이터셋에 대한 의존성을 줄입니다.

Mistral AI가 Voxtral을 발표했다. Voxtral은 오디오와 텍스트 입력을 처리하는 Voxtral-Small-24B 및 Voxtral-Mini-3B 모델로, 자동 음성 인식(ASR)과 자연어 이해 기능을 통합한다. Apache 2.0 라이선스로 공개된 Voxtral은 전사, 요약, 질문 응답 등에 실용적인 솔루션을 제공한다.

밀도 기능 이론(DFT)은 현대 계산 화학과 재료 과학의 기초 역할을 합니다. 그러나 높은 계산 비용으로 인해 사용이 제한됩니다. 기계 학습 상호 원자력(MLIP)은 DFT 정확도를 근접하게 흉내내며 계산 시간을 현저히 단축시키는 잠재력이 있습니다.

Kyutai가 2조 개의 파라미터로 구성된 혁신적인 스트리밍 텍스트 음성 변환 모델을 발표했습니다. 이 모델은 초저지연 시간(220밀리초)으로 고품질의 오디오 생성을 제공하며 전례없는 2.5백만 시간의 오디오로 훈련되었습니다. CC-BY-4.0에 따라 라이선스가 부여되었습니다.