본문에서는 Mixture of Experts (MoE) 모델에 대한 멀티-로라 추론을 구현하는 방법과 커널 수준의 최적화에 대해 설명하며, 이 작업에서 어떻게 이점을 얻을 수 있는지 보여줍니다. GPT-OSS 20B를 이 포스트 전체에서 주요 예제로 사용합니다.

본문에서는 Mixture of Experts (MoE) 모델에 대한 멀티-로라 추론을 구현하는 방법과 커널 수준의 최적화에 대해 설명하며, 이 작업에서 어떻게 이점을 얻을 수 있는지 보여줍니다. GPT-OSS 20B를 이 포스트 전체에서 주요 예제로 사용합니다.

글로벌 교차 지역 추론을 통해 요청을 라우팅하고 데이터가 어디에 있는지 보여주며, 필요한 IAM 권한을 구성하고 전 세계 추론 프로필 ARN을 사용하여 Claude 4.5 모델을 호출하는 방법을 안내합니다. 업무량을 위한 할당량 증가 요청하는 방법도 다룹니다. af-south-1에서 글로벌 교차 지역 추론을 구현할 수 있게 됩니다.

dLocal은 AWS 팀과 긴밀히 협력하여 제품 로드맵을 구상하고 산업 혁신가로서의 역할을 강화하며 글로벌 핀테크 분야의 운영 우수성에 대한 새로운 기준을 설정했습니다.

아마존은 세이지메이커 스튜디오를 위한 새로운 기능인 SOCI(Seekable Open Container Initiative) 인덱싱을 소개했다. SOCI는 컨테이너 이미지의 지연 로딩을 지원하여 초기에 이미지의 필요한 부분만 다운로드하고 전체 컨테이너를 다운로드하지 않는다.

Amazon SageMaker AI with MLflow가 새로운 서버리스 기능을 도입했다. 이로써 AI 및 머신러닝 작업을 위한 인프라 프로비저닝, 확장 및 운영을 동적으로 관리할 수 있게 되었다. 이번 포스팅에서는 이러한 새로운 기능이 SageMaker AI with MLflow를 통해 개선된 성능, 자동화, 보안을 제공하며 대규모 MLflow 워크로드를 실행하는 방법을 탐구한다.

AWS의 전문가들이 생성 모델 AI를 통해 조직이 우수한 성과를 거둘 수 있도록 도와주는 전략을 소개합니다.

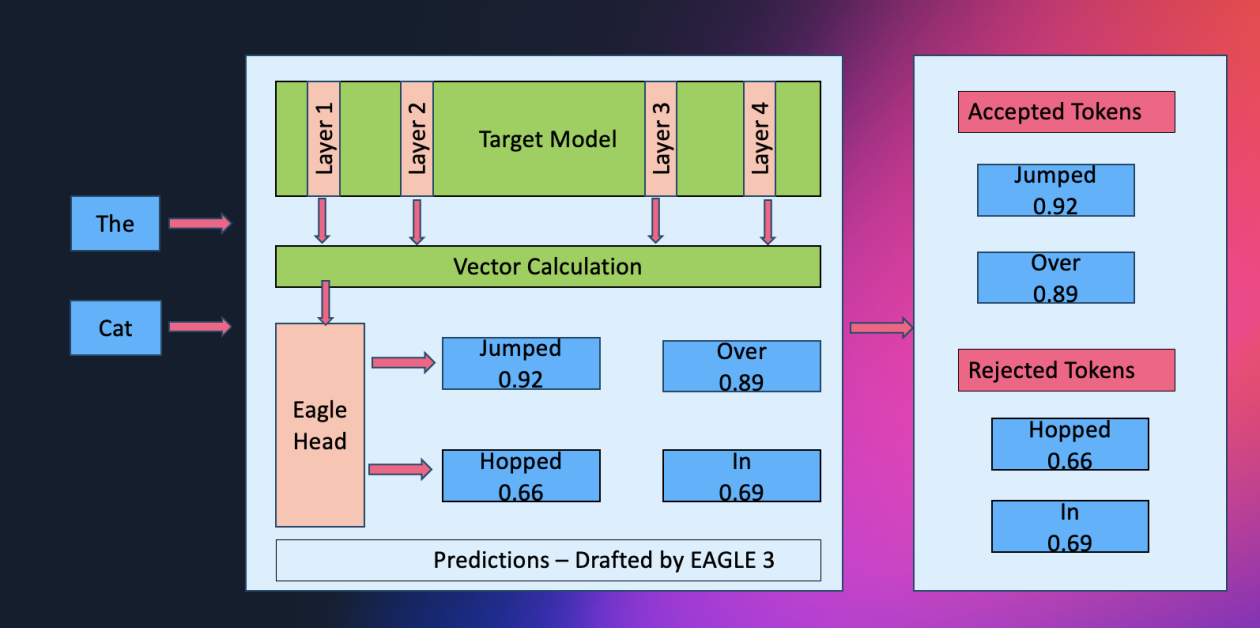

아마존 세이지메이커 AI가 EAGLE을 기반으로 한 적응형 추측 디코딩을 지원하며, 이 기술은 출력 품질을 유지하면서 대형 언어 모델 추론 속도를 최대 2.5배 가속화합니다. 이 글에서는 아마존 세이지메이커 AI에서 EAGLE 2 및 EAGLE 3 추측 디코딩을 사용하는 방법, 솔루션 아키텍처, 데이터셋 최적화 워크플로우, 그리고 증가된 처리량과 낮은 대기 시간을 보여주는 벤치마크 결과에 대해 설명합니다.

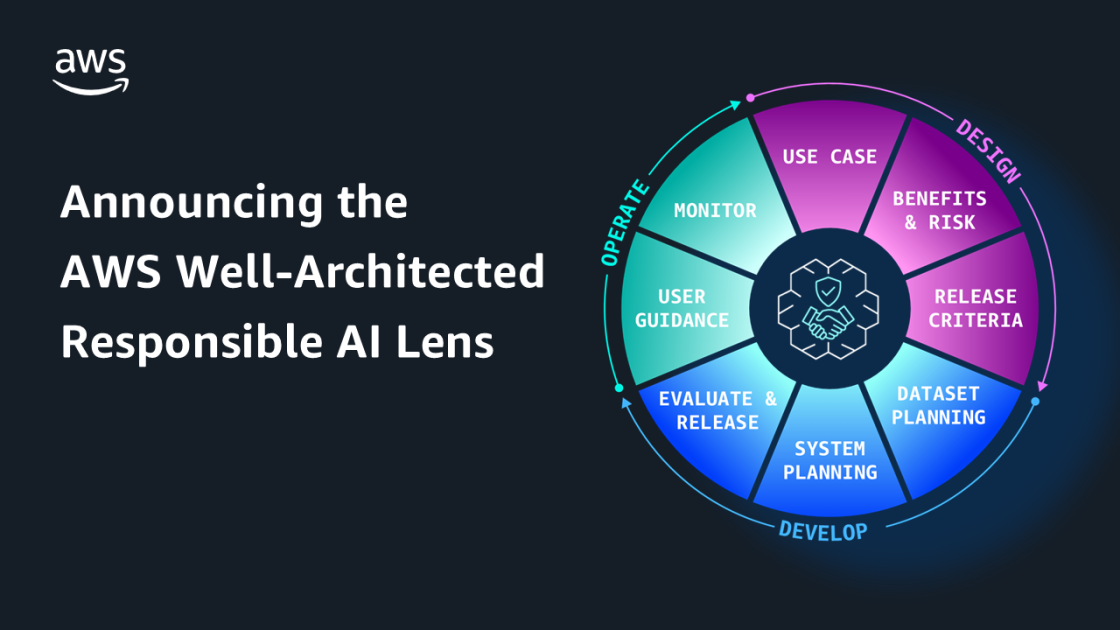

AWS Well-Architected 책임 있는 AI 렌즈는 적절한 질문과 모범 사례를 제공하여 개발 및 운영 과정에서 책임 있는 AI 문제를 해결하는 데 도움을 줍니다.

Anthropic의 클로드 소네 4.5와 하이쿠 4.5가 아마존 베드락에서 출시되어, 생성 AI 모델의 혁신을 이루어냈다. 이러한 최첨단 모델은 복잡한 작업, 코딩, 기업 작업에서 뛰어난 성과를 보여주며 개발자들에게 향상된 기능을 제공한다.

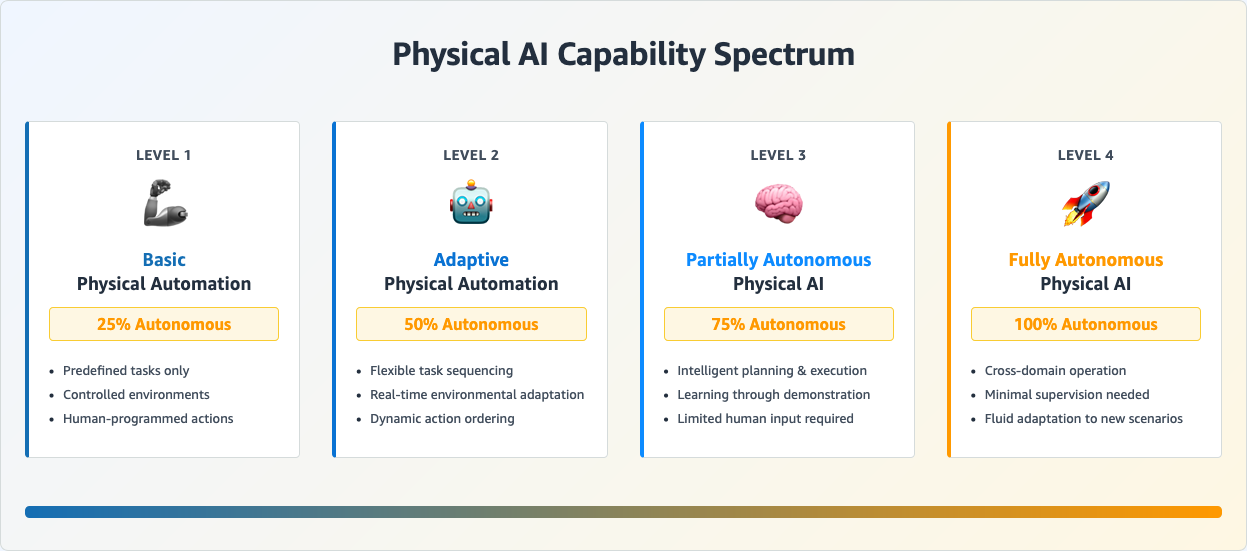

물리 AI는 인공지능이 디지털 경계를 넘어 우리 주변의 현실 세계를 인식, 이해, 조작하는 지능적 자동화의 다음 단계를 나타낸다.

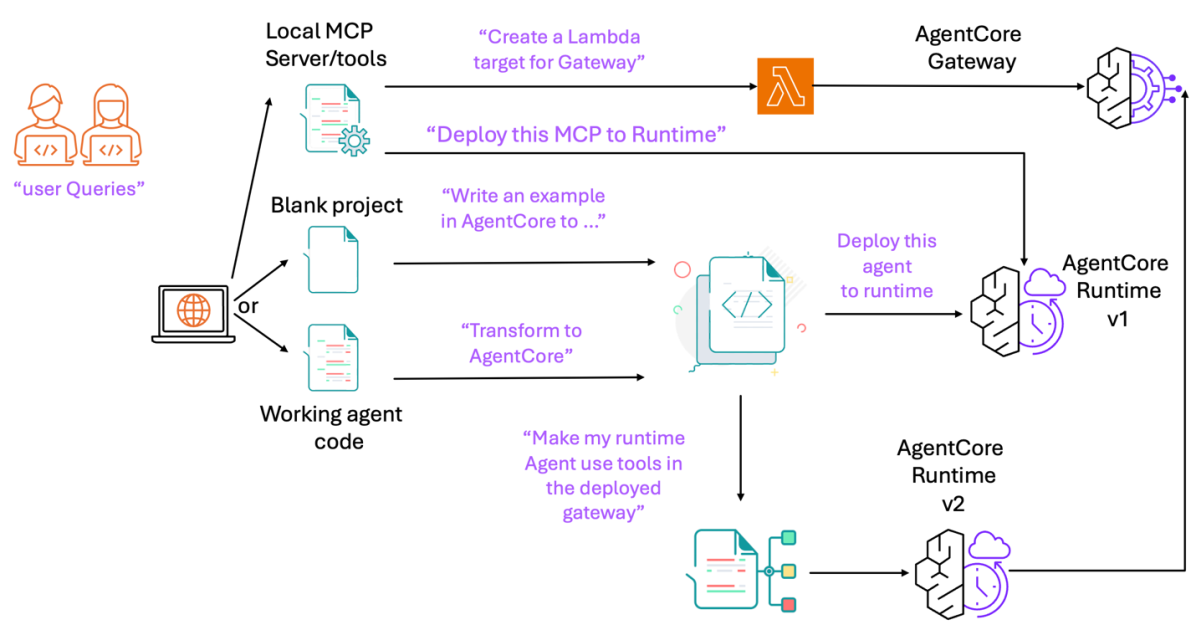

Amazon Bedrock AgentCore MCP 서버를 사용하면 Bedrock AgentCore와 호환되는 구성 요소를 빠르게 생성할 수 있으며, 런타임, 게이트웨이 통합, 식별 관리 및 에이전트 메모리에 대한 내장 지원이 제공됩니다. 빠른 프로토타이핑 및 제품용 AI 솔루션에 AgentCore MCP 서버를 사용할 수 있습니다.

Amazon Bedrock에서 가져온 모델에 로그 확률이 어떻게 작용하는지 알아봅니다. 로그 확률의 개념, API 호출에서 활성화하는 방법, 반환된 데이터 해석 방법을 배우고, 잠재적 환각 감지부터 RAG 시스템 최적화 및 세밀하게 조정된 모델 평가에 이르기까지 이러한 통찰력이 AI 애플리케이션을 개선하는 방법을 강조합니다.

실제 비디오 및 이미지 분석에서 기업들은 종종 모델의 원래 학습 세트에 포함되지 않은 객체를 감지하는 어려움을 겪습니다. 특히 새로운, 알려지지 않은 또는 사용자 정의 객체가 자주 나타나는 동적 환경에서 이는 특히 어려워집니다. 이 게시물에서는 Amazon Bedrock Data Automation이 OSOD를 활용하여 비디오 이해력을 향상하는 방법을 탐구합니다.

기술 혁신 연구소(TII)의 Falcon-H1 모델이 Amazon Bedrock Marketplace 및 Amazon SageMaker JumpStart에 출시되었습니다. 이를 통해 개발자와 데이터 과학자들은 AWS에서 여섯 가지 Falcon-H1 모델(0.5B, 1.5B, 1.5B-Deep, 3B, 7B, 34B)을 사용할 수 있게 되었으며 전통적인 어텐션 메커니즘과 State Space Models(SSMs)를 결합한 하이브리드 아키텍처 모델을 통해 탁월한 성능과 획기적인 효율성을 제공받을 수 있습니다.

아마존 세이지메이커를 사용하여 GPT-OSS 모델을 세밀하게 조정하는 방법에 대한 시리즈 중 두 번째 포스팅이다. 이번 글에서는 오픈 소스 허깅페이스 라이브러리를 이용해 GPT-OSS 모델을 세밀하게 조정하는 방법을 다룬다.

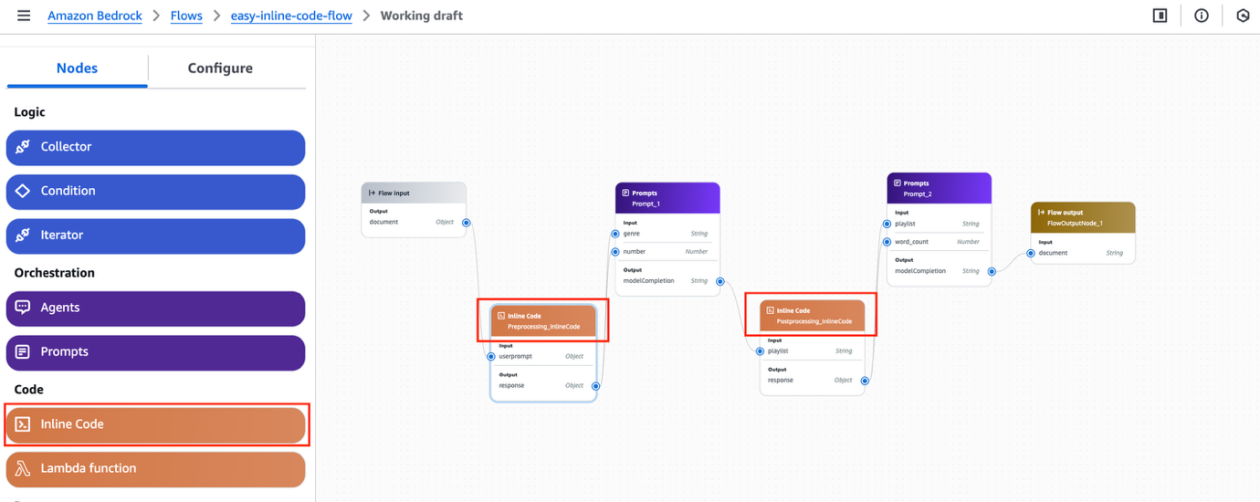

아마존 베드락 플로우의 공개 미리보기로 인라인 코드 노드 지원이 가능해졌습니다. 이 강력한 새로운 기능을 통해 워크플로우 내에서 파이썬 스크립트를 직접 작성할 수 있어 간단한 로직에 대한 별도의 AWS 람다 함수가 필요 없어졌습니다. 이 기능은 데이터 정규화와 응답 서식 지정과 같은 전처리 및 후처리 작업을 간소화하여 창조적 AI 애플리케이션 개발을 단순화하고 조직 전체에서 더 접근성 있게 만듭니다.

새로운 코드 편집기와 다중 공간 지원을 활용하여 SageMaker 통합 스튜디오에서 ML 파이프라인을 개발하는 방법을 안내합니다. 이 샘플 솔루션은 전형적인 ML 활동을 자동화하여 ML 모델을 구축, 훈련, 평가 및 (선택적으로) 배포하는 방법을 보여줍니다.

AWS는 AWS 창의적 AI 혁신 센터에 1억 달러의 추가 투자를 발표했으며, 금융 서비스부터 의료 분야까지의 산업에서의 성공적인 고객 협업 두 해를 기념했다. 이 투자는 AI가 더 많은 자율적이고 행동적인 시스템으로 진화함에 따라 이루어졌으며, 이미 수천 명의 고객이 수백만 달러의 생산성 향상을 이끌고 고객 경험을 변화시키는 데 도움을 받고 있다.

2025년 7월 14일부터 AWS DeepRacer 학생 포털은 유지보수 단계로 진입하여 새로운 등록이 비활성화될 예정이다. 기존 사용자는 2025년 9월 15일까지 자료와 교육 자료에 대한 완전한 접근 권한을 유지할 수 있으며, 그 이후에는 포털이 더 이상 사용할 수 없게 된다.